【InternLM 实战营第二期】第三节 笔记

第三节 茴香豆:搭建你的 RAG 智能助理

参考:

视频教学:https://www.bilibili.com/video/BV1QA4m1F7t4/

文档链接:https://github.com/InternLM/Tutorial/blob/camp2/huixiangdou/readme.md

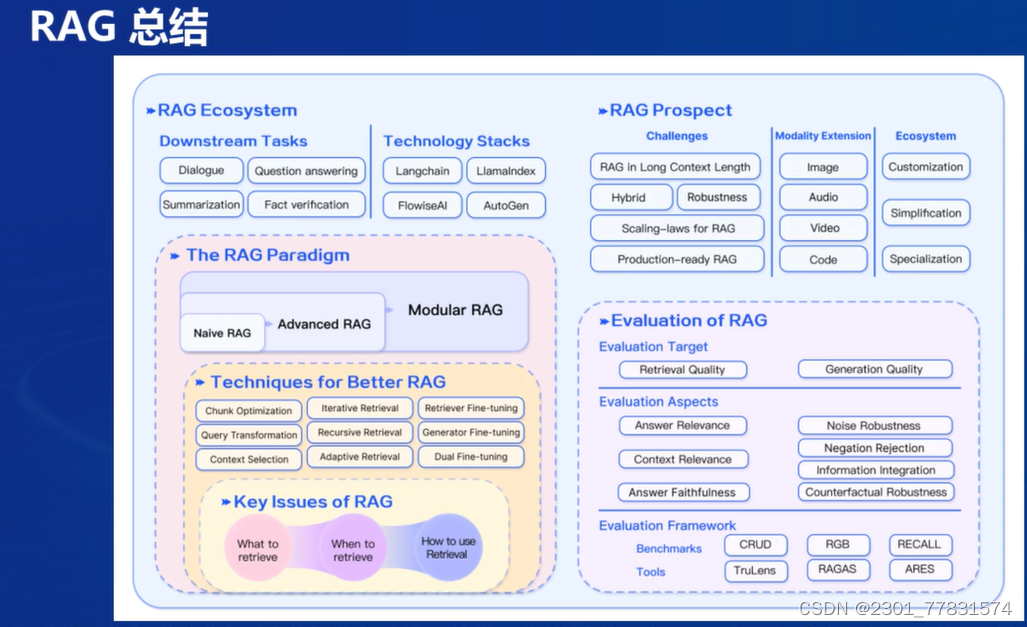

一、RAG

-

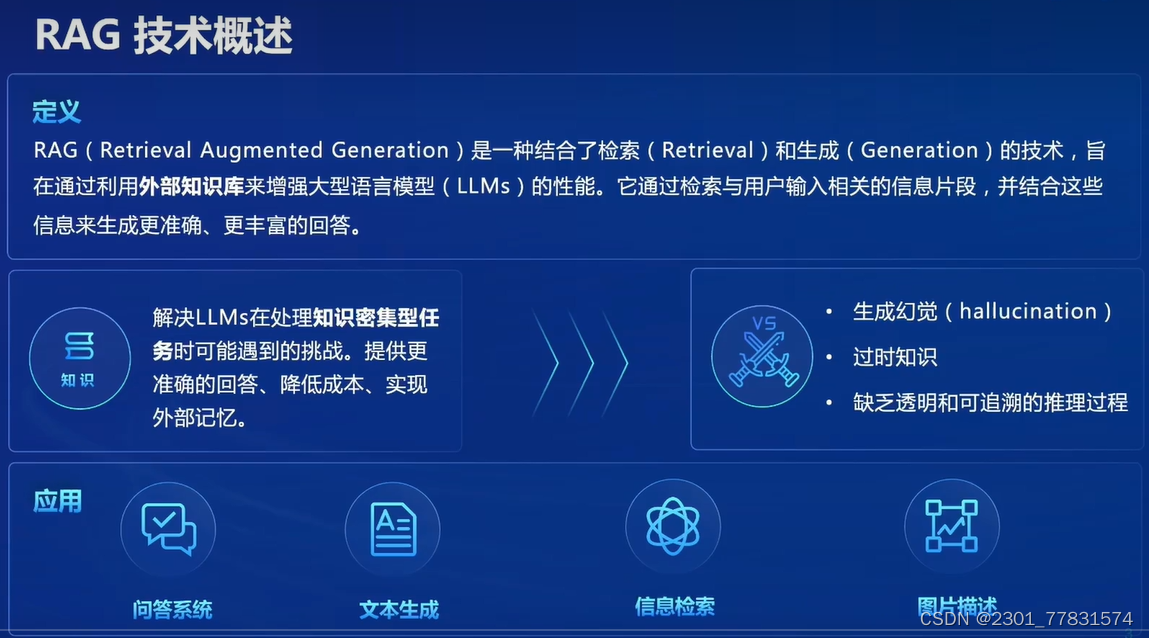

RAG定义

RAG(Retrieval Augmented Generation)技术,通过检索与用户输入相关的信息片段,并结合外部知识库来生成更准确、更丰富的回答。解决 LLMs 在处理知识密集型任务时可能遇到的挑战, 如幻觉、知识过时和缺乏透明、可追溯的推理过程等。提供更准确的回答、降低推理成本、实现外部记忆。

-

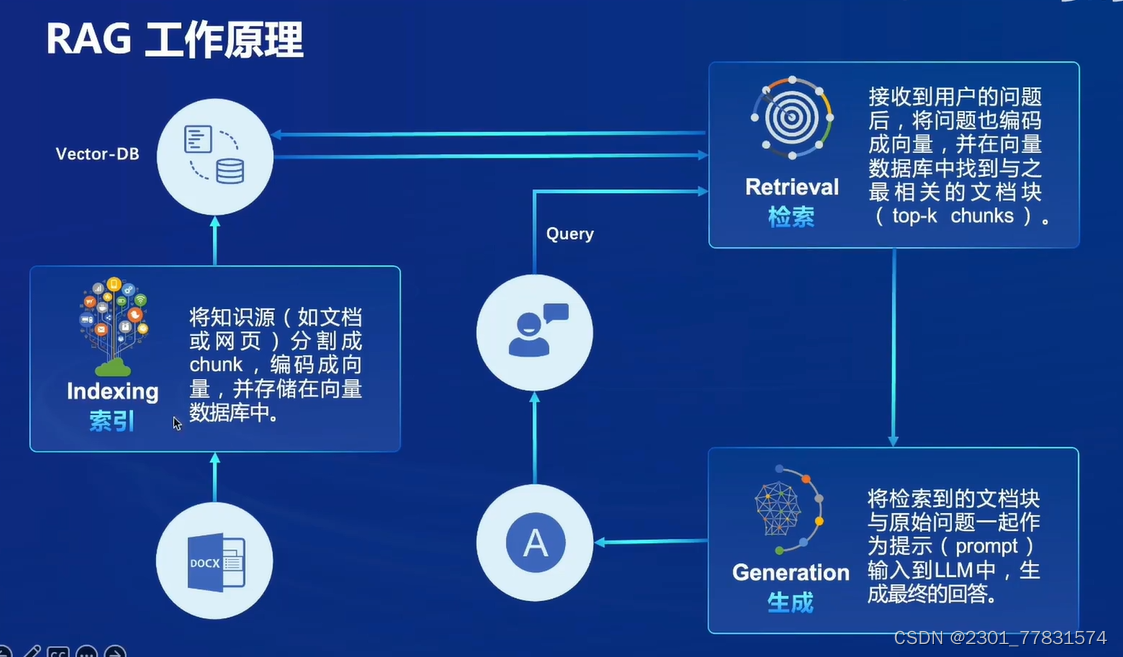

RAG工作原理

-

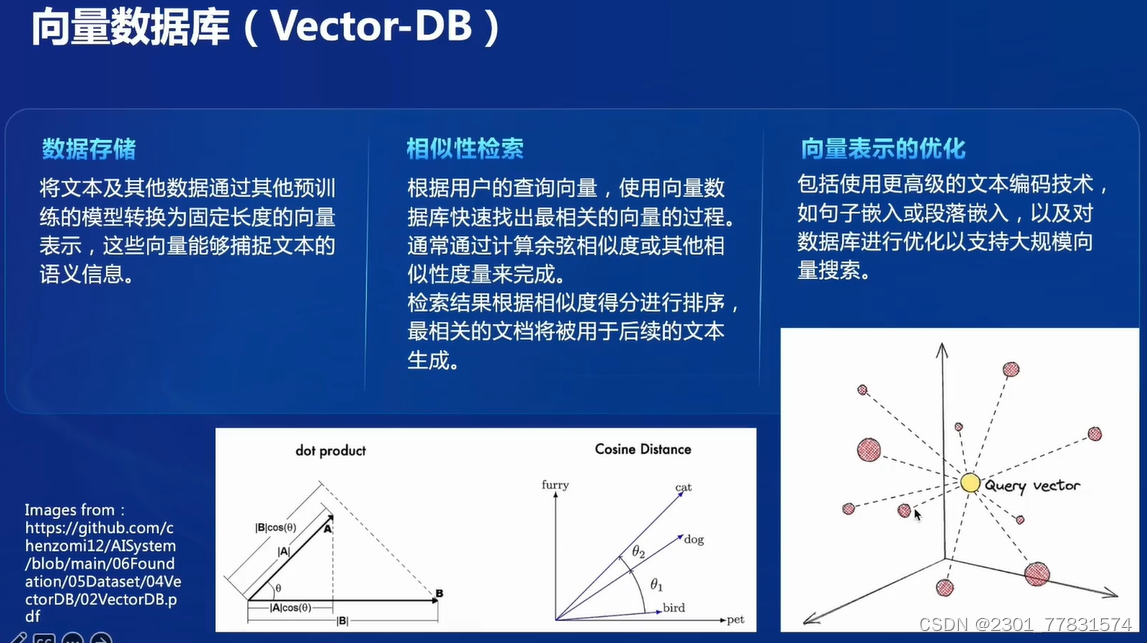

向量数据库(Vector-DB)

- 数据存储

- 相似性检索

- 向量表示的优化

-

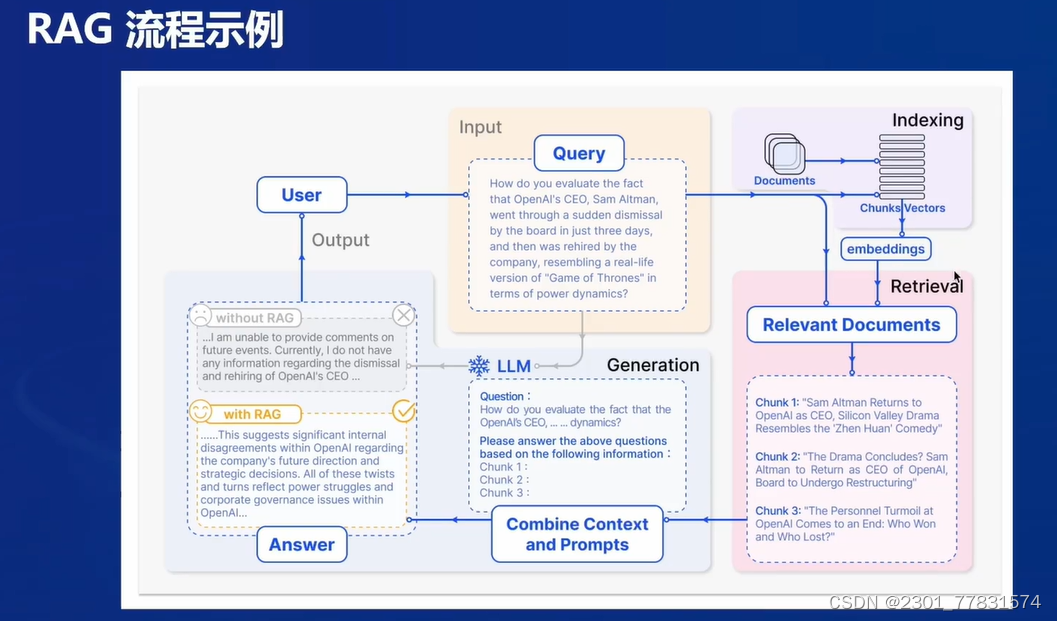

RAG流程实例

-

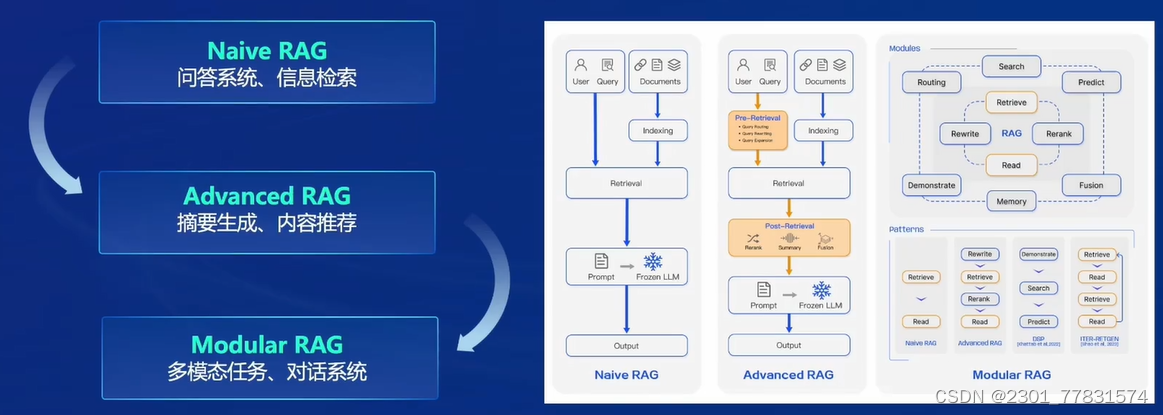

RAG发展进程

RAG的概念最早是由Meta(Facebook)的Lewis等人在2020《Retrieval-Augmented Generation foiKnowledge-Intensive NLp Tasks》中提出的。

-

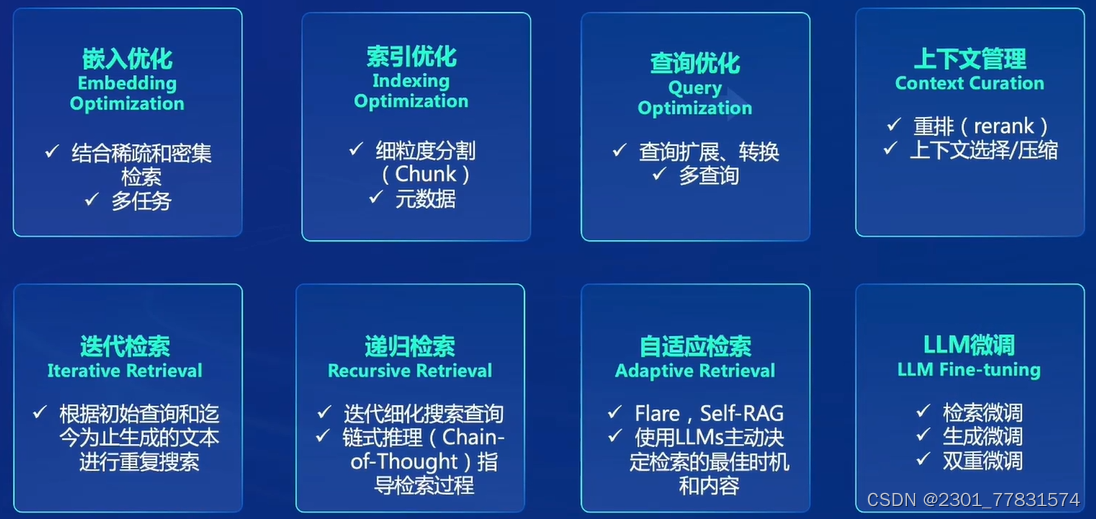

RAG常见优化方法

-

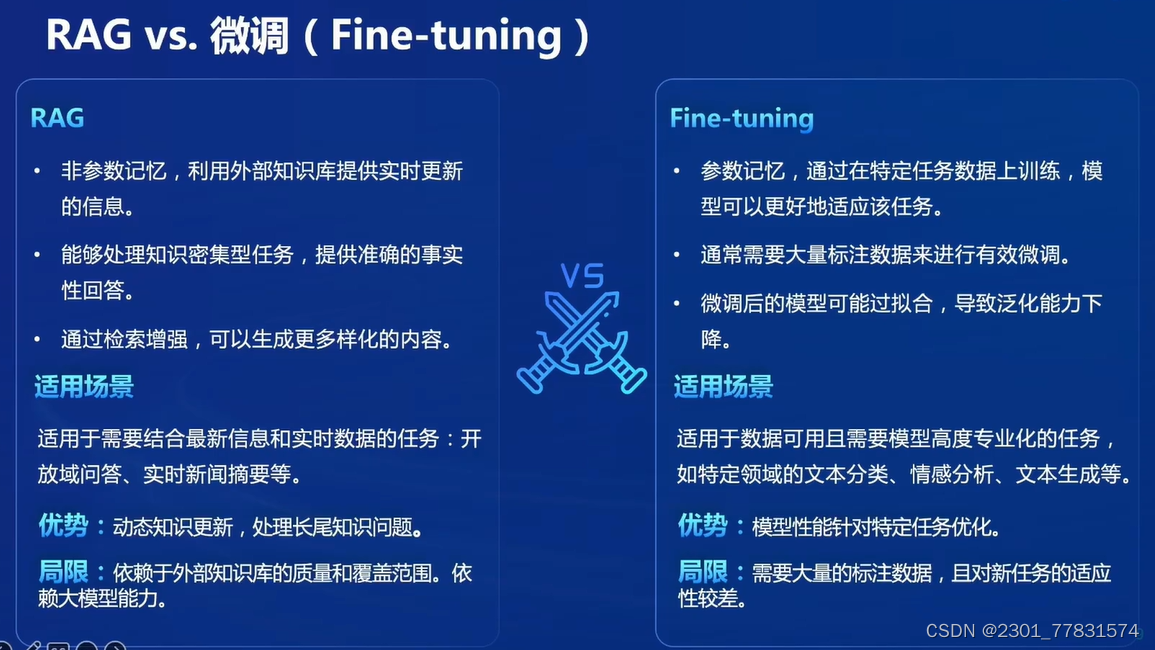

RAG vs 微调

-

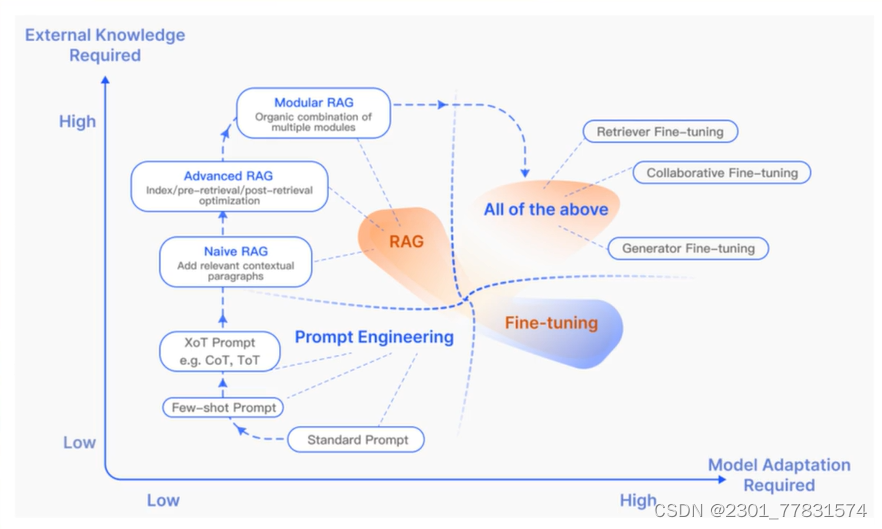

LLM模型优化方法比较

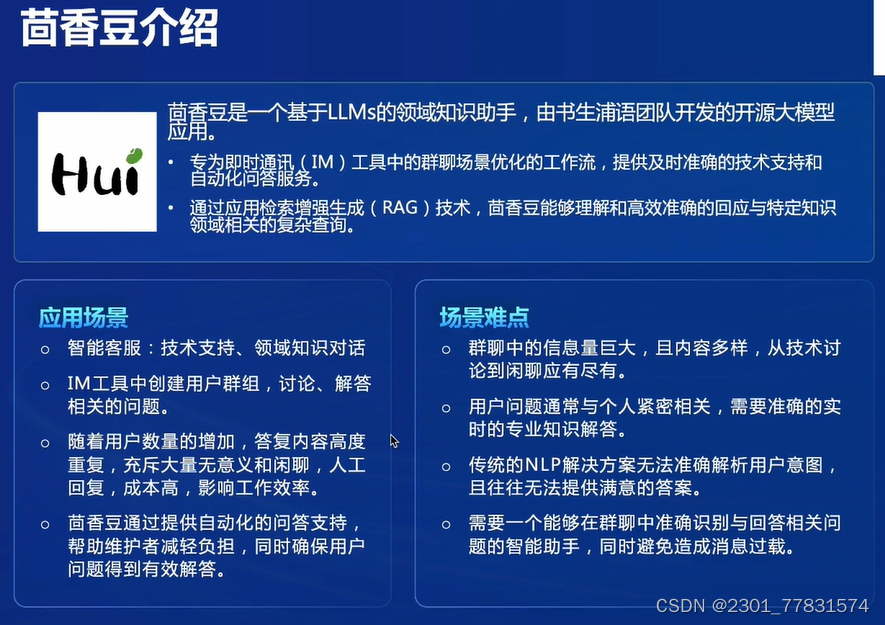

二、 茴香豆

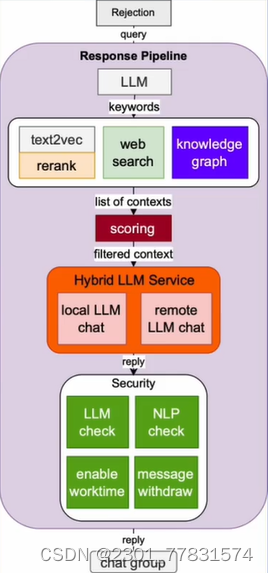

茴香豆完整工作流:

多来源检索、混合大模型、多重评分拒答工作流、安全检查

https://github.com/InternLM/HuixiangDou/blob/main/README_zh.md

本文介绍了InternLM实战营的第三节内容,详细讲解了RAG技术,包括其工作原理、Meta的提出背景、以及茴香豆项目中的应用,展示了如何通过多源检索、混合大模型等手段搭建一个准确且安全的智能助理系统。

本文介绍了InternLM实战营的第三节内容,详细讲解了RAG技术,包括其工作原理、Meta的提出背景、以及茴香豆项目中的应用,展示了如何通过多源检索、混合大模型等手段搭建一个准确且安全的智能助理系统。

534

534

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?