1、环境设置

Kafka 连接器提供从 Kafka topic 中消费和写入数据的能力。

官网链接:官网

方式1:在Maven工程中添加pom依赖

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-kafka</artifactId>

<version>1.17.1</version>

</dependency>

方式2:在 sql-client.sh 中添加 jar包依赖

将 flink-sql-connector-kafka-1.17.1.jar 上传到flink的lib目录下 (可以去官网下载jar包)

或者 启动 sql-client.sh 时,指定jar依赖

bin/sql-client.sh -j lib/flink-sql-connector-kafka-1.17.1.jar

2、读取Kafka

2.1 创建 kafka表

CREATE TABLE SourceKafkaTable (

指定物理字段,

指定元数据字段,

指定水位线生成策略

) WITH (

'connector' = 'kafka', --【必选】指定 连接器类型,kafka用'kafka'

'properties.bootstrap.servers' = 'localhost:9092', --【必选】指定 Kafka broker列表,用逗号分隔

'topic' = 'user_behavior', --【必选】指定 topic列表,用逗号分隔

'topic-pattern' = '.*log_kafka.*', --【必选】指定 匹配读取 topic 名称的正则表达式, 和 topic 配置一个即可

'properties.group.id' = 'testGroup', --【可选】指定 消费者组id,不指定时会自定生成 KafkaSource-{tableIdentifier}

'scan.startup.mode' = 'earliest-offset', --【可选】指定起始消费位点,默认值 earliest-offset

'format' = 'csv' --【必选】指定 消息的格式类型, 和 value.format 是等价的(配置一个即可)

);

2.2 读取 kafka消息体(Value)

在FlinkSQL读取kafka时,可以根据kafka存储的消息的格式,通过 ‘value.format’ = ‘csv|raw|json…’

来指定使用哪种格式来对kafka消息进行解析,并将解析的结果映射到表中的字段中去。

使用 ‘format’ = ‘json’ 解析json格式的消息

当 kafka消息为json格式,可以使用 ‘format’ = ‘json’ 在创建表时对json串进行解析,并将解析后的结果映射到表中的字段中去

**注意:**这种方式只能解析单层级的json格式,多层级时无法解析

如果为多层级json格式时,可以使用raw格式 + udf函数来对json进行解析

导入Maven的pom依赖

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-json</artifactId>

<version>1.17.1</version>

</dependency>

创建FlinkTable

-- TODO 创建用于读取kafka消息的flink表(消息格式为json)

-- kafka消息示例:{"ID":0,"NAME":"大王0"}

CREATE TABLE kafka_table_source_json (

`ID` STRING,

`NAME` STRING

) WITH (

'connector' = 'kafka',

'topic' = '20231009',

'properties.bootstrap.servers' = 'worker01:9092',

'properties.group.id' = 'FlinkConsumer',

'scan.startup.mode' = 'earliest-offset',

'format' = 'json',

'json.fail-on-missing-field' = 'false',

'json.ignore-parse-errors' = 'true'

);

-- TODO 解析json串时,容错性设置

'json.fail-on-missing-field' = 'false' -- 当解析字段缺失时,是跳过当前字段或行,还是抛出错误失败(默认为 false,即抛出错误失败)

'json.ignore-parse-errors' = 'true' -- 当解析异常时,是跳过当前字段或行,还是抛出错误失败(默认为 false,即抛出错误失败)。如果忽略字段的解析异常,则会将该字段值设置为null。

-- 触发读取kafka操作

select * from kafka_table_source_json;

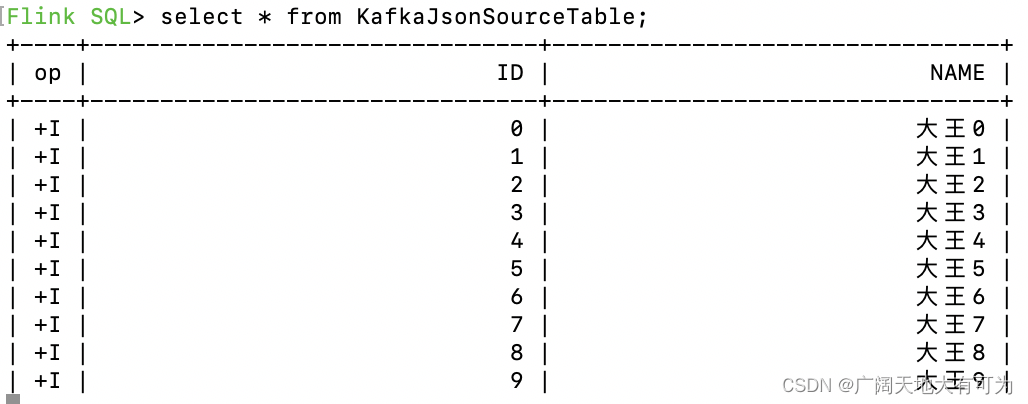

运行结果:

使用 ‘format’ = ‘csv’ 解析csv格式的消息

当 kafka消息为csv格式,可以使用 ‘format’ = ‘csv’ 在创建表时对csv进行解析,并将解析后的结果映射到表中的字段中去

导入Maven的pom依赖

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-csv</artifactId>

<version>1.17.1</version>

</dependency>

创建FlinkTable

-- TODO 创建用于读取kafka消息的flink表(消息格式为csv)

-- kafka消息示例:2,3.1

CREATE TABLE kafka_table_source_csv (

`order_id` BIGINT,

`price` DOUBLE

) WITH (

'connector' = 'kafka',

'topic' = 'csv_format',

'properties.bootstrap.servers' = 'worker01:9092',

'properties.group.id' = 'FlinkConsumer',

'scan.startup.mode' = 'earliest-offset',

'value.format' = 'csv'

);

-- 触发读取kafka操作

select * from kafka_table_source_csv;

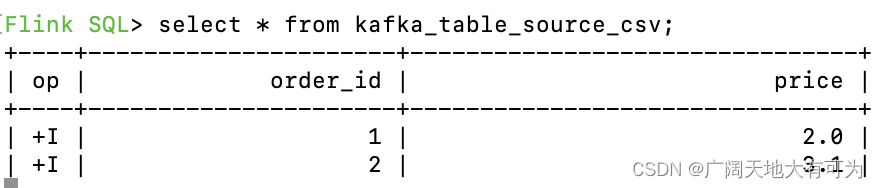

运行结果:

使用 ‘format’ = ‘raw’ 解析kafka消息为单个字符串字段

可以使用 ‘format’ = ‘raw’ 将kafka消息以原始格式映射到flink表中的string类型的字段中

创建FlinkTable

-- TODO 创建用于读取kafka消息的flink表(消息格式为json)

-- kafka消息示例:{"ID":0,"NAME":"大王0"}

CREATE TABLE kafka_table_source_raw (

`log` STRING

) WITH (

'connector' = 'kafka',

'topic' = '20231009',

'properties.bootstrap.servers' = 'worker01:9092',

'properties.group.id' = 'FlinkConsumer',

'scan.startup.mode' = 'earliest-offset',

'format' = 'raw'

);

-- 触发读取kafka操作

select * from kafka_table_source_raw;

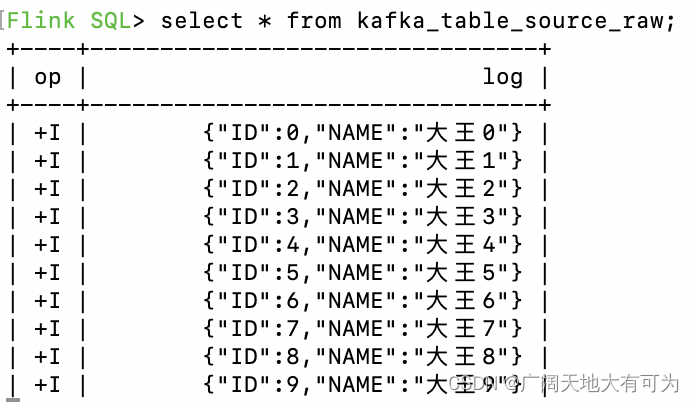

运行结果:

2.3 读取 kafka消息键(Key)

kafka消息信息:

{

"key":{

"ID_1":0,

"NAME_1":"大王0"

},

"value":{

"ID":0,

"NAME":"大王0"

},

"metadata":{

"offset":0,

"topic":"readKey",

"partition":0

}

}

创建FlinkTable

-- 读取kafka消息中的key部分

CREATE TABLE kafka_table_source_read_key (

`ID` STRING,

`NAME` STRING,

`ID_1` STRING,

`NAME_1` STRING

) WITH (

'connector' = 'kafka',

'topic' = 'readKey',

'properties.bootstrap.servers' = 'worker01:9092',

'properties.group.id' = 'FlinkConsumer',

'scan.startup.mode' = 'earliest-offset',

'key.format' = 'json',

'key.json.ignore-parse-errors' = 'true',

'key.fields' = 'ID_1;NAME_1',

'value.format' = 'json'

);

2.4 读取 kafka元数据(Metadata)

创建FlinkTable

-- TODO 创建读取kafka表时,同时读取kafka元数据字段

CREATE TABLE kafka_table_source_read_metadata (

`log` STRING,

**自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。**

**深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!**

**因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。**

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!**

**由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新**

**如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)**

**一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

2946318482)]

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!**

**由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新**

**如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)**

[外链图片转存中...(img-FkCqP0bu-1712946318482)]

**一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

955

955

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?