目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于大数据的疫情数据可视化分析系统

设计思路

一、课题背景

疫情数据的可视化分析对于理解和应对全球疫情具有重要意义。随着大数据技术的快速发展,利用大数据进行疫情数据的可视化分析可以帮助决策者和公众更好地了解疫情的传播趋势、地域分布以及相关特征,从而指导疫情防控工作和公众健康管理。因此,开发一个基于大数据的疫情数据可视化分析系统具有重要的现实意义和应用价值。

二、算法理论技术

使用Scrapy框架进行网页数据爬取,结合MySQL数据库进行数据存储,能够高效地采集所需信息。在实施过程中,需注意选择合适的爬取策略、时间规则和异常处理机制,确保数据的准确性和时效性。同时,遵守法律法规和尊重网站所有者的意愿至关重要。后期数据处理、测试与部署以及维护与监控也是整个流程中不可或缺的环节。

Scrapy框架的使用:

- 安装与配置: 首先,确保已安装Python和pip,然后使用pip安装Scrapy。配置Scrapy项目,包括设置项目名称、选择合适的中间件、调度器等。

- 选择爬取策略: 根据目标网站的结构和数据分布,选择合适的爬取策略。这可能包括深度优先、广度优先或其他定制策略。

- 定义爬虫: 在Scrapy项目中,需要定义一个或多个爬虫来执行实际的爬取任务。每个爬虫对应一个特定的网站或网站部分。

- 提取数据: 使用XPath或CSS选择器等技术从网页中提取所需的数据。这些数据可以直接存储或进一步处理后再存储。

- 数据存储: 将提取的数据导出到多种格式,如CSV、JSON等,或直接存储到数据库中。

KMeans算法是一种基础的聚类算法,是机器学习中常用的无监督学习算法。其核心思想是随机选取k个中心点,然后将每个数据点划分到最近的中心点所在的类中。接着,重新计算每个聚类的中心点位置,并重复这个过程,直到中心点不再变化或达到一定的迭代次数。

KMeans算法的时间复杂度和空间复杂度都是O(n),其中n为数据量。其优化算法K-means++在选取第一个聚类中心点的时候也是随机选取,当选取第二个中心点的时候,距离当前已经选择的聚类中心点的距离越远的点会有更高的概率被选中,这样可以大大降低找到最终聚类各个中心点的迭代次数,提高了效率。

在疫情数据抓取与处理过程中,由于数据冗杂和时间维度上的杂乱,导致存在不完整、冗余、冲突和错误等噪点数据。为了减少这些噪点对数据分析的影响,需要进行数据清洗,包括单独处理各属性疫情数据、数据聚类、分词识别等尝试性融合,以形成一个可一次性处理全部属性的数据集,从而提高数据处理的效率和准确性。ECharts是百度开源的数据可视化图表库,而PyEcharts则是将Python与ECharts结合的可视化工具,其交互性强、图表设计精巧。Python语言简洁易读,使开发者能更专注于问题解决而非语言本身。通过PyEcharts对疫情数据进行可视化处理,如折线图、柱状图、地图等,可直观展现数据规律,降低理解难度,快速洞察疫情态势。

相关代码示例:

import pandas as pd

from sklearn.cluster import KMeans

from sklearn.feature_extraction.text import TfidfVectorizer

def clean_data(df):

# 处理缺失值

df.dropna(inplace=True)

# 分割各属性数据

attributes = df.columns.tolist()

# 分别处理各属性数据

for attribute in attributes:

# 数据聚类,例如使用KMeans聚类算法

kmeans = KMeans(n_clusters=2) # 你可以根据需要调整聚类数量

kmeans.fit(df[attribute].values.reshape(-1, 1))

df[attribute] = kmeans.labels_

# 分词识别,例如使用TfidfVectorizer进行分词并转化为词频矩阵

vectorizer = TfidfVectorizer()

matrix = vectorizer.fit_transform(df[attribute].values)

df[attribute] = matrix.toarray()

return df三、检测的实现

3.1 数据集

由于网络上没有现有的合适的数据集,我亲自收集了全球范围内的疫情数据,并进行了整理和处理。我收集了各个地区的感染人数、康复人数、死亡人数等数据,并结合地理信息系统(GIS)技术,将数据与地图进行关联。通过这种方式,我能够捕捉到真实的疫情情况和地域分布,为我的研究提供了更准确、可靠的数据基础。我相信这个自制的疫情数据集将为疫情数据的可视化分析研究提供有力的支持,并为疫情防控和公共卫生领域的发展做出积极贡献。

数据清洗是数据预处理的关键步骤,旨在识别和纠正异常值、缺失值、重复值和格式错误等问题,以确保数据质量。通过有效的数据清洗,可以提高数据分析的准确性和可靠性,为后续的数据分析提供可靠的基础。

3.2 实验环境搭建

实验采用Python 3.10、PyEcharts 1.7.1以及Py-Charm 2022.1.1进行开发。通过PyEcharts库,可视化步骤包括导入数据包、准备数据、生成图表、对图表进行处理。具体而言,可以绘制折线图、热力图以及柱状图等。

3.3 实验及结果分析

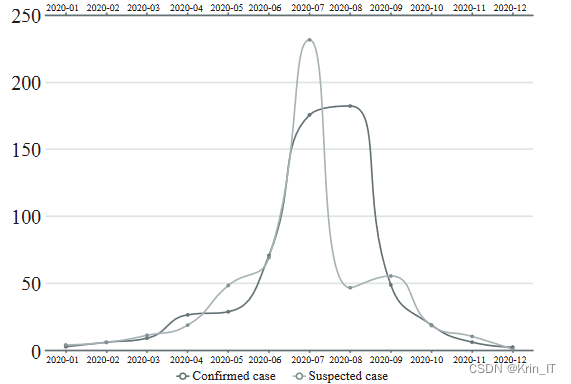

折线图在数据统计中广泛应用于展示信息波动和时间序列规律,包括疫情数据的治愈率、病死率和重症率。柱形图则用于对比不同类别事物的具体事件数据,如城市、省、全国和海外疫情数据。热力图通过颜色深度展示区域数值,直观地揭示疫情增长趋势和空间传播。词云则突出高频关键词,帮助识别疫情数据中的关键信息。这些可视化工具在疫情数据处理中发挥重要作用,有助于快速理解和应对疫情态势。

热力图通过颜色的深浅直观地展示数据密度或值的大小,帮助用户快速识别数据中的模式、趋势和异常点,适用于大规模数据集。关系图则使用圆圈和连线表示节点与节点之间的关系,常用于展示人物关系或用户行为活动,适用于连续型数据的分布展示。这两种图表各有特点,可根据具体需求选择使用,以实现数据可视化效果的最大化。

折线图统计方式可视化的目的在于直观地展示数据随时间变化的趋势和规律。通过将数据点连接成线,折线图能够清晰地呈现数据在时间轴上的变化趋势,便于观察和分析数据的长期变化和短期波动。相比其他图表类型,折线图在展示时间序列数据时具有更高的灵活性和可读性,能够更好地揭示数据之间的关联和趋势。因此,折线图在数据可视化中应用广泛,尤其适用于需要展示时间序列数据的场景。

相关代码示例:

# 数据预处理:确保数据类型正确、处理缺失值等

data['date'] = pd.to_datetime(data['date']) # 将日期转换为datetime类型

data = data.sort_values('date') # 按日期排序

data = data.dropna() # 删除含有缺失值的行

# 绘制每日新增病例图

plt.figure(figsize=(10, 5))

plt.plot(data['date'], data['new_cases'], marker='o', label='New Cases')

plt.title('Daily New Cases')

plt.xlabel('Date')

plt.ylabel('Number of Cases')

plt.legend()

plt.show()

# 绘制治愈率和死亡率图(使用条形图)

plt.figure(figsize=(10, 5))

plt.bar(data['date'], data['cured'], label='Cured')

plt.bar(data['date'], data['died'], bottom=data['cured'], label='Died')

plt.title('Recovery and Death Rate')

plt.xlabel('Date')

plt.ylabel('Number of Cases')

plt.legend()

plt.show()创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

本文介绍了一个针对疫情数据的毕设项目,涉及大数据爬取、Scrapy框架的应用、KMeans聚类算法、数据清洗和PyEcharts数据可视化。作者分享了如何使用这些技术构建一个系统,以实时分析和展示疫情动态,为决策者提供参考。

本文介绍了一个针对疫情数据的毕设项目,涉及大数据爬取、Scrapy框架的应用、KMeans聚类算法、数据清洗和PyEcharts数据可视化。作者分享了如何使用这些技术构建一个系统,以实时分析和展示疫情动态,为决策者提供参考。

4010

4010

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?