目录

🍉引言

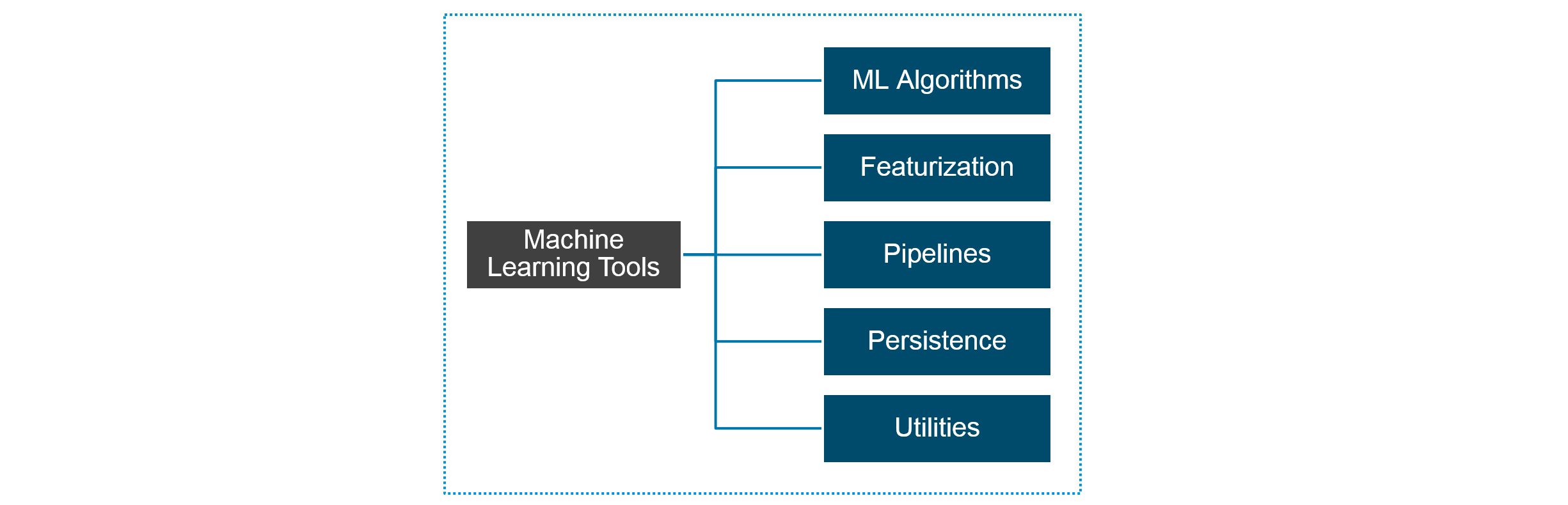

- Apache Spark 是一个开源的分布式计算框架,它提供了高效的处理大规模数据集的能力。Spark MLlib 是 Spark 的机器学习库,旨在提供可扩展的、易于使用的机器学习算法。MLlib 提供了一系列工具,用于分类、回归、聚类、协同过滤、降维等任务。

- 本文将详细介绍 Spark MLlib 的功能及其应用,结合实例讲解如何在实际数据处理中使用这些功能。

🍉Spark MLlib 简介

🍈 主要特点

- 易于使用:提供了丰富的 API,支持 Scala、Java、Python 和 R 等多种编程语言。

- 高度可扩展:可以处理海量数据,适用于大规模机器学习任务。

- 丰富的算法库:支持分类、回归、聚类、降维、协同过滤等常用算法。

🍈常见应用场景

- 分类:如垃圾邮件检测、图像识别、情感分析等。

- 回归:如房价预测、股票价格预测等。

- 聚类:如客户分群、图像分割等。

- 协同过滤:如推荐系统等。

- 降维:如特征选择、特征提取等。

🍉安装与配置

在使用 Spark MLlib 之前,需要确保已经安装了 Apache Spark。可以通过以下命令安装Spark:

# 安装 Spark

!apt-get install -y spark

# 安装 PySpark

!pip install pyspark

🍉数据处理与准备

机器学习的第一步通常是数据的获取与预处理。以下示例演示如何加载数据并进行预处理。

🍈加载数据

我们使用一个简单的示例数据集:波士顿房价数据集。该数据集包含506个样本,每个样本有13个特征和1个目标变量(房价)。

from pyspark.sql import SparkSession

# 创建 SparkSession

spark = SparkSession.builder.appName("MLlibExample").getOrCreate()

# 加载数据集

data_path = "path/to/boston_housing.csv"

data = spark.read.csv(data_path, header=True, inferSchema=True)

data.show(5)

🍈数据预处理

预处理步骤包括数据清洗、特征选择、数据标准化等。

from pyspark.sql.functions import col

from pyspark.ml.feature import VectorAssembler, StandardScaler

# 选择特征和目标变量

feature_columns = data.columns[:-1]

target_column = data.columns[-1]

# 将特征列组合成一个向量

assembler = VectorAssembler(inputCols=feature_columns, outputCol="features")

data = assembler.transform(data)

# 标准化特征

scaler = StandardScaler(inputCol="features", outputCol="scaledFeatures")

scaler_model = scaler.fit(data)

data = scaler_model.transform(data)

# 选择最终的数据集

data = data.select(co

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3083

3083

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?