先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

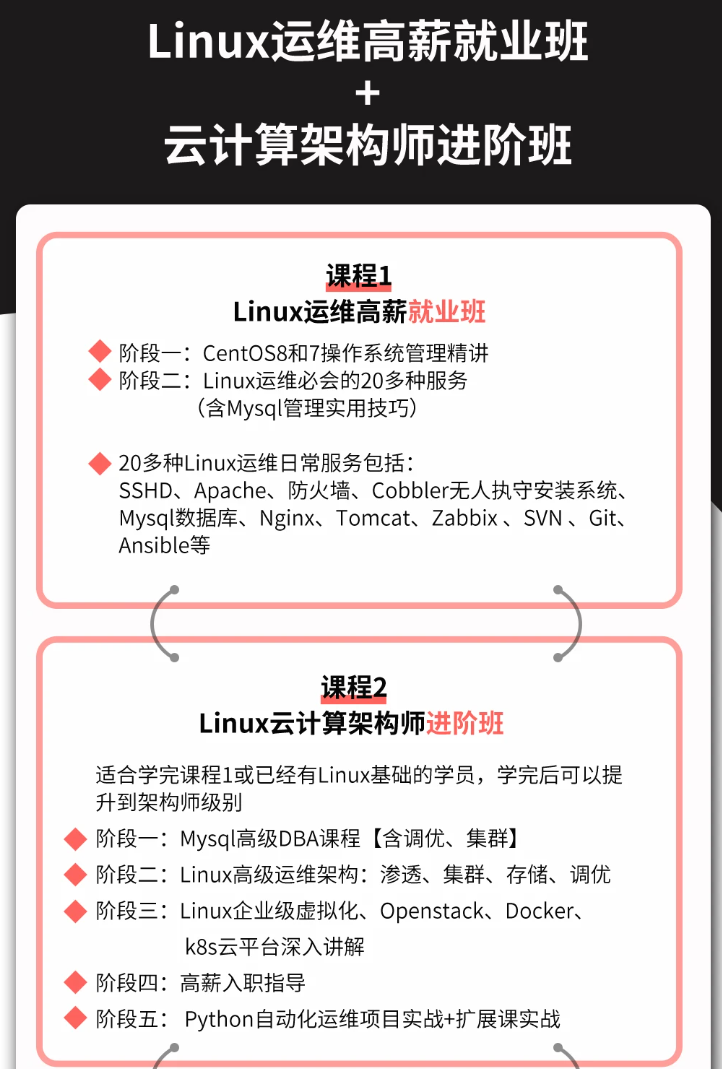

因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!

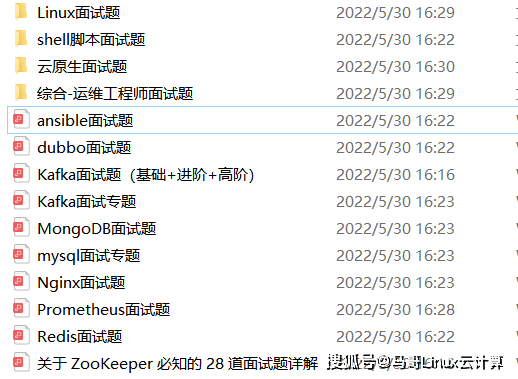

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注运维)

正文

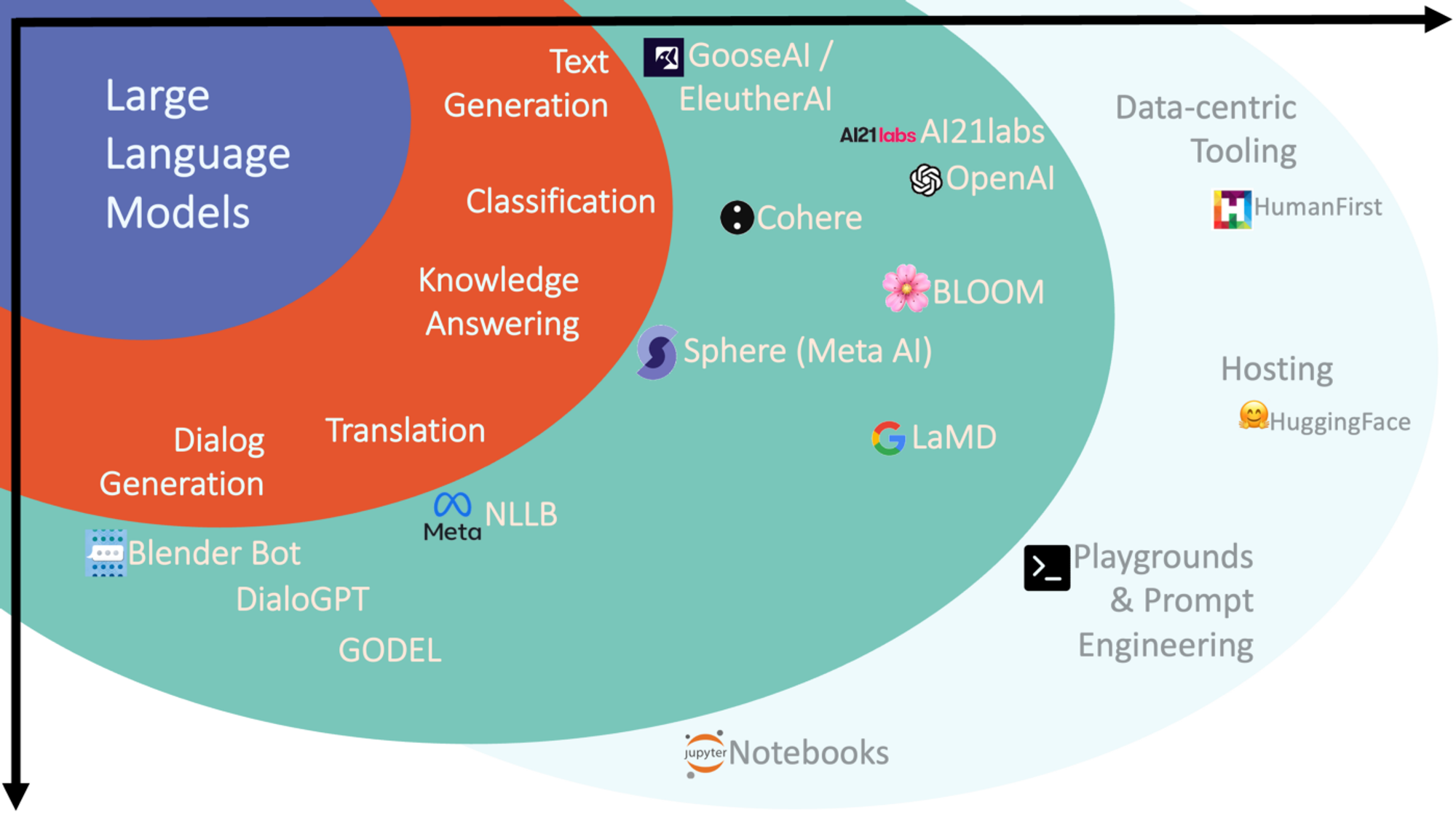

什么是大型语言模型?

语言模型是一种统计模型,用于预测单词序列的概率。它是一种人工神经网络,经过大量文本数据的训练,可以理解语言并预测序列中的下一个单词。大型语言模型是具有大量参数的神经网络,允许它们学习语言中的复杂模式。

大型语言模型,也称为预训练模型,是一种使用大量数据来学习语言特征的人工智能。这些模型用于生成基于语言的数据集,并可用于各种任务,例如语言理解和生成。

大型语言模型的关键特征之一是它们能够生成类似人类的文本。这些模型可以生成连贯、语法正确,有时甚至幽默的文本。他们还可以将文本从一种语言翻译成另一种语言,并根据给定的上下文回答问题。

大型语言模型如何工作?

大型语言模型使用一种称为无监督学习的技术来工作。在无监督学习中,模型是在没有任何特定标签或目标的情况下在大量数据上训练的。目标是学习数据的底层结构,并使用它来生成结构与原始数据相似的新数据。

对于大型语言模型,用于训练的数据通常是大型文本语料库。该模型学习文本数据中的模式,并使用它们来生成新文本。训练过程包括优化模型参数,以最小化语料库中生成的文本与实际文本之间的差异。

训练模型后,可以使用它来生成新文本。为此,模型被赋予一个单词的起始序列,并根据训练语料库中单词的概率生成序列中的下一个单词。重复此过程,直到生成所需的文本长度。

为了了解大型语言模型的工作原理,了解可用的不同类型的语言模型非常重要。最常见的语言模型类型是递归神经网络 (RNN)、卷积神经网络 (CNN) 和长短期记忆 (LSTM) 网络。这些模型通常用于在大型数据集(如宾夕法尼亚树库)上进行训练,并可用于生成基于语言的数据集。

训练语言模型后,它可用于在各种任务中生成文本,例如文本理解、文本生成、问答等。通过了解语言的一般特征,这些模型能够生成基于语言的数据集,这些数据集可用于为各种 NLP 应用程序提供支持。

💡 一点历史 -

预训练大型语言模型的概念最早出现在 2018 年,当时引入了 “语言建模” 的概念。语言建模是一种人工智能,它使用大量文本数据来理解语言的一般特征。通过对大量语言数据进行训练,这些模型能够学习语言的许多一般特征,例如语法、句法和语义。这使得它们可用于文本理解、文本生成、问答等任务。

自推出以来,大型语言模型已被用于各种任务,从文本理解和生成到问答和推荐系统。它们还被用于支持各种自然语言处理 (NLP) 应用程序,例如机器翻译和语音识别。

除了用于文本理解和生成外,大型语言模型还可用于支持各种其他应用程序。例如,一些使用大型语言模型的最流行的应用程序是聊天机器人、虚拟助手和推荐系统。通过了解语言的一般特征,这些模型能够生成基于语言的数据集,这些数据集可用于为各种 NLP 应用程序提供支持。

这些模型使我们能够生成基于语言的数据集,这些数据集可用于为各种不同的应用程序提供支持,从文本理解和生成到问答和推荐系统。

大型语言模型的常见示例

大型语言模型的一些常见示例包括:

GPT-3 型

GPT-3(Generative Pre-trained Transformer 3)是由 OpenAI 开发的大型语言模型。它有 1750 亿个参数,使其成为现存最大的语言模型之一。GPT-3 能够生成类似人类的文本、翻译文本、回答问题等等。

伯特

BERT(Bidirectional Encoder Representations from Transformers)是谷歌开发的一种大型语言模型。它有 3.4 亿个参数,并在大量文本语料库上进行训练。BERT 能够理解句子的上下文并生成连贯且语法正确的文本。

T5 型

T5(Text-to-Text Transfer Transformer)是谷歌开发的大型语言模型。它有 110 亿个参数,经过训练可以执行各种自然语言处理任务,包括文本分类、文本生成和翻译。

大型语言模型的进步

大型语言模型的开发是一个持续的研究和开发过程。该领域的一项重大进步是 transformer 架构,它彻底改变了大型语言模型的设计和训练方式。

Vaswani 等人于 2017 年在论文 “Attention Is All You Need” 中首次介绍了 transformer 架构,它是一种使用自注意力机制来处理输入序列的神经网络架构。这种架构显著提高了大型语言模型的性能,并使训练具有数十亿个参数的模型成为可能。

大型语言模型的应用

近年来,由于大型数据集的可用性和人工智能 (AI) 技术的进步,大型语言模型的使用显着增加。随着人工智能技术的不断改进,大型语言模型的准确性和功能也将不断提高。这将使它们对各种自然语言处理任务更加有用。

除了上述应用外,大型语言模型还可用于其他任务,例如文本摘要和情感分析。通过了解语言的一般特征,这些模型可用于生成文本摘要或分析文本的情感。

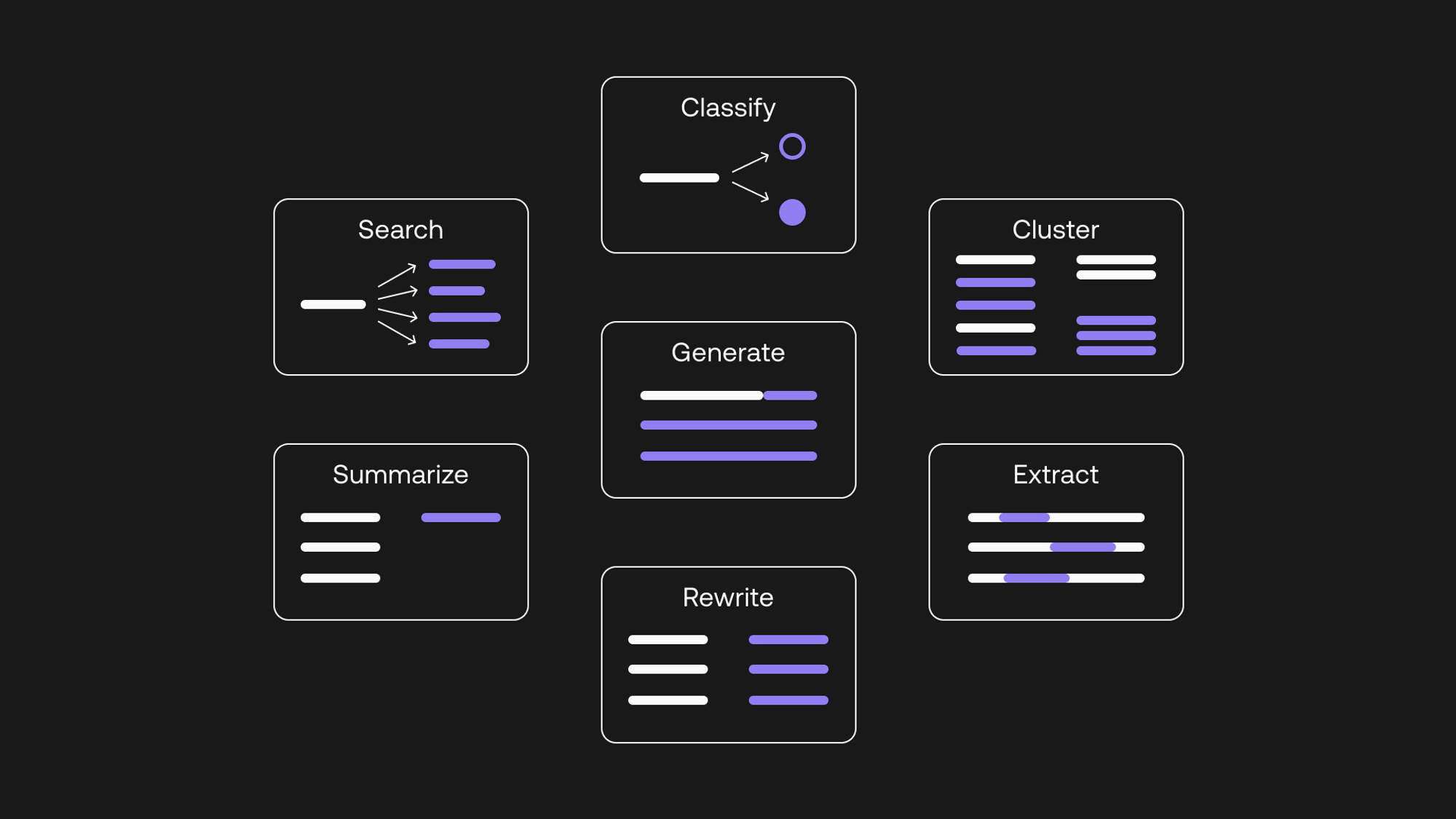

大型语言模型的各种用例

大型语言模型在自然语言处理、人工智能和数据科学等各个领域都有广泛的应用。一些应用包括:

- **语言翻译:**大型语言模型可用于将文本从一种语言翻译成另一种语言。例如,谷歌翻译使用大型语言模型来翻译文本。

- **问答:**大型语言模型可用于根据给定上下文回答问题。例如,语言模型 BERT 已用于问答任务。

- **文本摘要:**大型语言模型可用于生成文本文档的摘要。

- **内容创作:**大型语言模型可用于生成用于各种目的的内容,例如营销和广告。

为了做好运维面试路上的助攻手,特整理了上百道 【运维技术栈面试题集锦】 ,让你面试不慌心不跳,高薪offer怀里抱!

这次整理的面试题,小到shell、MySQL,大到K8s等云原生技术栈,不仅适合运维新人入行面试需要,还适用于想提升进阶跳槽加薪的运维朋友。

本份面试集锦涵盖了

- 174 道运维工程师面试题

- 128道k8s面试题

- 108道shell脚本面试题

- 200道Linux面试题

- 51道docker面试题

- 35道Jenkis面试题

- 78道MongoDB面试题

- 17道ansible面试题

- 60道dubbo面试题

- 53道kafka面试

- 18道mysql面试题

- 40道nginx面试题

- 77道redis面试题

- 28道zookeeper

总计 1000+ 道面试题, 内容 又全含金量又高

- 174道运维工程师面试题

1、什么是运维?

2、在工作中,运维人员经常需要跟运营人员打交道,请问运营人员是做什么工作的?

3、现在给你三百台服务器,你怎么对他们进行管理?

4、简述raid0 raid1raid5二种工作模式的工作原理及特点

5、LVS、Nginx、HAproxy有什么区别?工作中你怎么选择?

6、Squid、Varinsh和Nginx有什么区别,工作中你怎么选择?

7、Tomcat和Resin有什么区别,工作中你怎么选择?

8、什么是中间件?什么是jdk?

9、讲述一下Tomcat8005、8009、8080三个端口的含义?

10、什么叫CDN?

11、什么叫网站灰度发布?

12、简述DNS进行域名解析的过程?

13、RabbitMQ是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

17、如何重置mysql root密码?

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注运维)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

**

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注运维)

[外链图片转存中…(img-p8SA5Lbv-1713233026097)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

867

867

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?