为了做好运维面试路上的助攻手,特整理了上百道 【运维技术栈面试题集锦】 ,让你面试不慌心不跳,高薪offer怀里抱!

这次整理的面试题,小到shell、MySQL,大到K8s等云原生技术栈,不仅适合运维新人入行面试需要,还适用于想提升进阶跳槽加薪的运维朋友。

本份面试集锦涵盖了

- 174 道运维工程师面试题

- 128道k8s面试题

- 108道shell脚本面试题

- 200道Linux面试题

- 51道docker面试题

- 35道Jenkis面试题

- 78道MongoDB面试题

- 17道ansible面试题

- 60道dubbo面试题

- 53道kafka面试

- 18道mysql面试题

- 40道nginx面试题

- 77道redis面试题

- 28道zookeeper

总计 1000+ 道面试题, 内容 又全含金量又高

- 174道运维工程师面试题

1、什么是运维?

2、在工作中,运维人员经常需要跟运营人员打交道,请问运营人员是做什么工作的?

3、现在给你三百台服务器,你怎么对他们进行管理?

4、简述raid0 raid1raid5二种工作模式的工作原理及特点

5、LVS、Nginx、HAproxy有什么区别?工作中你怎么选择?

6、Squid、Varinsh和Nginx有什么区别,工作中你怎么选择?

7、Tomcat和Resin有什么区别,工作中你怎么选择?

8、什么是中间件?什么是jdk?

9、讲述一下Tomcat8005、8009、8080三个端口的含义?

10、什么叫CDN?

11、什么叫网站灰度发布?

12、简述DNS进行域名解析的过程?

13、RabbitMQ是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

17、如何重置mysql root密码?

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

解析代码:

看了一下两个版本的代码,如上面链接所示,

**简单版,**代码和之前解析的源码类型是一致的,更容易理解些,但是只有预测部分而没有训练部分。虽然能很容易理解,但里面没有标签处理,损失计算等部分。即使看懂了,也有种啥都没学到的感觉。

复杂版,当时看到这个源代码是有点懵的,为啥呢?因为看不懂啊,之前没见过用这种方式写的代码,套路不太一样。反反复复犹犹豫豫了好几次,想着要不要花点精力看复杂版的,也尝试在github上搜了一下看看有没有更合适的版本,结果是并没有,所以就硬着头皮解析这个比较复杂的代码了。前期是先跳过了看不懂的部分,直接去看网络构建部分,anchor生成部分,计算损失部分,数据预处理部分,但是整体运行逻辑还是有点懵。后来看了一点有关TensorFlow的Estimator讲解,稍微有点眉目,但是还不是很了解,有点不知所以然。主要是Estimator的方式不太习惯,如果只把他当作一种框架,你按它固定的格式传入相应的参数就行,还可以接受些。具体的网络搭建,anchor创建,损失计算等和之前还是一样的。

SSD损失函数

相比较YOLOv3,SSD的损失函数相对直观些,这次就不贴手写的了,因为要贴损失计算实现的代码,手写太费事了。

SSD损失函数定义为**位置误差(locatization loss, loc)与置信度误差(confidence loss, conf)**的加权和(实际代码中还会加上l2_loss以防止过拟合):

其中 是先验框的正样本数量。这里

是先验框的正样本数量。这里  为一个指示参数,当**

为一个指示参数,当** 时表示第i 个先验框与第j 个ground truth匹配**,并且ground truth的类别为 p 。 c 为类别置信度预测值。

时表示第i 个先验框与第j 个ground truth匹配**,并且ground truth的类别为 p 。 c 为类别置信度预测值。  为先验框的所对应边界框的位置预测值,而 g 是ground truth的位置参数。

为先验框的所对应边界框的位置预测值,而 g 是ground truth的位置参数。

下面盗一张图再来说明一下:

1,对于位置误差

其采用Smooth L1 loss,定义如下:

由于 的存在,所以位置误差仅针对正样本进行计算。值得注意的是,要先对ground truth的g 进行编码得到

的存在,所以位置误差仅针对正样本进行计算。值得注意的是,要先对ground truth的g 进行编码得到  (偏移量),因为预测值

(偏移量),因为预测值  也是编码值,若设置variance_encoded_in_target=True,编码时要加上variance=[0.1, 0.1, 0.2, 0.2]:

也是编码值,若设置variance_encoded_in_target=True,编码时要加上variance=[0.1, 0.1, 0.2, 0.2]:

上面公式在实际代码中的操作如下(encode_all_anchors()函数中):

gt_cy = (gt_cy - anchor_cy) / anchor_h / self._prior_scaling[0] # [0.1, 0.1, 0.2, 0.2]

gt_cx = (gt_cx - anchor_cx) / anchor_w / self._prior_scaling[1]

gt_h = tf.log(gt_h / anchor_h) / self._prior_scaling[2]

gt_w = tf.log(gt_w / anchor_w) / self._prior_scaling[3]

smooth_l1的公式如下,实际计算中x=g-l,g为ground_truth,l为预测值。

其中smooth_l1的代码实现如下:

'''

smooth_l1损失

'''

def modified_smooth_l1(bbox_pred, bbox_targets, bbox_inside_weights=1., bbox_outside_weights=1., sigma=1.):

"""

ResultLoss = outside_weights * SmoothL1(inside_weights * (bbox_pred - bbox_targets))

SmoothL1(x) = 0.5 * (sigma * x)^2, if |x| < 1 / sigma^2

|x| - 0.5 / sigma^2, otherwise

"""

with tf.name_scope('smooth_l1', values=[bbox_pred, bbox_targets]):

sigma2 = sigma * sigma

inside_mul = tf.multiply(bbox_inside_weights, tf.subtract(bbox_pred, bbox_targets))

smooth_l1_sign = tf.cast(tf.less(tf.abs(inside_mul), 1.0 / sigma2), tf.float32)

smooth_l1_option1 = tf.multiply(tf.multiply(inside_mul, inside_mul), 0.5 * sigma2) # 0.5x^2

smooth_l1_option2 = tf.subtract(tf.abs(inside_mul), 0.5 / sigma2) # |x|-0.5

smooth_l1_result = tf.add(tf.multiply(smooth_l1_option1, smooth_l1_sign),

tf.multiply(smooth_l1_option2, tf.abs(tf.subtract(smooth_l1_sign, 1.0))))

outside_mul = tf.multiply(bbox_outside_weights, smooth_l1_result)

return outside_mul

实际程序中计算smooth_l1损失的代码如下(其中location_pred是预测边框的编码值,flaten_loc_targets是标记边框的编码值):

#*******预测框回归smooth_l1损失

loc_loss = modified_smooth_l1(location_pred, flaten_loc_targets, sigma=1.) # 这时是框坐标的偏移量

loc_loss = tf.reduce_mean(tf.reduce_sum(loc_loss, axis=-1), name='location_loss')

tf.summary.scalar('location_loss', loc_loss)

tf.losses.add_loss(loc_loss)

2,对于置信度误差

其采用softmax loss:

权重系数  通过交叉验证设置为1。

通过交叉验证设置为1。

实际程序中对应的代码如下(其中flaten_cls_targets是类别标记值,cls_pred是预测类别值):

# 分类的交叉熵损失,并乘以权重系数3+1

cross_entropy = tf.losses.sparse_softmax_cross_entropy(labels=flaten_cls_targets, logits=cls_pred) * (params['negative_ratio'] + 1.)

# 创建一个名为cross_entropy_loss的张量用于记录。

tf.identity(cross_entropy, name='cross_entropy_loss')

tf.summary.scalar('cross_entropy_loss', cross_entropy)

3,l2_loss

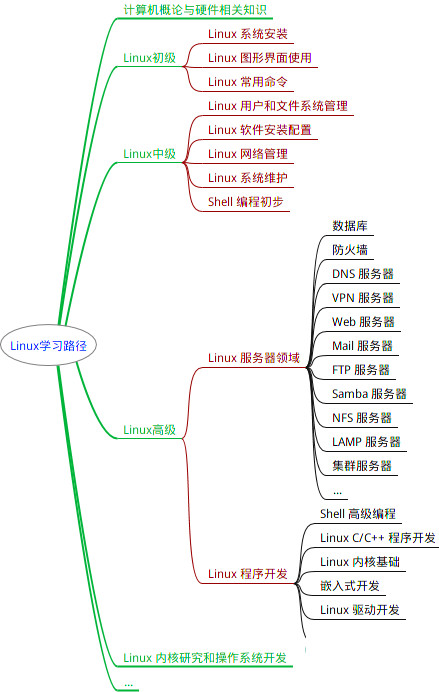

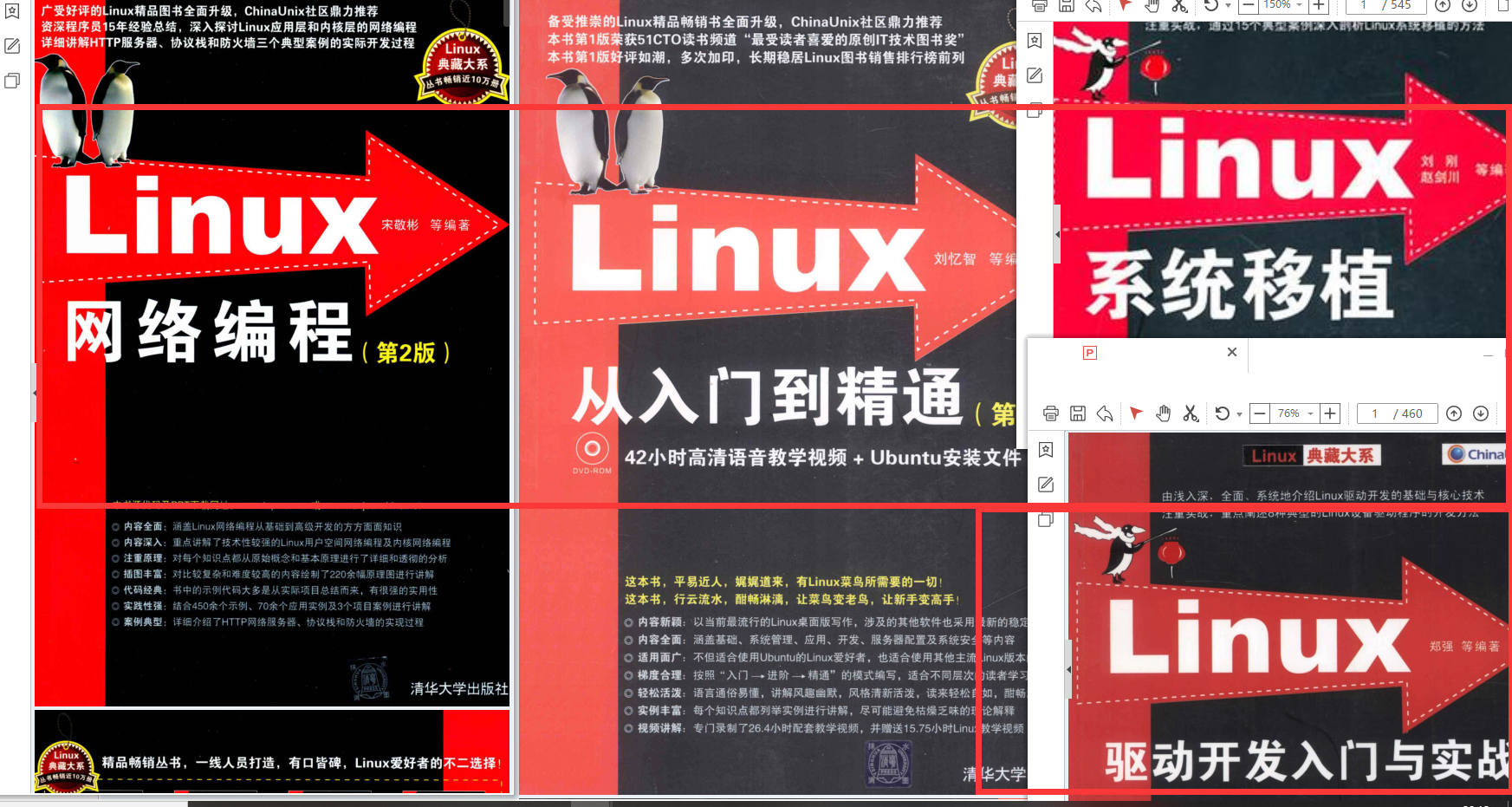

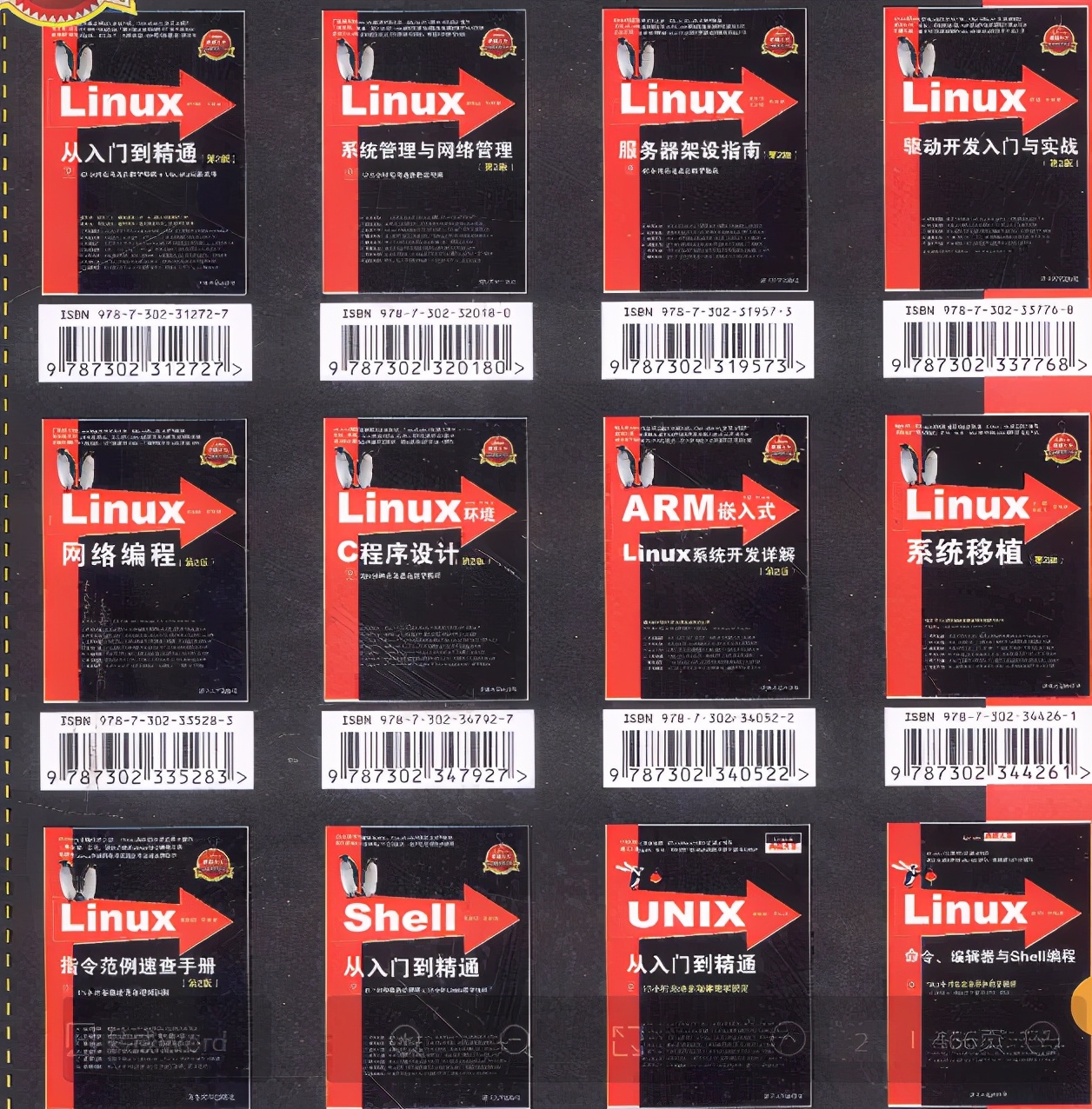

最全的Linux教程,Linux从入门到精通

======================

-

linux从入门到精通(第2版)

-

Linux系统移植

-

Linux驱动开发入门与实战

-

LINUX 系统移植 第2版

-

Linux开源网络全栈详解 从DPDK到OpenFlow

第一份《Linux从入门到精通》466页

====================

内容简介

====

本书是获得了很多读者好评的Linux经典畅销书**《Linux从入门到精通》的第2版**。本书第1版出版后曾经多次印刷,并被51CTO读书频道评为“最受读者喜爱的原创IT技术图书奖”。本书第﹖版以最新的Ubuntu 12.04为版本,循序渐进地向读者介绍了Linux 的基础应用、系统管理、网络应用、娱乐和办公、程序开发、服务器配置、系统安全等。本书附带1张光盘,内容为本书配套多媒体教学视频。另外,本书还为读者提供了大量的Linux学习资料和Ubuntu安装镜像文件,供读者免费下载。

本书适合广大Linux初中级用户、开源软件爱好者和大专院校的学生阅读,同时也非常适合准备从事Linux平台开发的各类人员。

需要《Linux入门到精通》、《linux系统移植》、《Linux驱动开发入门实战》、《Linux开源网络全栈》电子书籍及教程的工程师朋友们劳烦您转发+评论

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

561

561

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?