先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

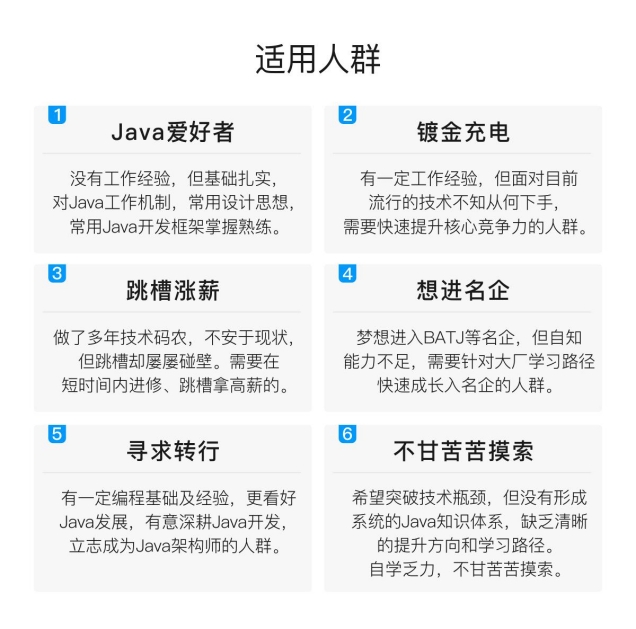

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Java开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

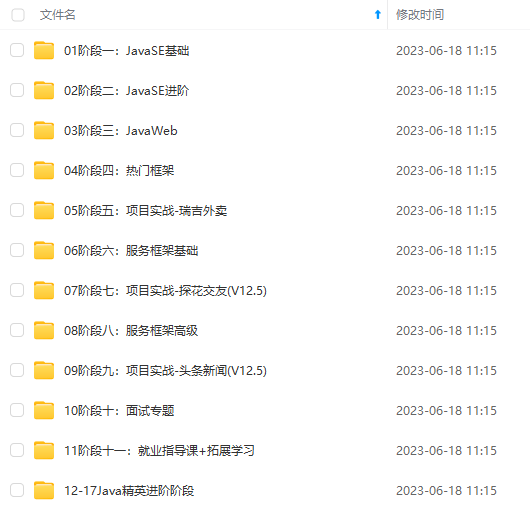

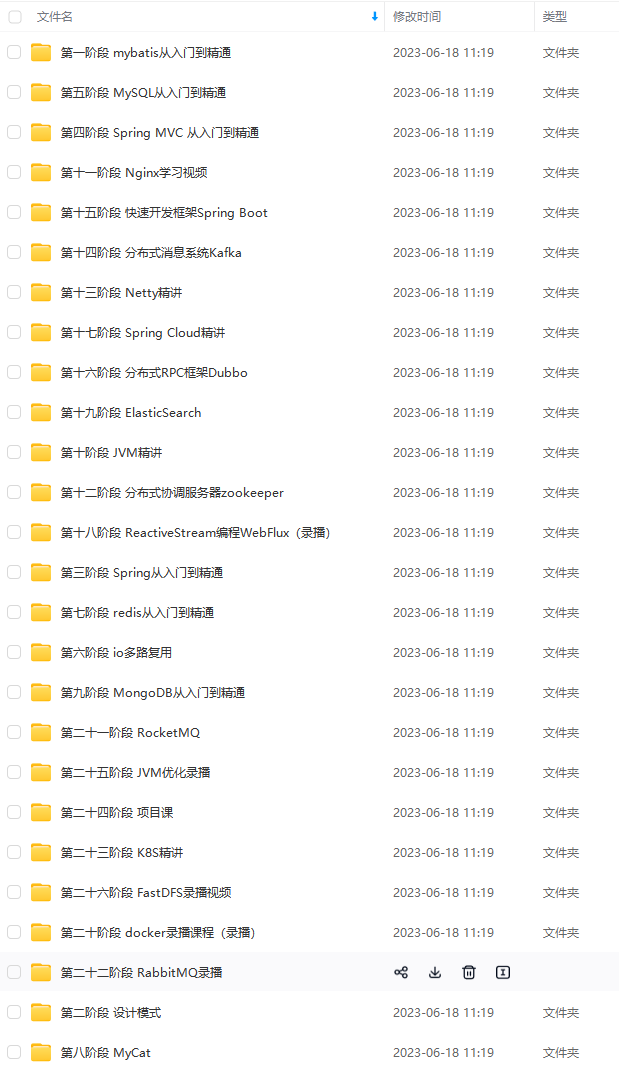

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Java开发知识点,真正体系化!

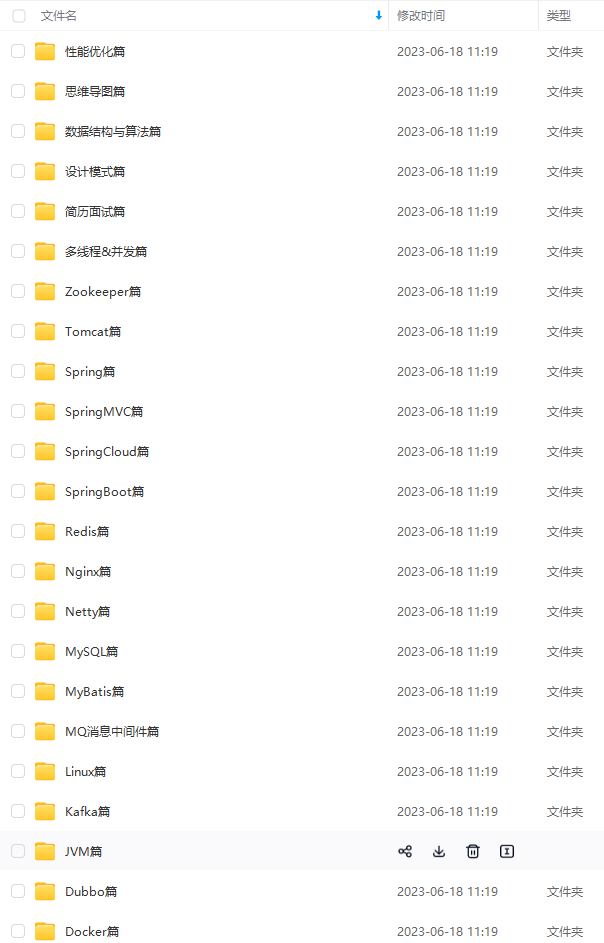

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注Java)

正文

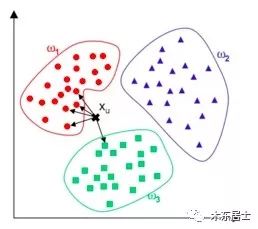

贴出一张从百度百科上找的一张图,我们可以直观地感受到这朴素的思想:我们要判断Xu 是什么颜色的,找到与其距离最近的5个点,有4个是红色的,有1个是绿色的。因此我们认为Xu是属于红色的集合

因此我们说:

在一个给定的类别已知的训练样本集中,已知样本集中每一个数据与所属分类的对应关系(标签)。在输入不含有标签的新样本后,将新的数据的每个特征与样本集中数据对应的特征进行比较,然后算法提取样本最相似的k个数据(最近邻)的分类标签。通过多数表决等方式进行预测。即选择k个最相似数据中出现次数最多的分类,作为新数据的分类。

K近邻法不具有显式的学习过程,而是利用训练数据集对特征向量空间进行划分,并作为其分类的“模型”。

kNN算法流程

通过理解算法思想,可以将其简化为“找邻居+投票”。K近邻法使用的模型,实际上是特征空间的划分。模型由三个基本要素决定:

-

距离度量

-

k值

-

分类决策规则

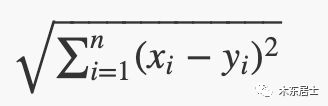

其中两个实例点之间的距离反映了相似程度。一般来说使用欧氏距离来计算。

梳理kNN算法流程如下:

-

计算测试对象到训练集中每个对象的距离

-

按照距离的远近排序

-

选取与当前测试对象最近的k的训练对象,作为该测试对象的邻居

-

统计这k个邻居的类别频率

-

k个邻居里频率最高的类别,即为测试对象的类别

0x02 算法实现

kNN算法自实现

打开Jupyter Notebook,创建Python3文件。

准备数据

首先我们准备一组数据:

import numpy as npimport matplotlib.pyplot as plt# raw_data_x是特征,raw_data_y是标签,0为良性,1为恶性raw_data_X = [[3.393533211, 2.331273381],

[3.110073483, 1.781539638],

[1.343853454, 3.368312451],

[3.582294121, 4.679917921],

[2.280362211, 2.866990212],

[7.423436752, 4.685324231],

[5.745231231, 3.532131321],

[9.172112222, 2.511113104],

[7.927841231, 3.421455345],

[7.939831414, 0.791631213]

]

raw_data_y = [0, 0, 0, 0, 0, 1, 1, 1, 1, 1]# 设置训练组X_train = np.array(raw_data_X)

y_train = np.array(raw_data_y)# 将数据可视化plt.scatter(X_train[y_train0,0],X_train[y_train0,1], color=‘g’, label = ‘Tumor Size’)

plt.scatter(X_train[y_train1,0],X_train[y_train1,1], color=‘r’, label = ‘Time’)

plt.xlabel(‘Tumor Size’)

plt.ylabel(‘Time’)

plt.axis([0,10,0,5])

plt.show()

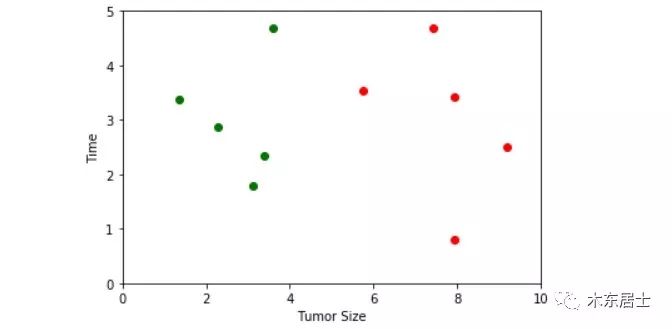

数据可视化后生成的图片如下图所示。其中横轴是肿块大小,纵轴是发现时间。每个病人的肿块大小和发病时间构成了二维平面特征中的一个点。对于每个点,我们通过label明确是恶性肿瘤(绿色)、良性肿瘤(红色)。

那么现在给出一个肿瘤患者的数据(样本点)x:[8.90933607318, 3.365731514],是良性肿瘤还是恶性肿瘤

求距离

我们要做的是:求点x到数据集中每个点的距离,首先计算距离,使用欧氏距离

下面写代码:

from math import sqrt

distances = [] # 用来记录x到样本数据集中每个点的距离for x_train in X_train:

d = sqrt(np.sum((x_train - x) ** 2))

distances.append(d)# 使用列表生成器,一行就能搞定,对于X_train中的每一个元素x_train都进行前面的运算,把结果生成一个列表distances = [sqrt(np.sum((x_train - x) ** 2)) for x_train in X_train]

distances

输出:[5.611968000921151, 6.011747706769277, 7.565483059418645, 5.486753308891268, 6.647709180746875, 1.9872648870854204, 3.168477291709152, 0.8941051007010301, 0.9830754144862234, 2.7506238644678445]

在求出距离列表之后,我们要找到最小的距离,需要进行一次排序操作。其实不是简单的排序,因为我们把只将距离排大小是没有意义的,我们要知道距离最小的k个点是在样本集中的位置。

这里我们使用函数:np.argsort(array) 对一个数组进行排序,返回的是相应的排序后结果的索引

nearest = np.argsort(distances)

nearest

输出:array([7, 8, 5, 9, 6, 3, 0, 1, 4, 2])

结果的含义是:距离最小的点在distances数组中的索引是7,第二小的点索引是8… 近到远是哪些点

选k值

然后我们选择k值,这里暂定为6,那就找出最近的6个点(top 6),并记录他们的标签值(y)

k = 6topK_y = [y_train[i] for i in nearest[:k]]

topK_y

输出:[1, 1, 1, 1, 1, 0]

决策规则

下面进入投票环节。找到与测试样本点最近的6个训练样本点的标签y是什么。可以查不同类别的点有多少个。

将数组中的元素和元素出现的频次进行统计

from collections import Counter

votes = Counter(topK_y)

votes

输出:一个字典,原数组中值为0的个数为1,值为1的个数有为5Counter({0:1, 1:5})

Counter.most_common(n) 找出票数最多的n个元素,返回的是一个列表,列表中的每个元素是一个元组,元组中第一个元素是对应的元素是谁,第二个元素是频次votes.most_common(1)

输出:[(1,5)]

predict_y = votes.most_common(1)[0][0]

predict_y

输出:1

得到预测的y值是1

自实现完整工程代码

我们已经在jupyter notebook中写好了kNN算法,下面我们在外部进行封装。

相关代码可以在 https://github.com/japsonzbz/ML_Algorithms 中看到

import numpy as npimport math as sqrtfrom collections import Counterclass kNNClassifier:

def init(self, k):

“”“初始化分类器”“”

assert k >= 1, “k must be valid”

self.k = k

self._X_train = None

self._y_train = None

def fit(self, X_train, y_train):

“”“根据训练数据集X_train和y_train训练kNN分类器”“”

assert X_train.shape[0] == y_train.shape[0], \ “the size of X_train must be equal to the size of y_train”

assert self.k <= X_train.shape[0], \ “the size of X_train must be at least k”

self._X_train = X_train

self._y_train = y_train return self def predict(self,X_predict):

“”“给定待预测数据集X_predict,返回表示X_predict结果的向量”“”

assert self._X_train is not None and self._y_train is not None, \ “must fit before predict!”

assert X_predict.shape[1] == self._X_train.shape[1], \ “the feature number of X_predict must be equal to X_train”

y_predict = [self._predict(x) for x in X_predict] return np.array(y_predict) def _predict(self, x):

distances = [sqrt(np.sum((x_train - x) ** 2)) for x_train in self._X_train]

nearest = np.argsort(distances)

topK_y = [self._y_train[i] for i in nearest]

votes = Counter(topK_y) return votes.most_common(1)[0][0] def repr(self):

return “kNN(k=%d)” % self.k

当我们写完定义好自己的kNN代码之后,可以在jupyter notebook中使用魔法命令进行调用:

%run myAlgorithm/kNN.py

knn_clf = kNNClassifier(k=6)

knn_clf.fit(X_train, y_train)

X_predict = x.reshape(1,-1)

y_predict = knn_clf.predict(X_predict)

y_predict

输出:array([1])

现在我们就完成了一个sklearn风格的kNN算法,但是实际上,sklearn封装的算法比我们实现的要复杂得多。

sklearn中的kNN

代码

对于机器学习来说,其流程是:训练数据集 -> 机器学习算法 -fit-> 模型 输入样例 -> 模型 -predict-> 输出结果

最后

由于篇幅原因,就不多做展示了

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注Java)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

中…(img-DrYu2jau-1713475152662)]

[外链图片转存中…(img-MYLcIOQv-1713475152663)]

[外链图片转存中…(img-LriVkca9-1713475152663)]

[外链图片转存中…(img-CZlEZXKG-1713475152664)]

由于篇幅原因,就不多做展示了

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024b (备注Java)

[外链图片转存中…(img-MbfCCSgp-1713475152665)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

666

666

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?