上周周末参加了校友会的年会,是在上海虹桥附近的一家很有特色的大酒店。

期间的茶歇,由于昨晚没睡好,就想着去拿一杯咖啡解解乏。

我一手拿着手机在看一份报告,一手想去服务员托盘上拿一杯奶咖,结果无意碰到了另一只手。

「不好意思」,我连忙跟人道歉。校友笑了笑,倒是关注起了我手机中的报告。我们寒暄了几句,他就问我要了报告仔细翻阅,越看越惊讶,连连追问我是怎么做到的。

他最近正在为写方案发愁,看了我用 AI 生成的这份报告后,直呼「太厉害了」,还赶紧向我讨教使用技巧。

这不禁让老王开始反思,是怎么做到让 AI 更「懂」我的? 好像也只是简单地输入一些关键词,它就能理解意图,输出文字内容,很多时候超出使用者的预期。

这一切的背后,都离不开提示工程。准确地说,是一套规则和方法,通过不同的提示词技巧,来激发AI模型的潜力。

接下来,老王将按自己实操过程中的理解,分重点给大家介绍 17种提示词规则方法,带你一起体验提示工程的魅力。

提示词规则

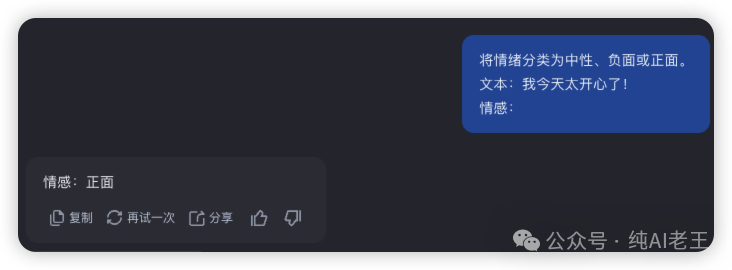

零样本提示

可在没有提供任何示例的情况下,直接指示模型完成任务的方法。核心思想是,凭借大模型在海量数据中学习到的通用知识和能力,直接理解任务要求并给出正确的答案。

案例

# prompt``将情绪分类为中性、负面或正面。``文本:我今天太开心了!``情感:

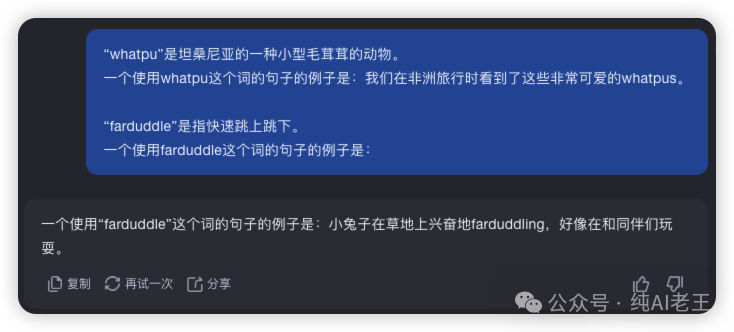

少样本提示

利用大型语言模型 (LLM) 的能力,通过在提示词中提供少量示例,来引导模型完成特定任务的方法。与零样本提示不同,少样本提示通过示例来帮助模型理解任务的模式和规则,进而更准确地生成符合要求的输出。

案例

# prompt``“whatpu”是坦桑尼亚的一种小型毛茸茸的动物。``一个使用whatpu这个词的句子的例子是:我们在非洲旅行时看到了这些非常可爱的whatpus。`` ``“farduddle”是指快速跳上跳下。``一个使用farduddle这个词的句子的例子是:

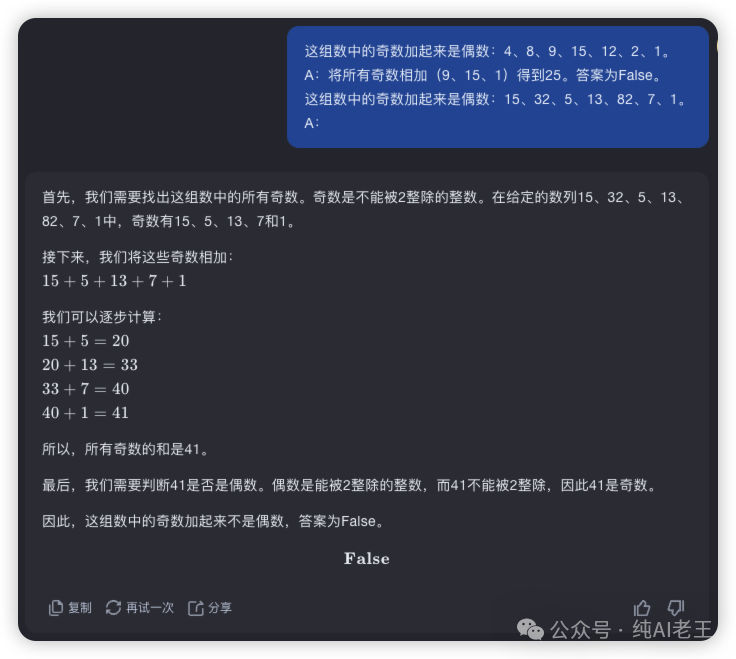

链式思考(COT)提示

通过在提示词中引导大型语言模型 (LLM) 逐步进行推理,来解决复杂问题。CoT 提示鼓励模型一步一步地思考,模拟人类的推理过程,从而提高多步推理和逻辑分析类任务的表现。

案例

# prompt``这组数中的奇数加起来是偶数:4、8、9、15、12、2、1。``A:将所有奇数相加(9、15、1)得到25。答案为False。``这组数中的奇数加起来是偶数:15、32、5、13、82、7、1。``A:

更夸张的是,只需要把**「让我们逐步思考」加入进去,就可以起效。这种称之为「零样本** COT 提示」。

# 反面案例``# prompt``我去市场买了10个苹果。我给了邻居2个苹果和修理工2个苹果。然后我去买了5个苹果并吃了1个。我还剩下多少苹果?``# output``1个苹果`` ``# 利用COT得到正确答案``# prompt``我去市场买了10个苹果。我给了邻居2个苹果和修理工2个苹果。然后我去买了5个苹果并吃了1个。我还剩下多少苹果?``让我们逐步思考。``# output``首先,您从10个苹果开始。``您给了邻居和修理工各2个苹果,所以您还剩下6个苹果。``然后您买了5个苹果,所以现在您有11个苹果。``最后,您吃了1个苹果,所以您还剩下10个苹果。

现在很多模型已经暗含了 COT 模式,分析非常细。

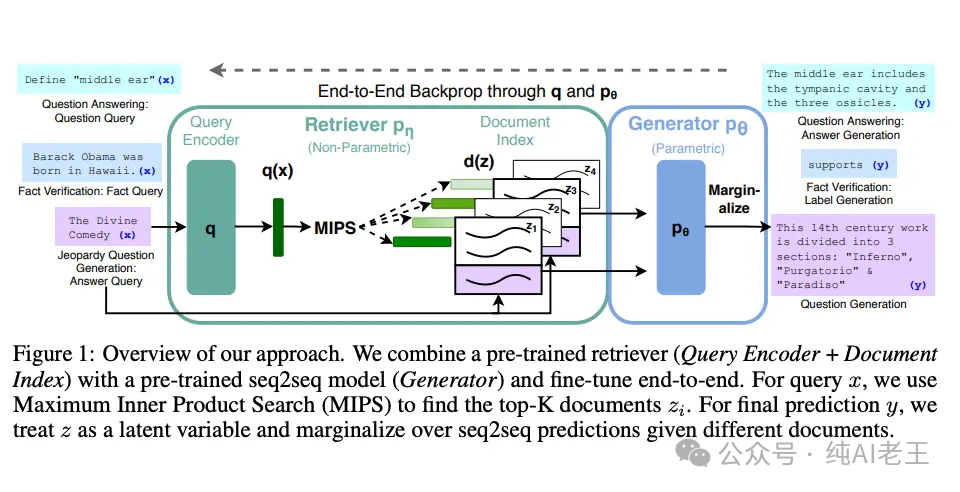

检索增强生成(RAG)

通过结合外部知识库的检索和大型语言模型 (LLM) 的生成能力,来提高LLM在知识密集型任务上的表现。

RAG 先从外部知识库中检索相关信息,然后利用检索到的信息进行生成,从而实现与事实更加一致,生成的答案更可靠,还有助于缓解「幻觉」问题。

案例

使用 LangChain 构建 RAG(检索增强生成)应用:https://python.langchain.com/docs/tutorials/rag/

主要包括以下步骤:

加载文档 (Loading documents): 从各种来源加载数据,例如文本文件,网页等。``分割文本 (Splitting text): 将文档分割成更小的文本块,以便于检索。``创建向量嵌入 (Creating embeddings): 将文本块转换为向量表示,以便于计算相似度。``存储向量 (Storing vectors): 将向量存储到向量数据库中,以便于快速检索。``检索相关文档 (Retrieving relevant documents): 使用用户的查询从向量数据库中检索相关的文本块。``利用LLM生成答案 (Generate answer with LLM): 将检索到的文本块和用户查询组合成提示,并使用 LLM 生成最终答案。

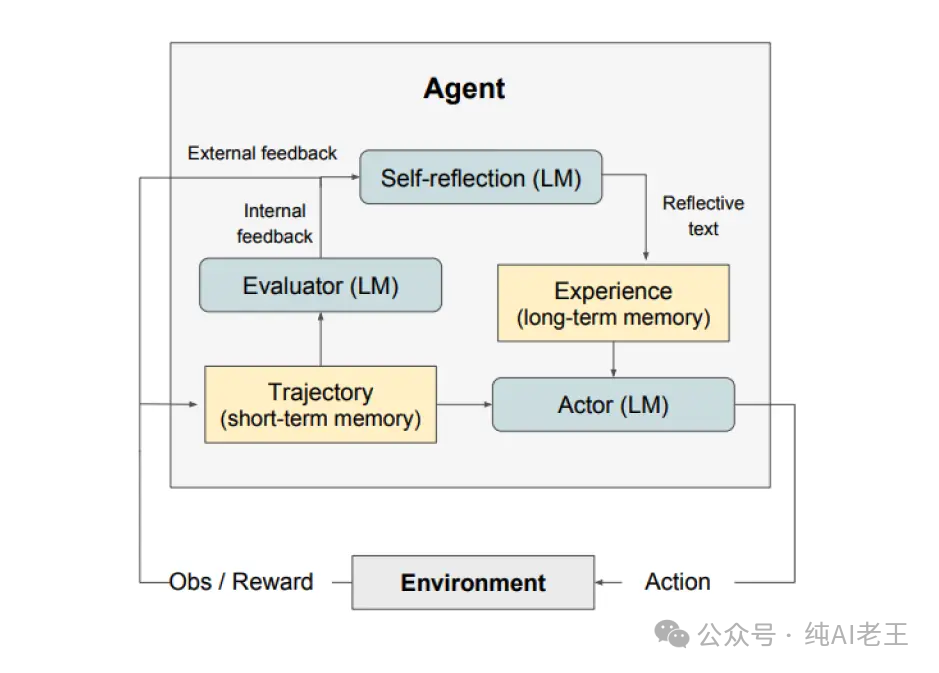

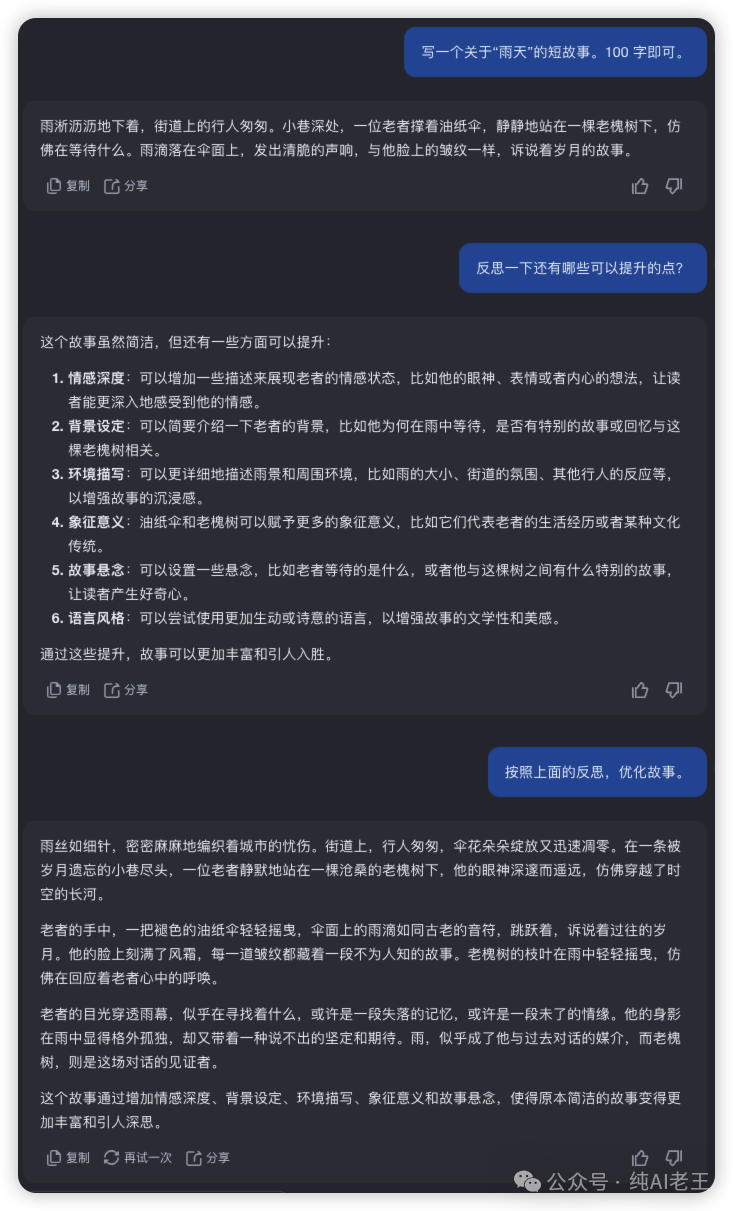

自我反思 Reflexion

通过让大型语言模型 (LLM) 对其自身的输出进行反思和迭代,来提高LLM在复杂任务上的表现。反思提示鼓励模型先生成一个初步答案,然后对该答案进行评估和反思,再反思结果进行改进,迭代生成最终的答案。

案例

除了上述 5 个规则,还有 12 个重要的规则如下:

-

自我一致性

-

生成知识提示

-

prompt chaining

-

思维树(TOT)

-

自动推理并使用工具(ART)

-

自动提示工程师

-

主动提示

-

方向性刺激提示

-

PAL程序辅助语言模型

-

ReAct框架

-

多模态思维链提示

-

基于图的提示

上述老王实战中使用频率不高,所以篇幅限制就不在此展示了。有想学习的伙伴可以关注本号,后台回复括号内关键词【17个提示词方法】免费获取2w字。

总结

AI 目前还是非常考验使用者的。

如果掌握了更多的底层方法论,就能更好的融入日常工作。

觉得有帮助的话,帮我点个赞、在看、转发三连吧~

- THE END -

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?