给大家的福利

零基础入门

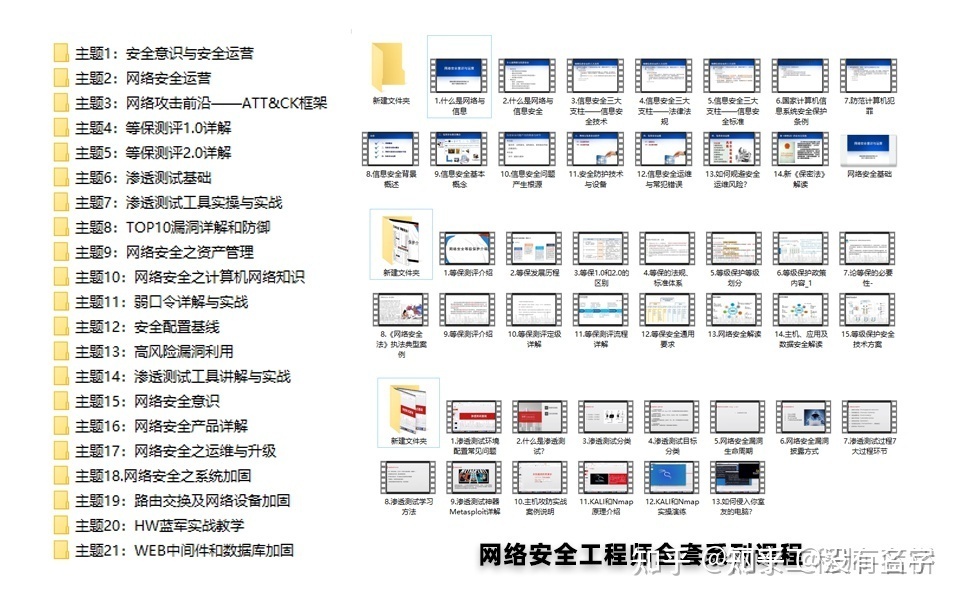

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

同时每个成长路线对应的板块都有配套的视频提供:

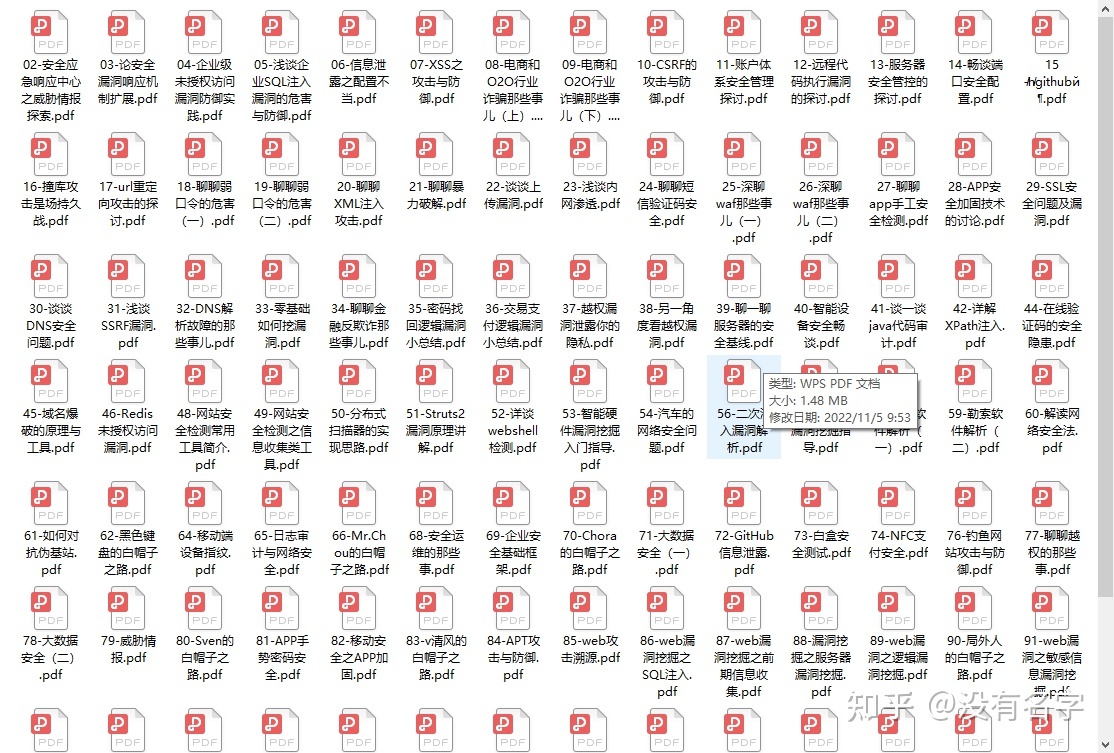

因篇幅有限,仅展示部分资料

网络安全面试题

绿盟护网行动

还有大家最喜欢的黑客技术

网络安全源码合集+工具包

所有资料共282G,朋友们如果有需要全套《网络安全入门+黑客进阶学习资源包》,可以扫描下方二维码领取(如遇扫码问题,可以在评论区留言领取哦)~

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

-1. 使用rsa加密技术,生成公钥和私钥。一路回车即可

[root@master ~]# cd ~

[root@master ~]# ssh-keygen -t rsa

-2. 进入~/.ssh目录下,将id_rsa.pub复制一份文件,文件名为authorized_keys。保证此文件的权限是600

[root@master ~]# cd ~/.ssh

[root@master .ssh]# cp id_rsa.pub authorized_keys

或者使用ssh-copy-id命令

[root@master .ssh]# ssh-copy-id -i id_ras.pub root@master

-3. 进行验证

[hadoop@master .ssh]# ssh localhost

[hadoop@master .ssh]# ssh master

[hadoop@master .ssh]# ssh 0.0.0.0

#输入yes后,不提示输入密码就对了

注意:三台机器提前安装好的情况下,需要同步公钥文件。如果使用克隆技术。那么使用同一套密钥对就方便多了。

4.6 时间同步

可以参考Linux文档中的时间同步或者搭建局域网时间服务器。

4.7 安装Jdk和Hadoop,配置相关环境变量

-1. 上传和解压两个软件包

[root@master ~]# cd /opt/software/

[root@master software]# tar -zxvf jdk-8u221-linux-x64.tar.gz -C /opt/apps/

[root@master software]# tar -zxvf hadoop-2.7.6.tar.gz -C /opt/apps/

-2. 进入apps里,给两个软件更名

[root@master software]# cd /opt/apps/

[root@master apps]# mv jdk1.8.0_221/ jdk

[root@master apps]# mv hadoop-2.7.6/ hadoop

-3. 配置环境变量

[hadoop@master apps]# vi /etc/profile

…省略…

#java environment

export JAVA_HOME=/opt/apps/jdk

export PATH=

J

A

V

A

H

O

M

E

/

b

i

n

:

JAVA_HOME/bin:

JAVAHOME/bin:JAVA_HOME/jre/bin:KaTeX parse error: Expected 'EOF', got '#' at position 8: PATH #̲hadoop environm…HADOOP_HOME/bin:

H

A

D

O

O

P

H

O

M

E

/

s

b

i

n

:

HADOOP_HOME/sbin:

HADOOPHOME/sbin:PATH

#### **5 Hadoop的配置文件**

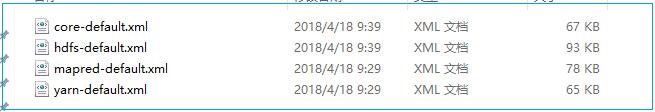

5.1 提取四个默认配置文件

第一步:将hadoop安装包解压到pc端的一个目录下,然后在hadoop-2.7.6目录下创建一个default目录,用于存储默认配置文件。 第二步:进入hadoop的share目录中的doc子目录,搜索default.xml。将以下四个默认的xml文件copy到default目录中,方便以后查看

5.2 $HADOOP\_HOME/etc/hadoop/目录下的用户自定义配置文件

- core-site.xml

- hdfs-site.xml

- mapred-site.xml 复制mapred-site.xml.template而来

- yarn-site.xml

5.3 属性的优先级

代码中的属性>xxx-site.xml>xxx-default.xml

#### **6 完全分布式文件配置(重点)**

配置前说明:我们先在master机器节点上配置hadoop的相关属性。

6.1 配置core-site.xml文件

[root@master ~]# cd $HADOOP_HOME/etc/hadoop/

[root@master hadoop]# vi core-site.xml

fs.defaultFS

hdfs://master:8020

hadoop.tmp.dir

/opt/apps/hadoop/tmp

>

> 参考:core-default.xml

>

6.2 再配置hdfs-site.xml文件

[root@master hadoop]# vi core-site.xml

dfs.namenode.name.dir

file://

h

a

d

o

o

p

.

t

m

p

.

d

i

r

/

d

f

s

/

n

a

m

e

<

/

v

a

l

u

e

>

<

/

p

r

o

p

e

r

t

y

>

<

!

−

−

确定

D

F

S

数据节点应该将其块存储在本地文件系统的何处

−

−

>

<

p

r

o

p

e

r

t

y

>

<

n

a

m

e

>

d

f

s

.

d

a

t

a

n

o

d

e

.

d

a

t

a

.

d

i

r

<

/

n

a

m

e

>

<

v

a

l

u

e

>

f

i

l

e

:

/

/

{hadoop.tmp.dir}/dfs/name</value> </property> <!-- 确定DFS数据节点应该将其块存储在本地文件系统的何处--> <property> <name>dfs.datanode.data.dir</name> <value>file://

hadoop.tmp.dir/dfs/name</value></property><!−−确定DFS数据节点应该将其块存储在本地文件系统的何处−−><property><name>dfs.datanode.data.dir</name><value>file://{hadoop.tmp.dir}/dfs/data

dfs.replication

3

dfs.blocksize

134217728

dfs.namenode.secondary.http-address

slave1:50090

>

> 参考:hdfs-default.xml

>

6.3 然后配置mapred-site.xml文件

如果只是搭建hdfs,只需要配置core-site.xml和hdfs-site.xml文件就可以了,但是我们过两天要学习的MapReduce是需要YARN资源管理器的,因此,在这里,我们提前配置一下相关文件。

[root@master hadoop]# cp mapred-site.xml.template mapred-site.xml

[root@master hadoop]# vi mapred-site.xml

mapreduce.framework.name

yarn

mapreduce.jobhistory.address

master:10020

mapreduce.jobhistory.webapp.address

master:19888

>

> 参考:mapred-default.xml

>

6.4 配置yarn-site.xml文件

[root@master hadoop]# vi yarn-site.xml

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.hostname

master

>

> 参考:yarn-default.xml

>

6.5 配置hadoop-env.sh脚本文件

[root@master hadoop]# vi hadoop-env.sh

…

The java implementation to use.

export JAVA_HOME=/opt/apps/jdk

…

6.6 配置slaves文件,此文件用于指定datanode守护进程所在的机器节点主机名

[root@master hadoop]# vi slaves

master

slave1

slave2

6.7 配置yarn-env.sh文件,此文件可以不配置,不过,最好还是修改一下yarn的jdk环境比较好

[root@master hadoop]# vi yarn-env.sh

…省略…

some Java parameters

export JAVA_HOME=/opt/apps/jdk

…省略…

#### **7 另外两台机器配置说明**

当把master机器上的hadoop的相关文件配置完毕后,我们有以下两种方式来选择配置另外几台机器的hadoop.

**方法1:**“scp”进行同步

提示:本方法适用于多台虚拟机已经提前搭建出来的场景。

–1. 同步hadoop到slave节点上

[root@master ~]# cd /opt/apps

[root@master apps]# scp -r ./hadoop slave1:/opt/apps/

[root@master apps]# scp -r ./hadoop slave2:/opt/apps/

–2. 同步/etc/profile到slave节点上

[root@master apps]# scp /etc/profile slave1:/etc/

[root@master apps]# scp /etc/profile slave2:/etc/

–3. 如果slave节点上的jdk也没有安装,别忘记同步jdk。

–4. 检查是否同步了/etc/hosts文件

**方法2:**克隆master虚拟机

提示:本方法适用于还没有安装slave虚拟机的场景。通过克隆master节点的方式,来克隆一个slave1和slave2机器节点,这种方式就不用重复安装环境和配置文件了,效率非常高,节省了大部分时间(免密认证的秘钥对都是相同的一套)。

–1. 打开一个新克隆出来的虚拟机,修改主机名

[root@master ~]# hostnamectl set-hostname slave1

–2. 修改ip地址

[root@master ~]# vi /etc/sysconfig/network-scripts/ifcfg-ens33

…省略…

IPADDR=192.168.10.201 <==修改为slave1对应的ip地址

…省略…

–3. 重启网络服务

[root@master ~]# systemctl restart network

–4. 其他新克隆的虚拟机重复以上1~3步

–5. 免密登陆的验证

从master机器上,连接其他的每一个节点,验证免密是否好使,同时去掉第一次的询问步骤

–6. 建议:每台机器在重启网络服务后,最好reboot一下。

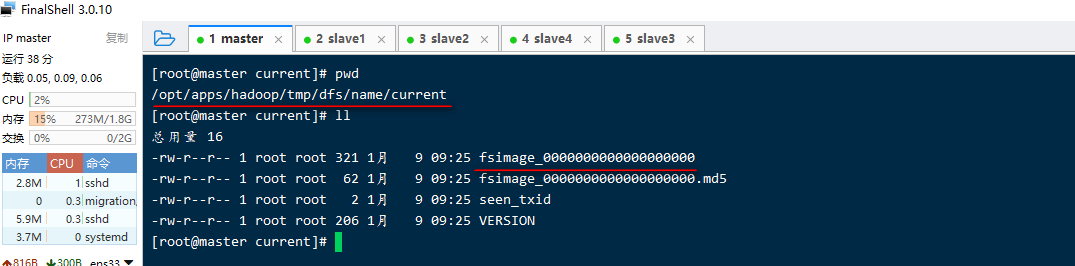

#### **8 格式化NameNode**

**1)**在master机器上运行命令

[root@master ~]# hdfs namenode -format

**注意,注意,注意:** 如果你是从伪分布式过来的,最好先把伪分布式的相关守护进程关闭:stop-all.sh

**2)**格式化的相关信息解读

–1. 生成一个集群唯一标识符:clusterid

–2. 生成一个块池唯一标识符:BlockPoolId

–3. 生成namenode进程管理内容(fsimage)的存储路径:

默认配置文件属性hadoop.tmp.dir指定的路径下生成dfs/name目录

–4. 生成镜像文件fsimage,记录分布式文件系统根路径的元数据

–5. 其他信息都可以查看一下,比如块的副本数,集群的fsOwner等。

参考图片:

**3)**目录里的内容查看

#### **9 启动集群**

**9.1** 启动脚本和关闭脚本介绍

-

启动脚本

– start-dfs.sh :用于启动hdfs集群的脚本

– start-yarn.sh :用于启动yarn守护进程

– start-all.sh :用于启动hdfs和yarn -

关闭脚本

– stop-dfs.sh :用于关闭hdfs集群的脚本

– stop-yarn.sh :用于关闭yarn守护进程

– stop-all.sh :用于关闭hdfs和yarn -

单个守护进程脚本

– hadoop-daemons.sh :用于单独启动或关闭hdfs的某一个守护进程的脚本

– hadoop-daemon.sh :用于单独启动或关闭hdfs的某一个守护进程的脚本

reg:

hadoop-daemon.sh [start|stop] [namenode|datanode|secondarynamenode]– yarn-daemons.sh :用于单独启动或关闭hdfs的某一个守护进程的脚本

– yarn-daemon.sh :用于单独启动或关闭hdfs的某一个守护进程的脚本

reg:

yarn-daemon.sh [start|stop] [resourcemanager|nodemanager]

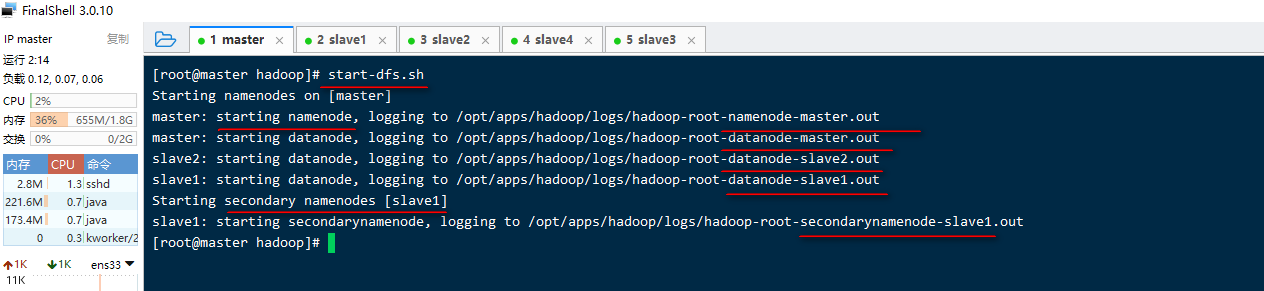

**9.2** 启动hdfs

**1)**使用start-dfs.sh,启动 hdfs。参考图片

**2)**启动过程解析:

- 启动集群中的各个机器节点上的分布式文件系统的守护进程

一个namenode和resourcemanager以及secondarynamenode

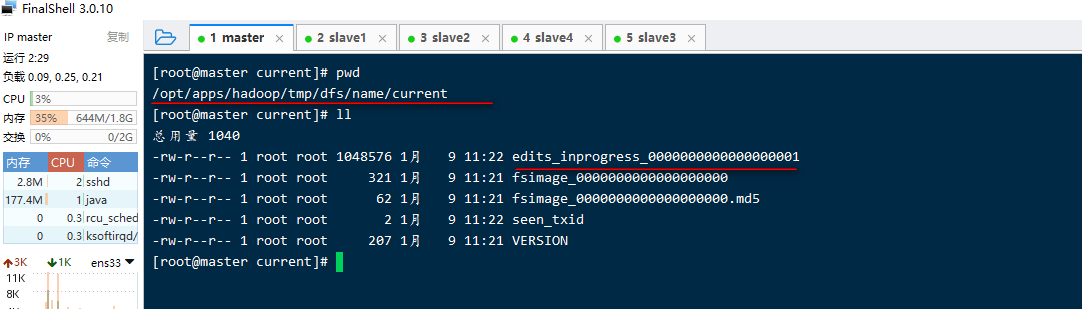

多个datanode和nodemanager - 在namenode守护进程管理内容的目录下生成edit日志文件

- 在每个datanode所在节点下生成${hadoop.tmp.dir}/dfs/data目录,参考下图:

**注意,注意,注意**

如果哪台机器的相关守护进程没有开启,那么,就查看哪台机器上的守护进程对应的日志log文件,注意,启动脚本运行时提醒的日志后缀是*.out,而我们查看的是*.log文件。此文件的位置:${HADOOP_HOME}/logs/里

**3)**jps查看进程

–1. 在master上运行jps指令,会有如下进程

namenode

datanode

–2. 在slave1上运行jps指令,会有如下进程

secondarynamenode

datanode

–3. 在slave2上运行jps指令,会有如下进程

datanode

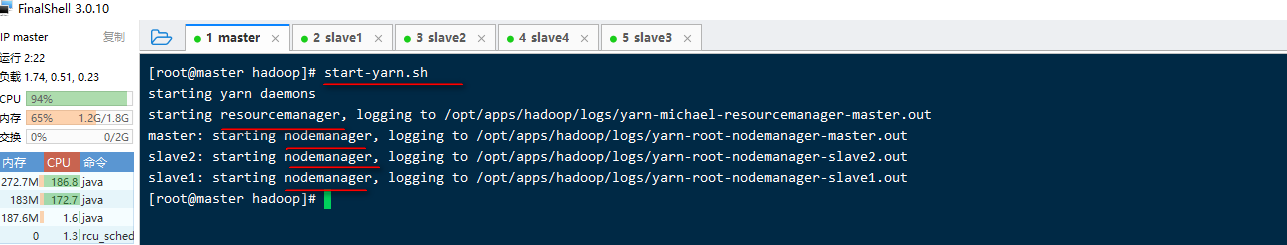

**9.3** 启动yarn

**1)**使用start-yarn.sh脚本,参考图片

本人从事网路安全工作12年,曾在2个大厂工作过,安全服务、售后服务、售前、攻防比赛、安全讲师、销售经理等职位都做过,对这个行业了解比较全面。

最近遍览了各种网络安全类的文章,内容参差不齐,其中不伐有大佬倾力教学,也有各种不良机构浑水摸鱼,在收到几条私信,发现大家对一套完整的系统的网络安全从学习路线到学习资料,甚至是工具有着不小的需求。

最后,我将这部分内容融会贯通成了一套282G的网络安全资料包,所有类目条理清晰,知识点层层递进,需要的小伙伴可以点击下方小卡片领取哦!下面就开始进入正题,如何从一个萌新一步一步进入网络安全行业。

### 学习路线图

其中最为瞩目也是最为基础的就是网络安全学习路线图,这里我给大家分享一份打磨了3个月,已经更新到4.0版本的网络安全学习路线图。

相比起繁琐的文字,还是生动的视频教程更加适合零基础的同学们学习,这里也是整理了一份与上述学习路线一一对应的网络安全视频教程。

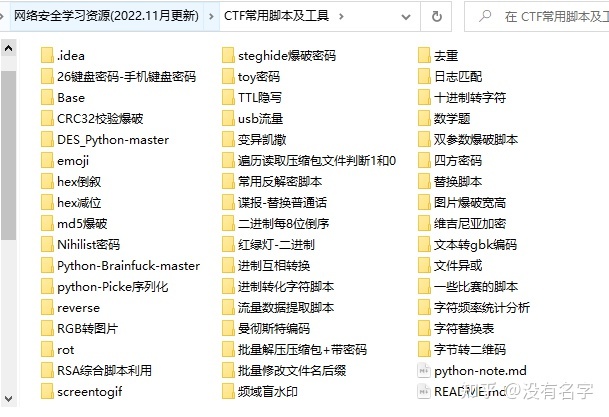

#### 网络安全工具箱

当然,当你入门之后,仅仅是视频教程已经不能满足你的需求了,你肯定需要学习各种工具的使用以及大量的实战项目,这里也分享一份**我自己整理的网络安全入门工具以及使用教程和实战。**

#### 项目实战

最后就是项目实战,这里带来的是**SRC资料&HW资料**,毕竟实战是检验真理的唯一标准嘛~

#### 面试题

归根结底,我们的最终目的都是为了就业,所以这份结合了多位朋友的亲身经验打磨的面试题合集你绝对不能错过!

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化资料的朋友,可以点击这里获取](https://bbs.csdn.net/topics/618540462)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

1125

1125

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?