深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

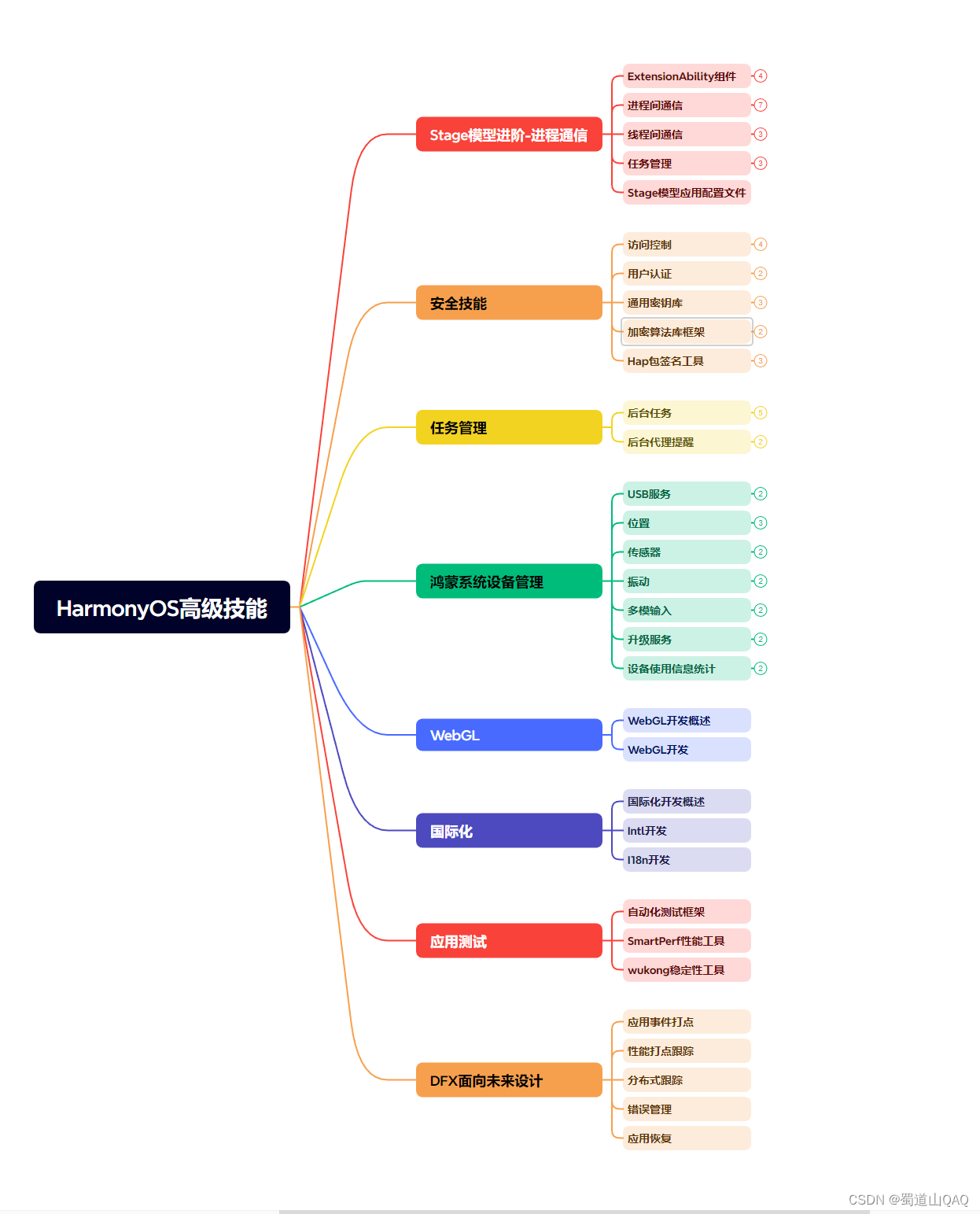

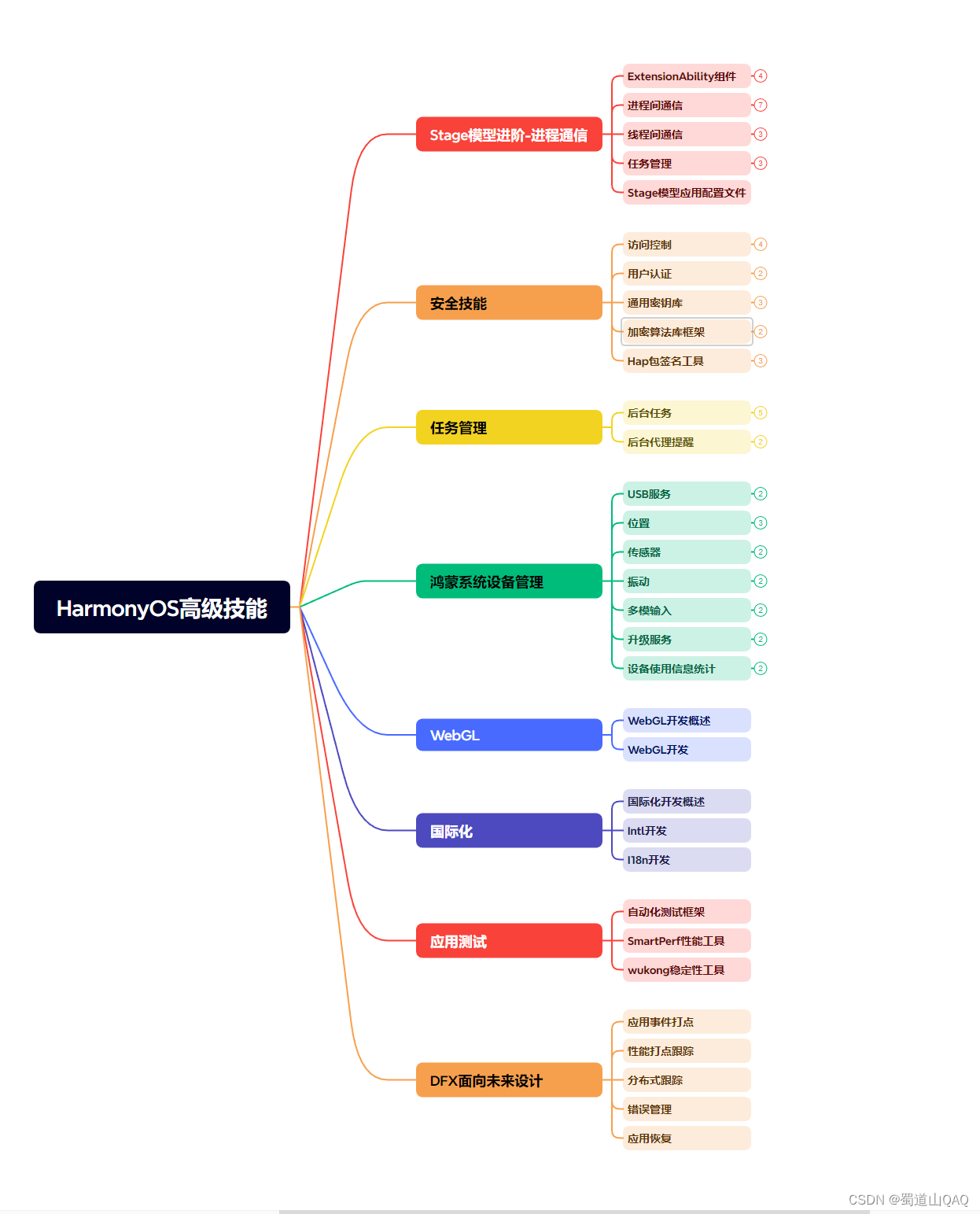

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上鸿蒙开发知识点,真正体系化!

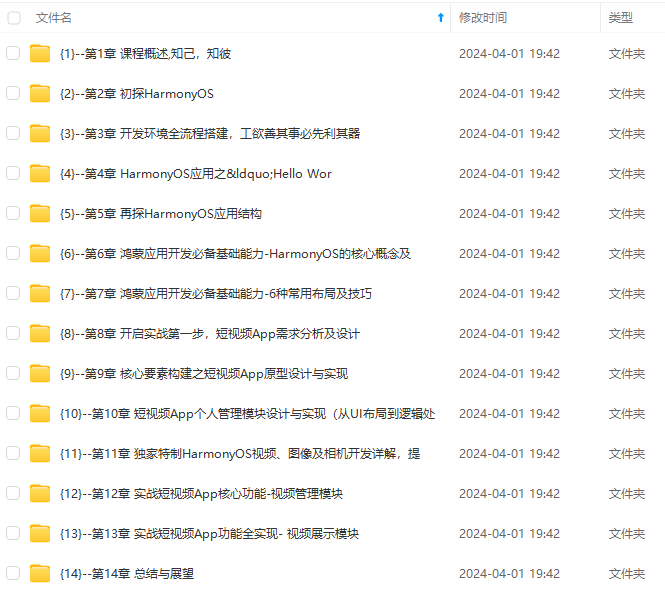

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

- 包含64个Transformer层,每层都有多头注意力块和密集块,注意力头数为查询48个,键/值8个。

- 使用旋转位置嵌入 (RoPE)处理序列数据,Tokenization词汇量为131072,嵌入大小为6144。

- 提供8位量化的权重,有助于减少模型的存储和计算需求,适合资源有限的环境。

- 运行要求:模型规模巨大(314B参数),需要具有足够GPU内存的机器运行,以每参数2字节来算,大概需要628GB的GPU内存(一张性价比最高的4090有24G显存,大概二三十张4090)。

- xAI 于 2023 年 10 月在 JAX 和 Rust 上使用自定义训练堆栈从头开始训练。

使用指南

当前,Grok-1 面向所有人开放,而要开始使用该模型,可以先确保下载 checkpoint 并将 ckpt-0 目录放入 checkpoint。然后,运行:

pip install -r requirements.txt

python run.py

进而测试代码。

脚本在测试输入上加载检查点和模型样本。

值得注意的事,Grok-1 参数量高达 314B 个参数,其模型体积庞大,需要配备足够 GPU 内存的机器才能使用示例代码测试模型。

xAI 团队在 GitHub 项目仓库里面也直言道:该资源库中 MoE 层的实现并不高效。选择这种实现方式是为了避免需要定制内核来验证模型的正确性。

你可以使用 torrent 客户端和下面磁铁链接下载权重:

magnet:xt=urn:btih:5f96d43576e3d386c9ba65b883210a393b68210e&tr=https%3A%2F%2Facademictorrents.com%2Fannounce.php&tr=udp%3A%2F%2Ftracker.coppersurfer.tk%3A6969&tr=udp%3A%2F%2Ftracker.opentrackr.org%3A1337%2Fannounce

既然用户可以免费将Grok用于商业用途,进行修改和分发,而且没有附加条款,

那Grok的开源无疑将为人工智能技术的发展和应用带来新的机遇,并为互联网创作者提供新的舞台。

var code = “682fbd7d-e031-41bb-bb24-5b7705c0c823”

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上鸿蒙开发知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

后续会持续更新**

9万+

9万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?