前言

Docker的安装挡住了90%的人,本地部署不能联网搜索等等。

今天就来解决这些问题,一个本地部署+私人知识库+联网搜索的终极方案。

本地部署DeepSeek

首先打开ollama官网:https://ollama.com

下载,一步步安装即可。

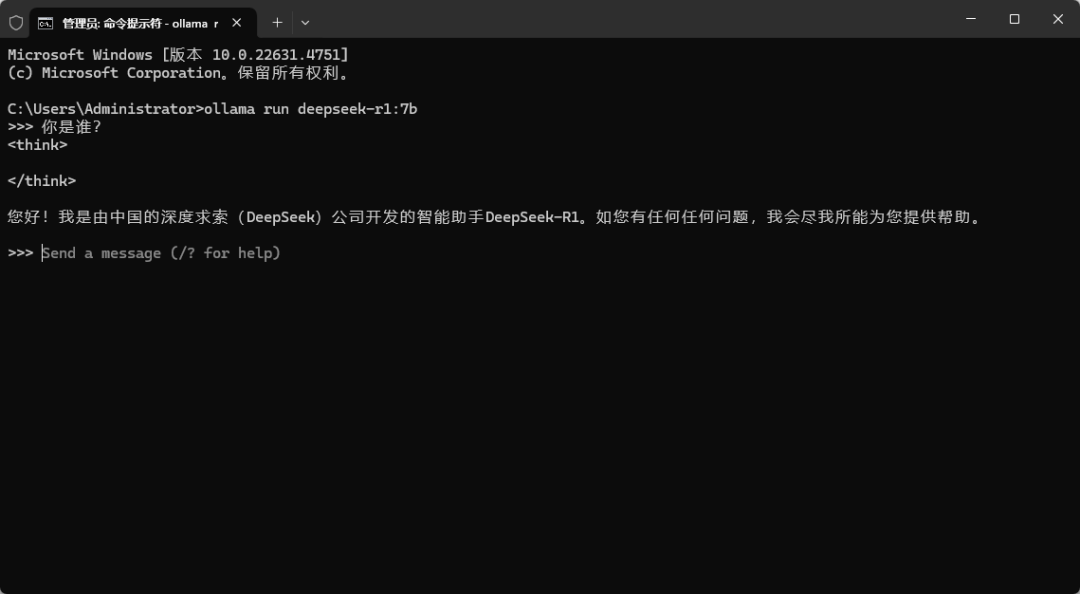

CMD命令窗口运行,启动deepseek-r1模型:

ollama run deepseek-r1:7b

根据自己显卡大小,选择对应的参数规模,1.5b最小,可以先用这个来尝试,完成以后再跑更大的参数模型。

另外有人反馈,任务管理器显示,大模型在执行的时候,回答很慢,GPU几乎没动,全都是CPU在跑。

大概率是安装了老版本的Ollama,官网下载最新的文件重新安装即可。

安装Page Assist插件

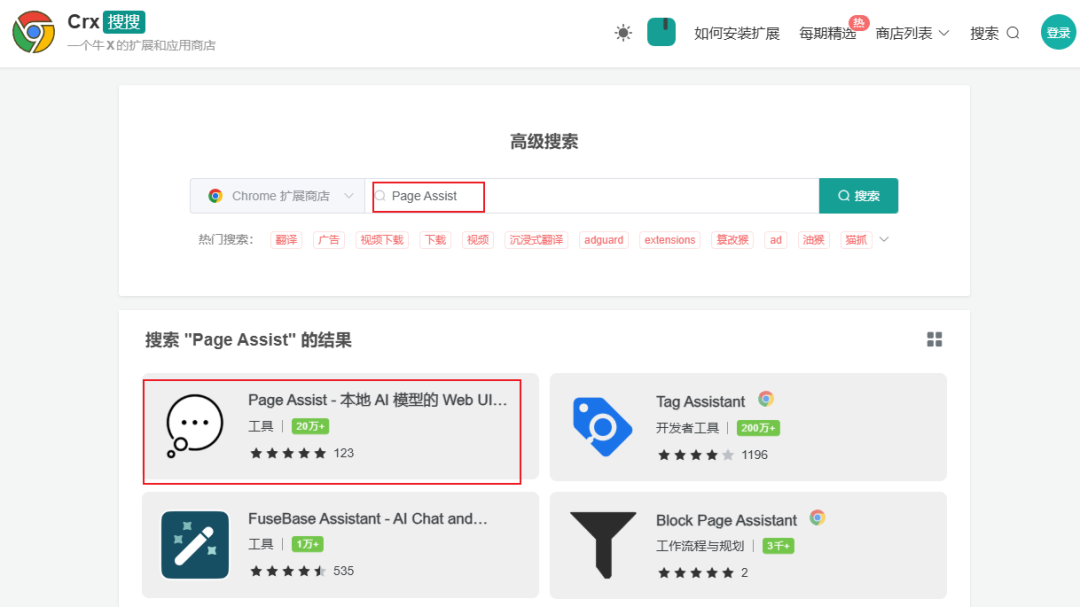

网络条件允许的话,直接谷歌商店搜索下载,下面介绍的方法国内网络可用。

打开网站Crx搜搜:

https://www.crxsoso.com

搜索:Page Assist,第一个就是今天主角,本地AI模型的Web UI。

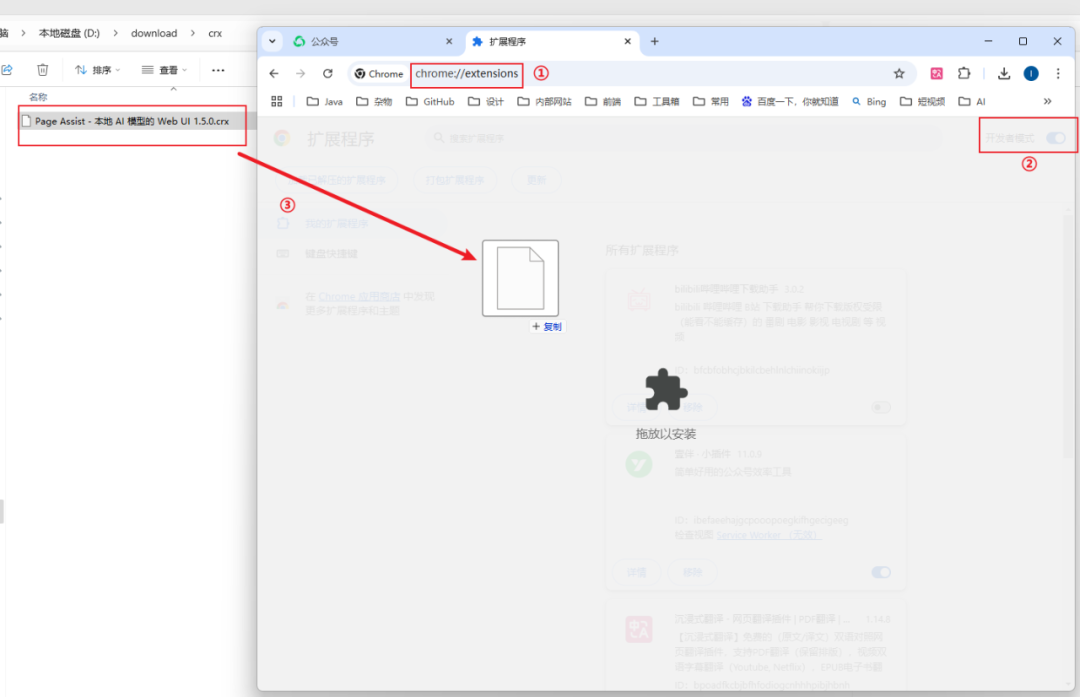

下载到本地,谷歌浏览器打开:chrome://extensions/,右上角打开开发者模式,将下载好的crx文件拖入浏览器,完成插件的安装。

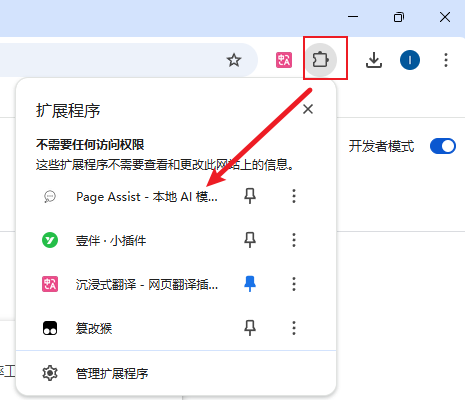

浏览器上方的扩展程序列表,找到Page Assist插件,点击进入WebUI界面。

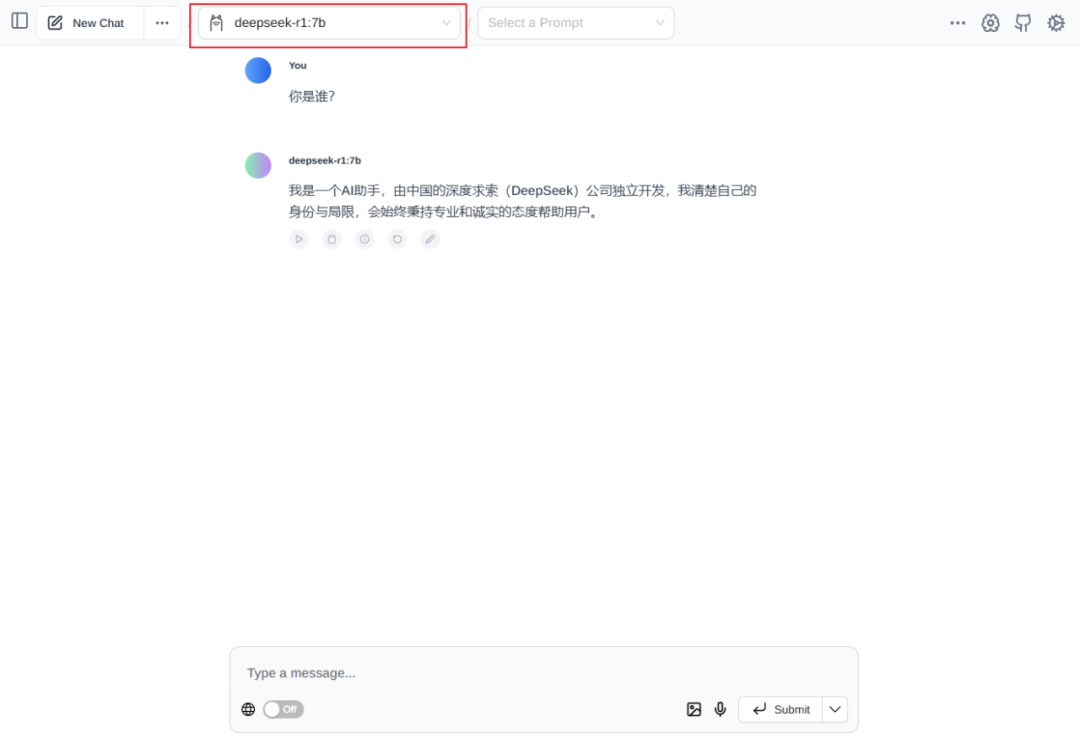

左上角可以选择ollama的所有本地模型,所以选deepseek-r1:7b就好了。

到这一步就可以流畅地使用deepseek大模型啦。

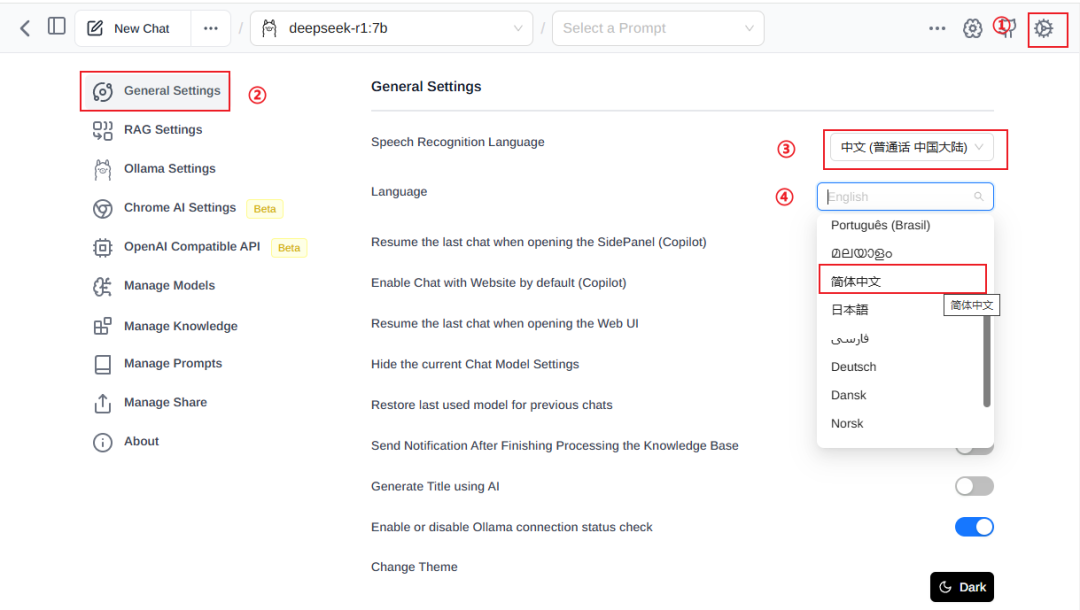

首次使用是英文版,不太习惯,点击右上角设置齿轮,【General Settings】,分别选择【简体中文】。

设置联网搜索

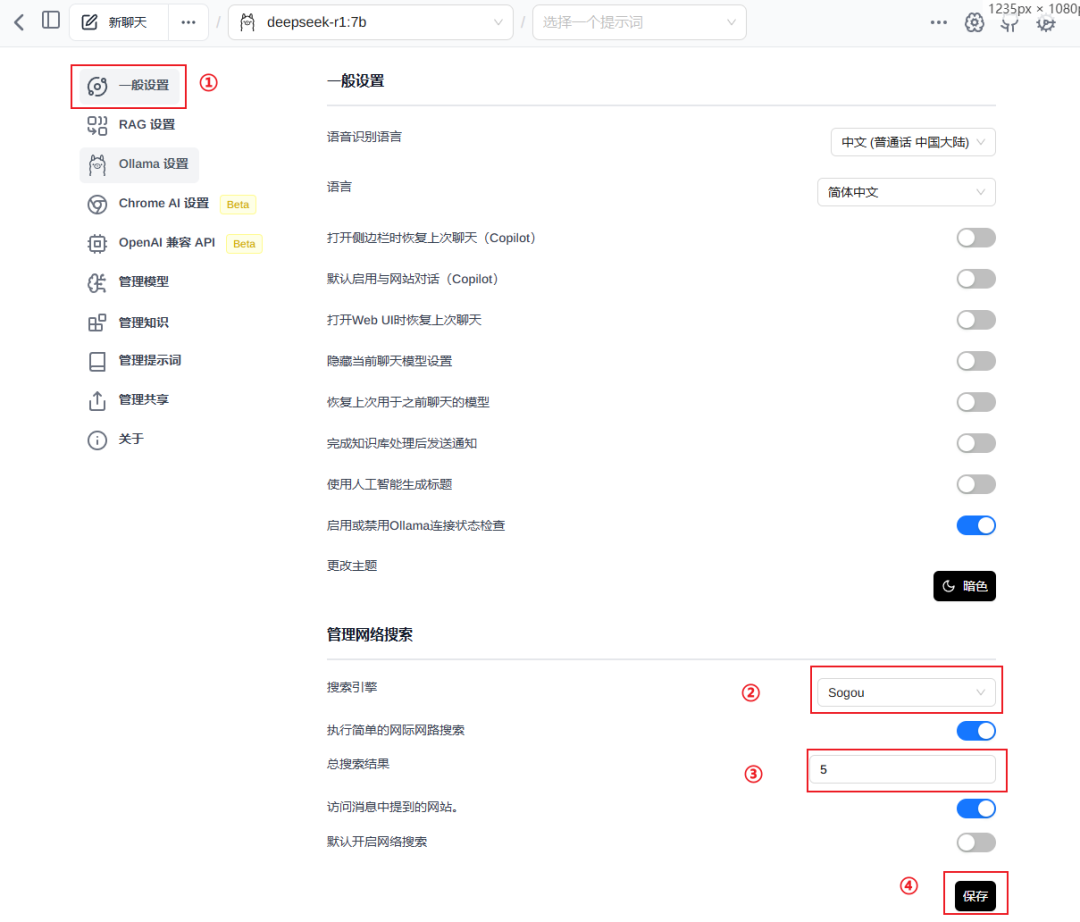

依然是右上角设置齿轮,【一般设置】,下方有个【管理网络搜索】,选择合适的搜索引擎,总搜索结果默认是2,可以适当调大一些,这样参考网络资源的权重更大。

记得点击保存。

回到聊天页面,打开聊天框下方的【搜索互联网】开关,联网搜索功能就搞定啦。

比如问一个关于《哪吒2》的评价,除了看到思考过程,下方还有列出了引用的数据来源。

现在,完成了本地部署+联网搜索,还差知识库…

搭建私人知识库

CMD窗口运行命令:

ollama pull nomic-embed-text

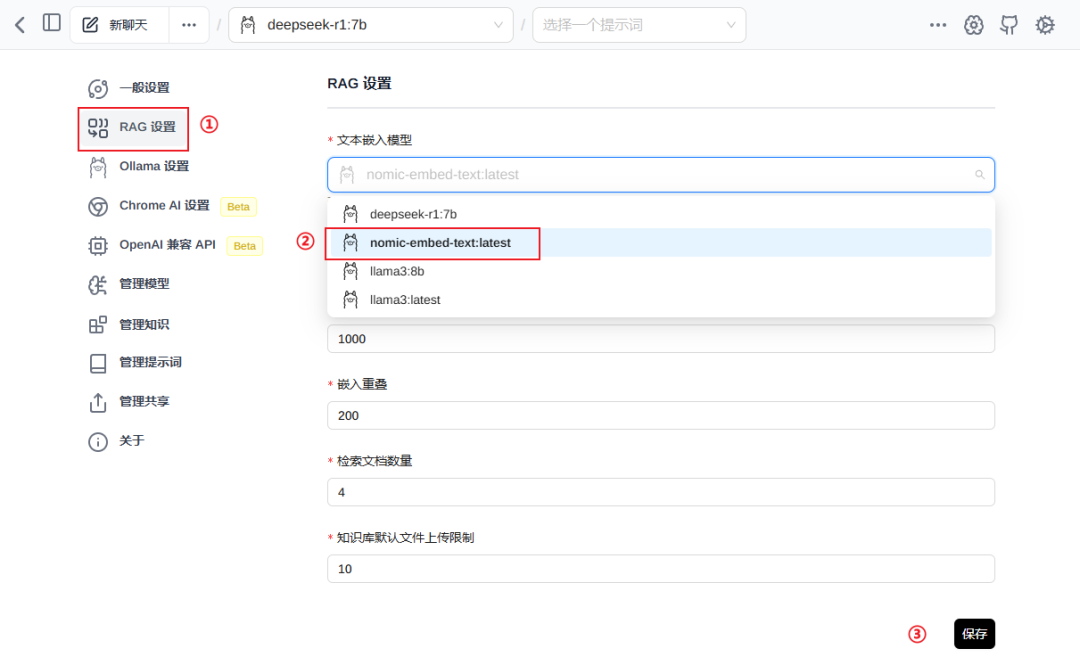

回到设置,【RAG设置】,文本嵌入模型选择【nomic-embed-text:latest】,保存。

文本嵌入模型的作用是,让大模型理解我们的文本资料。

左侧菜单【管理知识】,【添加新知识】,指定知识的标题,并上传我们的本地资料,提交。

这里的知识,指的就是知识库,当状态是【已完成】,代表大模型已经处理完成了。

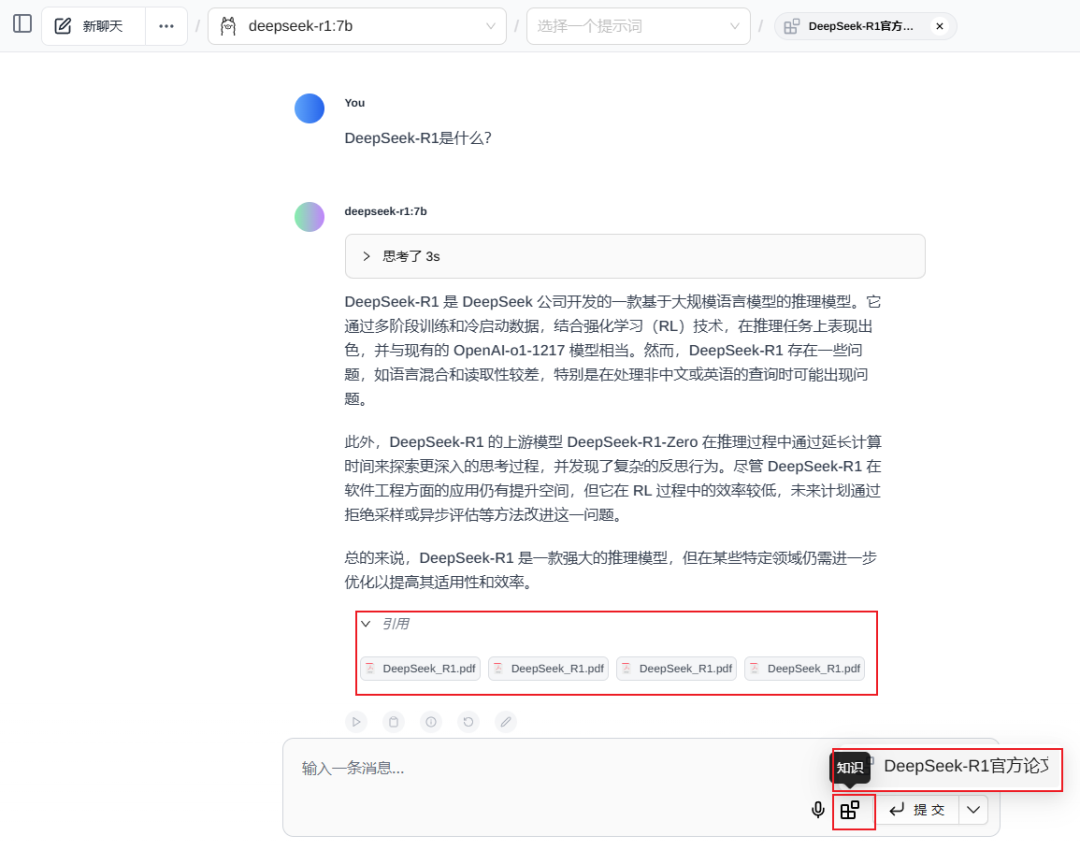

回到聊天窗口,右下方就可以选到刚刚添加的知识库。

提问:

DeepSeek-R1是什么?

本地大模型完美地回答了我们的问题,知识库搭建完成!

简单回顾一下,这次的方案:Ollama + Page Assist插件,没有docker的复杂配置,而且完美地实现了本地部署+联网搜索+知识库。

最后的最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

DeepSeek全套安装部署资料

大模型知识脑图

为了成为更好的 AI大模型 开发者,这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

经典书籍阅读

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

面试资料

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?