最近这一两周看到不少互联网公司都已经开始秋招提前批了。

不同以往的是,当前职场环境已不再是那个双向奔赴时代了。求职者在变多,HC 在变少,岗位要求还更高了。

最近,我们又陆续整理了很多大厂的面试题,帮助一些朋友解惑答疑,分享技术面试中的那些弯弯绕绕。

美团实习两个多月了,受益良多,这是我第一次来大厂实习,后悔没有早早去找实习,实习真的比学校收获的多的多。 在实习期间做了一个项目,从取数到模型上线由导师指导,然后我自己完成的,没有一点dirty work,真的舒服,感动。

在实习期间做了一个项目,从取数到模型上线由导师指导,然后我自己完成的,没有一点dirty work,真的舒服,感动。

同时也被大厂的流程和效率感动,虽然美团比较扣,但是对实习生尤其是校招生的培养还是挺友好的。美团上海相对而言没有北京卷,我所在的组的同事都超好,都有些舍不得了。

是时候滚回学校准备秋招了,有问题欢迎大家与我交流。

面经总结

可能是因为实习生岗位吧,感觉不是很难,偏技术面一点,整体效果还行,问到很多技术都比较简单,很多问题都是原问题,所以回答起来会比较轻松一点。

总结一下我常被问到的面试题:

-

项目介绍

-

在项目中,你用到 Bert,你能不能介绍一下 BERT和GPT的训练方式的区别?

-

简单介绍一下,transformer架构?Transformer的输入和输出分别是什么?

-

说一下 Transformer 的输出和 Bert 有什么区别

-

self-attention的公式及参数量,为什么用多头,为什么要除以根号d?

-

大模型的模型架构有哪些?

-

ChatGPT对比GPT-3的性能提升主要来源于哪些方面?

-

InstructGPT 和 ChatGPT 模型中使用的关键技术(SFT->RLHF)

-

大模型中常见的位置编码?

-

大模型高效参数微调方法?讲一讲 lora 微调

-

讲一讲ppo流程 dpo流程

-

为什么一定要用偏好对齐不用sft? 你认为偏好对齐和sft区别在哪里?各自优缺点是什么

-

你觉得 RAG 和长上下文的区别在哪里?各自有什么优势?

-

如何实现长上下文?

-

llama3 和 llama2 的区别?从数据角度,如何将15T的数据喂到模型里做训练才能稳定?

-

在微调阶段,如果出现了训练不稳定怎么办?比如出现了抖动,loss突然增大怎么办?

-

了解推理加速方法吗?

leetcode 题

-

hot 100 hard 二叉树最大路径

-

升序数组构建平衡二叉搜索树

-

中序遍历

(完)

在这里,我想要强调的是:成功求职并不是一件难事,关键在于你是否做好了充分的准备。通过学习和掌握AI技术的相关知识和技能,了解面试中可能出现的问题和技巧,你就能够在面试中展现出自己的专业素养和实力,赢得面试官的青睐和认可。因此,让我们一起努力,用知识和技能武装自己,迎接AI时代的挑战和机遇吧!

有需要的朋友可以扫描下方二维码,免费获取更多相关资料!

最后,祝愿所有转行、求职的同学都能够在AI产品面试中取得优异的成绩,找到心仪的工作!加油!

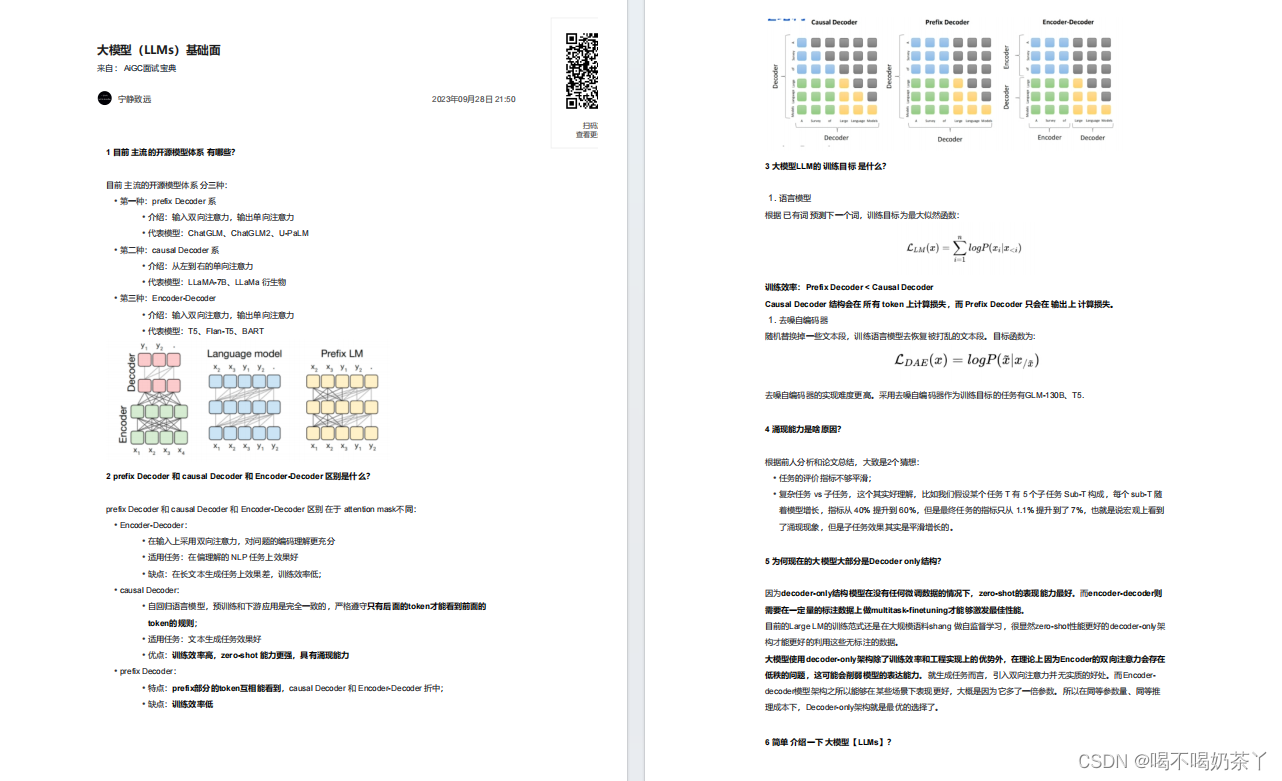

大模型基础面

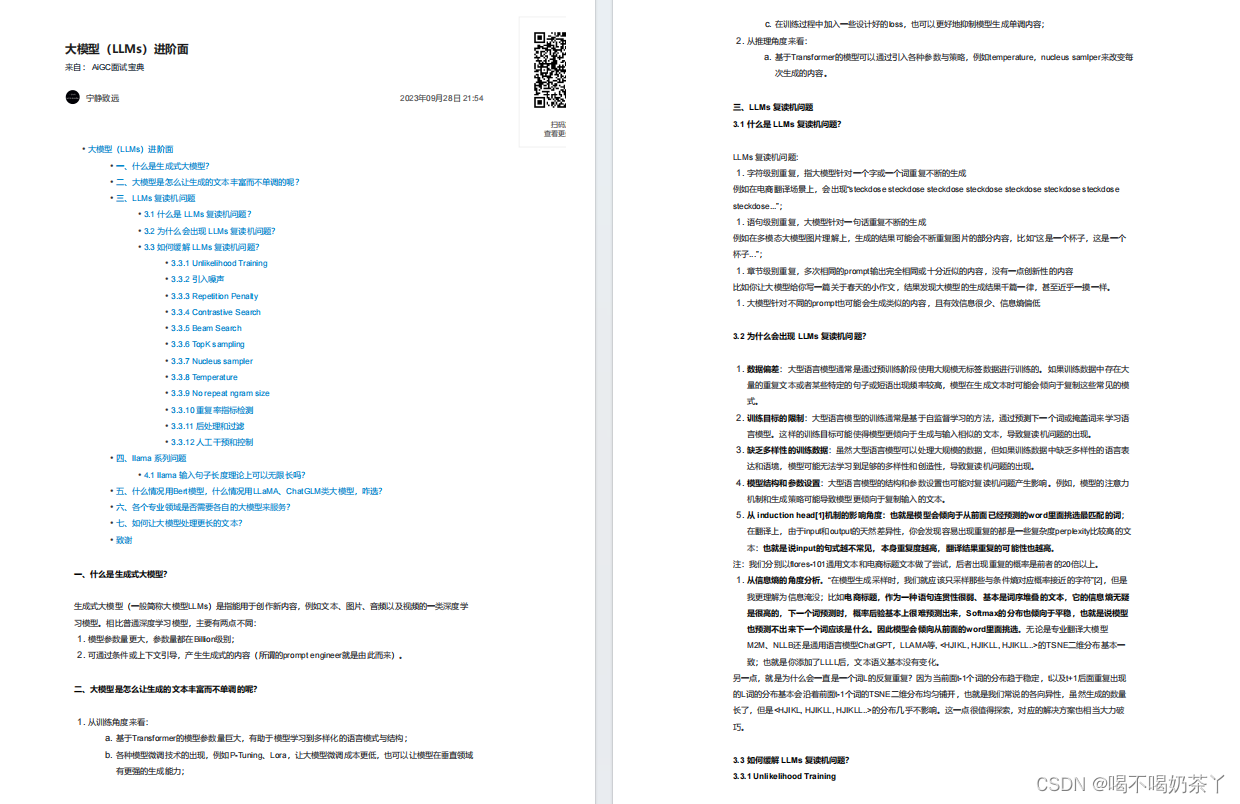

大模型进阶面

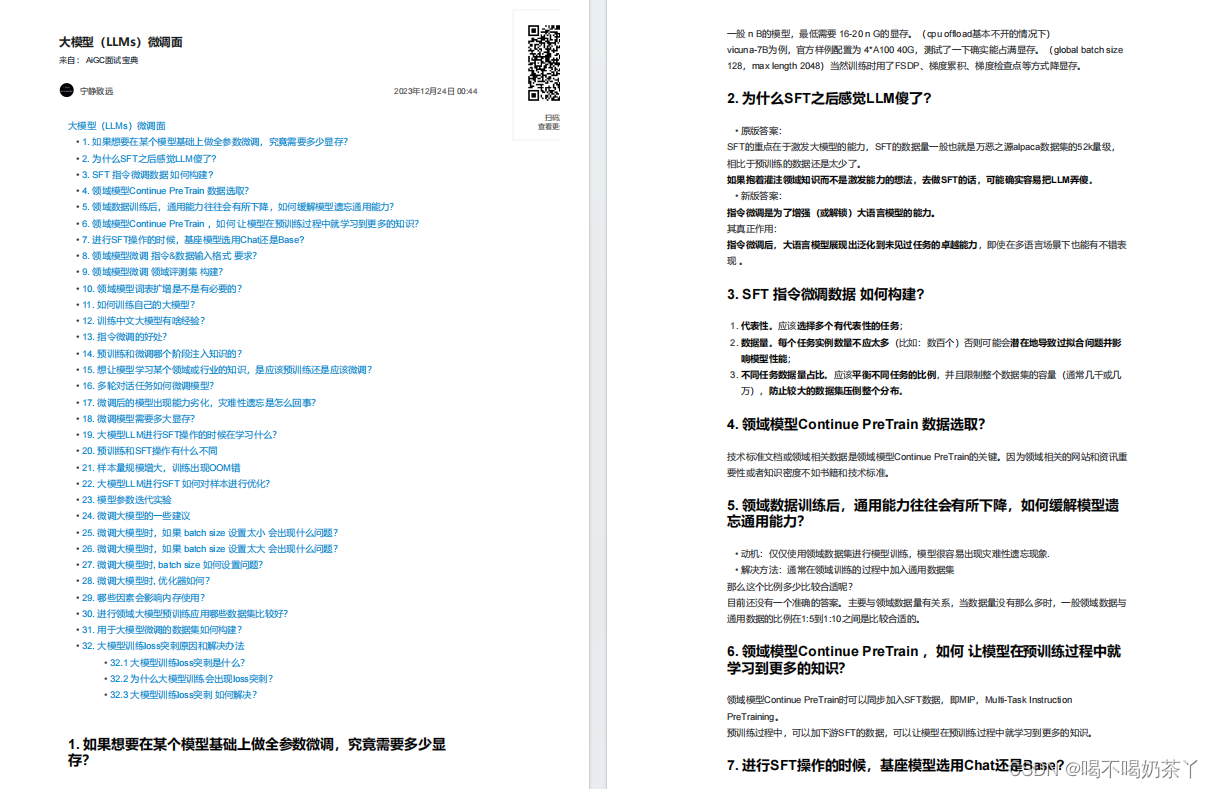

大模型微调面

大模型langchain面

大模型推理面

更多面试题分享

968

968

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?