又有一个超性价比的国产大模型出现了!这里是智匠AI,MiniMax刚刚对他们的主力模型abab6.5s,进行了大幅降价,输入和输出成本都达到了1元/百万tokens。我们今天就来进行评测这款abab6.5s。

一、综合能力测试:

abab6.5s在文科任务、内容理解、文字生成及信息提取方面展现出显著优势,同时在上下文长度和token处理速度上也表现出色。

二、基本测试:

下面是对它进行基本测试的结果,如图所示:

三、性能测试:

我们按照之前测试gpt4o-mini和deepseek coder的标准对它进行测试。这个主要用来测试它的推理能力

我们基于以下三项主要任务对三个模型进行测试:

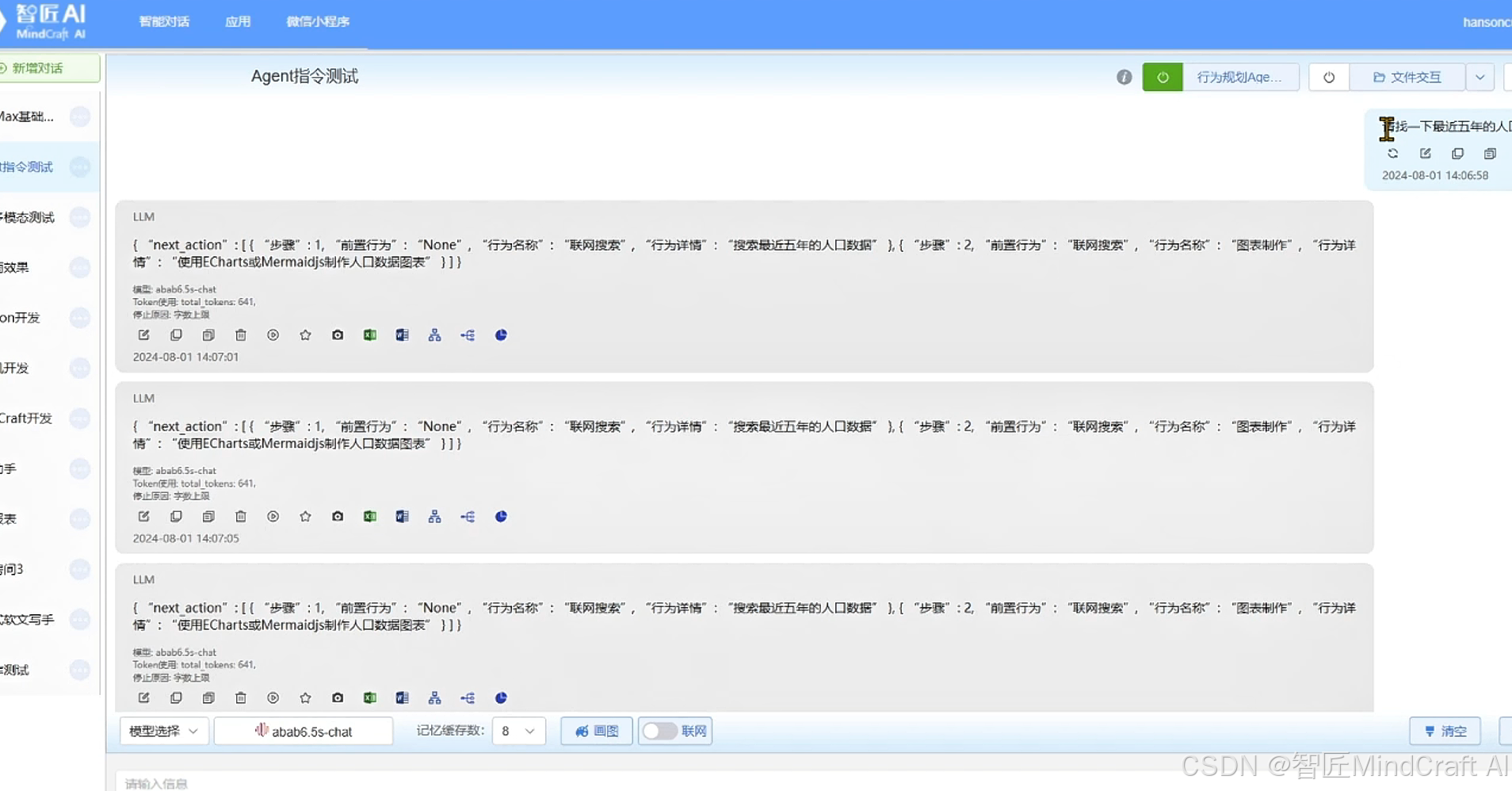

- 1、 原生指令遵从能力(测试是否适合用来驱动智能体和工作流)

-

测试结果:100%成功,稳定

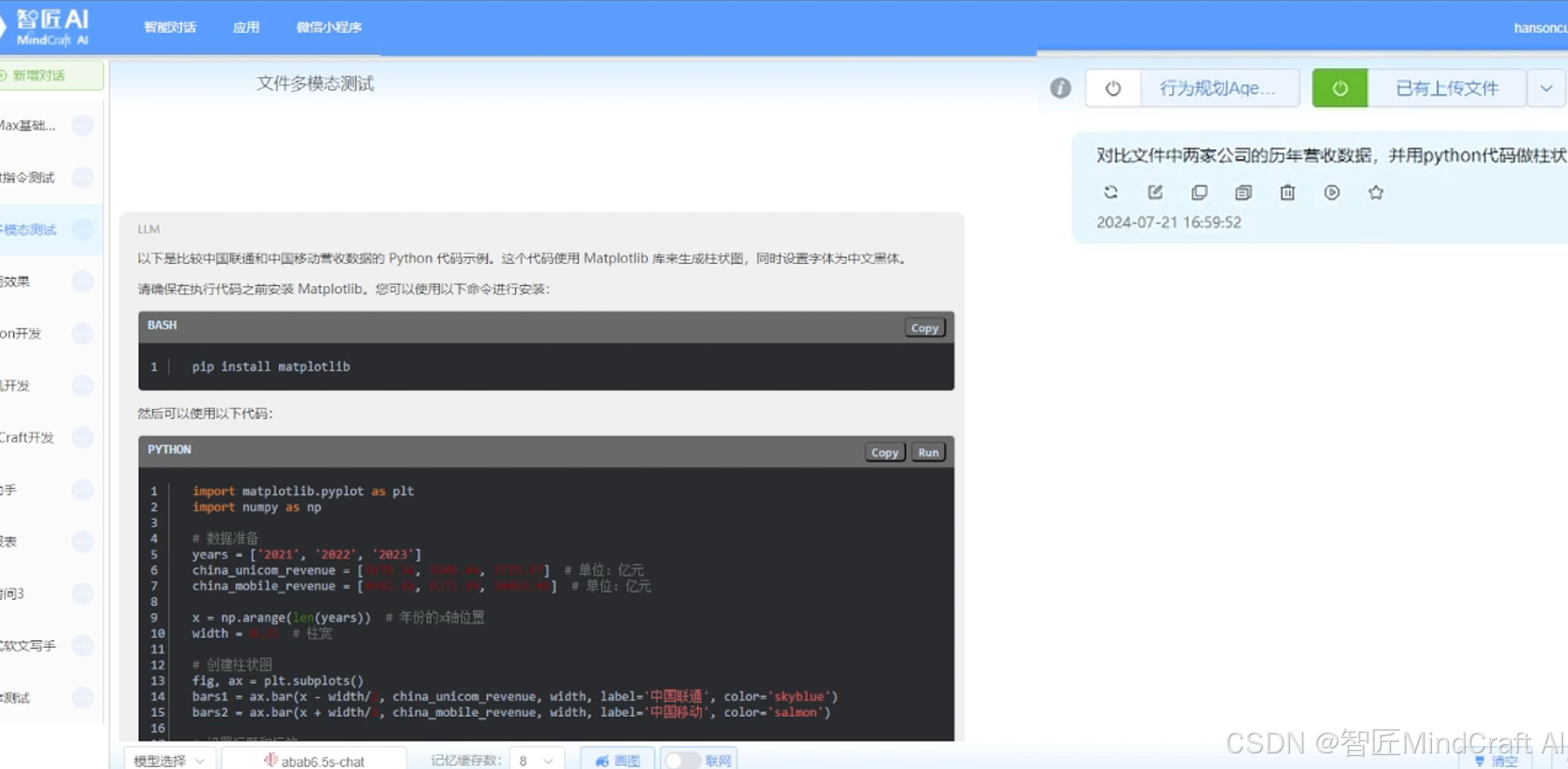

- 2、长上下文数据的理解和推理

-

测试结果:100%失败。在长上下文中数据抓取成功,代码有时候写得正确,主要问题是不会把获取的数据写到代码里。

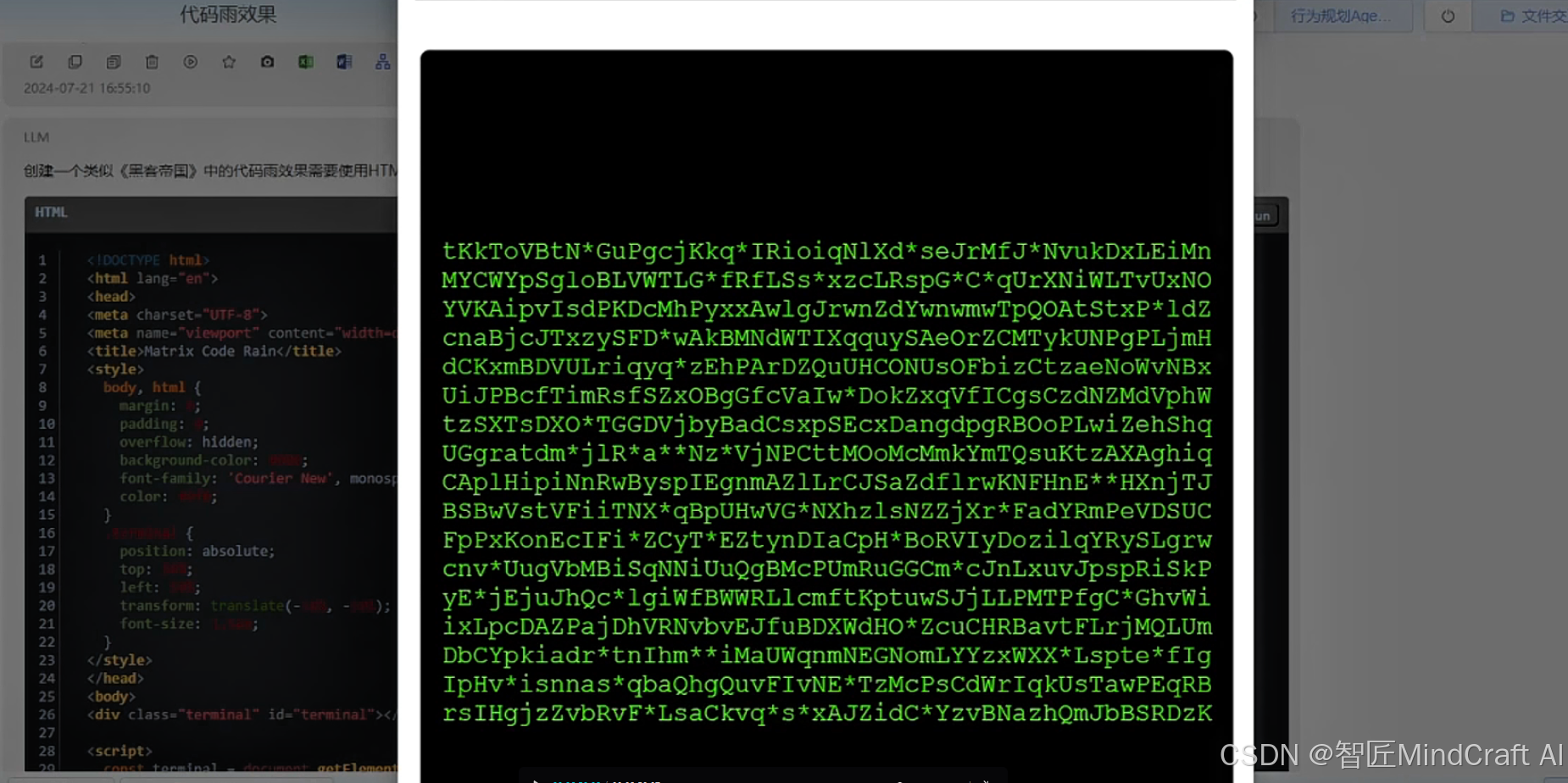

- 3、用代码实现有创造力的前端效果(需求理解及创造能力)

-

测试结果:70%基本实现,但效果都不是特别好。对需求的理解,以及用代码创造的能力有限。

通过以上测试我们大概可以总结以下几点,

- MiniMax abab6.5s各项基础能力均衡,没有明显短板。

- 254K的长上下文,以及极快的token处理速度是他的明显优势。

- 在推理层面,遵循指令能力稳定,可稳定有效输出json格式。但复杂问题推理效果一般。差于gpt4o-mini与deepseek coder。

- 角色扮演,沟通话术,文案生成,信息抓取能力较佳。作为一款1元/百万tokens的高级大模型,在文科任务变现更加优秀,适合如聊天机器人等应用。deepseek coder虽然性价比和推理能力极强,但并不适合拟人化沟通场景。

-

下面是对几款性能价格俱佳的大模型做了一个对比:

综上所述,MiniMax abab6.5s是一款在文科任务和长上下文处理方面具有优势,媲美GPT4级别的模型。

以上模型都可以在智匠AI中体验,可以根据高性价比选择自己喜欢的模型协助我们办公,提升项目开发效率。

532

532

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?