读完需要5分钟,速读仅需 1 分钟

1

目录

简介

Llama3 介绍和优点

Ollama 介绍

Lobechat 介绍

安装准备

本地运行环境要求

利用 Ollama 本地部署 Llama3

利用 Ollama 本地部署 Llama3 中文微调版

在 Lobechat 中使用 Llama3

2

简介

2.1

什么是 Llama3?

Lllma3 是 META 公司发布的开源语言大模型,与 chatGPT 类似,它可以完成一系列诸如对话,翻译,上下文理解等等复杂任务,你可以把它理解为一个免费,可以部署在你的电脑无须联网就可以使用的 AI 助手。

2.2

什么是 Ollama?

Ollama 是一个支持在本地运行大语言模型的工具,兼容 Windows 和 MacOS 操作系统。使用 Ollama,您仅需一行命令即可下载并启动模型。它简单方便使用,在本教程中我们使用 Ollama 来启动我们下载的 Lllama3 大模型。你可以把它理解为大语言模型的启动器。

2.3

什么是 Lobechat?

尽管在下载 Llama3 和 Ollama 后我们已经可以任意的使用模型,但为了更加方便的使用和体验我们可以使用 Lobechat 来部署我们的大语言模型。它拥有精美的 UI 设计 和可扩展的插件等等优点方便我们使用。

3

安装准备

Lllama3 有 8B 和 70B 两个版本,70B 拥有 700 亿个参数,需要强大的硬件支持,我们下载使用的是 Llama 3 8B,它拥有 80 亿个参数,相对来说轻量级是一个更加实用的选择。使用它我们需要:

良好的网络环境

GPU 最好有 8GB 及以上

磁盘空间最好有 10G 以上, Llama3 8B 版本需要 5G 空间,中文微调版需要至少 8G 空间

4

利用 Ollama 本地部署 Llama3

4.1

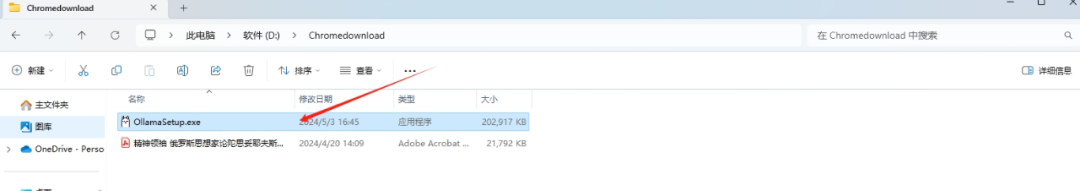

Windows系统下载 Ollama

打开下面的网站,下载 Ollama 并双击安装。

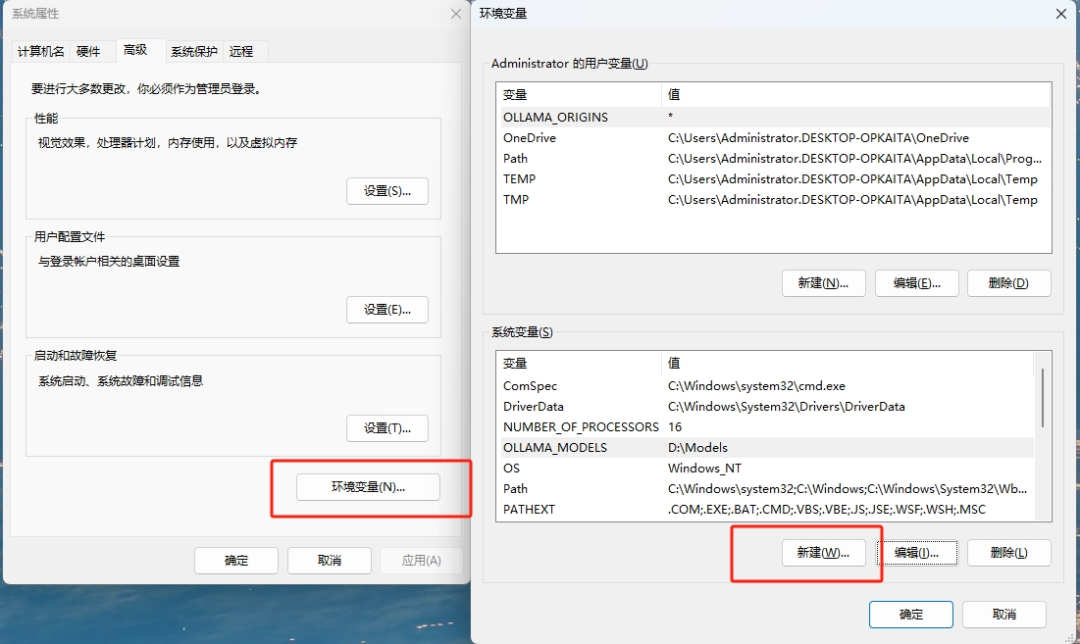

由于 Ollama 的默认参数配置,启动时设置了仅本地访问,所以跨域访问以及端口监听需要进行额外的环境变量设置 OLLAMA_ORIGINS。

首先通过 Windows 任务栏点击 Ollama 退出程序。

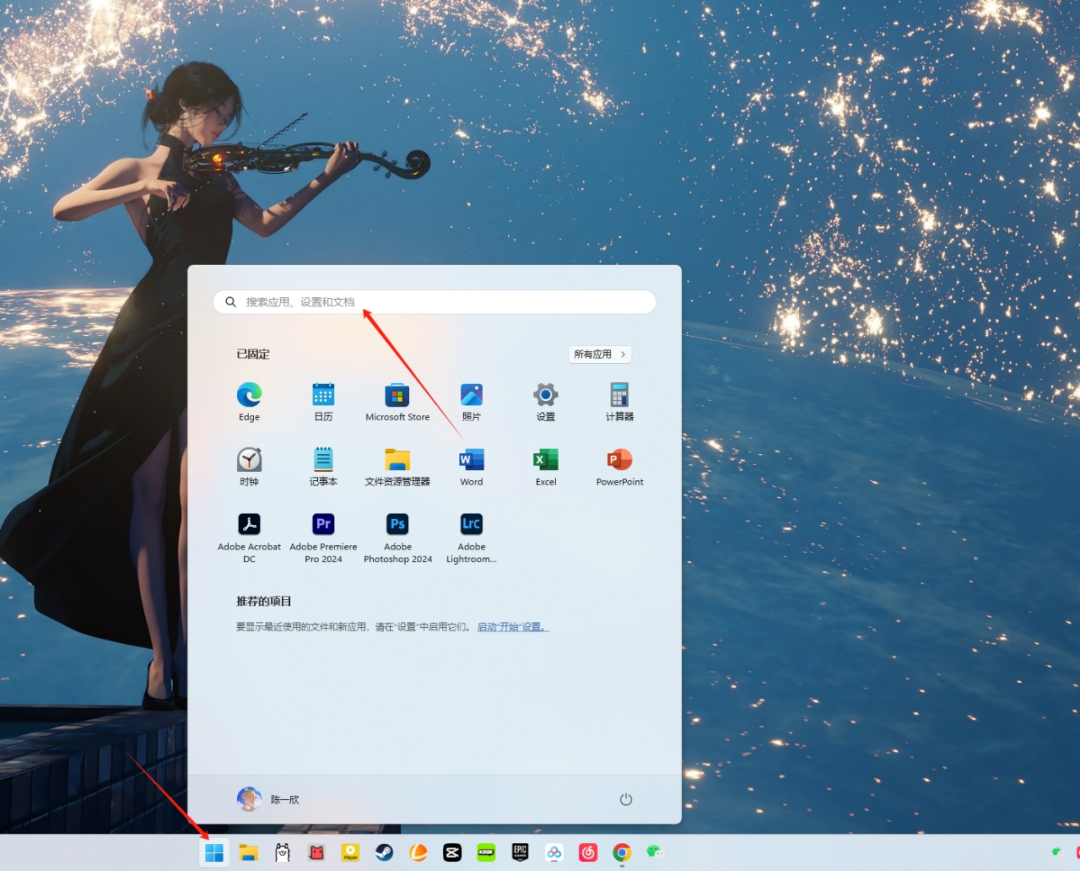

从控制面板编辑系统环境变量。

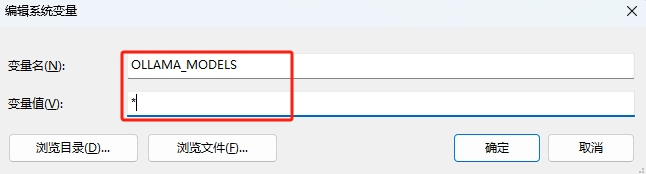

为您的用户账户编辑或新建 Ollama 的环境变量 OLLAMA_ORIGINS,值设为 * 。

点击 OK/应用保存后重启系统。

重新运行 Ollama。

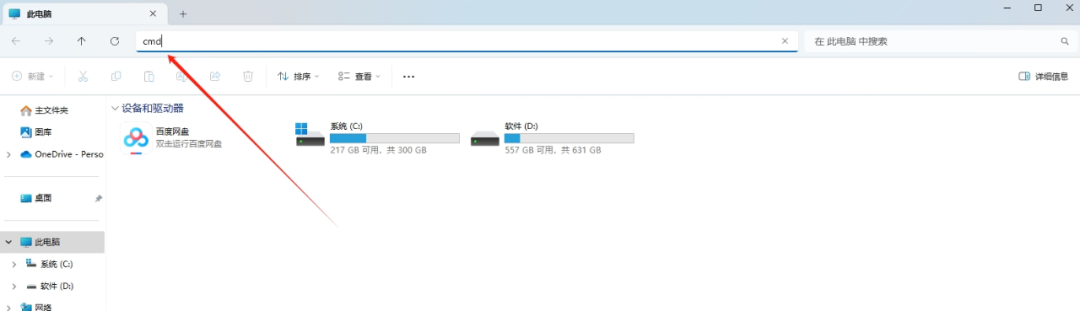

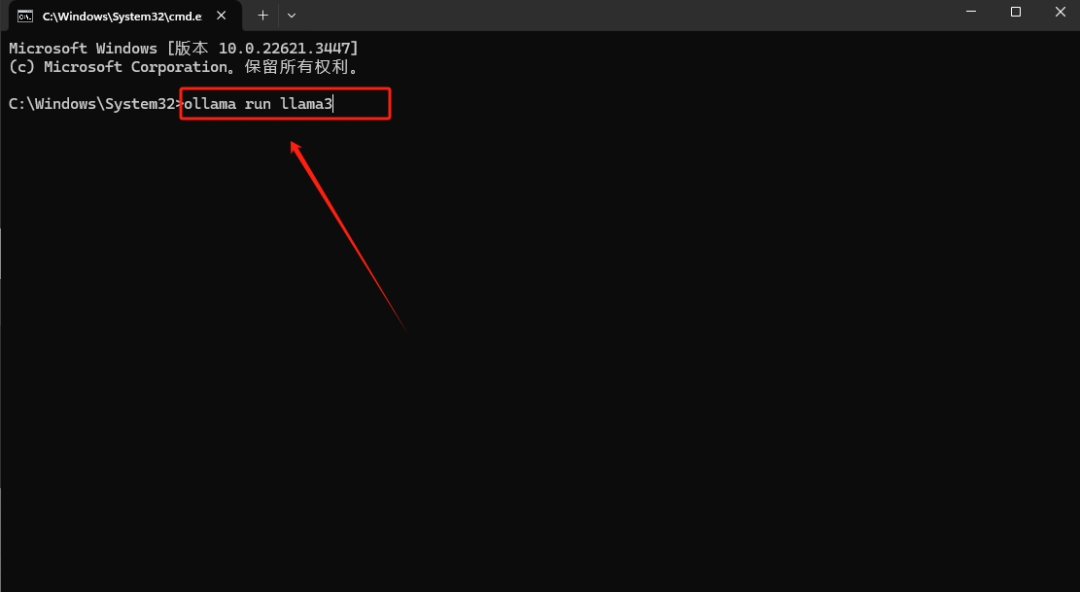

配置好后我们打开我的电脑,并在点击框输入 CMD,回车确定后输入命令:

ollama run llama3

这条命令的作用是检查目录下是否有该模型,没有会自动下载,下载好后自动运行该模型。

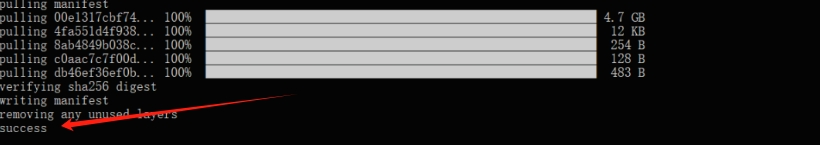

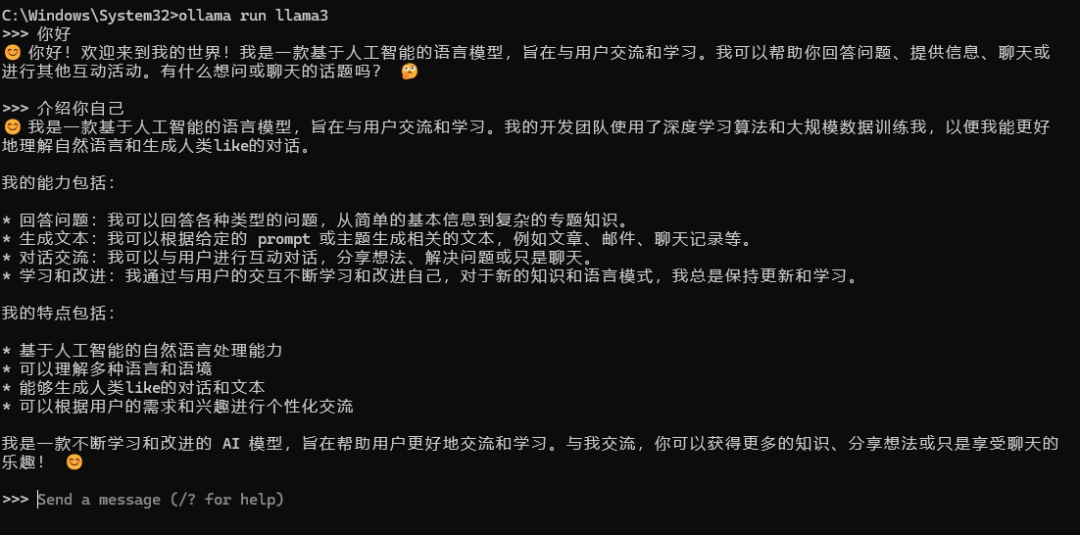

下载完成后我们已经可以开始使用了。

5

利用 Ollama 本地部署 Llama3 中文微调版

Llama3 中文微调版是在原版模型上进行了大量中文数据进行增量预训练,更加适合国人使用。在本教程中使用 ymcui 开发的中文微调版本,相对于其他版本,它拥有非常详细的文档供指引,参考和学习。项目地址:

https://github.com/ymcui/Chinese-LLaMA-Alpaca-3?tab=readme-ov-file

首先,我们输入下面的网址下载模型。

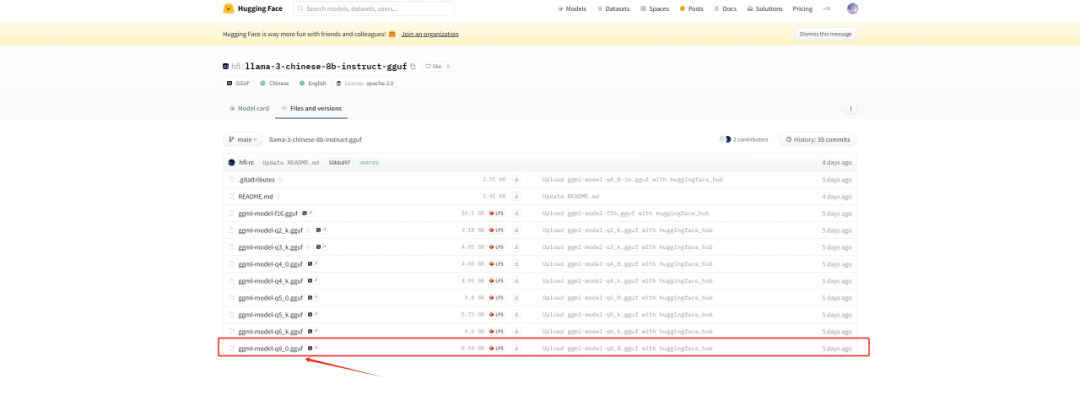

https://huggingface.co/hfl/llama-3-chinese-8b-instruct-gguf/tree/main

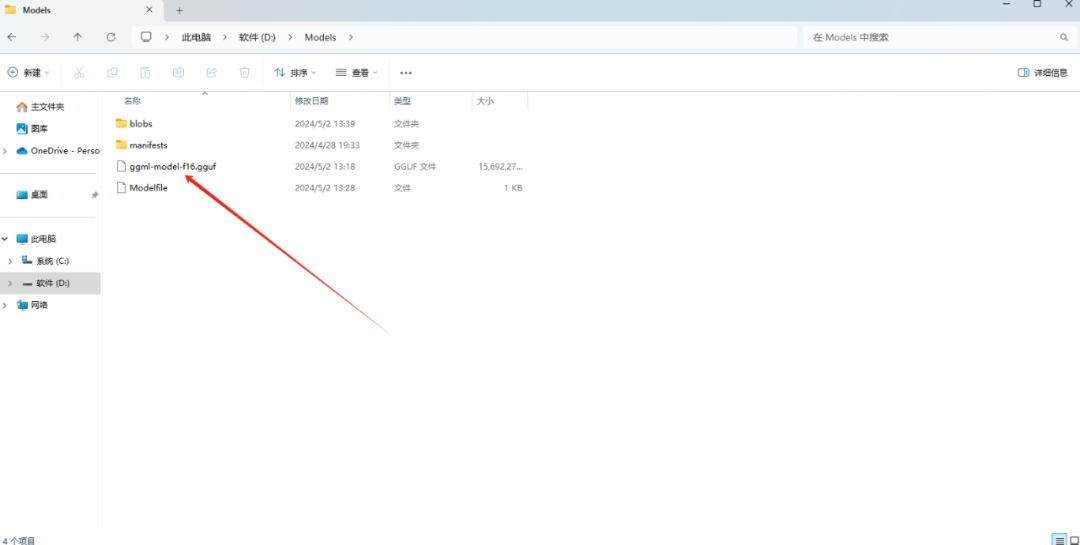

下载好后放入你自己创建的文件夹中,下面做演示(我自己下载的F16版本,请下载q8_0版本,它在大小和模型表现中做到了比较好的平衡。)

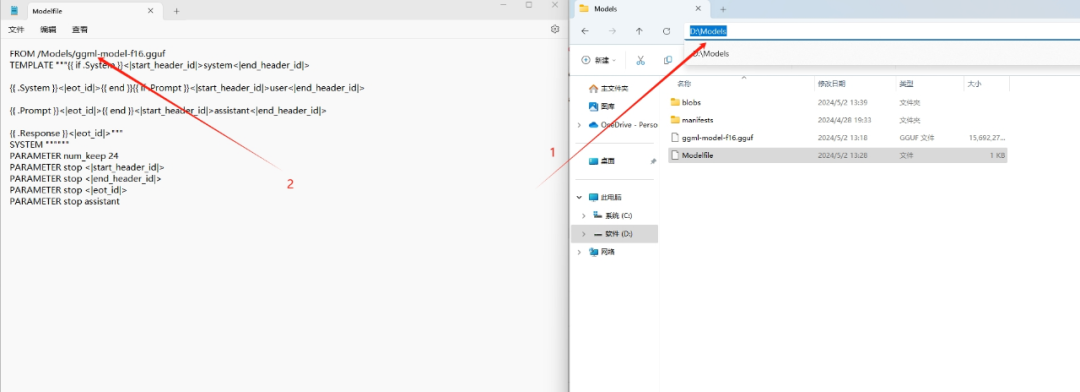

接下来在文本编辑器中编写 Modelfile 文件,其内容如下:

FROM /your-path-to-ggml/ggml-model-q8_0.gguf``TEMPLATE """{{ if .System }}<|start_header_id|>system<|end_header_id|>`` ``{{ .System }}<|eot_id|>{{ end }}{{ if .Prompt }}<|start_header_id|>user<|end_header_id|>`` ``{{ .Prompt }}<|eot_id|>{{ end }}<|start_header_id|>assistant<|end_header_id|>`` ``{{ .Response }}<|eot_id|>"""``SYSTEM """"""``PARAMETER num_keep 24``PARAMETER stop <|start_header_id|>``PARAMETER stop <|end_header_id|>``PARAMETER stop <|eot_id|>``PARAMETER stop assistant``PARAMETER stop Assistant

请注意 FROM 定义 GGUF 文件的路径,比如我的 GGUF 文件放在 Models 文件下,路径就改为

FROM /Models/ggml-model-f16.gguf

如果你没有其他的文本编辑器可以打开记事本复制输入后保存,然后在重命名中删除文件后缀 txt。

命令行中运行以下命令,创建一个名为 llama3-zh-inst(名字可自定义)的模型实例,加载 Modelfile 配置:

ollama create llama3-zh-inst -f Modelfile

创建过程输出日志如;

transferring model data``creating model layer``creating template layer``creating system layer``creating parameters layer``creating config layer``using already created layer sha256:f2a44c6358e8e0a60337f8a1b31f55f457558eeefd4f344272e44b0e73a86a32``using already created layer sha256:8ab4849b038cf0abc5b1c9b8ee1443dca6b93a045c2272180d985126eb40bf6f``writing layer sha256:b821abf159071cfc90f0941b5ca7ef721f229cfcfadcf95b5c58d0ceb3e773c7``writing layer sha256:dc4ec177268acc3382fc6c3a395e577bf13e9e0340dd313a75f62df95c48bc1d``writing manifest``success

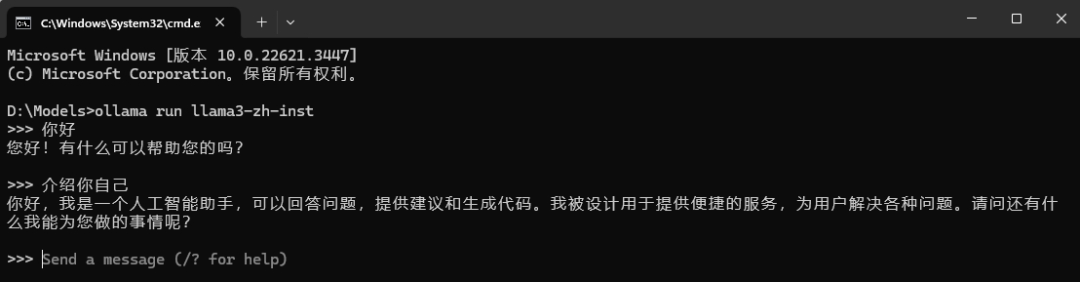

输入以下命令进入聊天程序,已经可以愉快的使用啦。

ollama run llama3-zh-inst

6

在 Lobechat 中使用 Llama3

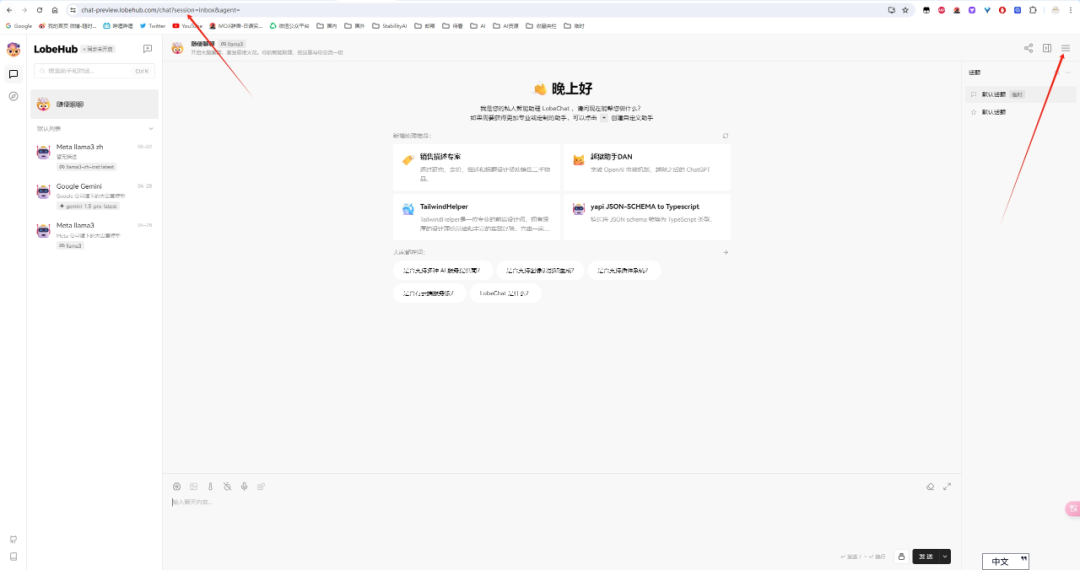

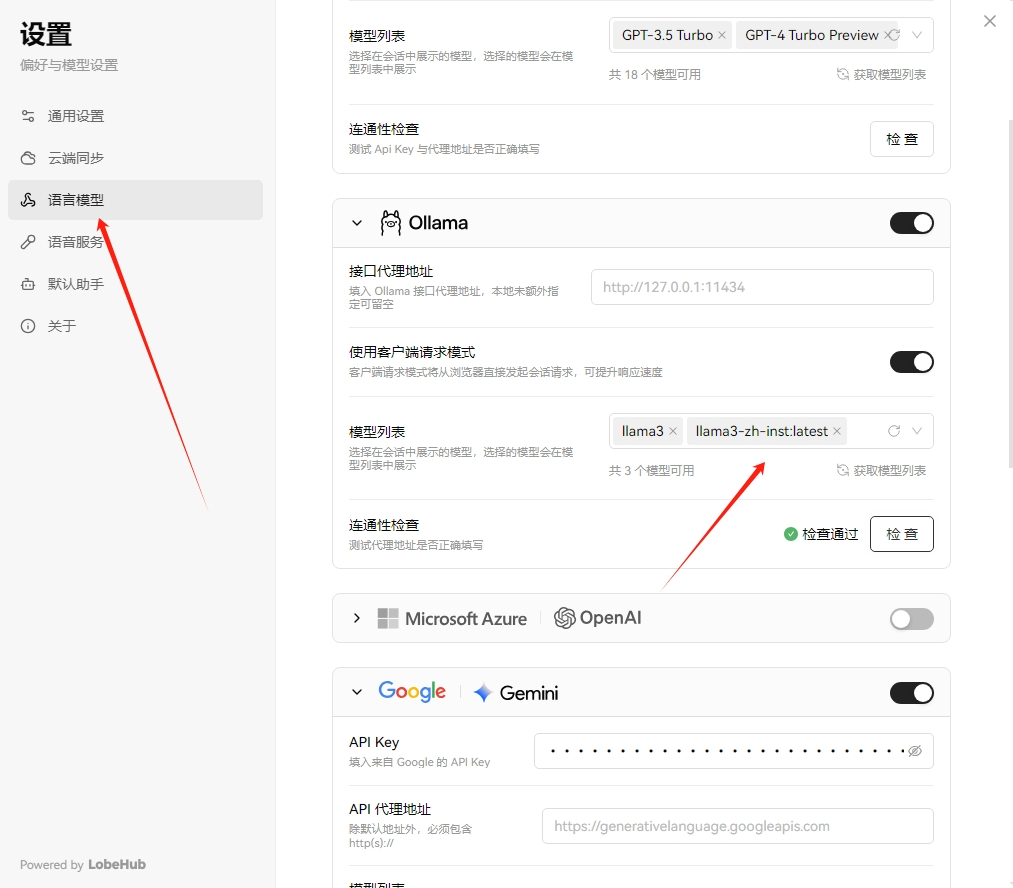

我们运行 Ollama 后, 打开 Lobechat 网站注册,然后打开会话设置。

网址:

https://chat.lobehub.com/welcom

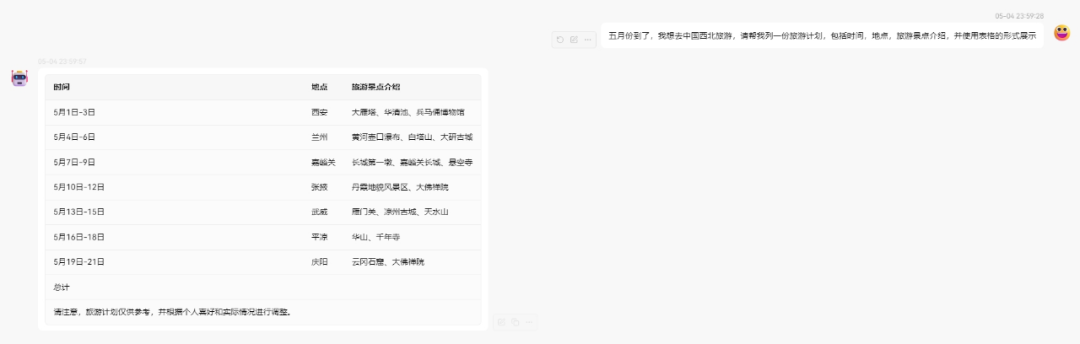

配置好我们的对话机器人后就可以使用了。测试:

零基础如何学习大模型 AI

感谢朋友们看完这篇文章,如果你对大模型感兴趣,可以看看我整合并且整理成了一份AI大模型资料包,需要的小伙伴文末免费领取哦,无偿分享!!!

如果二维码失效,可以点击下方链接,一样的哦

【CSDN大礼包】最新AI大模型资源包,这里全都有!无偿分享!!!

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

4710

4710

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?