点击蓝字

关注我们

AI TIME欢迎每一位AI爱好者的加入!

随机梯度下降(SGD)是训练大规模机器学习模型的常用工具。然而,它的性能非常取决于步长的选择。各种调整步长的策略因此被提出,从自适应步长到复杂的启发式方法,即在每次迭代中改变步长。在本文中,我们研究了两种在实践中表现良好的步长:指数步长和余弦步长。首先,我们理论证明了其在光滑非凸函数的收敛速度,涵盖了符合或不符合Polyak-Łojasiewicz(PL)条件的情况。此外,我们研究发现这两种步长对PL函数随机梯度中的噪声水平具有自适应性的性质。也就是说,即使在不知道噪声水平的情况下,它们也可以达到几乎最优的理论结果。最后,我们在具有深度学习体系结构的数据集上对其进行了全面的实验评估。结果表明,即使至多需要两个超参数,这两种步长的实验表现可以超过或者匹敌多种先进步长策略的性能表现。

本期AI TIME PhD直播间我们邀请到波士顿大学系统工程博士生——李晓宇,为我们带来报告分享《随机梯度下降与指数步长及余弦步长》

李晓宇:

波士顿大学系统工程博士四年级学生,导师是Dr. Francesco Orabona。研究方向主要包括随机优化,机器学习理论。

01

基础理论/背景介绍

凸函数与非凸函数的优化目标

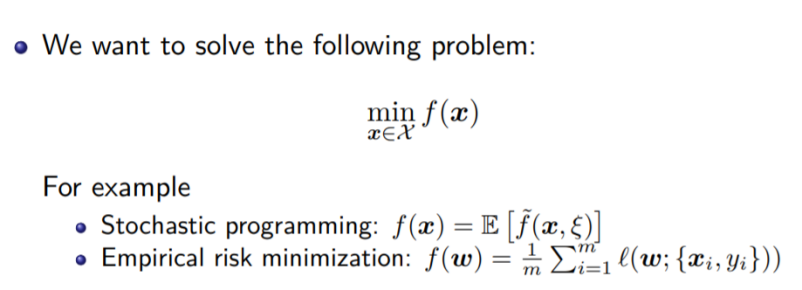

给定函数f,在集合中寻找一个元素,使得函数f取最小值。这里集合X可能是凸集(convex set)或者是非凸集合(non-convex set)。

在凸集上,可以定义凸函数,这里来讲述一下函数的凹凸性的概念。下面分别是凸函数和凹函数的示意图及特点,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

19

19

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?