在科技领域,Neuralink 一直是备受关注的焦点。作为一家致力于脑机接口(BCI)技术研发的公司,Neuralink 的目标是通过创新技术帮助人类与机器进行更直接的互动。在他们最近的 PRIME 研究中,第二位参与者的进展成为了一个重要的里程碑,这标志着神经科学和人工智能的结合在现实生活中的应用迈出了坚实的一步。

Neuralink 的核心理念是通过脑机接口技术,帮助那些因身体残疾而丧失部分行动能力的患者重新获得自主权。脑机接口技术旨在让大脑直接控制电子设备,帮助人们完成日常任务。这项技术不仅仅是为了恢复失去的功能,更是在探索如何增强人类的能力,使人类未来与人工智能和机器更紧密地结合。

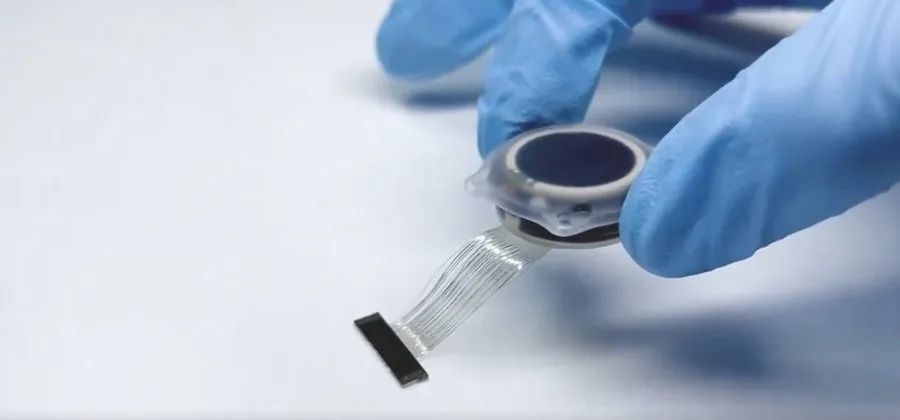

PRIME(Precision Robotics for Implanted Mind Enhancement)研究项目是 Neuralink进行的一个关键性临床试验,旨在测试和优化其脑机接口设备在人体中的应用。PRIME 项目的核心是通过微创手术,将 Neuralink 设备植入患者大脑,从而实现大脑与计算机之间的直接通信。

在最新的进展中,一位名为Alex的参与者,经过精心的手术植入了Neuralink设备。手术由一台精确的机器人完成,确保了设备的安全植入,并最小化了手术风险。

手术后,Alex的恢复过程非常顺利,并在短时间内适应了脑机接口设备的使用。他能够利用大脑直接控制计算机光标,这不仅是一项技术上的突破,更意味着大脑与数字世界的交互变得更加自然和高效。

通过脑机接口设备,Alex展示了其在日常生活中的应用潜力。他不仅可以使用CAD软件进行3D设计,还能够进行游戏操作。这些功能的实现,标志着脑机接口技术从理论研究向实际应用的转变。

Alex在玩反恐精英2

脑机接口技术的潜在应用范围广泛,从帮助瘫痪患者恢复部分活动能力,到增强普通人的认知能力。Neuralink的设备有望在未来成为医疗辅助设备,甚至是增强人类能力的工具。

Neuralink的目标不仅限于帮助残疾患者恢复功能,更在于探索如何通过技术增强人类能力。未来,Neuralink将继续优化其设备的安全性和功能性,同时扩展其应用场景。通过持续的研究和创新,Neuralink有望在未来改变人类与技术的交互方式。

随着脑机接口技术的发展,关于其伦理和社会影响的讨论也在增加。如何确保这项技术的使用不会侵犯个人隐私?如何防止技术被滥用?这些都是Neuralink在推进技术应用时需要考虑的重要问题。

Neuralink致力于确保其技术的开发与应用符合伦理标准,并为社会带来正面影响。他们的目标是通过技术为人类创造一个更加美好的未来,而不是制造新的社会问题。

Neuralink的PRIME研究项目展示了脑机接口技术的巨大潜力。从帮助残疾患者恢复自主权,到探索如何增强人类能力,Neuralink正在引领一场科技革命。这项技术不仅代表了神经科学与人工智能的结合,更预示着人类未来与技术的深度融合。

如果你对Neuralink及其研究项目感兴趣,建议访问Neuralink 官网获取更多信息。

1243

1243

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?