在深度学习时代,神经网络的参数量越来越大,从头开始训练(train from scratch)的成本也越来越大。幸运的是,在计算机视觉、自然语言处理等人工智能应用的主要领域,人们能够采用迁移学习的预训练-微调范式来有效降低训练成本。

迁移学习使得深度神经网络以预训练模型的形式走进千家万户,不用上千块TPU,我们也能够使用BERT、EfficientNet等大型模型。

如今,对于深度学习框架来说,丰富的预训练模型库已经是标配了(例如TensorFlow Hub, Torchvision Models)。在一些研究领域(比如2020年非常热门的自监督学习),研究成果最终也是以预训练模型的方式呈现给社区。在深度学习社区里,一些热门领域已经积累了成百上千个预训练模型。

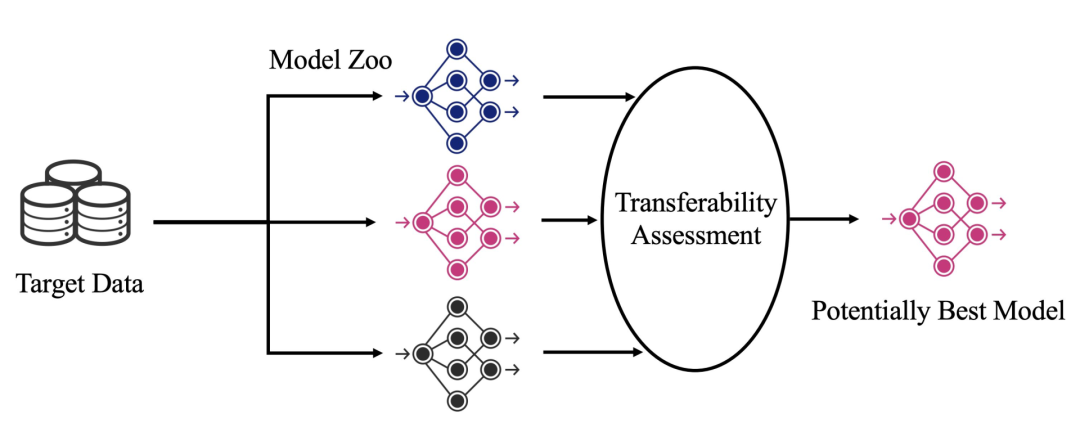

面对众多预训练模型,我们在进行迁移时,该用哪一个好呢?这个重要问题很少有人研究,因此人们目前只好使用一些简单粗暴的办法:

使用常见的预训练模型(例如ResNet50);

使用预训练指标(例如ImageNet准确率)高的模型。

如果想要准确地选择最好的预训练模型,我们需要把每一个候选模型都做一遍微调。因为微调涉及到模型训练,时间至少几个小时起步。有些预训练模型的微调还需要进行超参数搜索,想要决定一个预训练模型的迁移效果就需要将近50个小时!

针对这一问题,清华大学研究人员提出了一种名为LogME的方法。它能极大地加速预训练模型选择的过程,将衡量单个预训练模型的时间从50个小时减少到一分钟,疯狂提速三千倍!

智源社区特邀请论文《LogME: Practical Assessment of Pre-trained Models for Transfer Learning》一作清华大学软件学院在读博士生游凯超就其研究过程及内容做报告分享,欢迎大家参与交流讨论。

报告主题: LogME:一种通用快速准确的预训练模型评估方法

报告时间:2021年3月10日(周三)晚上7:00~8:00

报告形式:线上直播(智源社区Hub,https://hub.baai.ac.cn/activity/details/136)

讲者简介:游凯超,清华大学软件学院机器学习组在读博士,师从龙明盛副教授。他的研究兴趣包括迁移学习、机器学习、人工智能等方向。曾获清华大学特等奖学金、北京市优秀毕业生等荣誉称号。

个人主页: https://youkaichao.github.io/

报告简介:

在深度学习时代,神经网络的参数量越来越大,从头开始训练(train from scratch)的成本也越来越大。虽然人们能够采用迁移学习的预训练-微调范式来有效降低训练成本,但是在面对预训练模型库中成百上千的预训练模型时,人们却还没有行之有效的办法来选择合适的预训练模型。如果想要准确地选择最好的预训练模型,决定一个预训练模型的迁移效果就需要将近50个小时!

本次报告,我将介绍我们最近在预训练模型选择方面的研究成果——名为LogME的预训练模型选择指标。它能极大地加速预训练模型选择的过程,将衡量单个预训练模型的时间从50个小时减少到一分钟,带来三千倍加速。

论文链接:arxiv.org/abs/2102.11005

论文中文介绍:https://mp.weixin.qq.com/s/9lJEcwkXAN4jaENNghjpyw

报名方式

观看方式

通道:智源社区Hub直播(报名后会收到活动观看提醒)

https://hub.baai.ac.cn/activity/details/136

点击阅读原文直达直播页

加入参会群

识别下方二维码入群,本次主讲人将会在群内进行答疑。

* 进群需修改备注为:姓名+学校/公司+研究方向/职位

特别福利

游凯超及多位智源社区小伙伴们一起整理了数十个预训练模型集合链接,基本覆盖当下CV、NLP、多模态等各领域的常见模型。你可以尝试使用本文所提方法进行试验,看看哪个模型更适合你的任务。

* 进群即可领取主讲人推荐的“预训练模型的迁移”主题相关论文包。

* 分享本文到朋友圈超过2小时,加源源子(微信号:baai2020)微信发送截图,即可获取预训练资料包,里面包含了一些已经预训练好的模型、可直接下载的代码资源,还有一些教程。

78

78

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?