在 8 月 20 日的智源社区青源 LIVE 活动中,来自字节跳动 AI Lab 的许晶晶博士对其团队在 ACL 2021 上摘得最佳论文奖的论文《Vocabulary Learning via Optimal Transport for Neural Machine Translation》进行了解读。在机器翻译任务中,词表的选择影响模型最终的性能。许晶晶博士从信息论的角度入手,提出了一种基于最优运输理论的词表搜索方法。

论文地址:https://arxiv.org/pdf/2012.15671.pdf

代码地址:https://github.com/Jingjing-NLP/VOLT

视频地址:https://hub.baai.ac.cn/live/?room_id=160

主讲人简介

许晶晶,字节跳动公司AI Lab部门研究员。主要研究方向为自然语言处理和机器学习。已在国内外知名学术会议发表多篇论文,曾担任ACL 2021领域主席以及多项顶会审稿人。现致力于探索轻量级深度学习。

讲者:许晶晶

整理:熊宇轩

校对:李梦佳

词表在命名实体识别、语义分析、翻译、摘要生成、对话等任务中广为使用。在理解性任务中,我们需要将离散的输入单词表征为连续的向量,此时词表起到了「查找表」的作用。在一些生成任务中,生成式模型的输出是词表的分布,需要进一步将其映射为离散的字符输出。

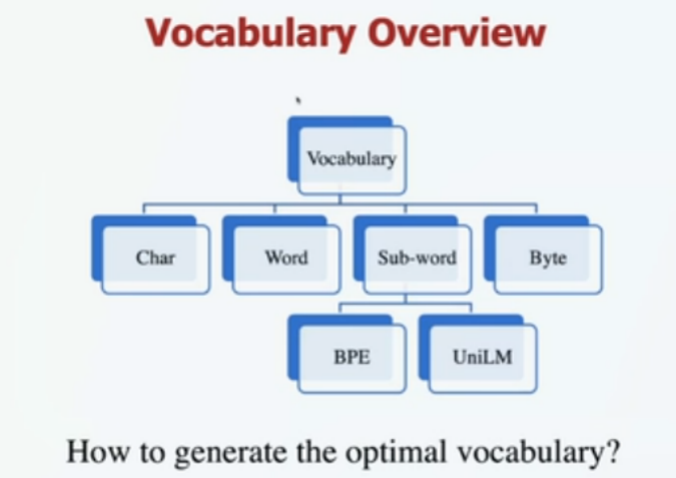

图 1:词表的类型

目前,研究人员已经提出了一系列基于字符(char)、词(word)、子词(sub-word)的词表,以及与具体语言无关的基于字节(UTF-8)的词表。其中,现有阶段最广为使用的是基于子词的词表(例如BPE )。大多数现有的词表是由专家根据自己的知识总结的生成方案得到的。那么这些词表是最优的吗?给定一个数据集,我们应该如何得到对于自然语言处理任务最优的词表?

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8

8

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?