导语:看到一道菜的成色,就能得知食材原料和烹饪方法?

在近期的AI TIME 青年科学家——AI 2000 学者专场论坛系列报告中,来自复旦大学计算机科学学院的助理教授陈静静博士带来了题为「跨模态菜谱检索」的演讲,从「基于识别的菜谱检索」、「基于跨模态学习的菜谱检索」、「跨域食物迁移」等方面介绍了跨模态菜谱检索任务几年来的前沿研究工作,讨论了该领域未来的研究方向。(回放:https://event.baai.ac.cn/activities/346)

陈静静,复旦大学计算机科学技术学院青年副研究员、上海高层次海外人才、浦江人才计划入选者、ACM China上海新星奖获奖者,累计发表学术论文 30 余篇,曾获ACM Multimedia 2016最佳学生论文奖、Multimedia Modeling 2017 最佳学生论文奖,担任多个国际知名期刊审稿人,以及国际会议领域主席/程序委员会委员。

整理:熊宇轩

编辑:李梦佳

01

定义与挑战

在「跨模态菜谱检索」任务中,给定一张菜品的图像作为模型的输入查询,模型需要检索出制作该菜品相应的菜谱,我们可以将该过程建模为「视觉-文本」的翻译。这项技术可以帮助我们进一步完成实物识别、营养成分估计、菜谱推荐等下游任务。

从技术角度来说,「跨模态菜谱检索」任务要求我们首先识别菜品,再将输入图像与菜谱文本关联起来,并且针对结构化的菜谱文本学习高质量表征。因此,该任务涉及到图像识别与理解、跨模态学习、菜谱文本建模等研究领域。

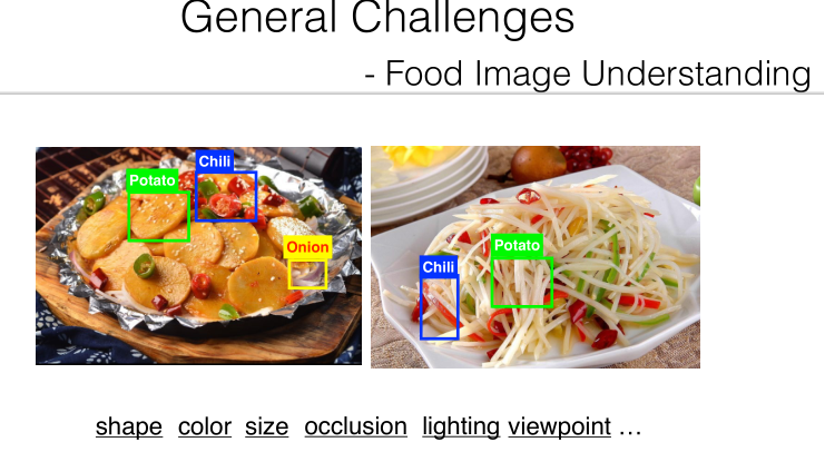

挑战——食物图像理解

与普通的自然图像相比,实物图像的理解面临着一些独特的挑战。颜色、光照、食材成分、切菜方法等因素都会导致菜品外观存在差异,影响模型对食物的识别效果。

具体到食材成分识别环节,切菜(切片、切丝、切丁等)的方式会导致同一种食材的形状存在较大差异。值得一提的是,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5

5

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?