导读

随着ChatGPT出现,语言大模型的进步与对话交互方式相结合,正在搅动科研、产业,以及普通人的想象力。我们对智能的探索是正在步入决胜之局,还是仍在中场酣战;是需要精巧完备的一致系统,还是可以遵循实效至上Worse is Better的设计哲学?打造面向未来的LLM与Chatbot,技术人员面对哪些共同阻碍,有哪些极限有待超越,如何协作共赢?

在青源Workshop(第20期)|LLM and Chatbot: Endgame, Worse is Better, How to Win Big 研讨会上,智源社区与青源会邀请十余位相关领域专家,围绕以上话题展开热烈研讨。

引导报告环节,袁进辉提出:

ChatGPT 开启了全新维度的竞争。无论是科研单位还是企业,有 ChatGPT 类工具的加持将对不具备此类工具的竞争者形成「降维打击」;

实现 ChatGPT 需要解决数据、算力、工程架构和算法模型细节四大难题;

对 ChatGPT 的开源不仅是一个技术问题,更是一个机制问题,开源 ChatGPT 的成功可能成为国内开源深度学习框架、基础架构、AI 芯片生态成功的「秘密武器」。

邱锡鹏提出:

GPT 的知识边界仍然只是人类知识的一小部分。

以2022全国高考客观卷为例测试性能,ChatGPT 在文综等具有大量公开信息的科目上取得了 78% 的得分率,而在数学、物理、化学、历史等科目上表现欠佳。

车万翔提出:

ChatGPT的诞生,源于研究者「暴力美学」的手段。

如果大胆预测,ChatGPT能火几年,我猜可能是2到3年的时间,到2025年大概又要更新换代了。

工业界相较于学术界拥有巨大优势。这种「AI 的马太效应」会造成胜者通吃的局面。更加危急的是,任务、甚至研究领域之间的壁垒被打破了,所有的问题都可以转化为一个「Seq2Seq」问题,计算机视觉等领域的研究者也会逐渐涌入该领域。

与搜索引擎时代类似,如果将 OpenAI 比作当年的 Google,国内也一定会出现 ChatGPT 时代的「百度」。在这之前,许多机构和企业都有机会放手一搏,做出自己的大模型。相较于其它领域的研究者,NLPer 的真正优势可能在于更加了解语言。

符尧提出:

大规模语言模型的构建可以分为「预训练」、「指令微调」、「对齐」、「专门化」(Specialization)四步。

「涌现能力」曲线所示,只有当模型的大小增大到一定程度时,模型的能力(如举一反三、跨域迁移等能力)才会产生跳变。因此,只有大模型才能有效提升这些效果。

参会嘉宾名单

扫描下方二维码填写表单,获取更多相关岗位机会

一流科技袁进辉:

一起做一个完全开源的 ChatGPT?

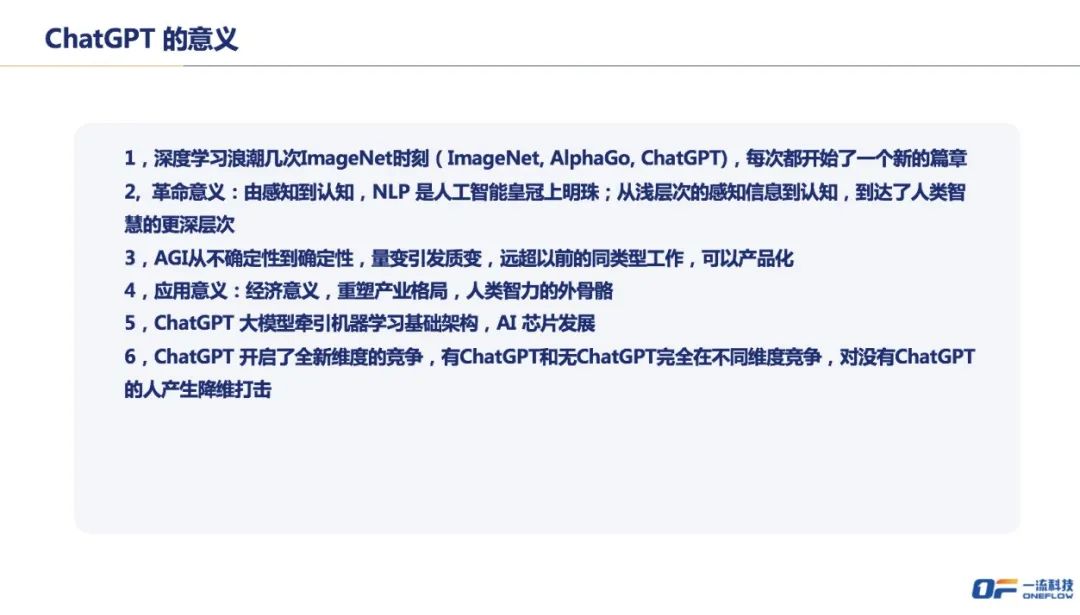

袁进辉提出,与 ImageNet、AlphaGo 、Stable Diffusion 类似,ChatGPT 也是一次我们正在经历的重大技术革新。ChatGPT 的出现具有重大的经济意义和商业价值,有望重塑产业格局、引领机器学习基础架构和 AI 芯片的发展走向。从产业的角度,ChatGPT 开启了全新维度的竞争。无论是科研单位还是企业,有 ChatGPT 类工具的加持将对不具备此类工具的竞争者形成「降维打击」。

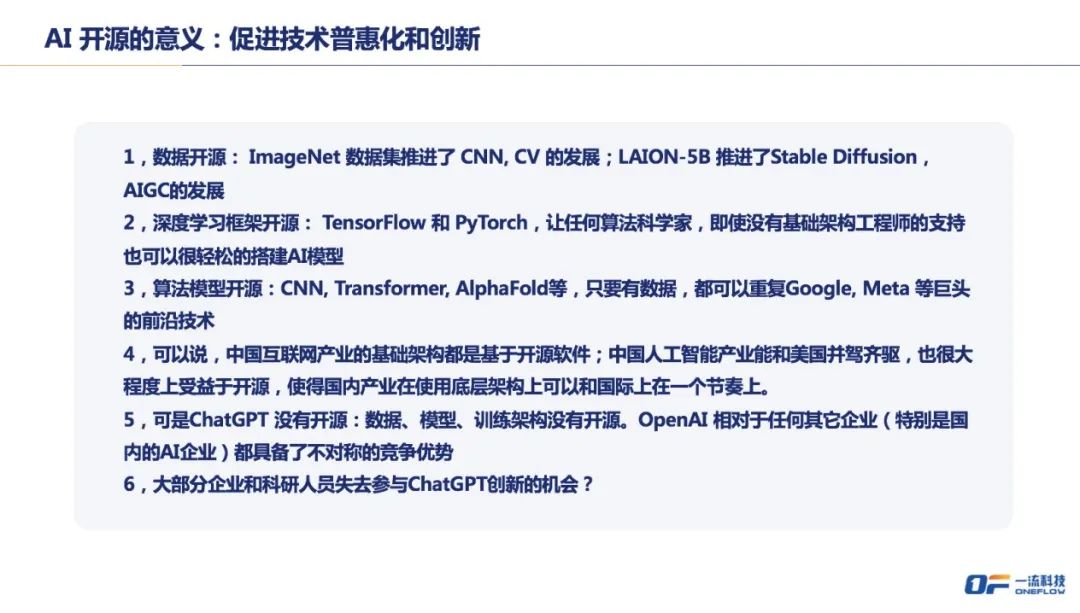

近十年来,开源运动对 AI 技术的发展起到了非常重大的作用。从数据角度看,ImageNet 数据集推进了计算机视觉的发展,LAION-5B 推动了 AIGC 的发展;从深度学习框架角度看,TensorFlow、PyTorch 成为了几乎所有深度学习模型的开发基础;从算法模型的角度看,CNN、Transformer、AlphaFold 等模型的开源促进了它们在各个行业的落地,科学家、工程师们可以在此基础上进行进一步的开发。实际上,中国互联网产业之所以能够迅速追赶上世界最先进的水平,在很大程度上得益于这些开源基础软件。

目前,ChatGPT 仍然没有开源,开源其代码的意义可能也不大。ChatGPT 是一个系统的工程,使用的数据、模型、训练架构并没有开源。在 ChatGPT 的帮助下,OpenAI 相较于其它企业具备了不对称的竞争优

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8

8

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?