1. 关于Softmax

机器学习中有一个经典的方法:逻辑回归(Logistic Regression)。它属于一种有监督学习(Supervised Learning)方法。 逻辑回归输出的范围为0-1的值,表示概率,并依据概率的大小将样本归类,其中包括二分类问题与多分类问题。二分类逻辑回归模型输出一个值,该值用于表示样本属于其中一类的概率,多分类逻辑回归模型的输出结果为所有类别的概率分布。

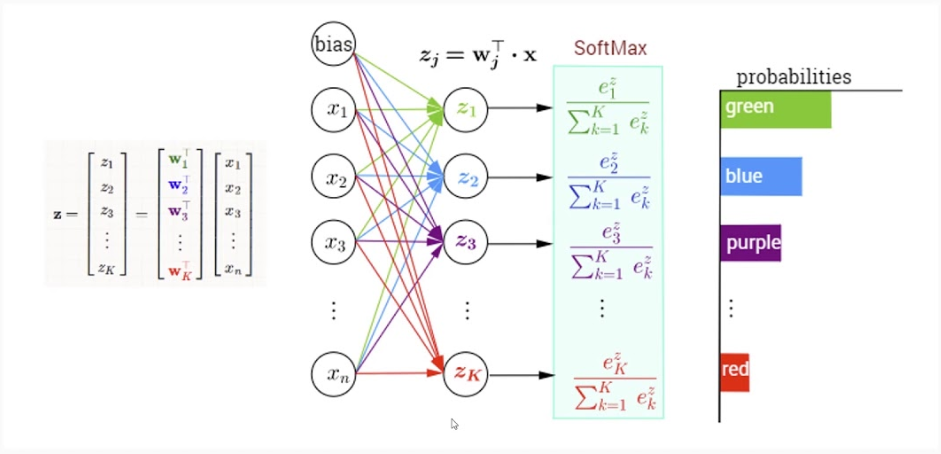

在多分类深度神经网络中,在输出层加上Softmax,使得输出结果为0~1的向量,合为1,表示一种概率分布。此时概率最大的项作为分类预测的类别。Softmax便是沿用了逻辑回归的方法。

详细内容可参考:二分类逻辑回归与多分类逻辑回归的公式推导。

2. 交叉熵

交叉熵(Cross Entropy) 本质上是用来衡量两个概率分布的相似性:

“… the cross entropy is the average number of bits needed to encode data coming from a source with distribution p when we use model q …”

— Page 57,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1096

1096

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?