五、语音模型

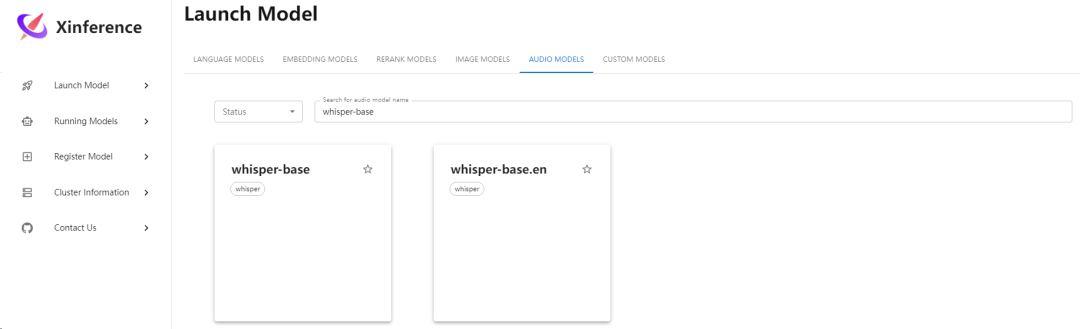

1)部署

语音模型是指用于处理和分析语音数据的机器学习或深度学习模型。这些模型旨在理解语音信号,执行各种任务,如语音识别、语音合成、说话人识别等。

使用 Xinference 将音频转换为文本或将文本转换为音频。

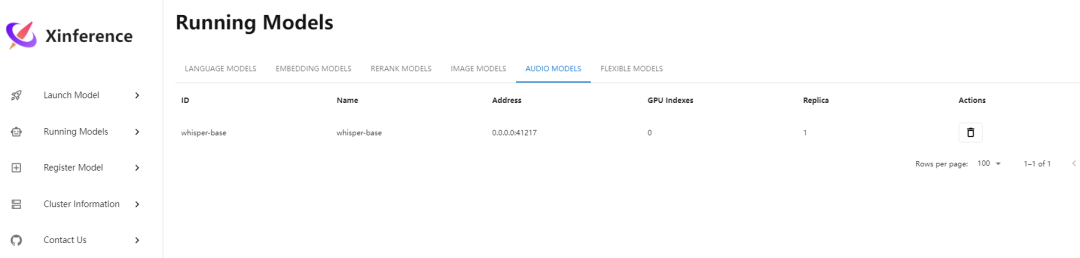

部署完成,查看运行的模型

部署完成,查看运行的模型

2)使用API

Audio API提供了三种与音频交互的方法:

| API端点 | OpenAI兼容端点 | 描述 |

|---|---|---|

| Transcription API | /v1/audio/transcriptions | 转录终端将音频转录为输入语言 |

| Translation API | /v1/audio/translations | 翻译端点将音频转换为英文 |

| Speech API | /v1/audio/speech | 转录终端将音频转录为输入语言 |

可以通过 cURL、OpenAI Client 或者 Xinference 的 Python 客户端来尝试 Transcription API:

1.转录

curl -X 'POST' \

'http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1/audio/transcriptions' \

-H 'accept: application/json' \

-H 'Content-Type: application/json' \

-d '{

"model": "<MODEL_UID>",

"file": "<audio bytes>",

}'

import openai

client = openai.Client(

api_key="cannot be empty",

base_url="http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1"

)

with open("speech.mp3", "rb") as audio_file:

client.audio.transcriptions.create(

model=<MODEL_UID>,

file=audio_file,

)

from xinference.client import Client

client = Client("http://<XINFERENCE_HOST>:<XINFERENCE_PORT>")

model = client.get_model("<MODEL_UID>")

with open("speech.mp3", "rb") as audio_file:

model.transcriptions(audio=audio_file.read())

2.翻译

curl -X 'POST' \

'http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1/audio/translations' \

-H 'accept: application/json' \

-H 'Content-Type: application/json' \

-d '{

"model": "<MODEL_UID>",

"file": "<audio bytes>",

}'

import openai

client = openai.Client(

api_key="cannot be empty",

base_url="http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1"

)

with open("speech.mp3", "rb") as audio_file:

client.audio.translations.create(

model=<MODEL_UID>,

file=audio_file,

)

from xinference.client import Client

client = Client("http://<XINFERENCE_HOST>:<XINFERENCE_PORT>")

model = client.get_model("<MODEL_UID>")

with open("speech.mp3", "rb") as audio_file:

model.translations(audio=audio_file.read())

3.语音

curl -X 'POST' \

'http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1/audio/speech' \

-H 'accept: application/json' \

-H 'Content-Type: application/json' \

-d '{

"model": "<MODEL_UID>",

"text": "<The text to generate audio for>",

"voice": "echo",

"stream": True,

}'

import openai

client = openai.Client(

api_key="cannot be empty",

base_url="http://<XINFERENCE_HOST>:<XINFERENCE_PORT>/v1"

)

client.audio.speech.create(

model=<MODEL_UID>,

input=<The text to generate audio for>,

voice="echo",

)

from xinference.client import Client

client = Client("http://<XINFERENCE_HOST>:<XINFERENCE_PORT>")

model = client.get_model("<MODEL_UID>")

model.speech(

input=<The text to generate audio for>,

voice="echo",

stream: True,

)

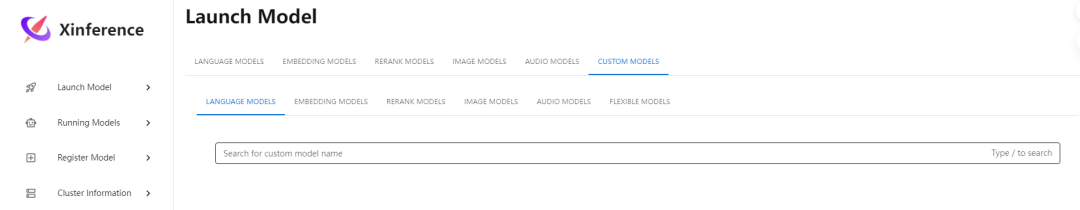

六、自定义模型

Xinference 提供了一种灵活而全面的方式来集成、管理和应用自定义模型。

五、异常

1、异常1

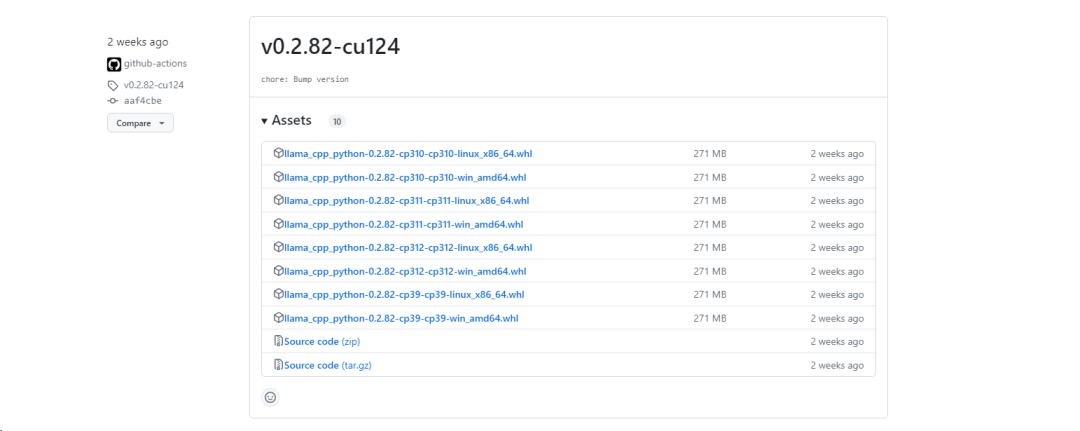

在执行过程中,出现安装llama-cpp-python时,出现以下问题:

Building wheels for collected packages: llama-cpp-python

Building wheel for llama-cpp-python (pyproject.toml) ... error

error: subprocess-exited-with-error

× Building wheel for llama-cpp-python (pyproject.toml) did not run successfully.

│ exit code: 1

╰─> [76 lines of output]

*** scikit-build-core 0.9.8 using CMake 3.22.1 (wheel)

*** Configuring CMake...

loading initial cache file /tmp/tmp0pe3_qsj/build/CMakeInit.txt

-- The C compiler identification is GNU 11.4.0

-- The CXX compiler identification is GNU 11.4.0

-- Detecting C compiler ABI info

-- Detecting C compiler ABI info - done

-- Check for working C compiler: /usr/bin/gcc - skipped

*** CMake build failed

[end of output]

note: This error originates from a subprocess, and is likely not a problem with pip.

ERROR: Failed building wheel for llama-cpp-python

Failed to build llama-cpp-python

ERROR: Could not build wheels for llama-cpp-python, which is required to install pyproject.toml-based projects

访问:llama-cpp-python项目

目前llama-cpp-python最新版本v0.2.82-cu123,根据系统版本、python版本选择下载

wget https://github.com/abetlen/llama-cpp-python/releases/download/v0.2.82-cu124/llama_cpp_python-0.2.82-cp310-cp310-linux_x86_64.whl

执行以下命令安装

pip install llama_cpp_python-0.2.82-cp310-cp310-linux_x86_64.whl

2、异常2

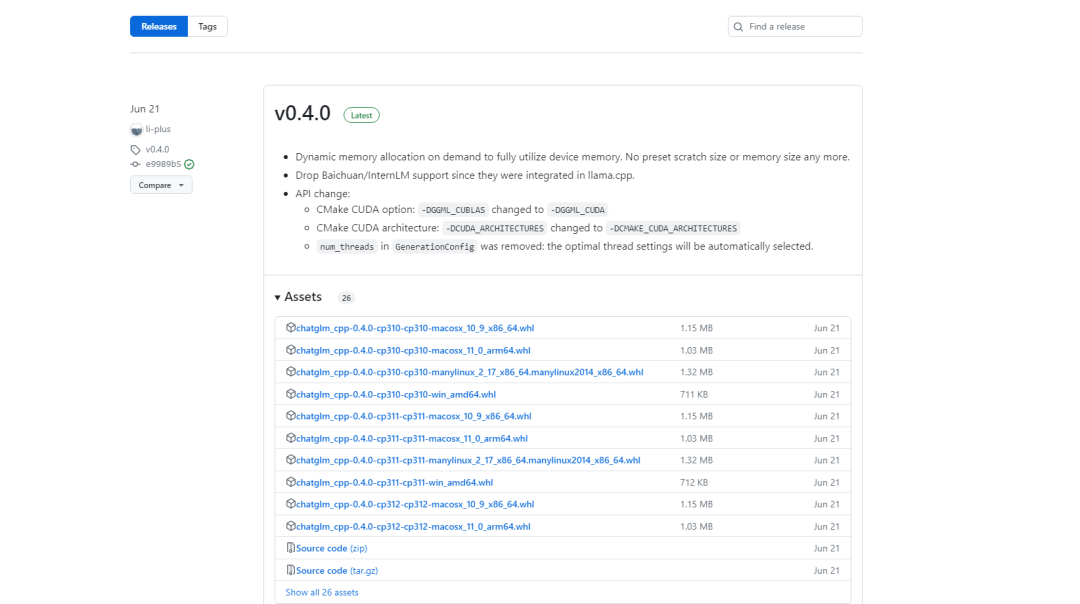

在执行过程中,如果出现安装chatglm.cpp相关异常,执行如下操作解决。

访问:chatglm.cpp项目

目前 chatglm.cpp最新版本v0.4.0,根据系统版本、python版本选择下载

wget https://github.com/li-plus/chatglm.cpp/releases/download/v0.4.0/chatglm_cpp-0.4.0-cp310-cp310-manylinux_2_17_x86_64.manylinux2014_x86_64.whl

执行以下命令安装

pip install chatglm_cpp-0.4.0-cp310-cp310-manylinux_2_17_x86_64.manylinux2014_x86_64.whl

3、异常3

在LLM模型对话界面出现异常提示:

Error

[address=0.0.0.0:34387, pid=354238] GenerationMixin._get_logits_warper() missing 1 required positional argument: 'device'

后台运行异常提示:

Exception: [address=0.0.0.0:34387, pid=354238] GenerationMixin._get_logits_warper() missing 1 required positional argument: 'device'

参阅GitHub项目的issues,对transformers进行降级

(xinference) root@master:~# pip list | grep transformers

sentence-transformers 3.0.1

transformers 4.42.4

transformers-stream-generator 0.0.5

(xinference) root@master:~# pip install 'transformers==4.41.2'

注意:应该是目前Xinference版本原因,后台任然会有异常输出,但是界面LLM对话是正常的。预计未来版本会更新处理。

如何学习大模型?

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

5. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方CSDN官方认证二维码,免费领取【

保证100%免费】

如有侵权,请联系删除

3496

3496

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?