神经网络中的参数,包括权重、偏置等等,tensorflow是如何保存使用这些参数的呢?事实上在tensorflow中,用变量tf.Variable保存和使用这些参数,和其他语言类似,tensorflow中的变量在使用时也需要指定初始值,一般使用随机数给tensorflow中的变量初始化。

Weights = tf.Variable(tf.random_normal([2,3],stddev=2))通常在c语言中,我们定义一个变量时会用到如下函数:

int a = 2 #定义一个整形变量a,并初始化a的值为2而在python中呢:

a = 2不需要做任何类型声明,这也是python的优势所在。

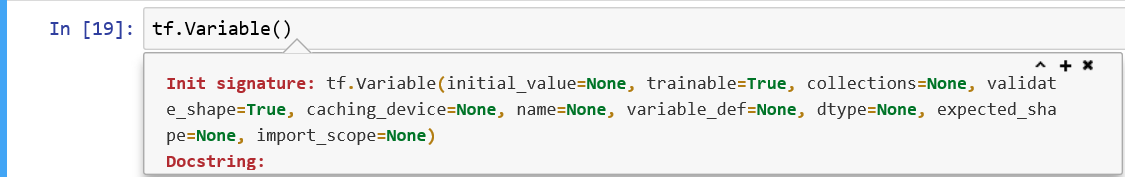

而我们上面在tensorflow中定义的weights变量呢,用到tf.Variable变量声明函数:下面是在python交互式环境jupyter的编译器下,官方给出的变量声明函数的用法:

可以看到:括号内第一个参数赋初始值之外,还需要指定大量其他参数,我们暂且不讨论,在这赋初始值我们用到了tf.random_normal()函数,同样,给出这个函数的用法:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

303

303

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?