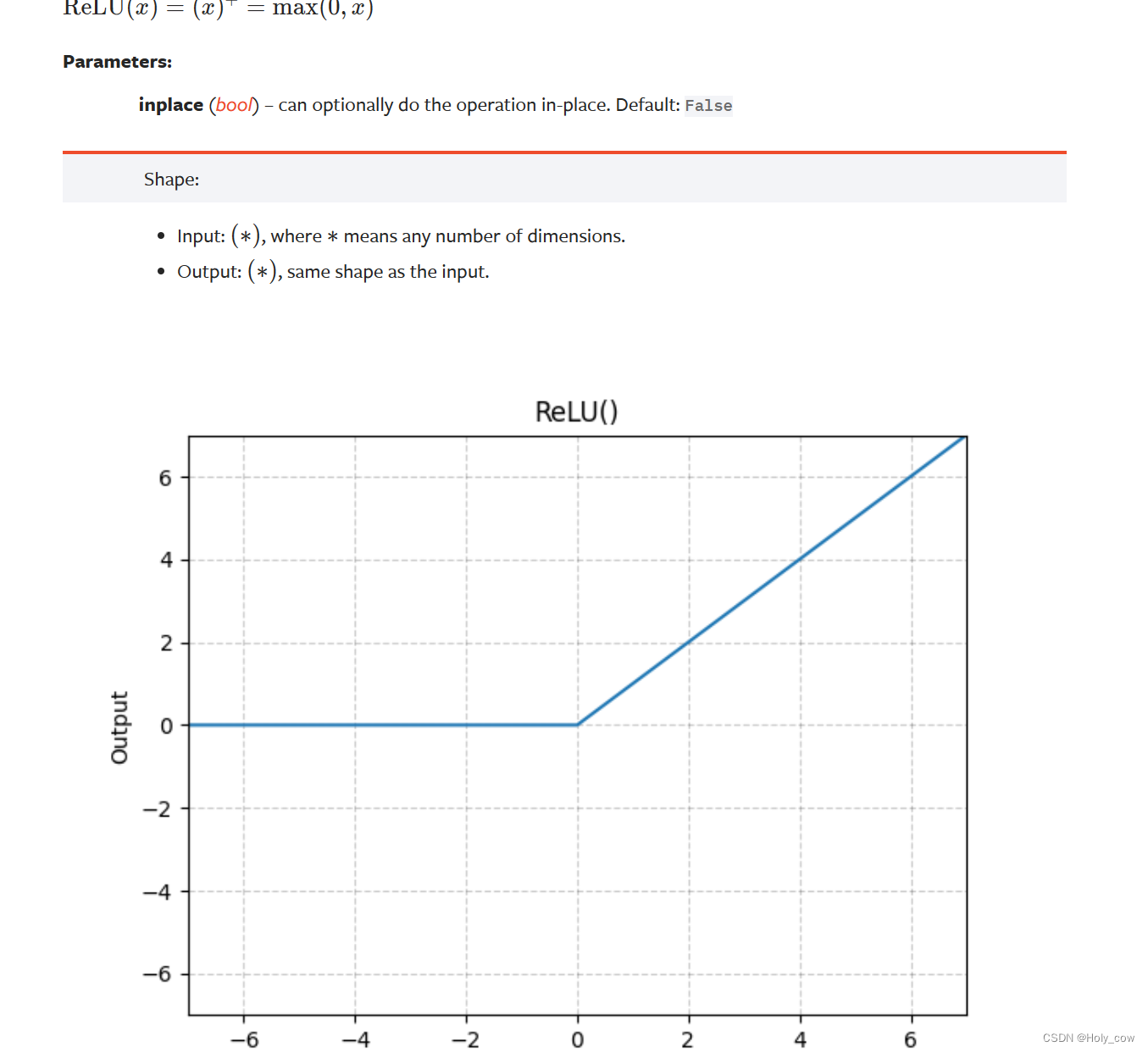

一、RELU激活函数的使用

可以打开Pytorch官网查看Relu激活函数

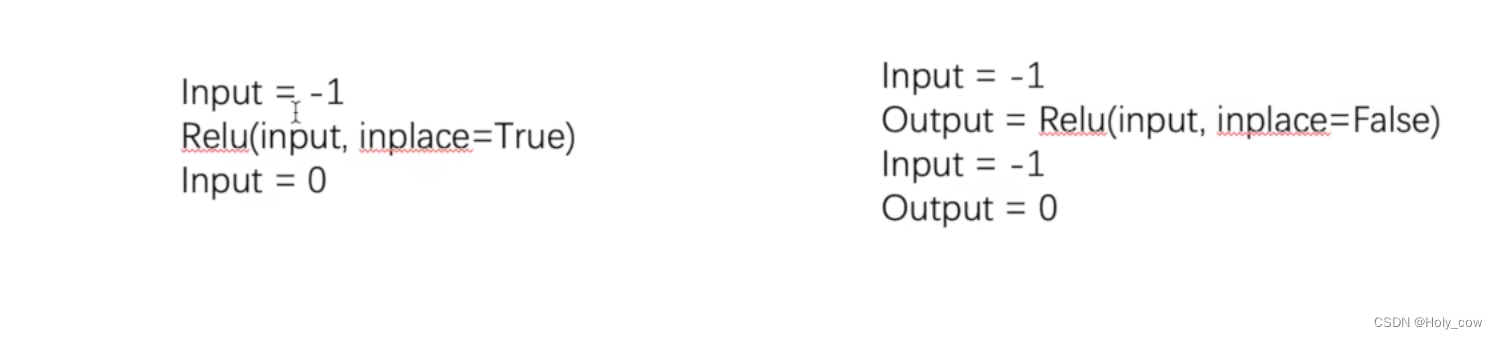

其中,有一个关于implace参数的使用:

implace的值为True时,会修改原来的输入值,为False时,不会修改原来的输入值,而是返回一个输出值。

运行如下代码,查看relu函数的作用:

import torch

from torch import nn

from torch.nn import ReLU

input = torch.tensor([[1, -0.5],

[-1, 3]])

input = torch.reshape(input, (-1, 1, 2, 2))

print(input.shape)

class Cow(nn.Module):

def __init__(self):

super(Cow, self).__init__()

self.relu1 = ReLU()

def forward(self, input):

output = self.relu1(input)

return output

cow = Cow()

output = cow(input)

print(output)

运行结果如下:

torch.Size([1, 1, 2, 2])

tensor([[[[1., 0.],

[0., 3.]]]])

大于0的数输出原值,小于0的数输出0。

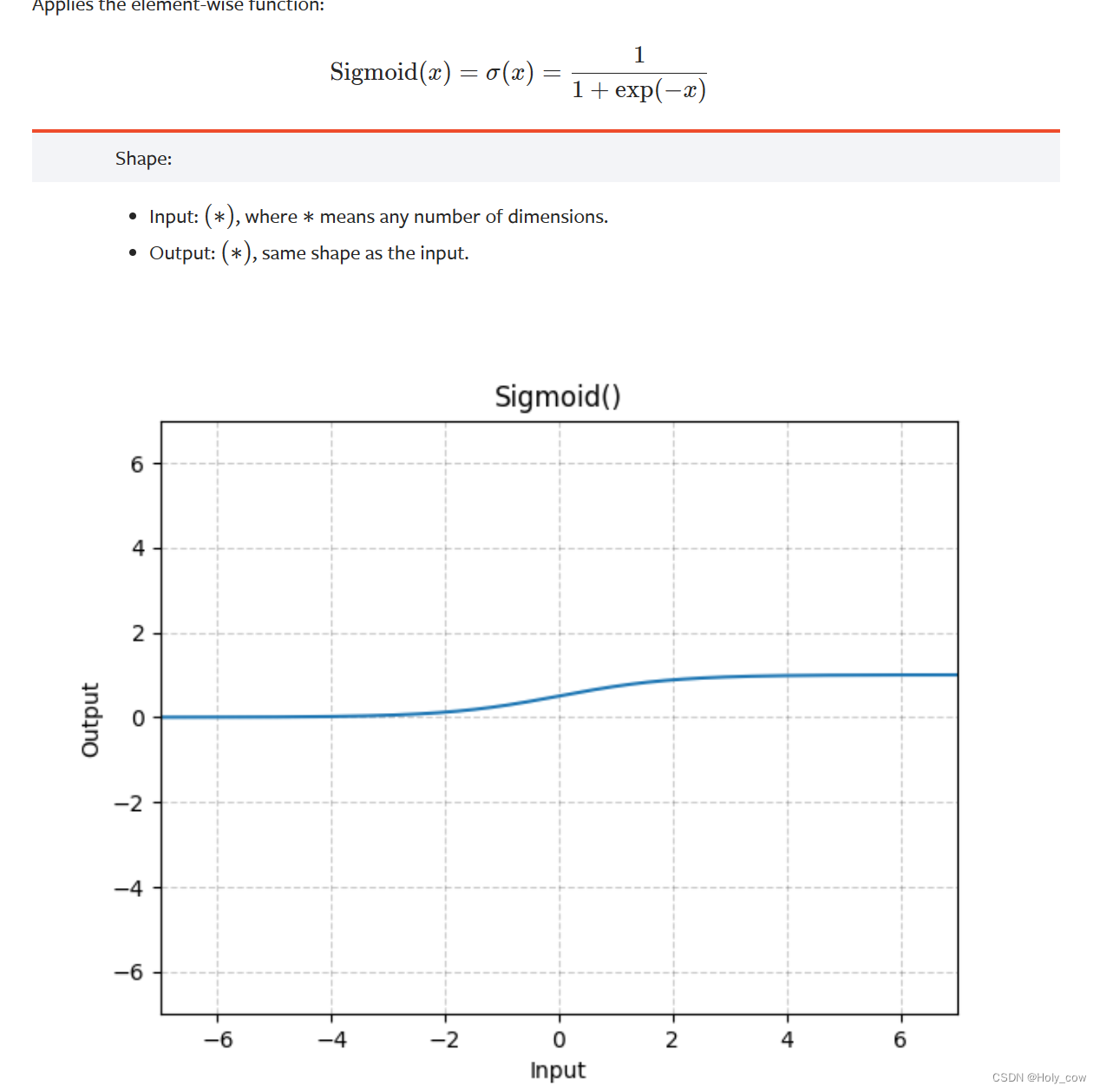

二、Sigmoid函数的使用

打开Pytorch官网,查看Sigmoid函数。

再运行如下代码,使用Sigmoid函数作为激活函数。

import torch

import torchvision

from torch import nn

from torch.nn import ReLU, Sigmoid

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

input = torch.tensor([[1, -0.5],

[-1, 3]])

input = torch.reshape(input, (-1, 1, 2, 2))

print(input.shape)

dataset = torchvision.datasets.CIFAR10("./dataset", train=False, transform=torchvision.transforms.ToTensor(), download=True)

dataloader = DataLoader(dataset, batch_size=64)

class Cow(nn.Module):

def __init__(self):

super(Cow, self).__init__()

self.relu1 = ReLU()

self.sigmoid1 = Sigmoid()

def forward(self, input):

output = self.sigmoid1(input)

return output

cow = Cow()

writer = SummaryWriter("logs_activation")

step = 0

for data in dataloader:

imgs, targets = data

writer.add_images("input", imgs, global_step=step)

output = cow(imgs)

writer.add_images("output", output, step)

step = step + 1

writer.close()

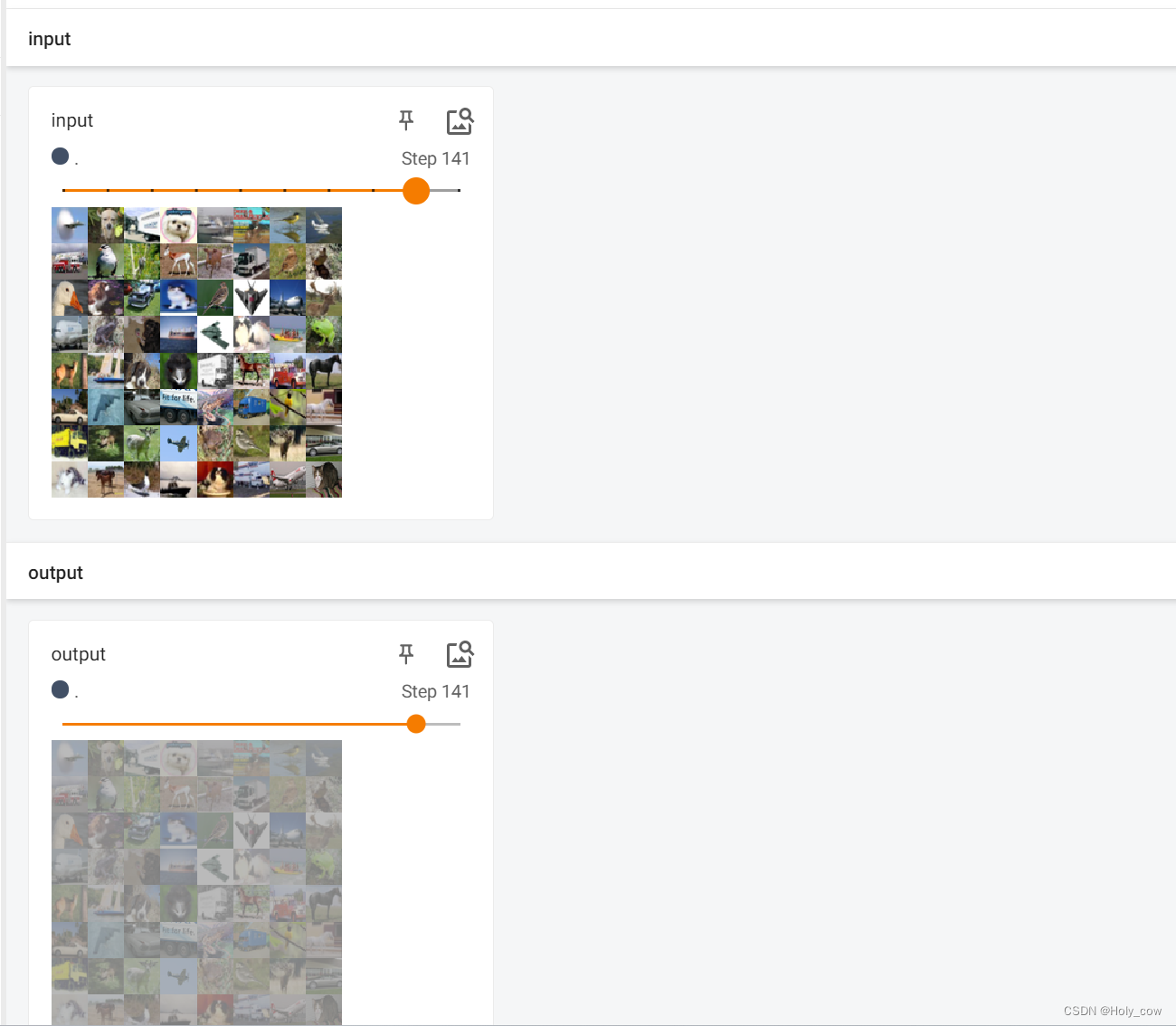

打开tensorboard,查看输出效果

2262

2262

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?