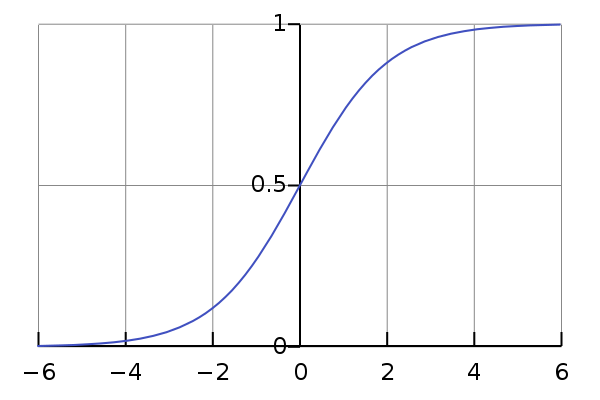

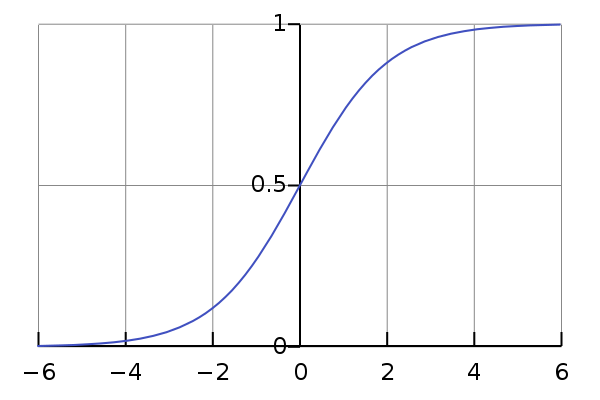

Sigmoid

神经网络最常见的激活函数就是sigmoid函数。

sigmoid函数意为“S型曲线函数”,它常常指的是logistic(对数几率)函数:

y=11+e−x=exex+1

但sigmoid函数还有其他的函数,例如tanh函数等。

tanhx=ex−

本文介绍了神经网络中常见的激活函数,包括Sigmoid的二分类特性,Softmax的多分类扩展,以及ReLU与softplus之间的联系。ReLU作为平滑函数,通过softplus求导得到logistic函数,进一步泛化为softmax,形成了一条函数关系链。

本文介绍了神经网络中常见的激活函数,包括Sigmoid的二分类特性,Softmax的多分类扩展,以及ReLU与softplus之间的联系。ReLU作为平滑函数,通过softplus求导得到logistic函数,进一步泛化为softmax,形成了一条函数关系链。

神经网络最常见的激活函数就是sigmoid函数。

sigmoid函数意为“S型曲线函数”,它常常指的是logistic(对数几率)函数:

5274

5274

3998

3998

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?