这个专栏围绕着大模型的基本知识点深入浅出,章节之间的联系较为紧密。若在某个环节出现卡点,可以回到如何优雅的谈论大模型重新阅读。而斯坦福2024人工智能报告解读则为通识性读物。若对于如果构建生成级别的AI架构则可以关注AI架构设计专栏。技术宅麻烦死磕LLM背后的基础模型。

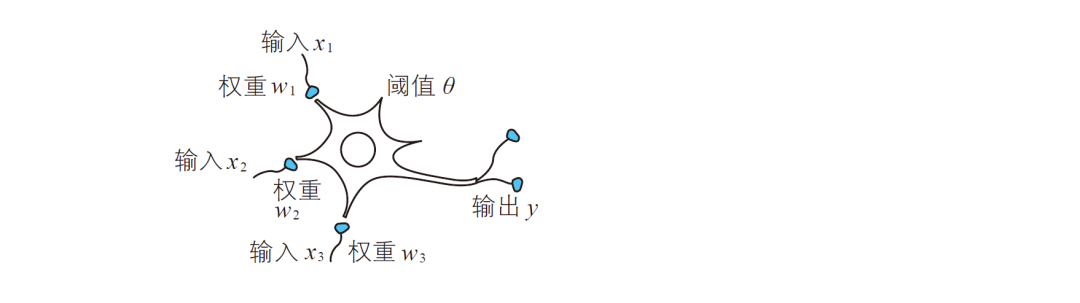

神经元

在继续往下的旅程之前,神经网络的基本知识十分重要,因为它涉及到后面大模型参数微调内容。于是就先停下来将一些基础知识讲明白。同时审视下神经网络的原理与背后的数学解释。如此可以更加优雅的理解大模型,当然受益的不仅仅是大模型技术,对于其他的深度神经网络也是十分重要。

|

|

|

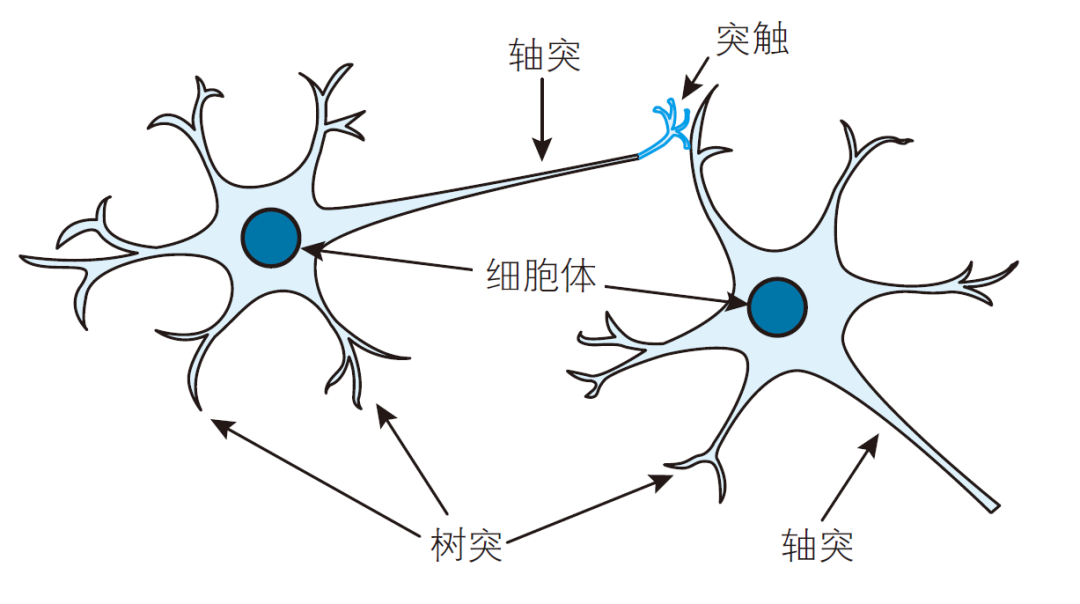

左图为人类大脑中神经元的结构,神经元是由细胞体、轴突和树突三个主要部分构成的。其他神经元的信号利用树突传递到某个细胞体,细胞体把这些传递过来的信号整合加工,最终通过轴突的突触传递给周边神经元。所以说人类神经元的模型就是将输入进行加工,然后输出给周边的神经元,最后激活人类对应的反应和行为。

但是若任何的输入都会导致输出,人脑估计也是吃不消,而且会出现人的情绪极不稳定。因此每个神经元都会有一种自我保护的机制(有些资料称呼为阈值),若输入的信号太小或者不是神经元的关注点,那么就会忽略这个信号,不会继续往下传递。

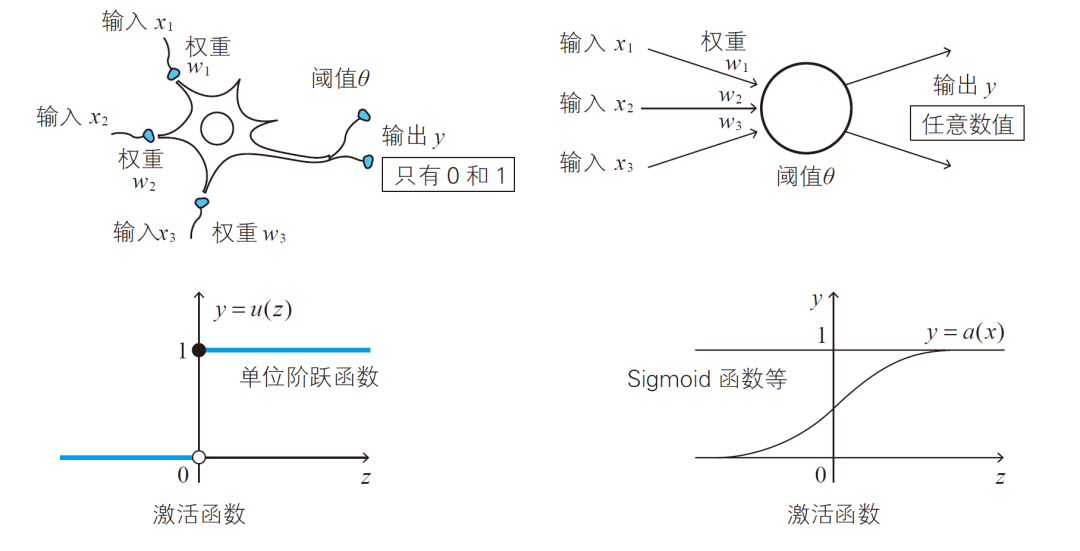

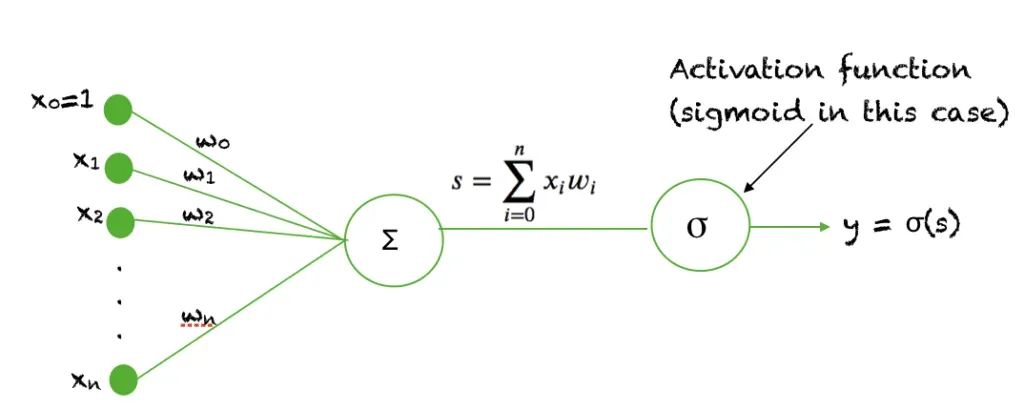

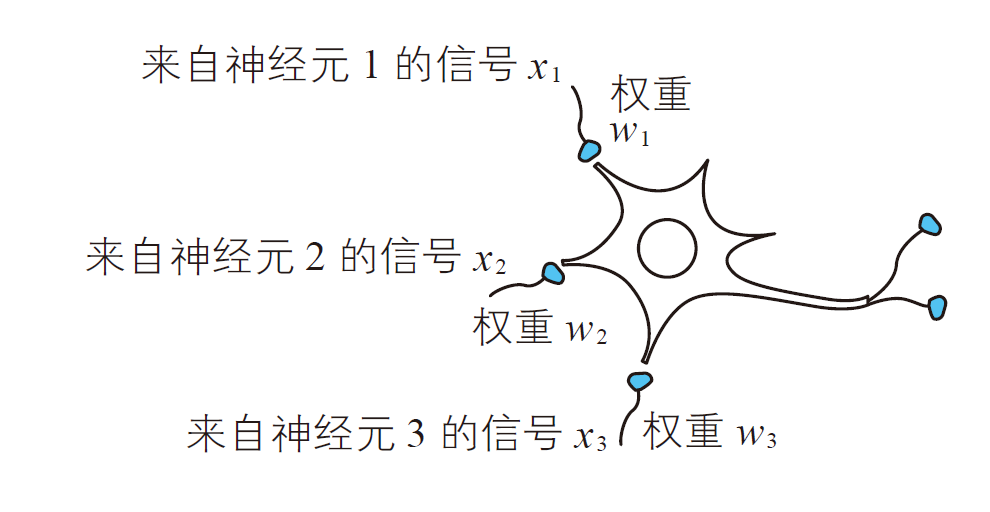

于是科学家们对神经元的模型进行了数学抽象,将每个输入x乘以一个权重w,然后累加之后加上或者减去调整项θ输入激活函数去判断是否输出,以及输出的数值y,最后将这个数据传递给下游。

想象一下,人类大脑有近860亿个神经元,每个神经元有多达10000个突触。输入x可以是现实世界的任何感知,权重都是训练得出,就像小孩子或者宠物,都是通过不断地尝试,不断地学习最终让大脑中的神经元各司其职。而神经网络也是如此,通过对于大量样本的学习,让不同位置的神经元负责某个部分的识别,最终达到最优的效果。

每个人的神经元的权重应该是不一样的,这才造就了个体。而每个人的成长和意识都是由不同的大脑结构(神经网路架构),成长背景(训练模式),接触知识(训练语料),教育模式(调优模式)导致。

激活函数

因此到了这里完成了神经元到神经网络(神经单元)的蜕变。输入x1,x2, x3, 计算z=w1x1+w2x2+w3x3+θ,然后将z输入激活函数u中得到最终的输出值。若激活函数式单位阶跃函数的话,那么z要是小于0,一律输出0。

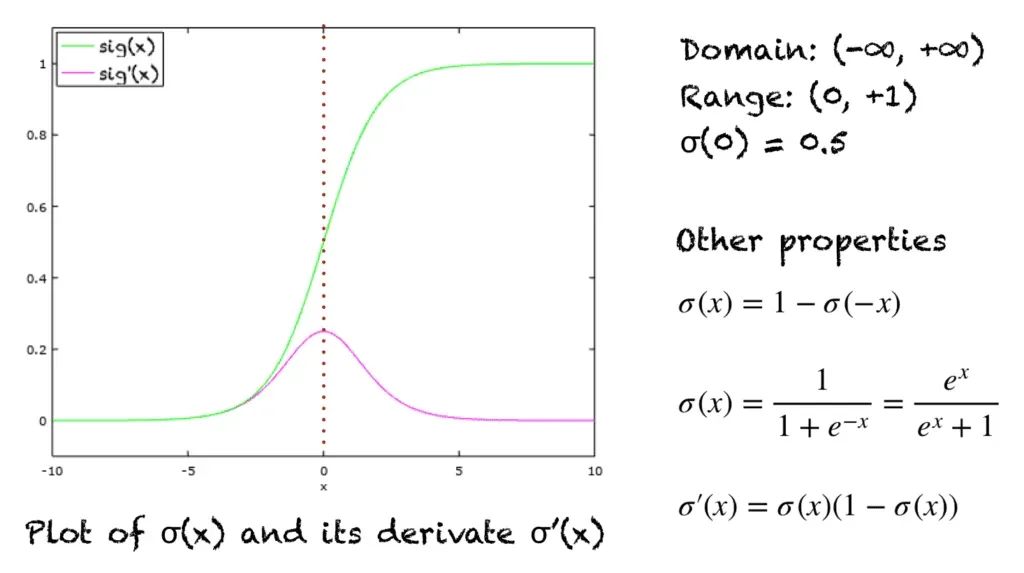

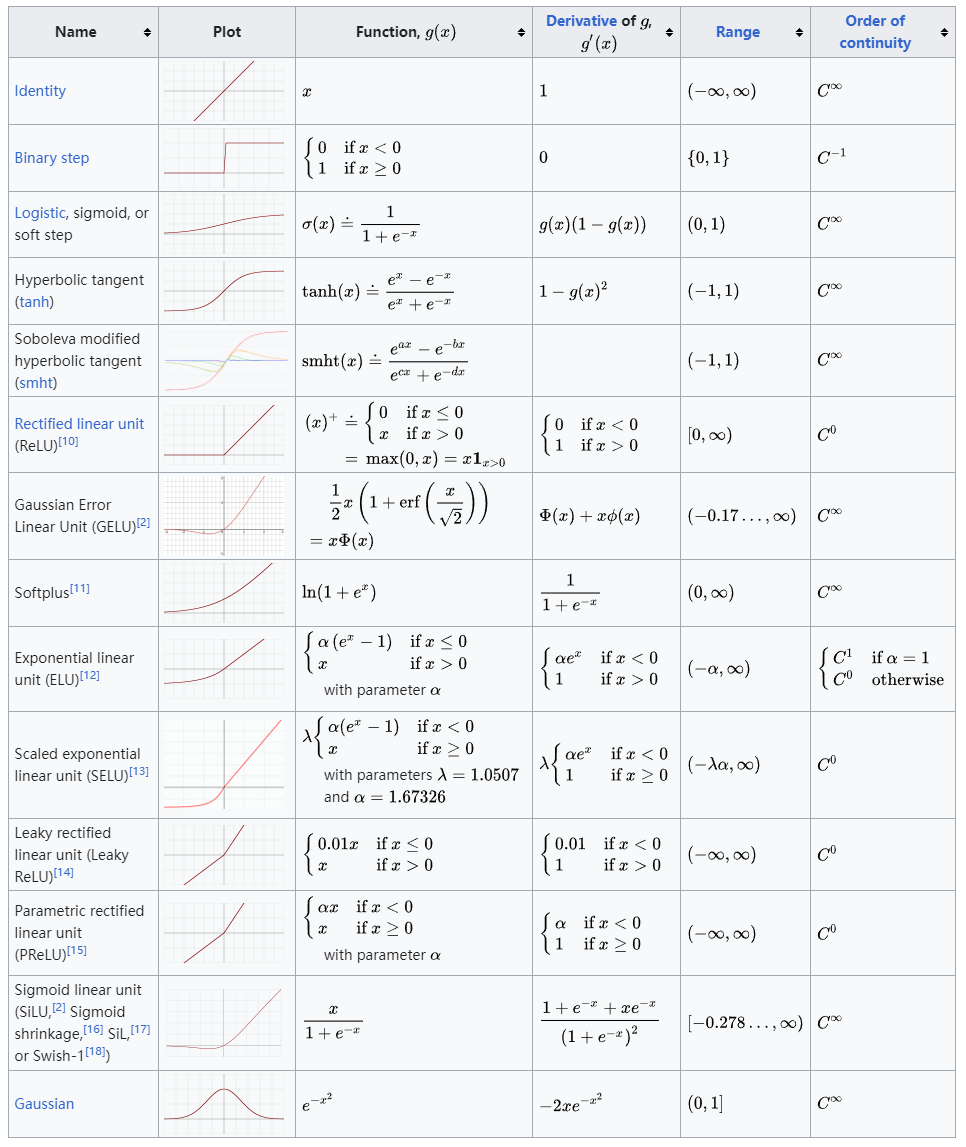

当然在实际运用中下图的σ激活函数(Sigmoid函数)使用最为广泛。因为它有很多优质的品质。比如它的导数等于自身和1减自身的积。在数值上,只需计算该函数在小范围数字上的值,例如[-10,+10]。对于小于-10的值,函数的值几乎为零。对于大于10的值,函数值几乎为1。

除了σ激活函数还有很多其他的函数,后续大家在看大模型架构的时候可以特意的留意下采用了什么激活函数。

神经网络

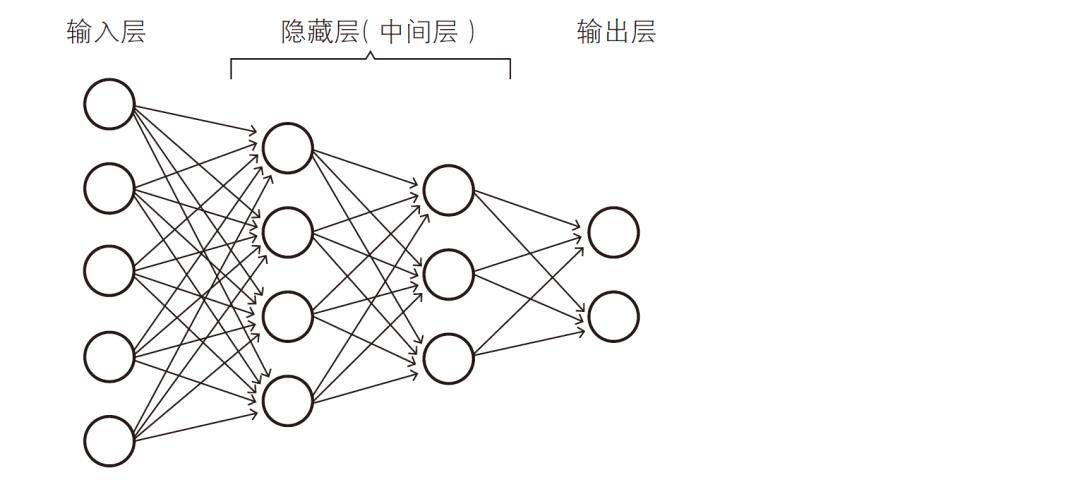

掌握了上面的基础知识之后,其实每个人都可以随意的构建自己心目中的神经网络,神经网络无非是将一个个的神经元连接起来。下图为一个经典的神经单元组织模式:阶层型的神经网络,层层递进,而这些中间层称之为隐藏层。

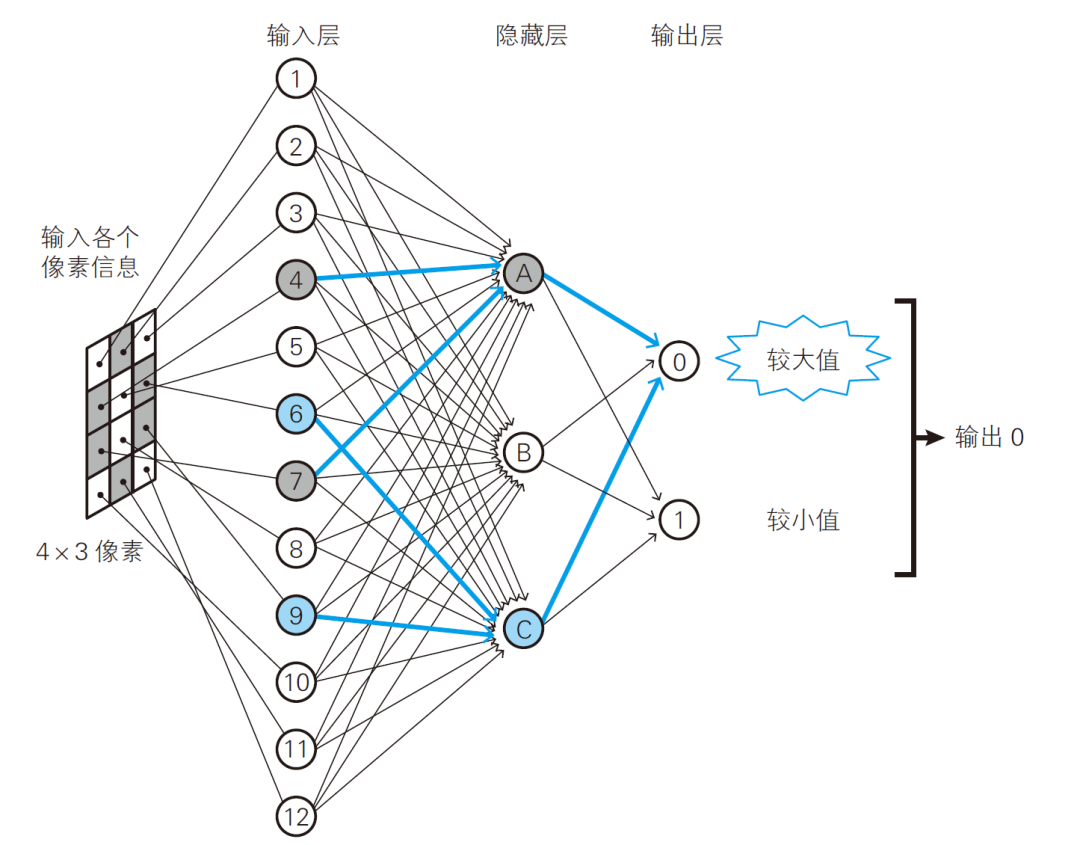

下图是一个具体的例子,例子中的神经网路只有一层的隐含层。将3*4的图像重新排序为一维的数组,然后输入,输入层和隐藏层全部连接,然后隐藏层和输出层也是全连接。图标蓝色的部分为被激活的连接,最终输出预测值0。

细心的同学可能会发现,隐藏层中A其实负责监测图像右边的“竖线”,而C负责监测图像左边的“竖线”,当输入满足的时候,“A”和“C”两个神经单元被激活,然后传递到“0”的神经单元,最终“0”的神经单元会被强力激活。

激活函数的输出离不开输入信号和权重,因此需要某种方式去训练神经网络的权重参数,让中间的这些隐藏层节点能够在整个任务中扮演特定的角色。而这些参数其实某种意义上就是对于信息的一种编码,存储在神经网络中。大模型技术某种意义将神经网络发挥到极致,不断地累加层级、参数量级和连接方式。在算力产业突破的情况下,进行大规模的训练,让复杂神经网络的信息编码更加的高效和智能。

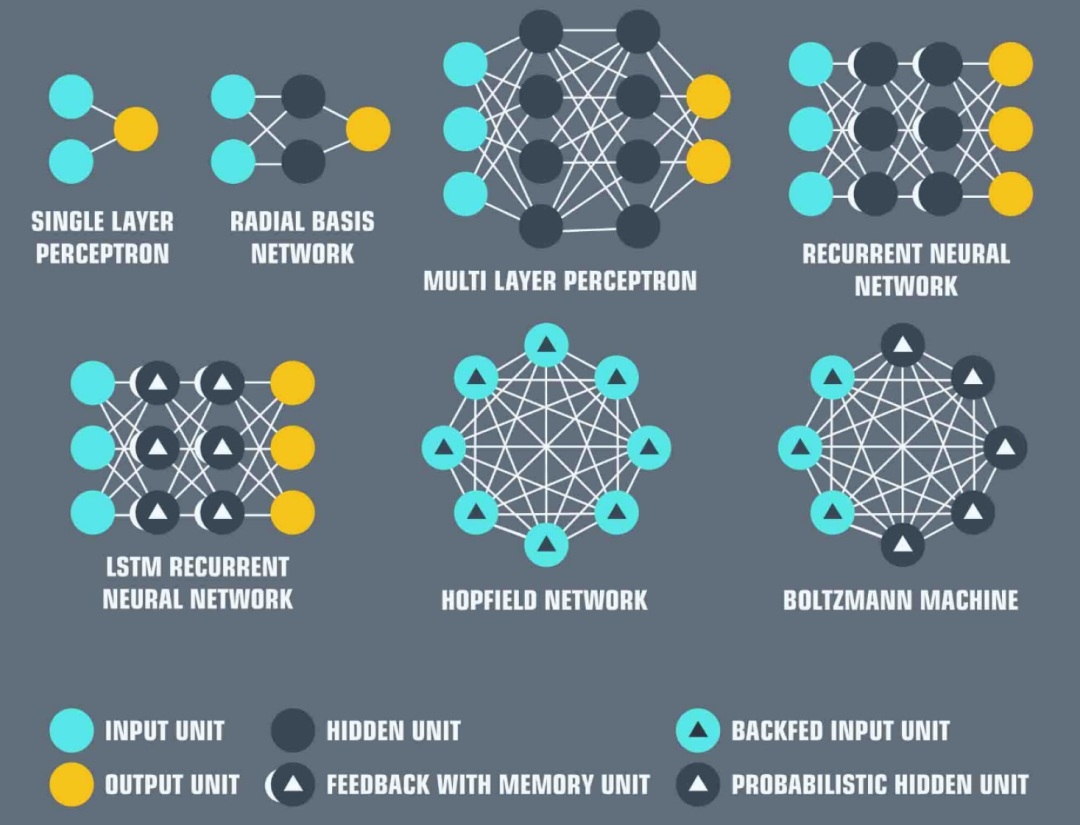

各种组织方式的神经网络

权重学习

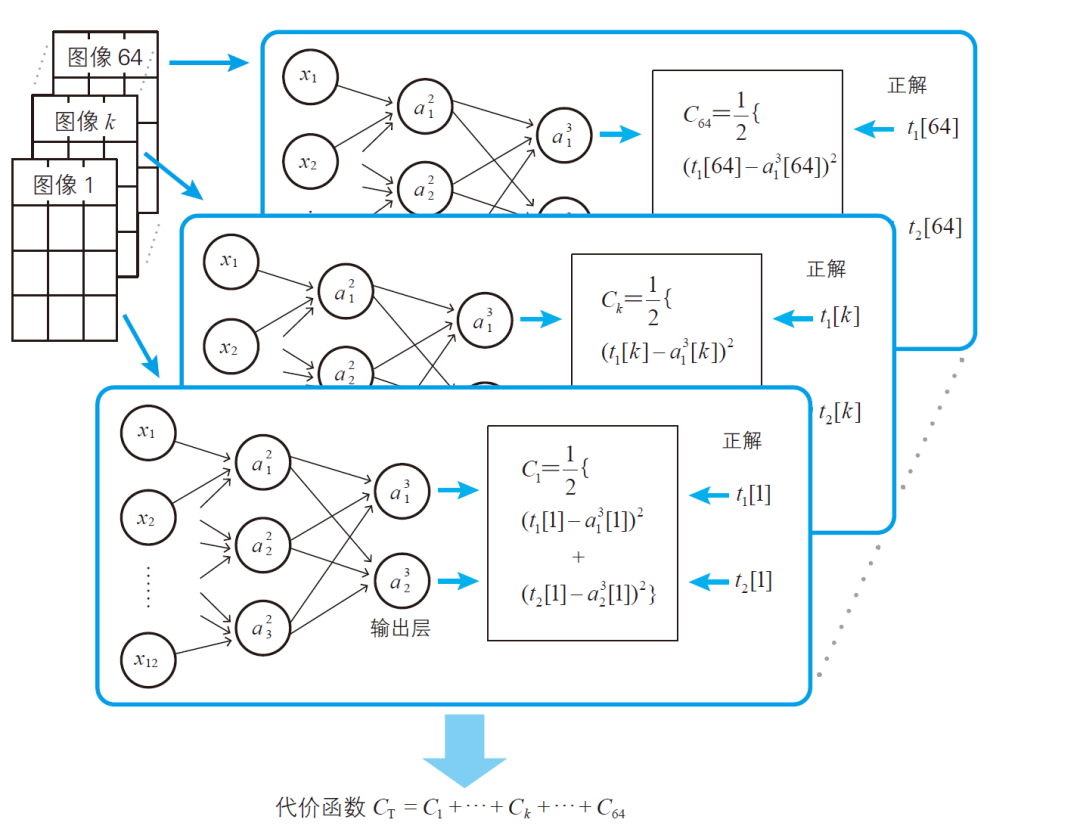

那么基础部分剩下最后一个问题,如何进行训练和调整参数。训练一开始所有的神经网络权重都是随机初始化。紧接着开始按照批次(本例的批次为64幅图)分别输入网络,输出预测结果。再将实际值和预测值进行“相减”,求出这个批次的所有预测值与实际值的代价函数,最后通过某种算法(梯度下降法或者其他),逐步的完成所有权重的更新操作。

相似度与点积

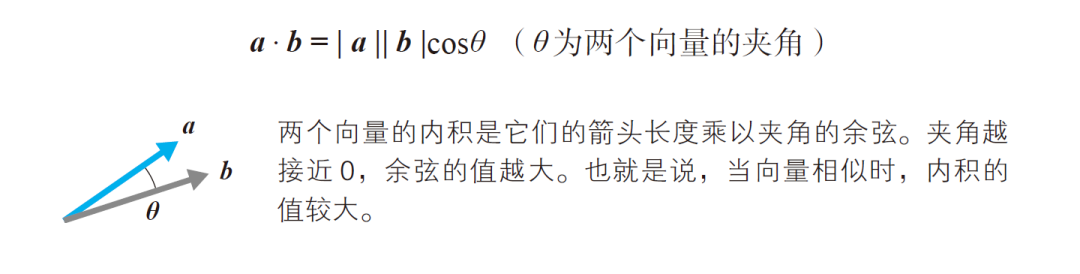

仔细观察这个公式,w和x,一个是权重参数,一个是输入,这样相乘的背后有什么数学意义没有?有,其实这样的运算就是求w向量(w1,w2,w3)和x向量(x1,x2,x3)的相似度(内积)。所以从某种意义而言,神经单元将输入和权重进行“相似度”的比较在进行决策是否输出。

306

306

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?