最小二乘双子支持向量机的改进(Improved LSTSVM)

LSTSVM是利用经验风险最小化原理构造的,因此它存在过拟合问题。以下方法针对此问题做出了改进。(改进方式类似于TBSVM,关于TBSVM请看我的其他文章)

Linear improved LSTSVM

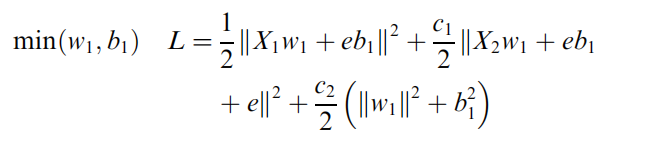

对于线性可分的数据样本,改进的LSTSVM如下:

上述方程式中的附加项是用来测量两个超平面的间距的。分离度越大,泛化能力越强。将等式约束代入目标函数,可以得到如下优化问题:

Non-linear improved LSTSVM

利用核函数将改进的LSTSVM扩展到非线性可分数据样本。针对非线性数据样本的改进LSTSVM如下:

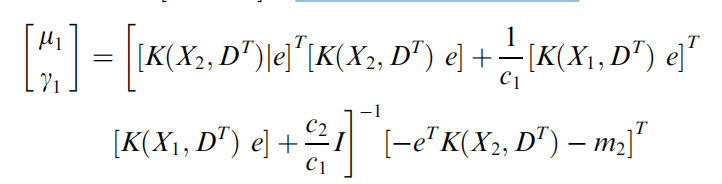

进一步可以得到:

进行如下替换:

得到:

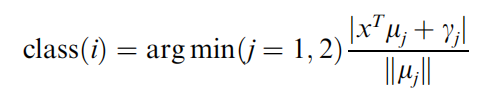

新数据点的分类公式为:

178

178

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?