一、过拟合

就是所建的机器学习模型或者是深度学习模型在训练样本中表现得过于优越,在验证数据集以及测试数据集中却表现不佳。

导致这种现象的原因有以下2种:

①数据集特征单一,或者数据量过少

可以丰富数据集

②网络层数较深,参数过多

适当的减少网络层数,激活函数使用relu也是一种方法,因为他会将小于0的部分全部归为0,从而造成了网络的稀疏性,并且减少了参数的相互依存关系,缓解了过拟合问题的发生

二、欠拟合

就是所建的模型在训练样本中的表现都很一般

可以通过增加网络复杂度或者在模型中增加多点特征点

三、激活函数

作用:通过激活函数,神经网络就可以拟合各种非线性曲线,所以激活函数肯定都是非线性的

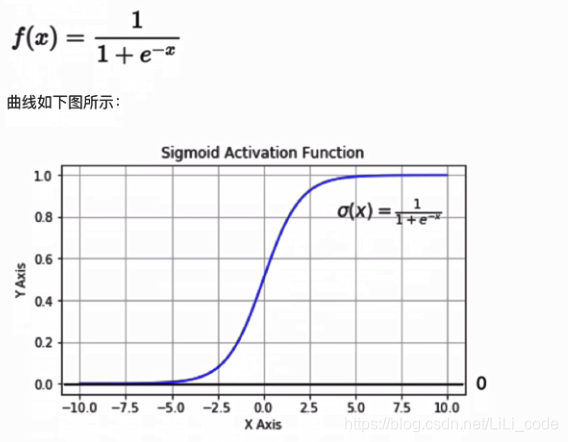

① sigmod

②tanh

本文介绍了神经网络中的过拟合和欠拟合现象,过拟合可能因数据特征单一、数据量不足或网络层数过多造成,可通过减少网络层数和使用ReLU来缓解。欠拟合则可通过增加网络复杂度解决。激活函数是实现非线性拟合的关键,如sigmoid、tanh、ReLU及其改进版LeakReLU,以及在多分类中使用的softmax。选择激活函数时需考虑计算效率、梯度消失问题和模型复杂度等因素。

本文介绍了神经网络中的过拟合和欠拟合现象,过拟合可能因数据特征单一、数据量不足或网络层数过多造成,可通过减少网络层数和使用ReLU来缓解。欠拟合则可通过增加网络复杂度解决。激活函数是实现非线性拟合的关键,如sigmoid、tanh、ReLU及其改进版LeakReLU,以及在多分类中使用的softmax。选择激活函数时需考虑计算效率、梯度消失问题和模型复杂度等因素。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9088

9088

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?