ex4,

一开始做的时候,卡在了代价函数这里,建议大家用for循环来练习这道题目,真正理解神经网络算法和one-vs-all算法的不同。

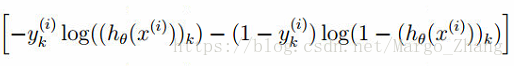

这个式子的重点在于计算

one-vs-all,十个分类器,分别做十次logistic回归。每一个的结果都要和y求误差。也就是10次计算。再有5000个样本,所以是10*5000次计算。

而对于神经网络算法,output layer有十个units,每一个unit和对应y的unit求误差,也就是10次计算。再有5000个样本,所以是10*5000次计算。也就是式子中显示的两层求和,K*m。

而不是每一个outputlayer的unit和每一个y都求误差,那就是10*10*5000(K*m*m)次计算。

ex5

Regularized Linear Regression a nd Bias v.s.Variance

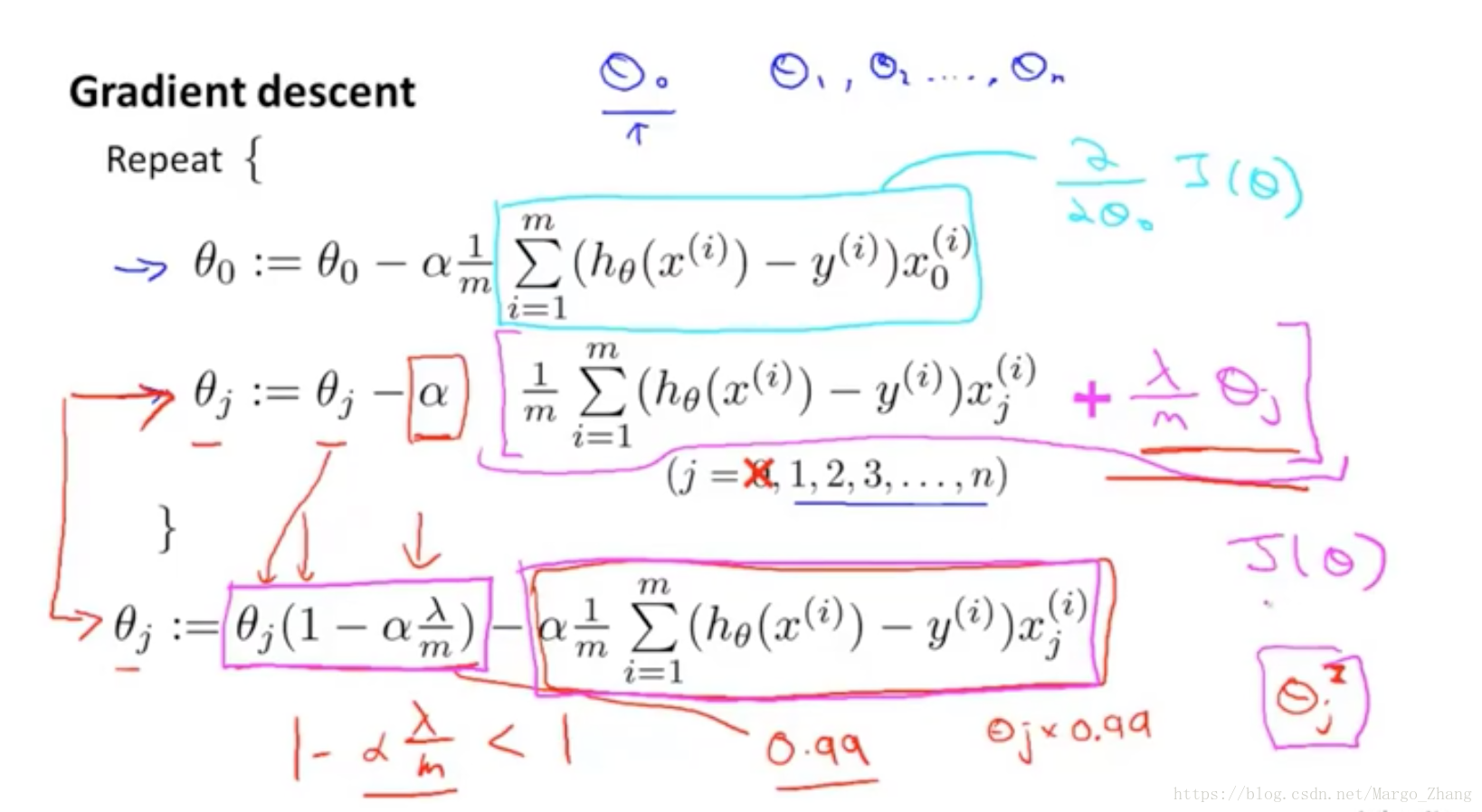

这边的问题不大,主要是在求regularized linear regression cost function,线性回归正则代价函数。发现总是会给惩罚项从1开始积分,但是实数项的theta是不用积分的。

6231

6231

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?