Neural Networks

1.1 Non-linear hypotheses

在课程的开头,提到了非线性假设,会因为特征量的增多导致二次项数的剧增。

举个例子,在图像识别中,一个50*50像素的图片,拥有的特征量为2500,那么它的二次项数为2500*2500/2,大约为3百万个。

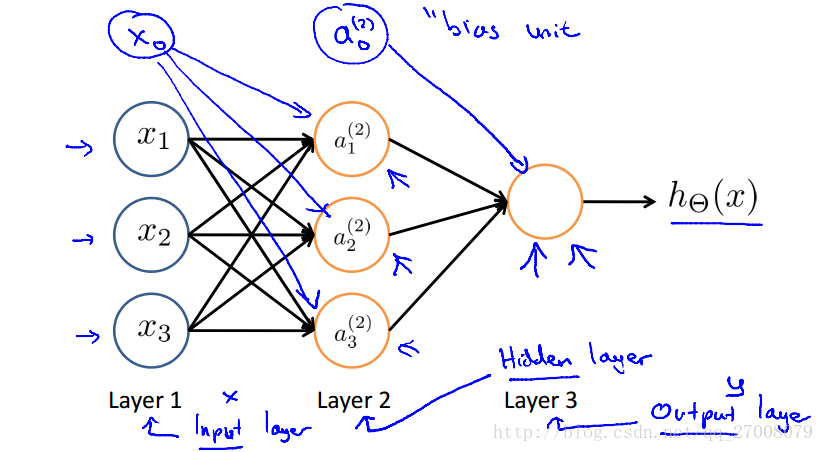

1.2 Model representation

上层是一个三层神经网络,第一层为输入层,第二层为隐藏层,第三层为输出层。

每条边上有一个权值 θ

下面是符号表示。

a(j)i :第j层单元i的“激励”

θ(j) :第j层到第j+1层单元的权值矩阵。

若第j层单元数为 sj ,第j+1层单元数为 sj+1 ,则 θ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2431

2431

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?