软svm就是L2规范化

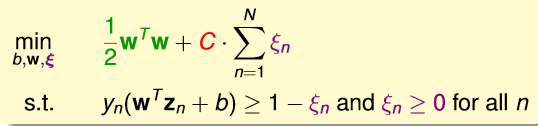

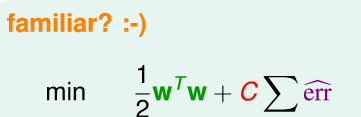

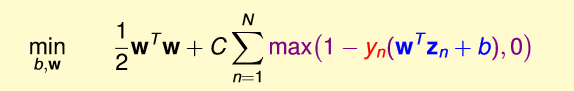

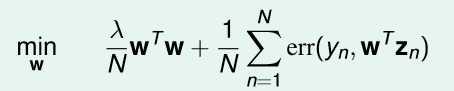

我们上一讲得到,soft-svm的形式为

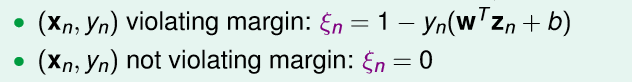

其实我们根据

可以得到

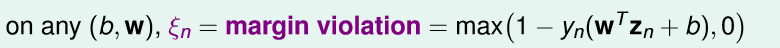

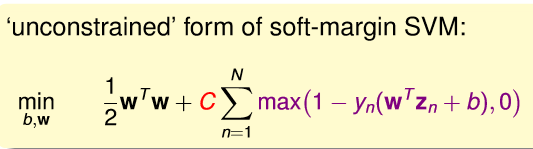

那么原来的soft-svm的表达式就是

发现没有,这已经变成了没有约束条件的形式。

发现他与我们可以简化为

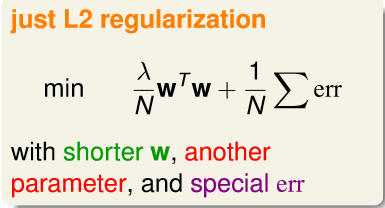

其实他就是L2泛化的形式

其实他就是L2泛化的形式,只是区别是,L2泛化是最小化err,用

wTw

来约束过拟合。而soft-svm是最小化

wTw

,用C,err约束过拟合。

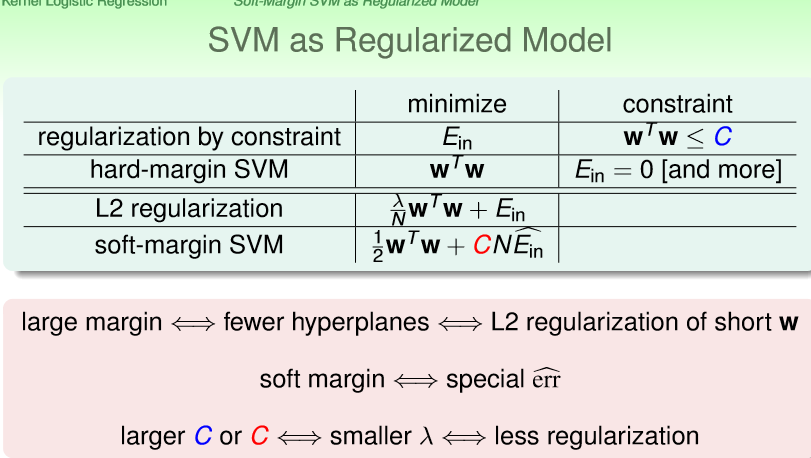

我把svm与以前泛化的形式进行比较

发现,svm就是泛化函数。

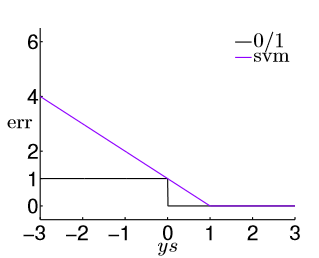

soft-svm的 errsvm 是 err0/1 的上限,且svm就是对logistic regression 进行L2处理形式

的

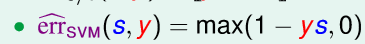

errsvm

为

画出的

errsvm

与

0/1svm

形式的图形为

可以发现

errsvm

是

err0/1

的上限。

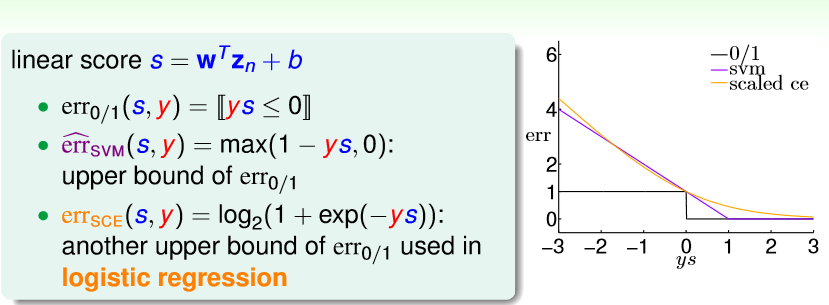

我们再把logistic regression的err曲线加上去

注意,这里logistic regression的err除了一个

ln2

在横坐标ys改变时,

errsvm

和

err0/1

变化曲线很相近。且有

所以,我们说soft-svm大概就是logistic regression进行L2 泛化后的形式。

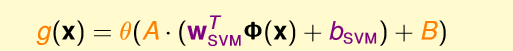

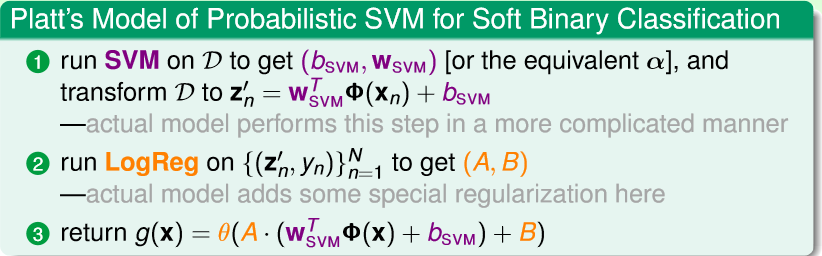

logistic 与SVM结合 用svm输出概率值,logistic回归解z域的情况

我们前面学得输出概率值得模型,就是logistic 回归。

为了能够svm的特性(kernel)和logistic的特性(最大似然值)结合起来,总结一个姓的模型

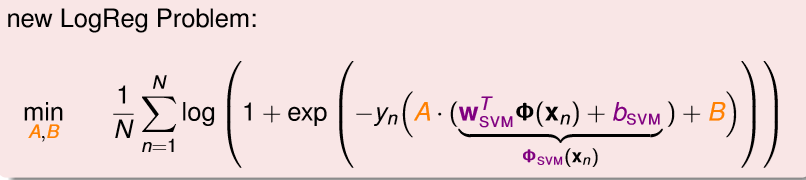

那么新logistic回归的值为

那么新模型的运算步骤为

这种情况下, 可以理解为可以用logistic回归解决z域的情况,但其实并不完全是这样的。因为我们这里其实仅仅是用svm来解决z域 的值,然后将其带入logistic 回归里。所以并不是真正的在z域里解logistic 回归问题。

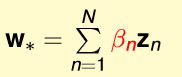

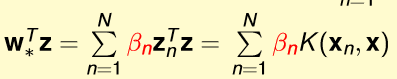

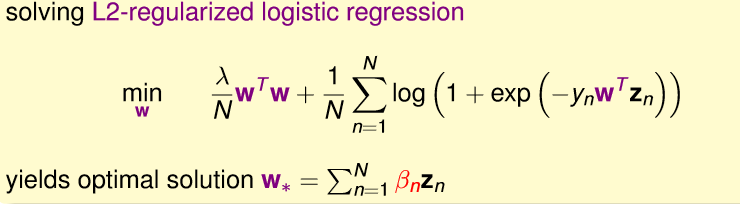

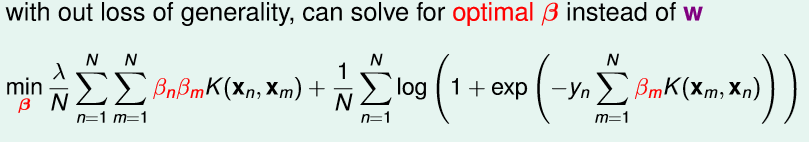

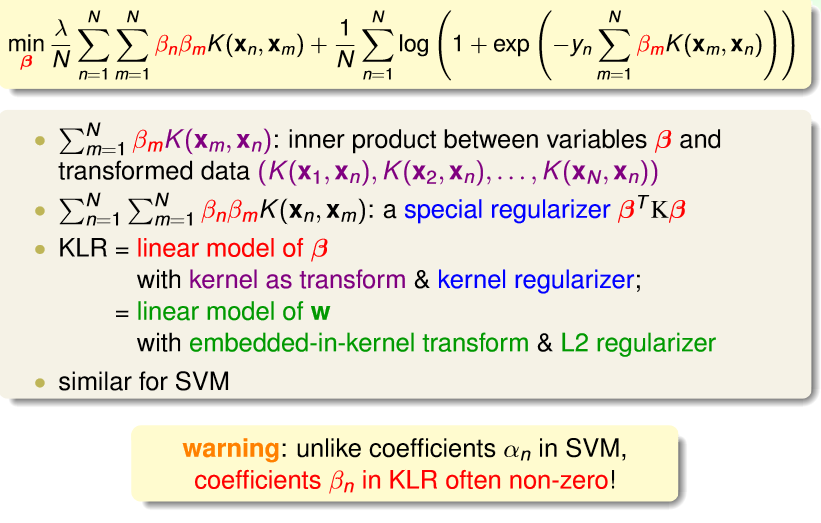

一定要在z域解logistic回归的问题 Kernel Logistic Regression (与svm无关,只是借用其kernel的思想)

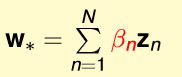

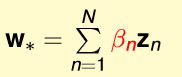

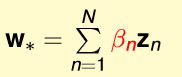

我们在解svm时,用到kernel函数化简z域的问题。之所以是这样,原因为我们得到的

w∗

是z的线性组合

那么在Logistic Regression我们也希望这样做,即希望

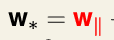

w∗

是z的线性组合

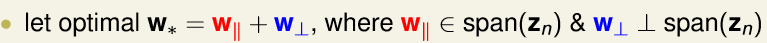

其实有一个结论:

当我们的模型是L2规范化线性模型时,即形如

那么他的最优解

w∗

就可以满足w_*$是z的线性组合

证明:

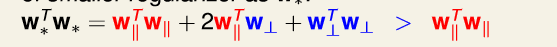

则有

又

那么

由于他没有约束条件,那么他用 GD/SGD等等都可以求解。

他的缺点是比上面logistic+svm运算量大一些。

Kernel Logistic Regression (KLR) 的理解

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?