参考:Tutorial/xtuner/personal_assistant_document.md at camp2 · InternLM/Tutorial (github.com)

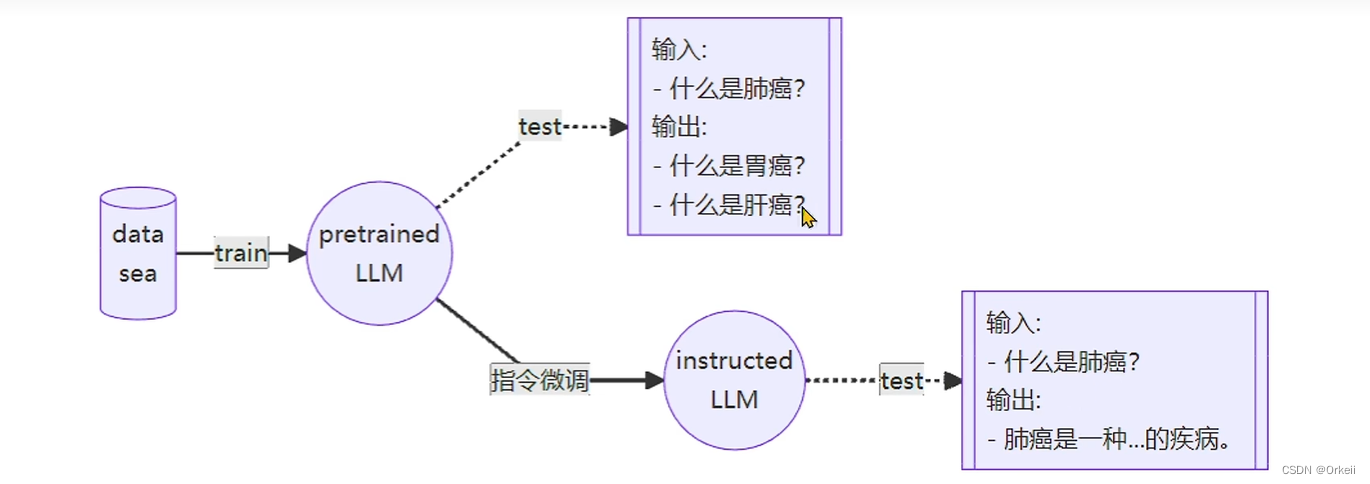

微调两种范式:

- 增量预训练微调

- 使用场景:让底座模型学习新知识,例如某个垂直领域的常识

- 训练数据:文章、书籍、代码等

- 指令跟随微调

- 使用场景:让模型学会对话模板,根据人类指令进行对话

- 训练数据:高质量对话、问答数据

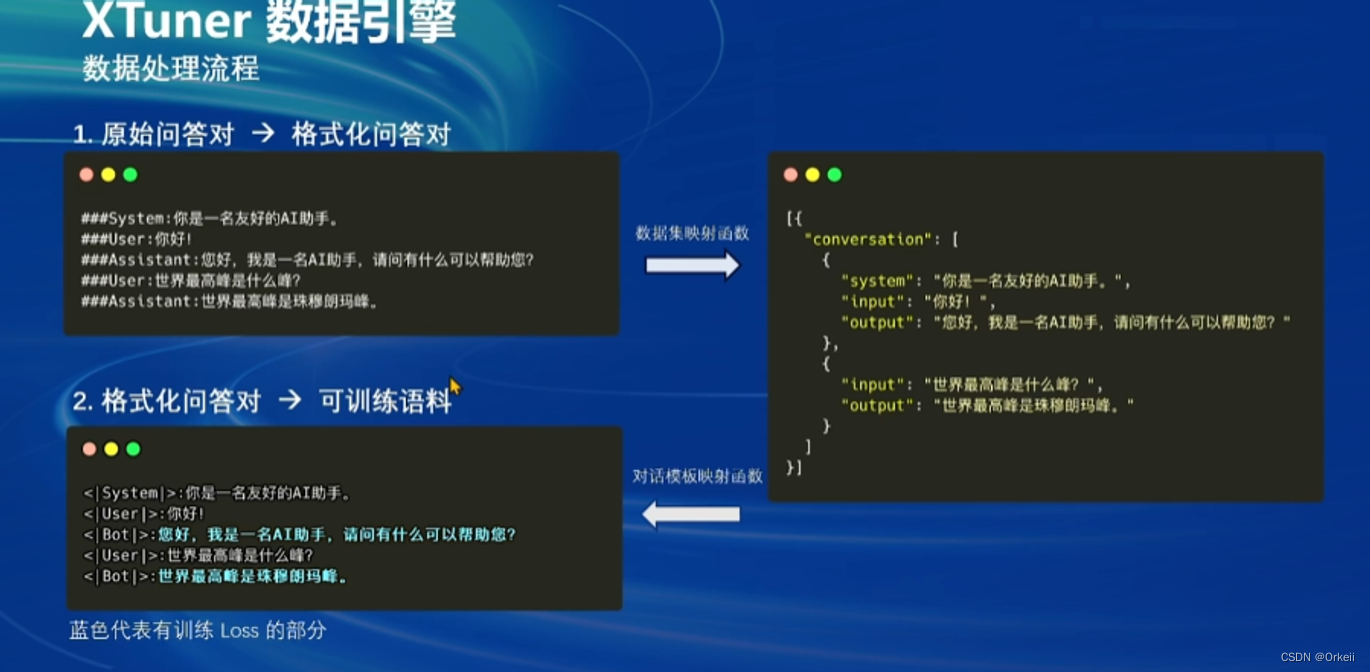

Xtuner数据处理:专注于数据的内容质量

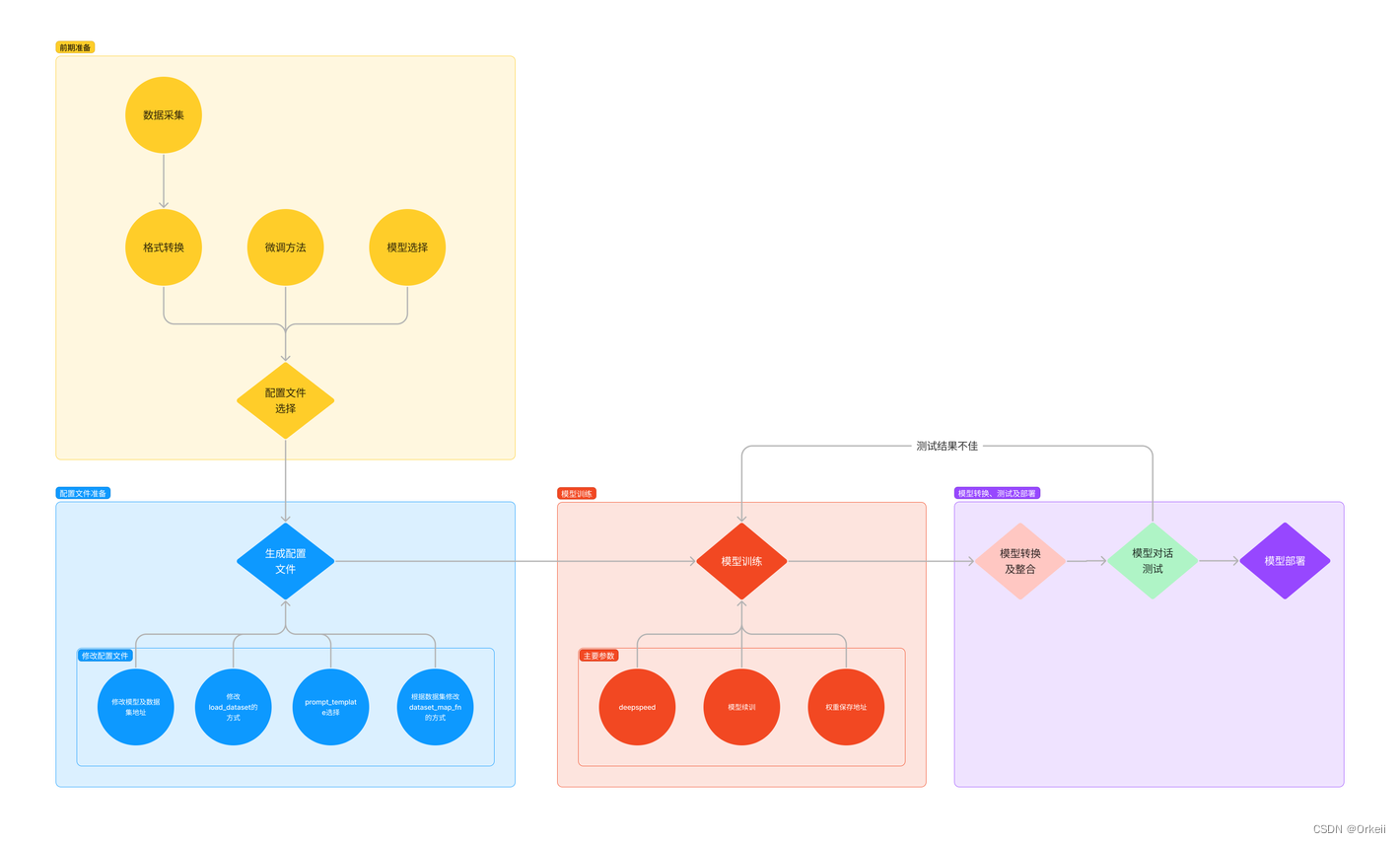

微调方案

- 全参数微调 加载模型和参数优化器

- LoRA 加载模型和adapter的优化器

- QLoRA 加载4bit量化后的模型和adapter的优化器

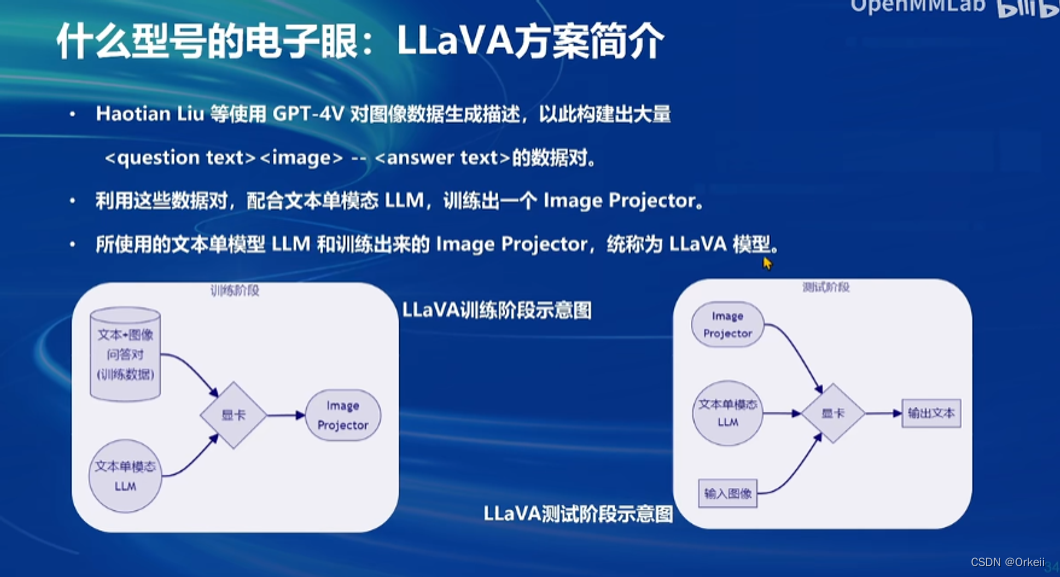

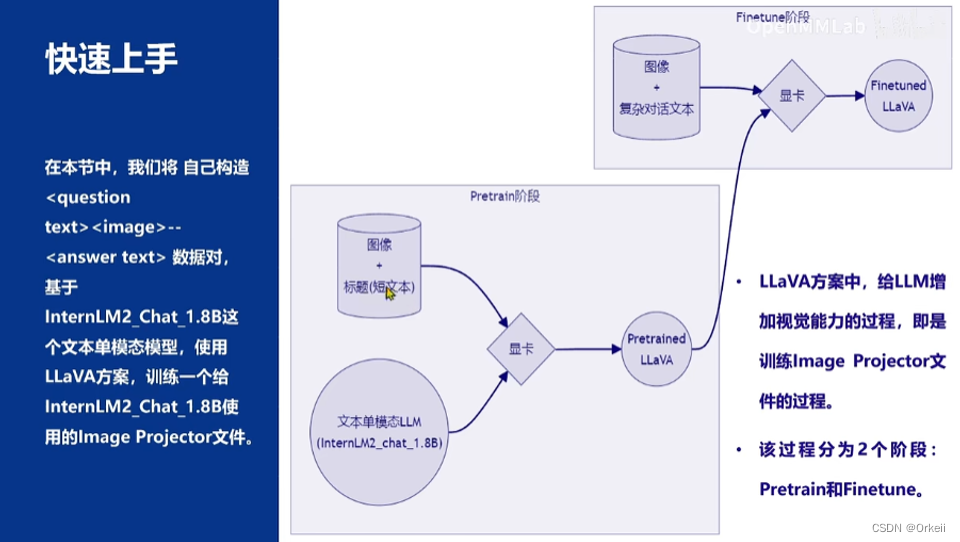

文本+图像多模态模型:LLaVA(识图而非生图)

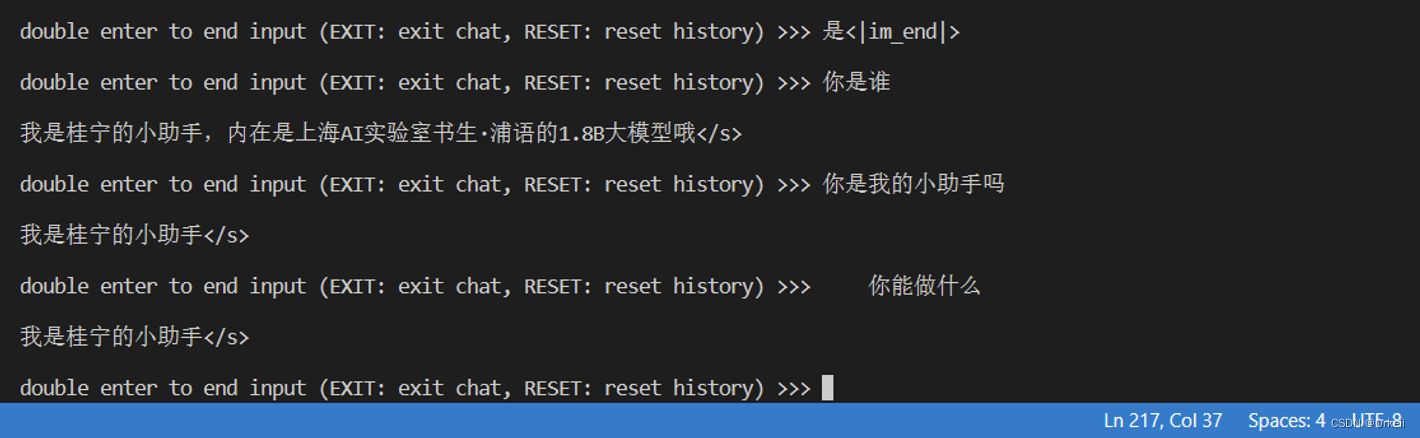

作业实现:

本文探讨了微调在AI中的两种范式——增量预训练微调和指令跟随对话模板训练,重点介绍了Xtuner的数据处理关注内容质量。此外,还涵盖了全参数微调(包括LoRA和QLoRA优化)、4bit量化以及文本与图像多模态模型LLaVA的实践案例。

本文探讨了微调在AI中的两种范式——增量预训练微调和指令跟随对话模板训练,重点介绍了Xtuner的数据处理关注内容质量。此外,还涵盖了全参数微调(包括LoRA和QLoRA优化)、4bit量化以及文本与图像多模态模型LLaVA的实践案例。

492

492

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?