个人认为这个玩意水很深啊,还没摸透呢,也是看了一些别人的博客自己再总结一下

然后看到有的博客扯到《机器学习实战》这本书,我点进去看了一下,对于我这英文水准比较烂的人来说,完全是两眼一抹黑啊

什么是逻辑回归?

Logistic回归与多重线性回归实际上有很多相同之处,最大的区别就在于它们的因变量不同,其他的基本都差不多。正是因为如此,这两种回归可以归于同一个家族,即广义线性模型(generalizedlinear model)。

这一家族中的模型形式基本上都差不多,不同的就是因变量不同。

- 如果是连续的,就是多重线性回归;

- 如果是二项分布,就是Logistic回归;

- 如果是Poisson分布,就是Poisson回归;

- 如果是负二项分布,就是负二项回归。

Logistic回归的因变量可以是二分类的,也可以是多分类的,但是二分类的更为常用,也更加容易解释。所以实际中最常用的就是二分类的Logistic回归。

Logistic回归的主要用途:

- 寻找危险因素:寻找某一疾病的危险因素等;

- 预测:根据模型,预测在不同的自变量情况下,发生某病或某种情况的概率有多大;

- 判别:实际上跟预测有些类似,也是根据模型,判断某人属于某病或属于某种情况的概率有多大,也就是看一下这个人有多大的可能性是属于某病。

Logistic回归主要在流行病学中应用较多,比较常用的情形是探索某疾病的危险因素,根据危险因素预测某疾病发生的概率,等等。例如,想探讨胃癌发生的危险因素,可以选择两组人群,一组是胃癌组,一组是非胃癌组,两组人群肯定有不同的体征和生活方式等。这里的因变量就是是否胃癌,即“是”或“否”,自变量就可以包括很多了,例如年龄、性别、饮食习惯、幽门螺杆菌感染等。自变量既可以是连续的,也可以是分类的。

上面都是别人扯得姑且看看,我们最直观的还是看看逻辑回归是个啥模样吧?

这是它的数学表达式:

Logistic回归虽然名字里带“回归”,但是它实际上是一种分类方法,主要用于两分类问题(即输出只有两种,分别代表两个类别),所以利用了Logistic函数(或称为Sigmoid函数),函数形式为:

给你们一个针对上面公式求导过程吧:

如果我们令中的z为:,这样就得到了二元逻辑回归模型的一般形式:

我估计他是想表达这个式子:

还是弄成图片好点,格式太麻烦了。。。。。。。。。。。。。。。。。。。。。。。

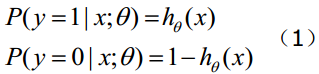

然后就跳到 二元逻辑回归的损失函数

函数

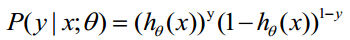

把这两个式子写成一个式子,就是:

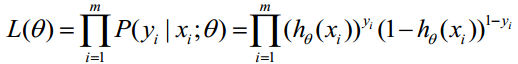

似然函数的代数表达式为:

其中m为样本的个数。

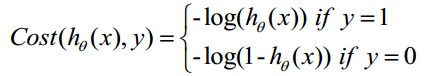

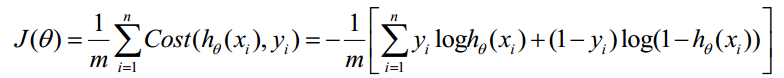

对似然函数对数化取反的表达式,即损失函数表达式为:

构造损失函数J

Cost函数和J函数如下,它们是基于最大似然估计推导得到的。

下面详细说明推导的过程:

(1)式综合起来可以写成:

取似然函数为:

对数似然函数为:

最大似然估计就是求使 取最大值时的θ,其实这里可以使用梯度上升法求解,求得的θ就是要求的最佳参数。但是,在Andrew Ng的课程中将

取最大值时的θ,其实这里可以使用梯度上升法求解,求得的θ就是要求的最佳参数。但是,在Andrew Ng的课程中将 取为下式,即:

取为下式,即:

因为乘了一个负的系数-1/m,所以取 最小值时的θ为要求的最佳参数。

最小值时的θ为要求的最佳参数。

梯度下降法求的最小值

θ更新过程:

θ更新过程可以写成:

其实还有一种写法,我看了老半天才看懂:

下面介绍向量化的过程:

约定训练数据的矩阵形式如下,x的每一行为一条训练样本,而每一列为不同的特称取值:

g(A)的参数A为一列向量,所以实现g函数时要支持列向量作为参数,并返回列向量。由上式可知 可由

可由 一次计算求得。

一次计算求得。

θ更新过程可以改为:

小结

逻辑回归尤其是二元逻辑回归是非常常见的模型,训练速度很快,虽然使用起来没有支持向量机(SVM)那么占主流,但是解决普通的分类问题是足够了,训练速度也比起SVM要快不少。如果你要理解机器学习分类算法,那么第一个应该学习的分类算法个人觉得应该是逻辑回归。理解了逻辑回归,其他的分类算法再学习起来应该没有那么难了。

说实话,我现在也是一知半解,但是Logistic回归我们可以把它当做线性回归来理解,只不过用途不一样而已,它也需要梯度下降,需要正则化这一系列调参之后才能拟合的更好,等以后我有了更深的理解了再来更新博客吧,这篇博客是我看了三篇相关博客写的。。。另外,今天get了一个新技能,以后写数学公式就不会这么low了。

下面这段话或许会对你们有点帮助。。。。

1)对于一个问题,我们用数学语言来描述它,然后建立一个模型,例如回归模型或者分类模型等来描述这个问题;

2)通过最大似然、最大后验概率或者最小化分类误差等等建立模型的代价函数,也就是一个最优化问题。找到最优化问题的解,也就是能拟合我们的数据的最好的模型参数;

3)然后我们需要求解这个代价函数,找到最优解。这求解也就分很多种情况了:

a)如果这个优化函数存在解析解。例如我们求最值一般是对代价函数求导,找到导数为0的点,也就是最大值或者最小值的地方了。如果代价函数能简单求导,并且求导后为0的式子存在解析解,那么我们就可以直接得到最优的参数了。

b)如果式子很难求导,例如函数里面存在隐含的变量或者变量相互间存在耦合,也就互相依赖的情况。或者求导后式子得不到解释解,例如未知参数的个数大于已知方程组的个数等。这时候我们就需要借助迭代算法来一步一步找到最有解了。迭代是个很神奇的东西,它将远大的目标(也就是找到最优的解,例如爬上山顶)记在心上,然后给自己定个短期目标(也就是每走一步,就离远大的目标更近一点),脚踏实地,心无旁贷,像个蜗牛一样,一步一步往上爬,支撑它的唯一信念是:只要我每一步都爬高一点,那么积跬步,肯定能达到自己人生的巅峰,尽享山登绝顶我为峰的豪迈与忘我。

另外需要考虑的情况是,如果代价函数是凸函数,那么就存在全局最优解,方圆五百里就只有一个山峰,那命中注定了,它就是你要找的唯一了。但如果是非凸的,那么就会有很多局部最优的解,有一望无际的山峰,人的视野是伟大的也是渺小的,你不知道哪个山峰才是最高的,可能你会被命运作弄,很无辜的陷入一个局部最优里面,坐井观天,以为自己找到的就是最好的。没想到山外有山,人外有人,光芒总在未知的远处默默绽放。但也许命运眷恋善良的你,带给你的总是最好的归宿。也有很多不信命的人,觉得人定胜天的人,誓要找到最好的,否则不会罢休,永不向命运妥协,除非自己有一天累了,倒下了,也要靠剩下的一口气,迈出一口气能支撑的路程。

对了,上点干货吧(代码是复制别人的,他用的是python2.7,我用的python3.5没跑通他这个代码,如果哪位大神用3.5的跑通了烦请告诉我一下,谢谢) 我自己调好了,py3可以跑了(下面是已经更新的code)

主要函数:logRegression.py

所需数据:from numpy import * import matplotlib.pyplot as plt import time # calculate the sigmoid function def sigmoid(inX): return 1.0 / (1 + exp(-inX)) # train a logistic regression model using some optional optimize algorithm # input: train_x is a mat datatype, each row stands for one sample # train_y is mat datatype too, each row is the corresponding label # opts is optimize option include step and maximum number of iterations def trainLogRegres(train_x, train_y, opts): # calculate training time startTime = time.time() numSamples, numFeatures = shape(train_x) alpha = opts['alpha']; maxIter = opts['maxIter'] weights = ones((numFeatures, 1)) # optimize through gradient descent algorilthm for k in range(maxIter): if opts['optimizeType'] == 'gradDescent': # gradient descent algorilthm output = sigmoid(train_x * weights) error = train_y - output weights = weights + alpha * train_x.transpose() * error elif opts['optimizeType'] == 'stocGradDescent': # stochastic gradient descent for i in range(numSamples): output = sigmoid(train_x[i, :] * weights) error = train_y[i, 0] - output weights = weights + alpha * train_x[i, :].transpose() * error elif opts['optimizeType'] == 'smoothStocGradDescent': # smooth stochastic gradient descent # randomly select samples to optimize for reducing cycle fluctuations dataIndex = list(range(numSamples)) for i in range(numSamples): alpha = 4.0 / (1.0 + k + i) + 0.01 randIndex = int(random.uniform(0, len(dataIndex))) output = sigmoid(train_x[randIndex, :] * weights) error = train_y[randIndex, 0] - output weights = weights + alpha * train_x[randIndex, :].transpose() * error del (dataIndex[randIndex]) # during one interation, delete the optimized sample else: raise NameError('Not support optimize method type!') print('Congratulations, training complete! Took %fs!' % (time.time() - startTime)) return weights # test your trained Logistic Regression model given test set def testLogRegres(weights, test_x, test_y): numSamples, numFeatures = shape(test_x) matchCount = 0 for i in range(numSamples): predict = sigmoid(test_x[i, :] * weights)[0, 0] > 0.5 if predict == bool(test_y[i, 0]): matchCount += 1 accuracy = float(matchCount) / numSamples return accuracy # show your trained logistic regression model only available with 2-D data def showLogRegres(weights, train_x, train_y): # notice: train_x and train_y is mat datatype numSamples, numFeatures = shape(train_x) if numFeatures != 3: print("Sorry! I can not draw because the dimension of your data is not 2!") return 1 # draw all samples for i in range(numSamples): if int(train_y[i, 0]) == 0: plt.plot(train_x[i, 1], train_x[i, 2], 'or') elif int(train_y[i, 0]) == 1: plt.plot(train_x[i, 1], train_x[i, 2], 'ob') # draw the classify line min_x = min(train_x[:, 1])[0, 0] max_x = max(train_x[:, 1])[0, 0] weights = weights.getA() # convert mat to array y_min_x = float(-weights[0] - weights[1] * min_x) / weights[2] y_max_x = float(-weights[0] - weights[1] * max_x) / weights[2] plt.plot([min_x, max_x], [y_min_x, y_max_x], '-g') plt.xlabel('X1'); plt.ylabel('X2') plt.show() def loadData(): train_x = [] train_y = [] fileIn = open('lr.txt',encoding="utf-8") for line in fileIn.readlines(): lineArr = line.strip().split() print("++++:",lineArr[0]) print("---",float(lineArr[1])) train_x.append([1.0, float(lineArr[0]), float(lineArr[1])]) train_y.append(float(lineArr[2])) return mat(train_x), mat(train_y).transpose() ## step 1: load data print "step 1: load data..." train_x, train_y = loadData() test_x = train_x; test_y = train_y ## step 2: training... print("step 2: training...") opts = {'alpha': 0.01, 'maxIter': 20, 'optimizeType': 'smoothStocGradDescent'} optimalWeights = trainLogRegres(train_x, train_y, opts) ## step 3: testing print("step 3: testing...") accuracy = testLogRegres(optimalWeights, test_x, test_y) ## step 4: show the result print("step 4: show the result...") print('The classify accuracy is: %.3f%%' % (accuracy * 100)) showLogRegres(optimalWeights, train_x, train_y)

lr.txt

-0.017612 14.053064 0

-1.395634 4.662541 1

-0.752157 6.538620 0

-1.322371 7.152853 0

0.423363 11.054677 0

0.406704 7.067335 1

0.667394 12.741452 0

-2.460150 6.866805 1

0.569411 9.548755 0

-0.026632 10.427743 0

0.850433 6.920334 1

1.347183 13.175500 0

1.176813 3.167020 1

-1.781871 9.097953 0

-0.566606 5.749003 1

0.931635 1.589505 1

-0.024205 6.151823 1

-0.036453 2.690988 1

-0.196949 0.444165 1

1.014459 5.754399 1

1.985298 3.230619 1

-1.693453 -0.557540 1

-0.576525 11.778922 0

-0.346811 -1.678730 1

-2.124484 2.672471 1

1.217916 9.597015 0

-0.733928 9.098687 0

-3.642001 -1.618087 1

0.315985 3.523953 1

1.416614 9.619232 0

-0.386323 3.989286 1

0.556921 8.294984 1

1.224863 11.587360 0

-1.347803 -2.406051 1

1.196604 4.951851 1

0.275221 9.543647 0

0.470575 9.332488 0

-1.889567 9.542662 0

-1.527893 12.150579 0

-1.185247 11.309318 0

-0.445678 3.297303 1

1.042222 6.105155 1

-0.618787 10.320986 0

1.152083 0.548467 1

0.828534 2.676045 1

-1.237728 10.549033 0

-0.683565 -2.166125 1

0.229456 5.921938 1

-0.959885 11.555336 0

0.492911 10.993324 0

0.184992 8.721488 0

-0.355715 10.325976 0

-0.397822 8.058397 0

0.824839 13.730343 0

1.507278 5.027866 1

0.099671 6.835839 1

-0.344008 10.717485 0

1.785928 7.718645 1

-0.918801 11.560217 0

-0.364009 4.747300 1

-0.841722 4.119083 1

0.490426 1.960539 1

-0.007194 9.075792 0

0.356107 12.447863 0

0.342578 12.281162 0

-0.810823 -1.466018 1

2.530777 6.476801 1

1.296683 11.607559 0

0.475487 12.040035 0

-0.783277 11.009725 0

0.074798 11.023650 0

-1.337472 0.468339 1

-0.102781 13.763651 0

-0.147324 2.874846 1

0.518389 9.887035 0

1.015399 7.571882 0

-1.658086 -0.027255 1

1.319944 2.171228 1

2.056216 5.019981 1

-0.851633 4.375691 1

-1.510047 6.061992 0

-1.076637 -3.181888 1

1.821096 10.283990 0

3.010150 8.401766 1

-1.099458 1.688274 1

-0.834872 -1.733869 1

-0.846637 3.849075 1

1.400102 12.628781 0

1.752842 5.468166 1

0.078557 0.059736 1

0.089392 -0.715300 1

1.825662 12.693808 0

0.197445 9.744638 0

0.126117 0.922311 1

-0.679797 1.220530 1

0.677983 2.556666 1

0.761349 10.693862 0

-2.168791 0.143632 1

1.388610 9.341997 0

0.317029 14.739025 0

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?