softmax regission

好,接下来说一说softmax,上一个随笔介绍了logistic 回归,但是logistic基本上都是用在二分类问题上,也就是他能分辨出一个样本究竟是A还是B,但如果多出一个C选项的话系统就不能很好的工作了.而softmax就是用来处理多分类问题得.

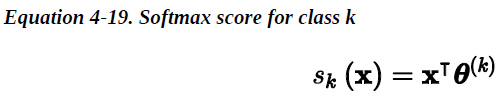

softmax regression的思想是这样的,当给定实例x时,Softmax回归模型首先为每个类别k计算该x的得分s(x),然后通过将Softmax函数应用于得分来估计每个类别的概率。

计算得分s(x)的方程应该看起来很熟悉,

要注意的是其中的θk并不是一组参数,而是一个元组对象,对于每个类别k,都有一个独一无二的θ值去计算分数.

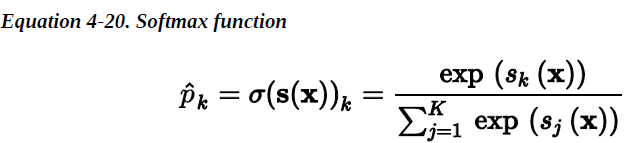

一旦为实例x计算了每个类别的分数,就可以通过softmax函数再次计算这些分数,从而估算出该实例属于类别k的概率。

该函数计算每个分数的指数,然后对其进行归一化(除以所有指数的总和)。

在这个式子中,k是类别k=1,2,3,...n, s(x)k是指实例对于这个类别k的分数,σ(s(x))是实例x属于类别k的估计概率.

那么这个方程中最重要的是什么呢?就是怎么求θ.其实所有的回归问题都可以总结成一个问题,如何求得一组最合适的参数.

还是老样子,构建一个合适的cost function,然后用梯度下降法一点一点的迭代出最优解.

那我们之前就说了,cross entropy是一个在分类回归

本文介绍了softmax回归用于多分类问题的基本思想和计算流程。首先,解释了softmax函数如何从得分转化为类别概率,并展示了softmax回归的参数θ求解过程。接着,讨论了交叉熵作为成本函数,以及其对应的梯度下降更新规则。最后,通过对比与逻辑回归的相似性,强调了在多类别情况下softmax的适用性,并以三分类问题为例说明迭代优化过程。

本文介绍了softmax回归用于多分类问题的基本思想和计算流程。首先,解释了softmax函数如何从得分转化为类别概率,并展示了softmax回归的参数θ求解过程。接着,讨论了交叉熵作为成本函数,以及其对应的梯度下降更新规则。最后,通过对比与逻辑回归的相似性,强调了在多类别情况下softmax的适用性,并以三分类问题为例说明迭代优化过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?