目录

第二颗树,根据梯度提升,减小残差(残差越小,结果越好,越准确)

导包

概念:导数求导后还是自身

import numpy as np

# f(x) = 3*x**2

# 梯度=导数

from sklearn.ensemble import GradientBoostingClassifier

from sklearn import datasets

from sklearn.model_selection import train_test_split梯度提升树也是建在决策树的基础上的。

X,y = datasets.load_iris(True)

X_train,X_test,y_train,y_test = train_test_split(X,y,test_size = 0.2)

gbdt = GradientBoostingClassifier(n_estimators=10)

gbdt.fit(X_train,y_train)

gbdt.score(X_test,y_test)

![]()

gbdt.n_estimators_![]()

gbdt.estimators_.shape![]()

树分10份,每份中是3棵树,每棵树都是多分类问题

减少类别,假设只有两类点,用一棵树就能分开了。

X,y = datasets.load_iris(True)

cond = y!=2#0,1

X = X[cond]

y = y[cond]

X_train,X_test,y_train,y_test = train_test_split(X,y,test_size = 0.2)gbdt.estimators_.shape![]()

二分类只需一棵树就行了。

梯度提升树原理

导包

import numpy as np

import matplotlib.pyplot as plt

%matplotlib inline

# 回归是分类的极限思想

# 分类的类别多到一定程度,那么就是回归

from sklearn.ensemble import GradientBoostingClassifier,GradientBoostingRegressor

from sklearn import tree导入数据

# X数据:上网时间和购物金额

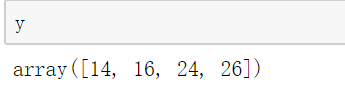

# y目标:14(高一),16(高三),24(大学毕业),26(工作两年)

X = np.array([[800,3],[1200,1],[1800,4],[2500,2]])

y = np.array([14,16,24,26])#年龄声明树

# 梯度提升树用于分类,森林,集成算法,基本树(决策树,分类树)

# 用到的是,回归树

gbdt = GradientBoostingClassifier(n_estimators=10)

gbdt.fit(X,y)

gbdt.predict(X)![]()

使用回归研究其原理

# 使用回归,数据连续的

gbdt = GradientBoostingRegressor(n_estimators=10)

gbdt.fit(X,y)

gbdt.predict(X)![]()

plt.rcParams['font.sans-serif'] = 'KaiTi'

plt.figure(figsize=(9,6))

_=tree.plot_tree(gbdt[0,0],filled=True,feature_names=['消费','上网'])

26为均方误差

# mse mean-square-error:均方误差 ;均方误差越小,数据越准确。

((y - y.mean())**2).mean()![]()

14,16代表高中生。

((y[:2] - y[:2].mean())**2).mean()![]()

第二棵决策树

plt.rcParams['font.sans-serif'] = 'KaiTi'

plt.figure(figsize=(9,6))

_ = tree.plot_tree(gbdt[0,0],filled=True,feature_names=['消费','上网'])

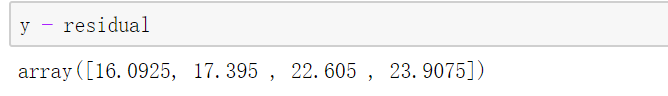

以下数据为残差

![]()

原因

第二颗树,根据梯度提升,减小残差(残差越小,结果越好,越准确)

# learning_rate = 0.1

gbdt1 = np.array([-6,-4,6,4])

# 梯度提升 学习率0.1

gbdt1 - gbdt1*0.1![]()

同理可求的最后一棵树的残差,根据最后一棵树的残差,计算了算法最终的预测值。给100棵树,梯度提升一百次,给1千棵树,梯度提升1000次。

直接使用算法predict返回的值,和手算一模一样。

6160

6160

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?