BP神经网络预测,MATLAB代码

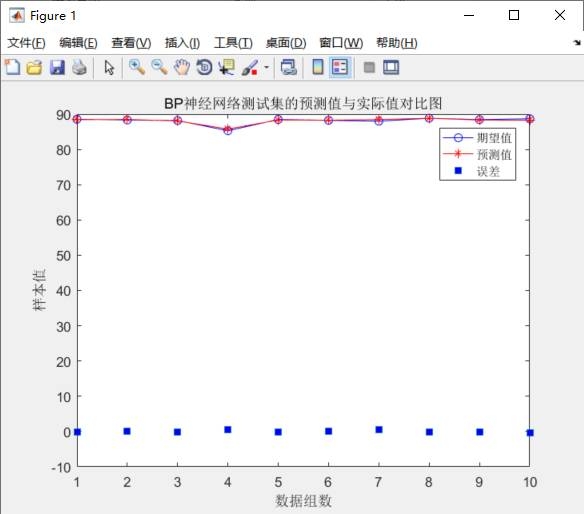

多输入单输出,结果如图,换数据直接用,附样本数据。

ID:715678625093922

谷神星直率的葵花

在计算机科学领域,BP神经网络是一种常用的预测模型。它基于神经网络的基本架构,通过一系列计算和迭代的过程,能够对数据进行预测和分类。本文旨在介绍BP神经网络预测的原理和应用,并提供相关的MATLAB代码和样本数据。

首先,我们来了解一下BP神经网络的基本原理。BP神经网络是一种具有反馈机制的前馈神经网络,能够通过对已知数据的学习和训练,建立起输入与输出之间的映射关系。其核心思想是通过调整连接权值和阈值,使得网络的输出与样本数据的输出尽可能接近。BP神经网络通常包含输入层、隐藏层和输出层,其中隐藏层的节点数量可以根据实际问题的需要进行设置。

在使用BP神经网络进行预测时,我们需要事先准备好训练数据和测试数据。训练数据用于调整网络的连接权值和阈值,而测试数据则用于评估模型的预测性能。在进行训练之前,我们需要对数据进行一定的预处理,如归一化处理或标准化处理,以提高预测的准确性。

在MATLAB中,我们可以使用神经网络工具箱来实现BP神经网络的预测。具体步骤如下:

-

导入数据:将样本数据导入MATLAB工作环境中。可以使用csvread()函数或其他相关函数进行数据的读取和导入。

-

数据预处理:对导入的数据进行预处理操作,如归一化处理。可以使用mapminmax()函数来进行数据的归一化处理。

-

构建网络:定义BP神经网络的结构,包括输入层、隐藏层和输出层的节点数量。可以使用newff()函数来创建一个新的BP神经网络。

-

训练网络:使用训练数据对神经网络进行训练。可以使用train()函数来进行网络的训练,其中可以设置训练的最大迭代次数和训练的误差容限。

-

预测结果:使用训练好的神经网络对测试数据进行预测。可以使用sim()函数来进行预测,其中输入参数为测试数据。

通过以上步骤,我们可以得到BP神经网络的预测结果。预测结果可以通过绘制图形的方式进行可视化展示,以便更直观地观察预测效果。同时,我们也可以通过对不同数据集的测试,评估模型的预测性能和准确度。

本文附上了相关的MATLAB代码和样本数据,以便读者更好地理解和实践BP神经网络的预测。读者可以根据自己的需求,进行代码的调整和实验。通过反复实践和调整参数,可以不断优化预测模型的准确性和鲁棒性。

总结而言,BP神经网络是一种常用的预测模型,在多个领域都有广泛的应用。通过对已知数据的学习和训练,BP神经网络能够对未知数据进行准确的预测和分类。MATLAB提供了方便易用的神经网络工具箱,可以方便地实现BP神经网络的预测。希望本文能够对读者有所帮助,引发对BP神经网络的研究和应用的兴趣。尽管本文只是简要介绍了BP神经网络的原理和应用,但读者可以根据自己的需求和兴趣,进一步深入研究和探索该领域的更多内容。

致谢:感谢读者对本文的阅读和关注。本文所述部分内容参考了相关文献和资料,特此致谢。同时,也感谢MATLAB提供了方便易用的神经网络工具箱,使得BP神经网络的实现变得更加便捷。希望本文能够为读者在BP神经网络的研究和应用中提供一定的帮助。如有任何问题或建议,欢迎随时与作者交流。最后,祝愿读者在技术研究和应用中取得更大的成就!

相关的代码,程序地址如下:http://matup.cn/678625093922.html

3925

3925

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?