沐神视频:

https://www.bilibili.com/video/BV1L64y1m7Nh?p=3&vd_source=302f06b1d8c88e3138547635c3f4de52

沐神代码:

https://zh-v2.d2l.ai/chapter_convolutional-neural-networks/conv-layer.html

卷积层代码解析

import torch

from torch import nn

from d2l import torch as d2l

#定义二维卷积层

#Conv2d(输入通道数,输出通道数,卷积核形状1x2,不适用偏置项)

conv2d=nn.Conv2d(1,1,kernel_size=(1,2),bias=False)

#这里沐神的是 reshape(批量大小,输入通道数,高度,宽度),我为了让代码运行改成了randn

X = torch.randn(1, 1, 6, 8)

Y = torch.randn(1, 1, 6, 7)

lr=3e-2

for i in range(10):

Y_hat=conv2d(X)

l=(Y_hat-Y)**2

conv2d.zero_grad()

#注意l.sum.backward与l.backward是不同的

l.sum().backward()

#注意与下方对比这里使用的是手动更新梯度,其实也可以使用SGD优化器更新

conv2d.weight.data[:] -= lr * conv2d.weight.grad

if (i + 1) % 2 == 0:

print(f'epoch {i+1}, loss {l.sum():.3f}')

线性回归代码对比

#这是线性回归的大体流程可以与上面做对比

net = nn.Sequential(nn.Linear(2, 1))

loss = nn.MSELoss()

trainer = torch.optim.SGD(net.parameters(), lr=0.03)

num_epochs = 3

for epoch in range(num_epochs):

### X为特征值 y为标签值

for X, y in data_iter:

### 计算该模型下的损失函数

l = loss(net(X) ,y)

### 清零梯度 因为是靠梯度进行下降的 所以先清除之前的梯度

trainer.zero_grad()

### 通过反向传播计算新梯度

l.backward()

### 更新参数模型

trainer.step()

l = loss(net(features), labels)

print(f'epoch {epoch + 1}, loss {l:f}')

值得注意的是

函数的区别

l.sum().backward():这一行代码会计算损失张量 l 中所有元素的梯度之和,并将这个梯度值反向传播到模型的参数中。这个方法通常在计算平均损失时使用,因为在计算梯度时会考虑到损失中所有元素的贡献。

l.backward():这一行代码会计算损失张量 l 中每个元素的梯度,并将这些梯度值反向传播到模型的参数中。这个方法通常在计算损失时使用,但不会对损失张量中的每个元素都做同等对待,而是将每个元素的梯度值视为一个单独的贡献。

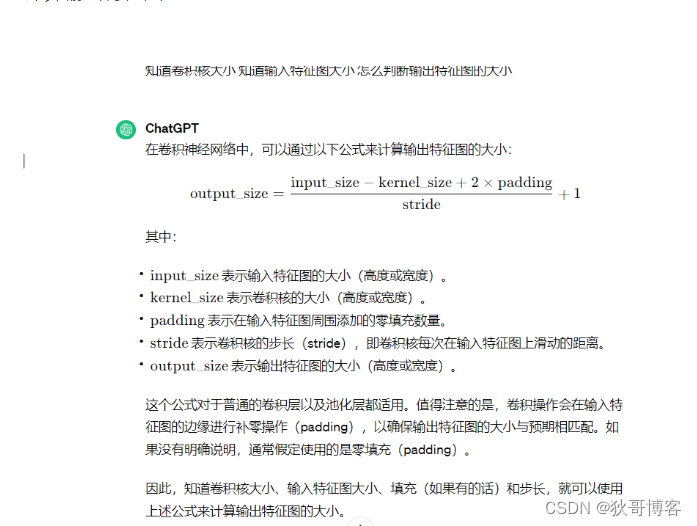

输出特征图的形状如何计算

506

506

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?