>- **🍨 本文为[🔗365天深度学习训练营](https://mp.weixin.qq.com/s/0dvHCaOoFnW8SCp3JpzKxg) 中的学习记录博客**

>- **🍖 原作者:[K同学啊](https://mtyjkh.blog.csdn.net/)**代码:

#%%

import matplotlib

import matplotlib.pyplot as plt

from torchvision.transforms import transforms

from torch.utils.data import DataLoader

from torchvision import datasets

import torchvision.models as models

import torch.nn.functional as F

import torch.nn as nn

import torch, torchvision

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

device

#%%

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

device

#%%

import os, PIL, random, pathlib

import matplotlib.pyplot as plt

# 支持中文

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

data_dir = './015_licence_plate/015_licence_plate'

data_dir = pathlib.Path(data_dir)

# print(data_dir)

data_paths = list(data_dir.glob('*'))

# print(data_paths)

classeNames = [str(path).split("\\")[-1].split("_")[1].split(".")[0] for path in data_paths]

print(len(classeNames))

print(classeNames)

#%%

data_paths = list(data_dir.glob('*'))

data_paths_str = [str(path) for path in data_paths]

data_paths_str

#%%

import os

os.environ["KMP_DUPLICATE_LIB_OK"] = "TRUE"

plt.figure(figsize=(14, 5))

plt.suptitle("数据示例(K同学啊)", fontsize=15)

for i in range(18):

plt.subplot(3, 6, i + 1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

# 显示图片

images = plt.imread(data_paths_str[i])

plt.imshow(images)

plt.show()

#%%

import numpy as np

char_enum = ["京", "沪", "津", "渝", "冀", "晋", "蒙", "辽", "吉", "黑", "苏", "浙", "皖", "闽", "赣", "鲁", \

"豫", "鄂", "湘", "粤", "桂", "琼", "川", "贵", "云", "藏", "陕", "甘", "青", "宁", "新", "军", "使"]

number = [str(i) for i in range(0, 10)] # 0 到 9 的数字

alphabet = [chr(i) for i in range(65, 91)] # A 到 Z 的字母

char_set = char_enum + number + alphabet

char_set_len = len(char_set)

label_name_len = len(classeNames[0])

# 将字符串数字化

def text2vec(text):

vector = np.zeros([label_name_len, char_set_len])

for i, c in enumerate(text):

idx = char_set.index(c)

vector[i][idx] = 1.0

return vector

all_labels = [text2vec(i) for i in classeNames]

#%%

import os

import pandas as pd

from torchvision.io import read_image

from torch.utils.data import Dataset

import torch.utils.data as data

from PIL import Image

class MyDataset(data.Dataset):

def __init__(self, all_labels, data_paths_str, transform):

self.img_labels = all_labels # 获取标签信息

self.img_dir = data_paths_str # 图像目录路径

self.transform = transform # 目标转换函数

def __len__(self):

return len(self.img_labels)

def __getitem__(self, index):

image = Image.open(self.img_dir[index]).convert(

'RGB') #plt.imread(self.img_dir[index]) # 使用 torchvision.io.read_image 读取图像

label = self.img_labels[index] # 获取图像对应的标签

if self.transform:

image = self.transform(image)

return image, label # 返回图像和标签

#%%

# 缺少

# 定义数据转换

train_transforms = transforms.Compose([

transforms.Resize([224, 224]), # 将输入图片resize成统一尺寸

transforms.ToTensor(), # 将PIL Image或numpy.ndarray转换为tensor,并归一化到[0,1]之间

transforms.Normalize( # 标准化处理-->转换为标准正太分布(高斯分布),使模型更容易收敛

mean=[0.485, 0.456, 0.406],

std =[0.229, 0.224, 0.225]) # 其中 mean=[0.485,0.456,0.406]与std=[0.229,0.224,0.225] 从数据集中随机抽样计算得到的。

])

total_data = MyDataset(all_labels, data_paths_str, train_transforms)

train_size = int(0.8 * len(total_data))

test_size = len(total_data) - train_size

train_dataset, test_dataset = torch.utils.data.random_split(total_data, [train_size, test_size])

train_size, test_size

#%%

train_loader = torch.utils.data.DataLoader(train_dataset,

batch_size=16,

shuffle=True)

test_loader = torch.utils.data.DataLoader(test_dataset,

batch_size=16,

shuffle=True)

print("The number of images in a training set is: ", len(train_loader) * 16)

print("The number of images in a test set is: ", len(test_loader) * 16)

print("The number of batches per epoch is: ", len(train_loader))

#%%

for X, y in test_loader:

print("Shape of X [N, C, H, W]: ", X.shape)

print("Shape of y: ", y.shape, y.dtype)

break

#%%

class Network_bn(nn.Module):

def __init__(self):

super(Network_bn, self).__init__()

"""

nn.Conv2d()函数:

第一个参数(in_channels)是输入的channel数量

第二个参数(out_channels)是输出的channel数量

第三个参数(kernel_size)是卷积核大小

第四个参数(stride)是步长,默认为1

第五个参数(padding)是填充大小,默认为0

"""

self.conv1 = nn.Conv2d(in_channels=3, out_channels=12, kernel_size=5, stride=1, padding=0)

self.bn1 = nn.BatchNorm2d(12)

self.conv2 = nn.Conv2d(in_channels=12, out_channels=12, kernel_size=5, stride=1, padding=0)

self.bn2 = nn.BatchNorm2d(12)

self.pool = nn.MaxPool2d(2, 2)

self.conv4 = nn.Conv2d(in_channels=12, out_channels=24, kernel_size=5, stride=1, padding=0)

self.bn4 = nn.BatchNorm2d(24)

self.conv5 = nn.Conv2d(in_channels=24, out_channels=24, kernel_size=5, stride=1, padding=0)

self.bn5 = nn.BatchNorm2d(24)

self.fc1 = nn.Linear(24 * 50 * 50, label_name_len * char_set_len)

self.reshape = Reshape([label_name_len, char_set_len])

def forward(self, x):

x = F.relu(self.bn1(self.conv1(x)))

x = F.relu(self.bn2(self.conv2(x)))

x = self.pool(x)

x = F.relu(self.bn4(self.conv4(x)))

x = F.relu(self.bn5(self.conv5(x)))

x = self.pool(x)

x = x.view(-1, 24 * 50 * 50)

x = self.fc1(x)

# 最终reshape

x = self.reshape(x)

return x

# 定义Reshape层

class Reshape(nn.Module):

def __init__(self, shape):

super(Reshape, self).__init__()

self.shape = shape

def forward(self, x):

return x.view(x.size(0), *self.shape)

device = "cuda" if torch.cuda.is_available() else "cpu"

print("Using {} device".format(device))

model = Network_bn().to(device)

model

#%%

import torchsummary

''' 显示网络结构 '''

torchsummary.summary(model, (3, 224, 224))

#%%

optimizer = torch.optim.Adam(model.parameters(),

lr=1e-4,

weight_decay=0.0001)

loss_model = nn.CrossEntropyLoss()

#%%

from torch.autograd import Variable

def test(model, test_loader, loss_model):

size = len(test_loader.dataset)

num_batches = len(test_loader)

model.eval()

test_loss, correct = 0, 0

with torch.no_grad():

for X, y in test_loader:

X, y = X.to(device), y.to(device)

pred = model(X)

test_loss += loss_model(pred, y).item()

test_loss /= num_batches

print(f"Avg loss: {test_loss:>8f} \n")

return correct, test_loss

def train(model, train_loader, loss_model, optimizer):

model = model.to(device)

model.train()

for i, (images, labels) in enumerate(train_loader, 0): #0是标起始位置的值。

images = Variable(images.to(device))

labels = Variable(labels.to(device))

optimizer.zero_grad()

outputs = model(images)

loss = loss_model(outputs, labels)

loss.backward()

optimizer.step()

if i % 1000 == 0:

print('[%5d] loss: %.3f' % (i, loss))

#%%

test_acc_list = []

test_loss_list = []

epochs = 30

for t in range(epochs):

print(f"Epoch {t + 1}\n-------------------------------")

train(model, train_loader, loss_model, optimizer)

test_acc, test_loss = test(model, test_loader, loss_model)

test_acc_list.append(test_acc)

test_loss_list.append(test_loss)

print("Done!")

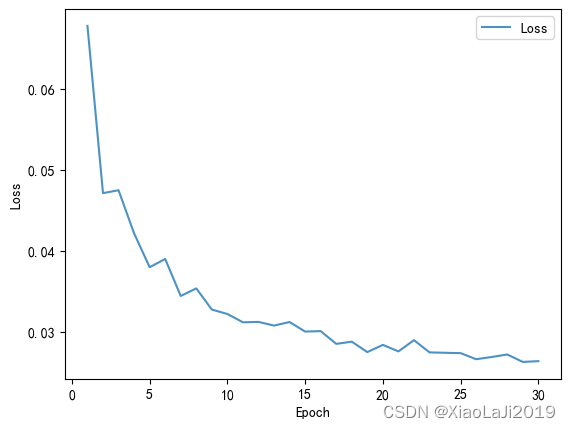

#%%

import numpy as np

import matplotlib.pyplot as plt

x = [i for i in range(1, 31)]

plt.plot(x, test_loss_list, label="Loss", alpha=0.8)

plt.xlabel("Epoch")

plt.ylabel("Loss")

plt.legend()

plt.show()

总结:

优点

- 有效特征提取:通过多层卷积层和池化层,可以有效提取图像的局部特征,并通过批归一化层提高训练的稳定性和收敛速度。

- 网络结构简单明了:设计简洁,层数适中,易于理解和实现。

- 合理的数据预处理:使用了标准的图像预处理方法(如归一化、尺寸调整),有助于模型的训练和性能提升。

- 适合小数据集:相对于深层网络,该结构更适合用于小数据集,训练速度快,避免过拟合。

缺点

- 泛化能力有限:网络层数较少,参数较少,可能限制了模型的表达能力,在更复杂的任务中可能表现不佳。

- 对噪声敏感:没有加入正则化手段,如 dropout,容易受到噪声的干扰。

- 适应性差:针对特定任务设计的网络,若应用于其他任务,可能需要重新调整和优化。

运行结果分析

从训练过程中损失曲线图来看,损失在训练初期迅速下降,在训练后期趋于平稳,说明模型在训练过程中不断学习和优化,逐渐收敛。最终损失稳定在一个较低的值,表明模型性能较好。具体结果如下:

- 训练效果:损失在前几个 epoch 下降迅速,之后缓慢下降,表明模型逐渐学习到了图像的特征。

- 收敛性:在第20个 epoch 左右,损失基本趋于平稳,说明模型基本达到了收敛状态。

综上所述,该模型适用于车牌识别任务,但在更复杂的场景或数据量较大的情况下,可能需要进一步优化模型结构和训练策略,以提高泛化能力和鲁棒性。

优化方向

-

增加网络深度

- 更多卷积层:增加卷积层的数量,以提取更高层次的特征。

- 残差网络(ResNet):使用残差块可以在增加网络深度的同时,缓解梯度消失的问题,提高模型的表达能力。

-

正则化手段

- Dropout:在全连接层或卷积层后使用 dropout,可以减少过拟合,提高模型的泛化能力。

- L2 正则化:在损失函数中加入 L2 正则化项,可以限制模型参数的大小,减少过拟合风险。

-

优化算法

- 学习率调度:使用学习率调度器,如阶梯式下降、余弦退火等,可以在训练过程中动态调整学习率,提升训练效果。

- 优化器选择:尝试不同的优化器,如 AdamW、RMSprop 等,选择最适合当前任务的优化器。

-

预训练模型

- 迁移学习:使用在大规模数据集(如 ImageNet)上预训练的模型,进行迁移学习,可以在小数据集上快速获得较好的性能。

- 微调(Fine-tuning):在预训练模型的基础上,对特定任务进行微调,以适应特定的数据集和任务。

-

模型集成

- 多模型融合:使用多种模型进行融合,如 bagging、boosting 等方法,可以提高模型的鲁棒性和泛化能力。

- 软投票:在预测阶段,使用多个模型的预测结果进行加权平均,提高预测的准确性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?