在全民AI的2025年,我原以为大家都对MCP耳熟能详了,至少搞技术的都应该清楚是怎么回事。然而现实总是出人意料。

前两天,一家专门做大数据的公司找到我咨询MCP Server的事情。与他们开发交流的过程中,我惊讶地发现他们对MCP的基本概念,甚至最基础的Function Calling都了解得不是很清楚。最后,他们领导决定让我线上给团队做了一个培训。

(原定三小时,但我只用了两小时就给他们研发组所有人都讲得清清楚楚!)

更让我惊讶的是,今天一位建筑行业的大哥也来咨询Cursor中MCP Server的配置问题。看到他的投屏我才知道,现在连建筑行业都开始用MCP了!大哥说近期他们行业,包括他们公司,都在主推AI,有些人会使用3D绘图的MCP Server,还给我介绍了前段时间爆火的blender-mcp (https://github.com/ahujasid/blender-mcp) 项目。

虽然大哥目前配置的只是一个让模型能够进行深度有序思考的Server-Sequential Thinking,但他这种积极拥抱AI的态度着实让我感动。

这些经历让我意识到,尽管AI技术日新月异,但仍有许多人对MCP这样的基础概念不够了解。所以我决定写这篇博客,希望能帮助大家初步了解MCP,不至于在这个AI时代掉队。

什么是MCP?用最简单的话说

MCP,全称Model Context Protocol(模型上下文协议),是一个开放的标准协议,用于规范应用程序如何向AI模型提供上下文信息。(其实就是一个标准而且,不要想的太复杂。只不过这个标准是由Anthropic——做Claude模型的那个公司制定的,比较有权威性而已。)

想象一下,MCP就像AI世界的"USB-C接口":

-

USB-C让你的电脑能连接各种外设(显示器、硬盘、键盘等)

-

MCP让AI模型能连接各种数据源和工具(文件系统、数据库、API等)

简单说,MCP就是让AI能够"看见"和"操作"外部世界的标准接口。

换句话说,它只是一个中心化的翻译官,具体的任务还是需要对应工具去执行(对应到AI应用就是Funtion Calling,显示器、键盘等就是一个一个的tool。)

为什么我们需要MCP?

在没有MCP之前,让AI使用外部工具和数据是件麻烦事:

-

每集成一个新工具,你都要写特定的代码

-

不同AI供应商有不同的接口标准

-

数据安全问题难以统一管理

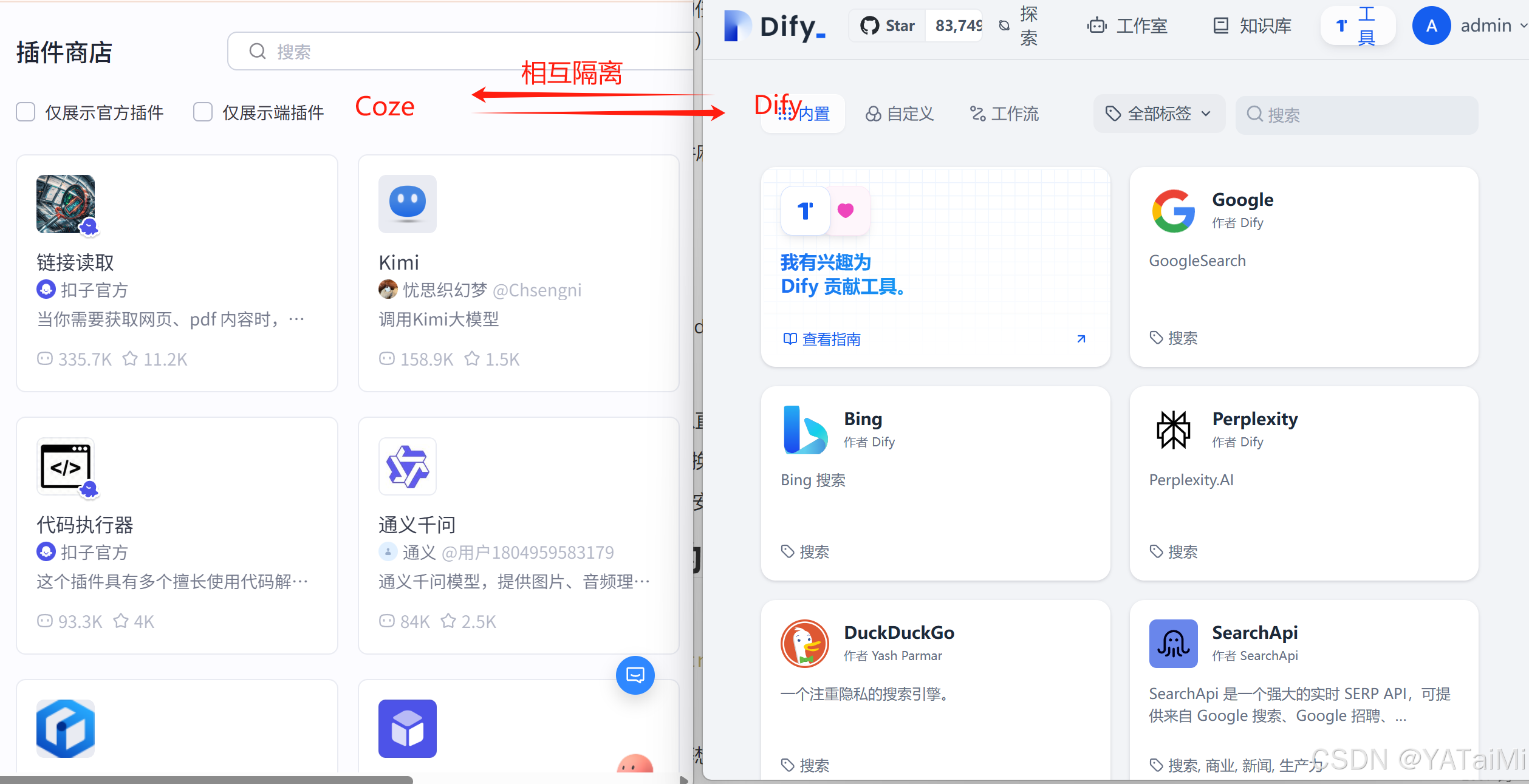

举一个比较通俗的例子,就像你的GPT插件Claude用不了,或者你的Dify插件Coze用不了。

MCP解决了这些问题,它提供:

-

预构建集成:有大量现成的MCP服务器可以直接使用

-

灵活切换:可以轻松在不同AI供应商之间切换

-

安全标准:确保你的数据在你的基础设施内安全处理

就像有了JDBC规范,你可以随便连接使用任何实现这个规范的数据库(软件史上每一次统一规范,必会带来一次重大的变革!)

MCP的基本架构是什么样的?

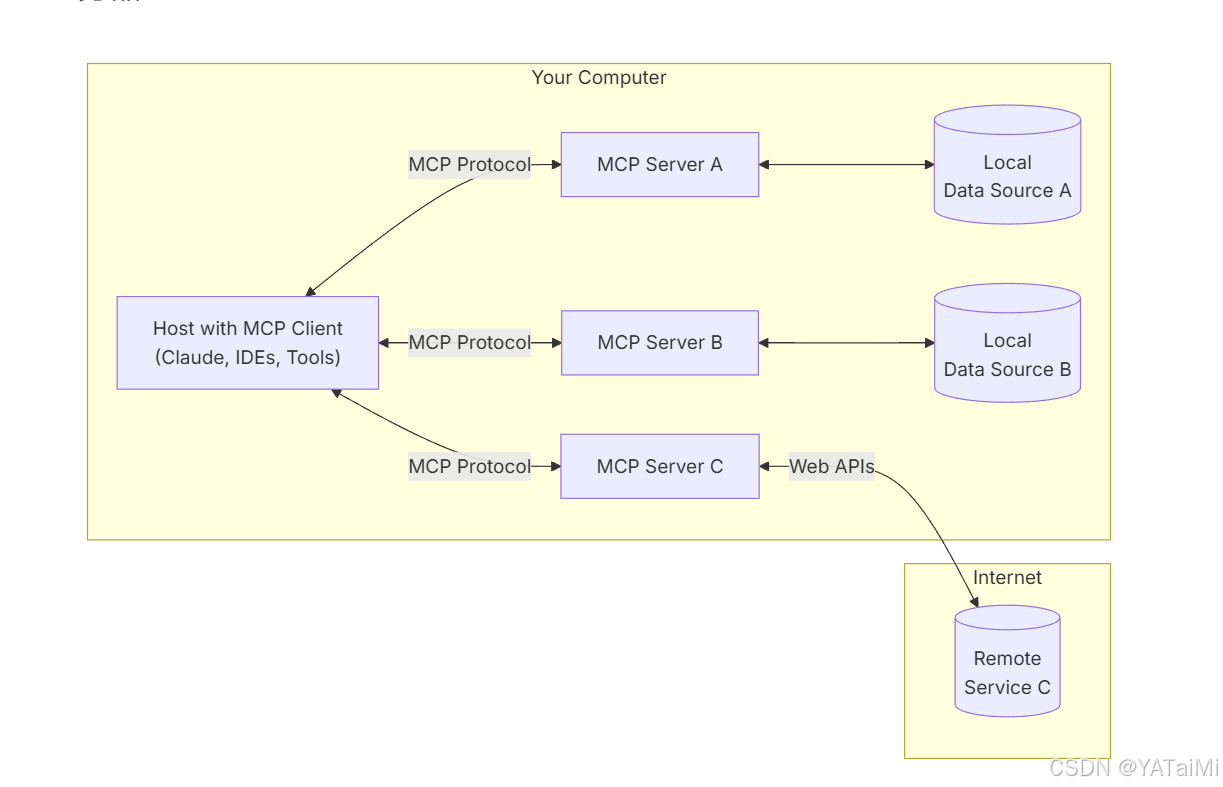

MCP采用经典的客户端-服务器架构:

(来自官方:Introduction - Model Context Protocol)

主要组件包括:

-

MCP Hosts:就是你用的 Claude Desktop、Cursor、Cline等想通过MCP访问数据的程序

-

MCP客户端:维持与服务器1:1连接的协议客户端

-

MCP服务器:通过标准化协议暴露特定功能的轻量级程序

-

数据源:可以是本地文件、数据库,也可以是远程API

打个比方:如果把AI模型比作"大脑",MCP服务器就像各种"感官"和"肢体",让AI能"看到"(读取数据)和"动手"(执行操作)。

MCP的核心概念

MCP定义了三个主要概念(也叫"原语"),让我们用最简单的类比来理解:

1. 资源(Resources)

类比:相当于AI的"眼睛"和"耳朵",让AI能"看到"和"听到"信息。

实际上是:允许AI读取数据的接口,比如文件内容、数据库信息等。

例子:

-

读取本地Excel文件

-

获取网页内容

-

查看数据库结构

2. 工具(Tools)

类比:相当于AI的"手",让AI能"做事"。

实际上是:允许AI执行操作的函数,比如修改文件、发送请求等。

例子:

-

发送电子邮件

-

查询数据库

-

生成图片

-

执行代码

3. 提示(Prompts)

类比:相当于AI的"工作指南",指导AI如何完成特定任务。

实际上是:可重用的模板,定义AI与用户交互的模式。

例子:

-

代码审查模板

-

数据分析向导

-

翻译助手

MCP在实际中是如何工作的?

让我们看一个简单例子,用MCP来完成一个任务:

假设你想让AI帮你分析一个Excel文件中的销售数据:

-

连接阶段:

-

你的Claude Desktop(主机)连接到Excel读取器MCP服务器

-

-

交互阶段:

-

你告诉Claude:"分析我的销售数据表"

-

Claude通过MCP的资源接口读取Excel文件内容

-

Claude分析数据后,可能想生成一个图表

-

Claude使用MCP的工具接口调用图表生成功能

-

最后Claude呈现分析结果和图表

-

整个过程中,Claude不需要直接访问你的文件系统,所有访问都通过受控的MCP接口完成,既安全又高效。

比如你想从一堆波多野结衣老师的视频里找到一个叫“猴子万爆出装教学”的视频,只需要让MCP Sever(自己人)去查询就行,Claude是不会发现那些波老师的视频的,极大地保护了用户隐私。

MCP的实际应用场景

MCP已经在各行各业得到应用:

-

软件开发:连接代码库、文档系统,辅助编码和调试

-

数据分析:连接各种数据源,进行复杂分析

-

内容创作:连接设计工具、CMS系统,辅助创作

-

客户服务:连接CRM系统,提供智能客服

-

建筑设计:正如前面提到的,连接3D建模工具

免费的MCP Server 网站:

Open-Source MCP servers | Glama

PulseMCP | Keep up-to-date with MCP

Smithery - Model Context Protocol Registry

https://github.com/punkpeye/awesome-mcp-servers

如何开始使用MCP?

根据你的角色不同,开始使用MCP的方式也不同:

作为用户

如果你只是想使用预建的MCP服务器:

-

安装支持MCP的客户端(如Claude Desktop、Cursor、Cline等)

-

按照指南配置需要的MCP服务器

-

开始使用增强的AI功能

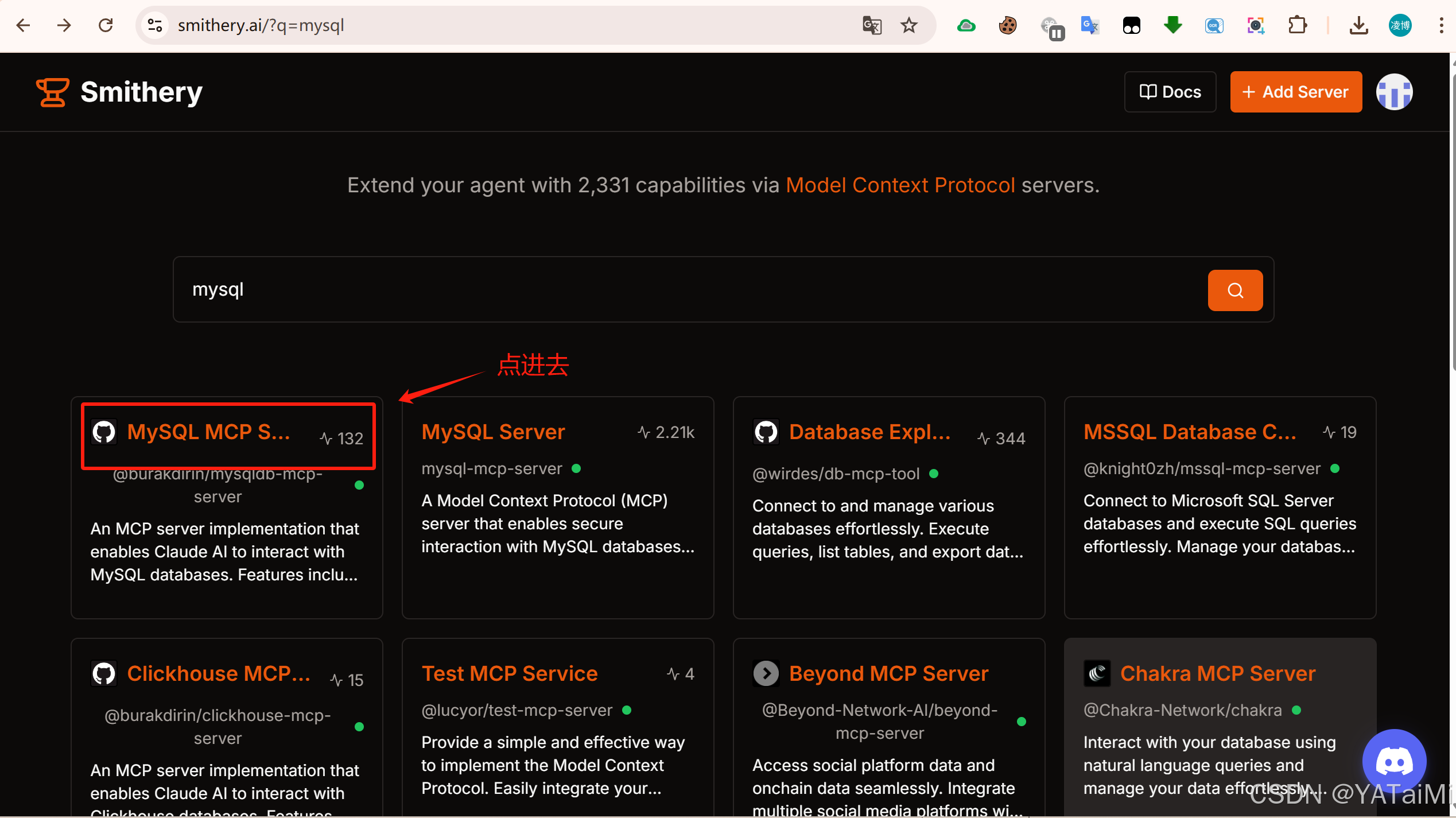

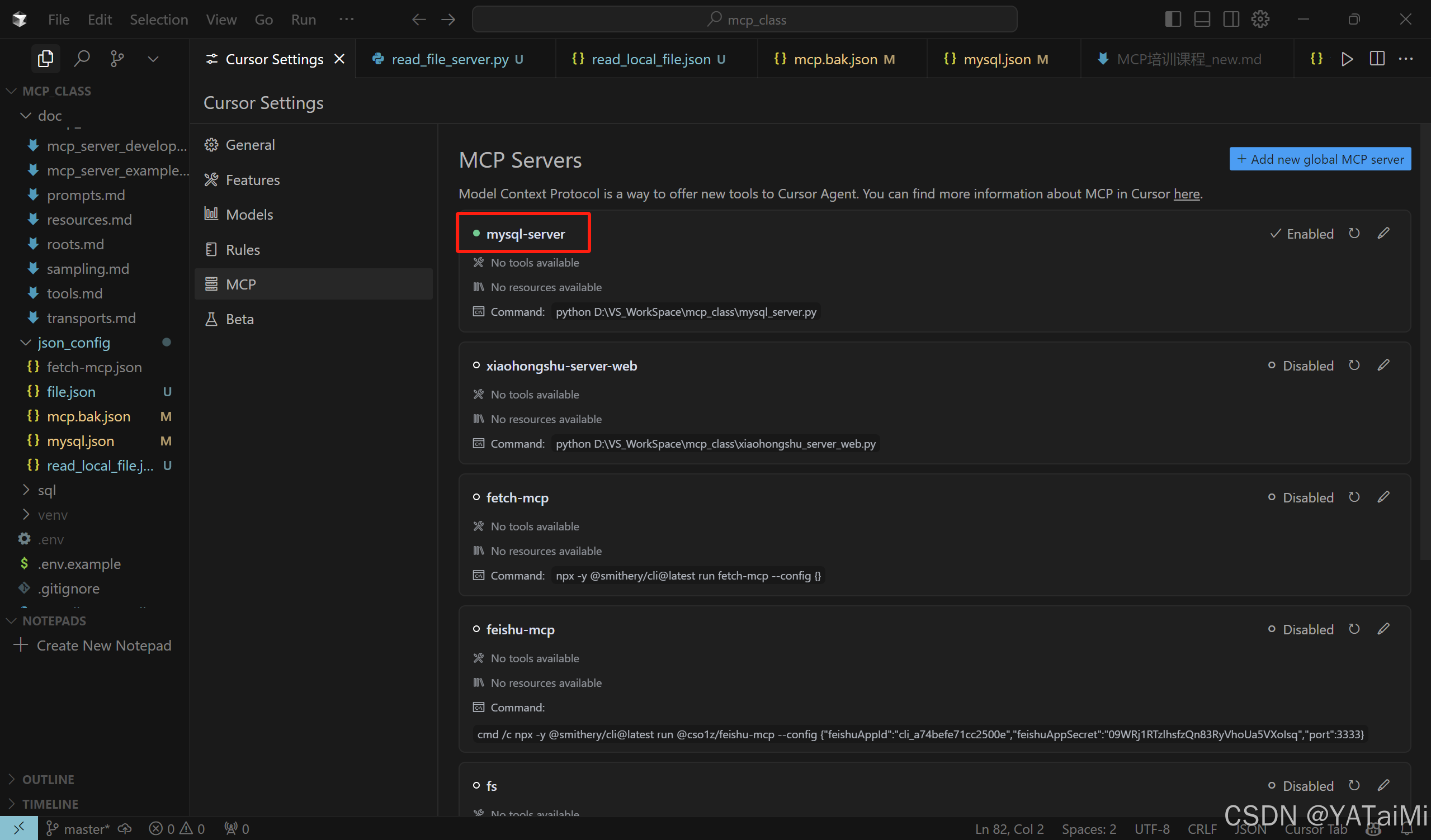

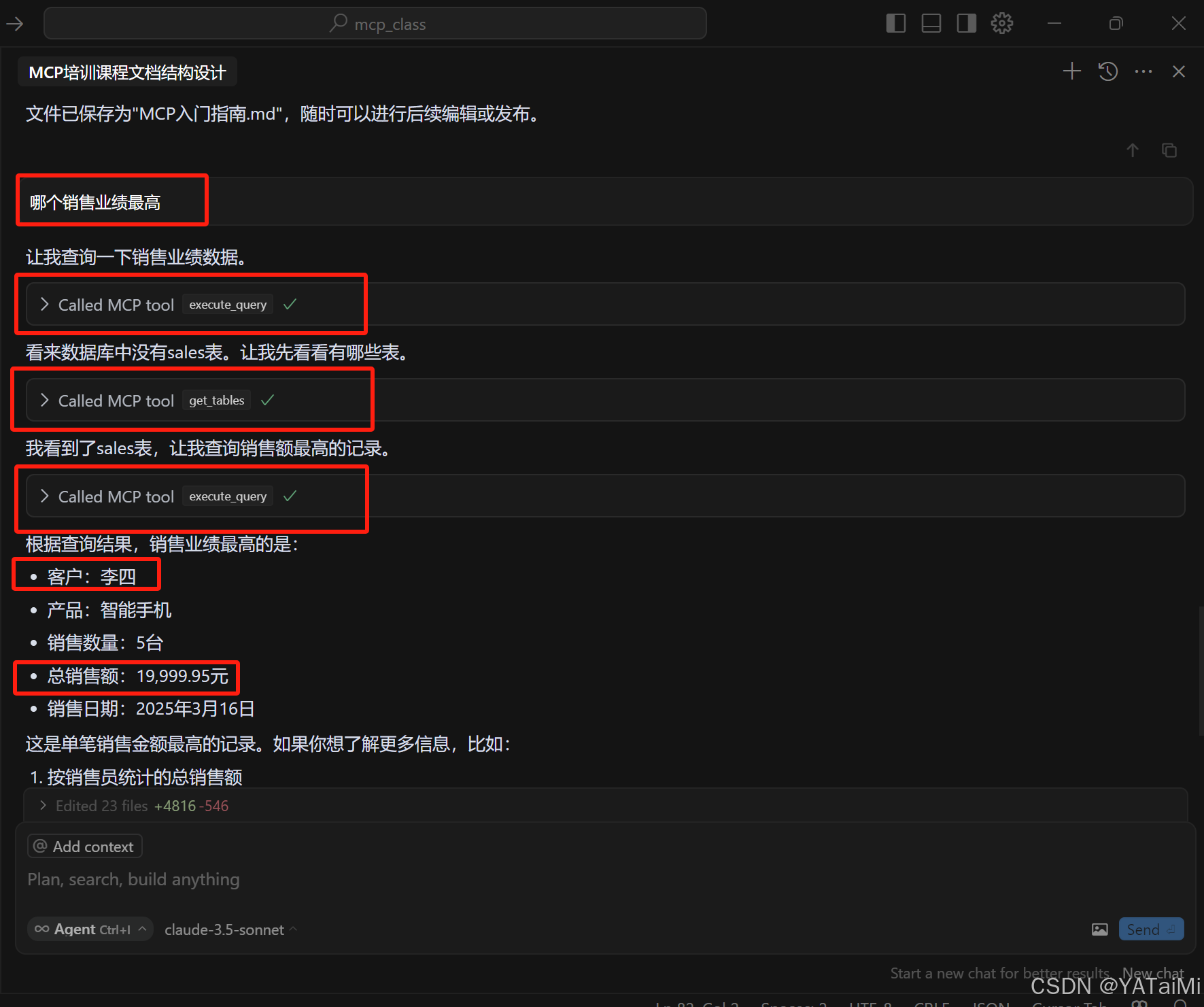

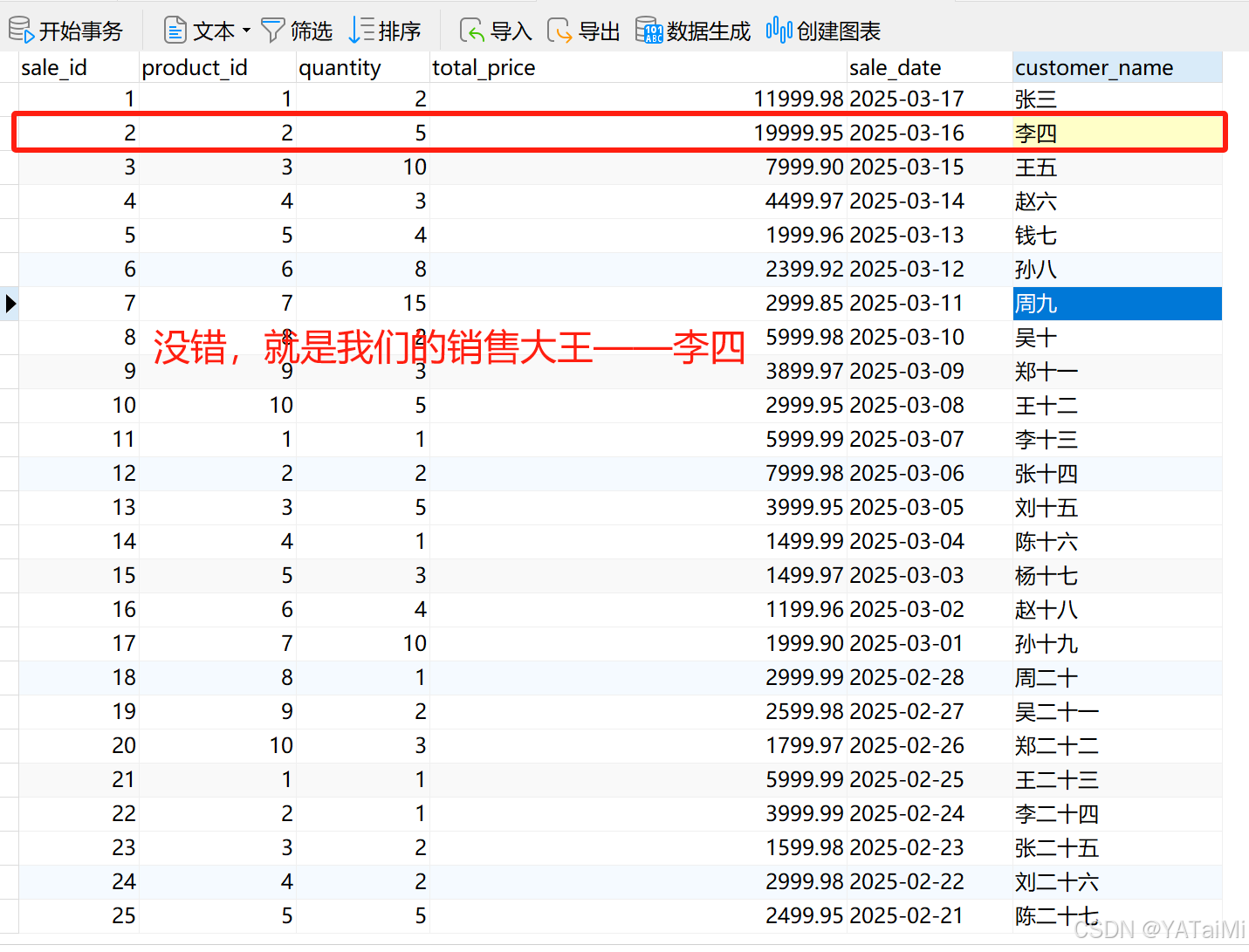

这里以Cursor为例演示配置一个可以连接MySQL的 MCP Server:

1. 在Smithery - Model Context Protocol Registry上搜索mysql:

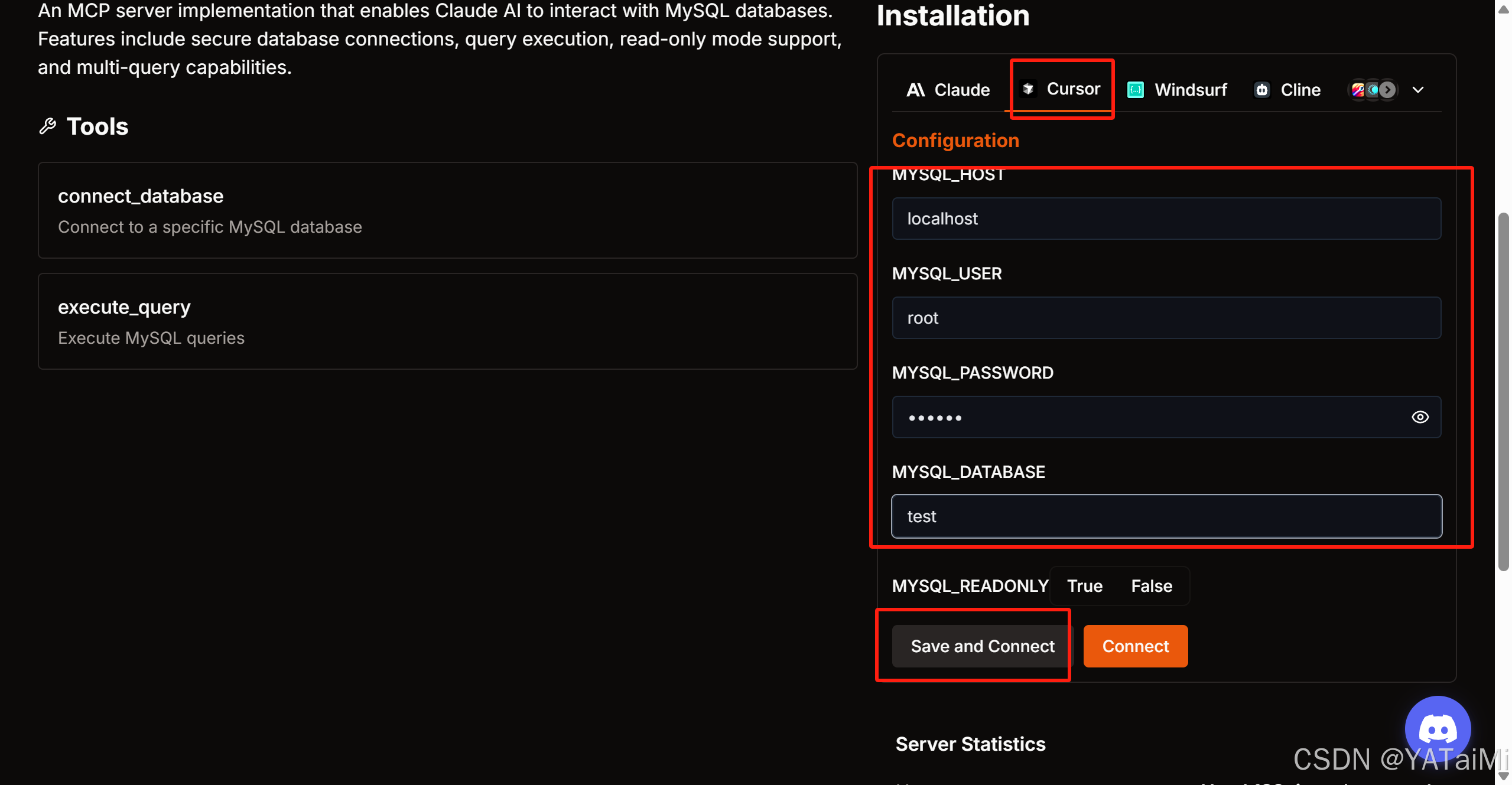

2. 点击Cursor=>输入数据库连接信息=>点击 Save and Connect

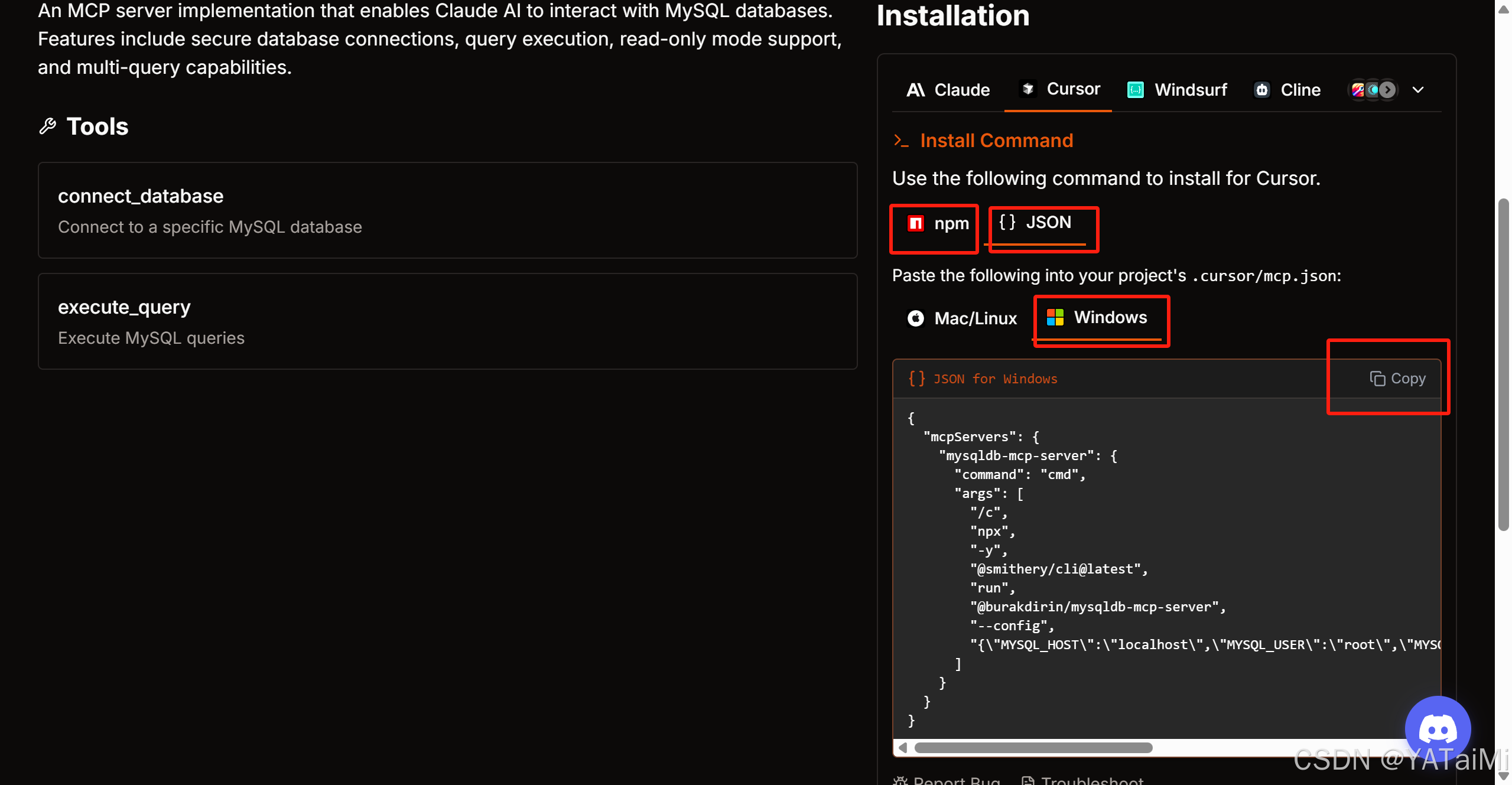

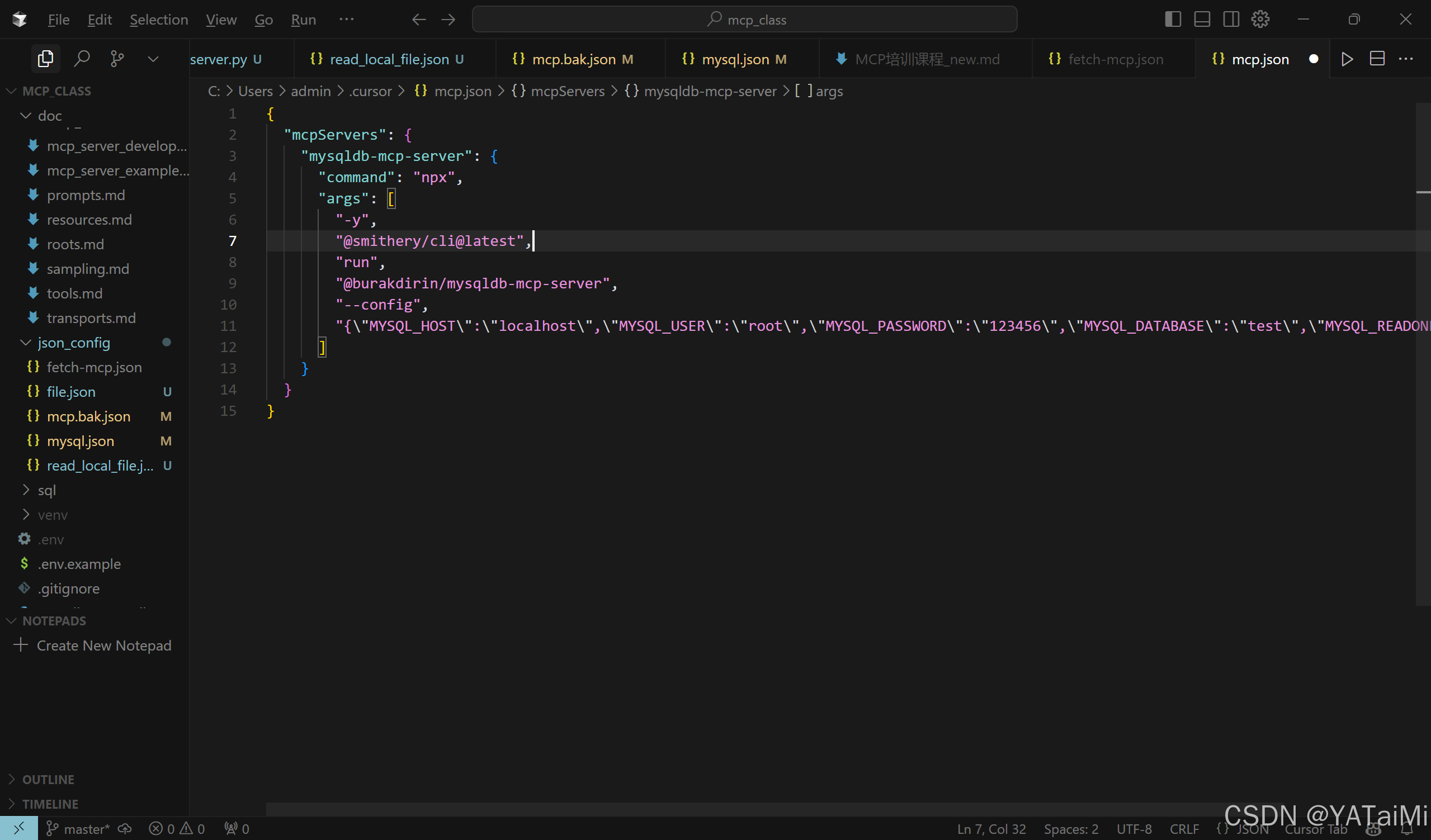

3. 0.46及以下用命令,0.47及以上用json=>选择操作系统=>复制json/npm命令

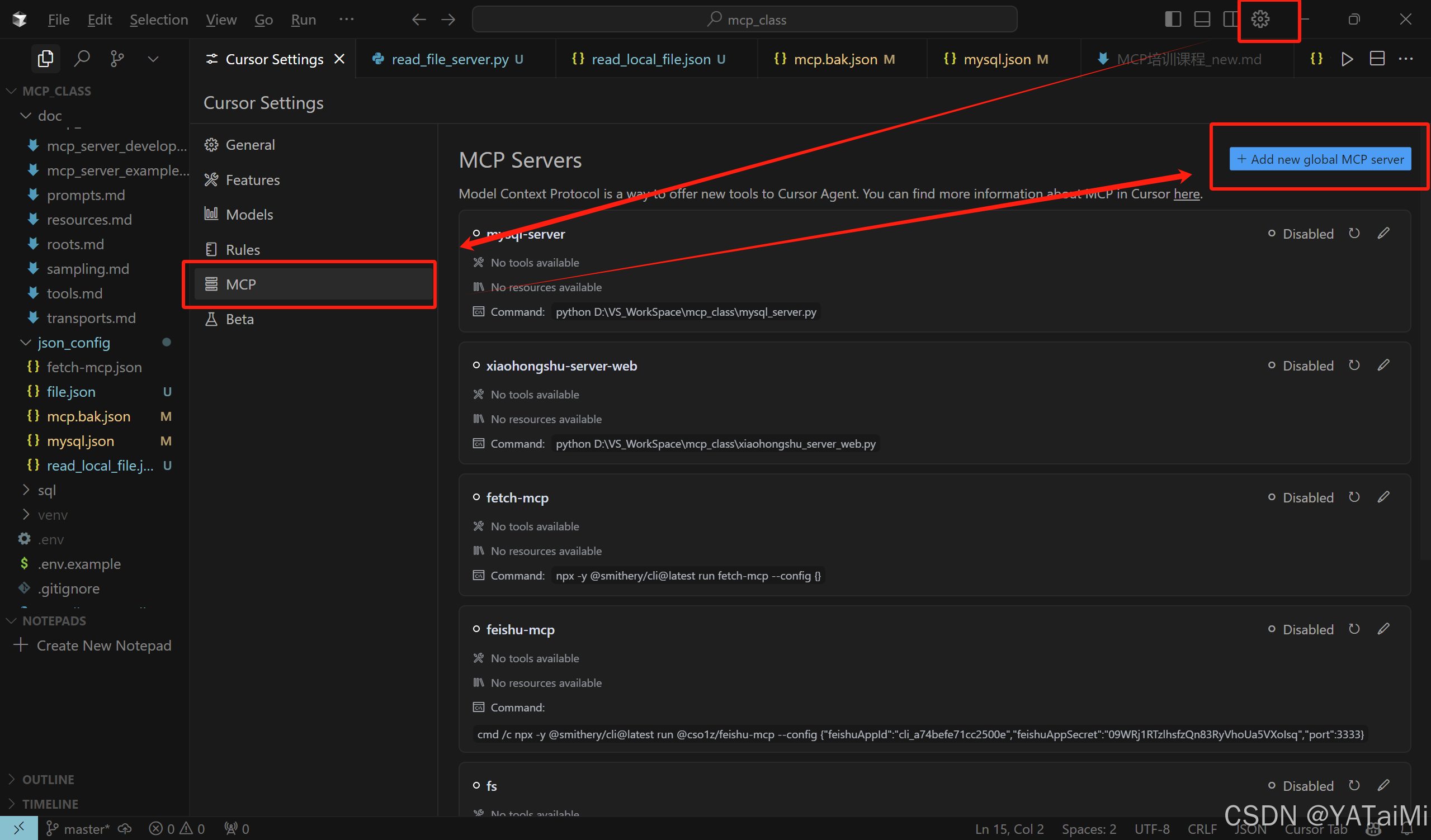

4. 配置到Cursor=> 保存

5. 等待连接成功(信号灯变成绿色就连接成功了)

6. 开始享用(注意只有 Agent模式才能够使用MCP Server)

作为开发者

如果你想构建自己的MCP服务器:

-

选择合适的编程语言SDK(Python、Java等)

-

根据MCP规范开发服务器

-

测试并部署你的服务器

直观感受

最后通过不同MCP Server的配置来直观地感受一下为什么说MCP就是一个规范

{

"mcpServers": {

"fetch-mcp": {

"command": "npx",

"args": [

"-y",

"@smithery/cli@latest",

"run",

"fetch-mcp",

"--config",

"{}"

]

}

}

}

{

"mcpServers": {

"fs": {

"command": "cmd",

"args": [

"/c",

"npx",

"-y",

"@smithery/cli@latest",

"run",

"@bunasQ/fs",

"--config",

"{}"

]

}

}

}

{

"mcpServers": {

"excel-reader": {

"name": "Excel文件读取器",

"description": "提供通过路径读取Windows本地Excel文件的功能",

"command": "python",

"args": ["D:\\VS_WorkSpace\\mcp_class\\read_file_server.py"]

}

}

}机智如你是不是已经看出端倪了呢?

结语

AI技术的浪潮正在改变各行各业,MCP作为连接AI与外部世界的标准接口,将大大降低AI应用的门槛。无论你是技术专家还是普通用户,了解MCP都能帮助你更好地利用AI工具。

正如开头所说,我希望这篇文章能帮助所有人——无论是技术人员还是非技术人员——降低使用AI技术的门槛,一起享受人工智能带来的美好生活。

这期主要是讲了一些通识性的概念。下一期,我们将从实战角度出发,手动实现一个MCP Server和Client来理解清楚原理。敬请期待!(感兴趣的可以点个关注哦!)

如果你觉得这篇文章对你有帮助,别忘了点赞、分享,并在评论区告诉我们你的使用体验!

352

352

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?