论文解读:《RECURRENT NEURAL NETWORK REGULARIZATION》

论文地址:https://arxiv.org/pdf/1409.2329.pdf

1.RNN简介

RNN(Recurrent Neural Network)是一类用于处理序列数据的神经网络。神经网络包含输入层、隐层、输出层,通过激活函数控制输出,层与层之间通过权值连接。下图一个标准的RNN结构图,图中每个箭头代表做一次变换,也就是说箭头连接带有权值。左侧是折叠起来的样子,右侧是展开的样子,左侧中h旁边的箭头代表此结构中的“循环“体现在隐层。图中O代表输出,y代表样本给出的确定值,L代表损失函数。

我们可以做这样的定义:

X(t):表示t时刻的输入,o(t):表示t时刻的输出,h(t):表示t时刻的记忆

神经网络最擅长做的就是通过一系列参数把很多内容整合到一起,然后学习这个参数,RNN在这点上也类似,因此就定义了RNN的基础:

St=f(U∗X(t)+W∗h(t)−1)

RNN的想法就是预测的时候带着当前时刻的记忆h(t)去预测。假如你要预测下一个词出现的概率,可以运用softmax来预测每个词出现的概率,但预测不能直接带用一个矩阵来预测呀,所有预测的时候还要带一个权重矩阵V,用公式表示为:

o(t)=softmax(Vh(t))

2.LSTM 网络

Long Short Term Memory networks(以下简称LSTMs),一种特殊的RNN网络,该网络是由 Hochreiter & Schmidhuber (1997)为了解决长依赖问题设计出来。

所有循环神经网络都具有神经网络的重复模块链的形式。 在标准的RNN中,该重复模块将具有非常简单的结构,例如单个tanh层。标准的RNN网络如下图所示:

LSTMs也具有这种链式结构,但是它的重复单元不同于标准RNN网络里的单元只有一个网络层,它的内部有四个网络层。LSTMs的结构如下图所示:

图中黄色类似于CNN里的激活函数操作,粉色圆圈表示点操作,单箭头表示数据流向,箭头合并表示向量的合并(concat)操作,箭头分叉表示向量的拷贝操作。

3.论文解读

3.1 文章概述

该论文针对具有长短期记忆(LSTM)单元的递归神经网络(RNNs),提出了一种简单的正则化技术。Dropout是使神经网络正规化最成功的技术,但在RNN和LSTM中不能很好地工作,作者将Dropout成功的应用到LSTM中,并用实验证明它大大减少了在各种任务中的过度拟合。

3.2 介绍(RNN详情见上文)

循环神经网络(RNN)是一个连续神经网络,用于解决语言模型、语音重建和机器翻译等问题。不幸的是,dropout在RNNs中表现不佳,在比较大的RNN网络中,常常出现过拟合现象。论文提出了一个很好的使用dropout的技巧来解决这个过拟合的问题。

dropout在RNN中表现不佳是由于循环增大了噪声,该噪声对学习效果有害。论文提出的方法可以通过在RNN的一些子集连接中使用dropout来解决这个问题。

3.3 相关工作

作者列举了一些近些年的成果

正则化带有 LSTM 单元的 RNN

3.3.1 LSMT单元

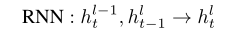

RNN方程如下,RNN动态的描述了之前状态和当前状态的转变:

在经典的RNNs网络中,该方程可表达如下;

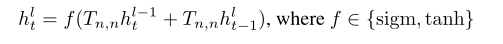

LSTM的引入,使得RNN可以记住一定数量步骤的的信息,同时也使得上述过程复杂化,CtL∈Rn储存在一个向量中:,LSTM的结构可以由如下方程表示:

下图是LSTM的结构表示:

3.3.2 具有 Dropout 的正则化

本文最大的突破是在没有循环连接的结构中使用dropout,在有循环连接结构中,不适用dropout,方程修改如下所示,数据流向及操作如下右图所示,虚线表示使用了dropout,实线表示没有使用dropout:

论文采用的方式使得在RNN之间的信息传递,数据计算更加具有鲁棒性,同时也保证了数据之间的相关性和完整性。下图显示了,信息从 t-2 步流向到 t+2 步中,实线表示信息数据的流向。

3.4 实验

本文做了三个领域的结果:语言建模、语音识别、机器翻译和图像字幕生成

3.4.1 语言建模

在宾夕法尼亚树库(PTB)数据集Marcus等人的基础上进行了词级预测实验。将以前的结果与我们的LSTM进行了比较,结果如下:

3.4.2 语音识别

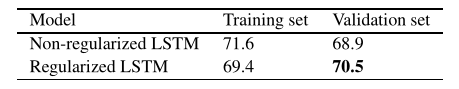

声学建模是将声学信号映射到单词序列的关键组件,因为它对p(st|X)进行建模,其中st是时间t的语音状态,而X是声学观测。研究结果表明,Dropout提高了LSTM的帧精度。结果如下:

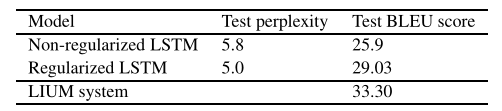

3.4.3 机器翻译

将机器翻译问题描述为语言建模任务,其中LSTM被训练为为源句的正确翻译分配高概率。研究结果表明,Dropout提高了LSTM的翻译性能。结果如下:

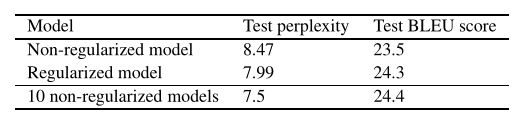

3.4.4 图像字幕

将Dropout变体应用于Vinyals等人的图像字幕生成模型。结果总结在下表中。相对于不使用Dropout,Dropout是有帮助的,但是使用集成消除了Dropout所获得的增益。结果如下:

3.5 结论

给出了一种简单的将Dropout应用于LSTM的方法,使得不同领域中的几个问题的性能都有了很大的提高。本文提出的方法使得Dropout对于RNNs很有用,实验结果表明Dropout实现可以提高各种应用程序的性能。

参考:

https://blog.csdn.net/qq_39422642/article/details/78676567

https://blog.csdn.net/qq_32172681/article/details/100060263

https://www.jianshu.com/p/95d5c461924c

6773

6773

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?