原文链接:http://www.jianshu.com/p/4a40f90f0d98

著作权归作者所有,转载请联系作者获得授权,并标注“简书作者”。

The Hinge Loss 定义为 E(z) = max(0,1-z),在图中是蓝色的线所表示的那个,the Log Loss 为红色的线所表示,而 the Square Loss 是绿色 the misclassification error 用黑色表示。

Figure 1 来自 Chris Bishop's PRML book

Hinge Loss 最常用在 SVM 中的最大化间隔分类中[1]。

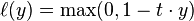

对可能的输出 t = ±1 和分类器分数 y,预测值 y 的 hinge loss 定义如下:

看到 y 应当是分类器决策函数的“原始”输出,而不是最终的类标。例如,在线性的 SVM 中

可以看出当 t 和 y 有相同的符号时(意味着 y 预测出正确的分类)

此时的 hinge loss

但是如果它们的符号相反

则会根据 y 线性增加 one-sided error。

扩展

尽管 SVM 常常被采用 1 v all 或者 1v1 的方式扩展到 multiclass classification中 [2],事实上还有一种“真正的”多类 Hinge loss 版本,由Crammer and Singer,[3]提出,

在[4]中给出定义了。

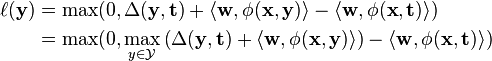

在 结构化推断structured prediction中,hinge loss 可以被更远地扩展到结构话输出空间上。采用下面的变体的间隔重形变技术的Structured SVMs ,其中 y 表示 SVM 的参数, φ 是联合特征函数, 而 Δ 是 Hamming loss:

优化

Hinge loss 是一个 凸函数, 所以很多常用的凸优化技术都可以使用。不过它是不可微的, 只是有subgradient

这个是跟线性 SVM 的模型参数 w 相关,其得分函数为

然而,因为 Hinge loss 的导数不是确定型的,

所以人们多采用平滑后的版本进行优化,例如二次平滑

在这篇文章中 Zhang 提出这样的想法。[5]

[Modified Huber loss] 是这个 loss function 的特例 [5],其中

参考:

[1]: Rosasco, L.; De Vito, E. D.; Caponnetto, A.; Piana, M.; Verri, A. (2004). "Are Loss Functions All the Same?". ↩

[2]: Duan, K. B.; Keerthi, S. S. (2005). "Which Is the Best Multiclass SVM Method? An Empirical Study". Multiple Classifier Systems. [LNCS] ↩

[3]: Crammer, Koby; Singer, Yoram (2001). "On the algorithmic implementation of multiclass kernel-based vector machines". [J. Machine Learning Research] ↩

[4]: Moore, Robert C.; DeNero, John (2011). "L1 and L2 regularization for multiclass hinge loss models". ↩

[5]: Zhang, Tong (2004). Solving large scale linear prediction problems using stochastic gradient descent algorithms. ICML. ↩

500

500

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?