前言

Gatys大神之前发表了一篇利用风格迁移进行作画的文章,让普通的照片具有名人的画风,效果如下:

让一篇普通的图片有了梵高的风格,厉害了。

文章链接:A Neural Algorithm of Artistic Style

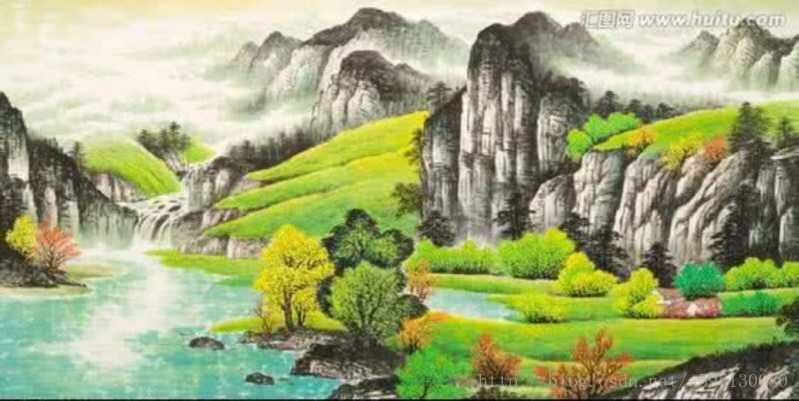

其实我们也可以利用风格迁移实现自己的风格,比如本文实现的国画风格。难点在于很多国画背景与内容色差并没西方画作那么明显,有的仅用淡墨,黑白两色就可以完成。这样给风格迁移学习带来较大困难,不过通过调节学习速率和损失函数也可以实现很好的学习效果。比如本文实现的国画风格:

风格迁移1. 马

风格迁移2. 山水

是不是很有意思!接下来我们就一起来理解实现风格迁移。

实现风格迁移主要依赖于

• torch7

• loadcaffe

• VGG-19 model

可选:

CUDA ,cuDNN,OpenCL

安装相关平台还是蛮麻烦的, 需要 protobuf, loadcaffe, torch 三件套。而且有些 trick ,比如 lua 版本要足够新否则会有包安装不上的问题 (luarocks),需要查询相关安装说明,github issue 以及 FAQ 耐心解决。

相关代码整理在我的GitHub上,感兴趣的同学可以直接克隆下来调试玩一玩。

GitHub地址:https://github.com/TONYCHANBB/Chinese_painting-style

原理

回到原理上来,作者定义了两个损失函数:style loss 和 content loss,回到文章初始的图上来

将图a的style loss 和 图p的content loss 组合起来,最小化total loss function求得x

其中, α α , β β 对应两个loss的权重,调节它们会得到不同的效果。

如何得到两个损失函数和内容风格重建呢呢,我们回到网络结构上来,作者利用了VGG-Network16个卷积层和5个池化层,没有用全连接层,采用的平均池化。(文末有VGG的网络结构图)

对于内容重建来说,用了原始网络的五个卷积层,‘conv1_1’ (a), ‘conv2_1’ (b), ‘conv3_1’ (c), ‘conv4_1’ (d) and ‘conv5_1’ (e),即图下方中的a、b、c、d、e。VGG 网络主要用来做内容识别,在实践中作者发现,使用前三层a、b、c已经能够达到比较好的内容重建工作,d、e两层保留了一些比较高层的特征,丢失了一些细节。

对于风格重建,用了卷积层的不同子集:

‘conv1_1’ (a),

‘conv1_1’ and ‘conv2_1’ (b),

‘conv1_1’, ‘conv2_1’ and ‘conv3_1’ (c),

‘conv1_1’, ‘conv2_1’ , ‘conv3_1’and ‘conv4_1’ (d),

‘conv1_1’, ‘conv2_1’ , ‘conv3_1’, ‘conv4_1’and ‘conv5_1’ (e)

这样构建网络可以忽略图像的内容,保留风格。

内容损失函数:

Lcontent L c o n t e n t 采用平方损失函数,为每个像素的损失和

本文介绍了风格迁移的原理和实现方法,利用VGG-19模型,通过风格损失和内容损失函数实现图像的艺术风格转换。作者提供GitHub代码,详细讲解了内容重建和风格重建的过程,并给出了优化建议,鼓励读者尝试不同的参数和网络结构,进行视频风格转化等创新应用。

本文介绍了风格迁移的原理和实现方法,利用VGG-19模型,通过风格损失和内容损失函数实现图像的艺术风格转换。作者提供GitHub代码,详细讲解了内容重建和风格重建的过程,并给出了优化建议,鼓励读者尝试不同的参数和网络结构,进行视频风格转化等创新应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2664

2664

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?