机器学习正则化笔记概要

正则化(regularization)是用于抑制过拟合的方法的统称,它通过动态调整估计参数的取值来降低模型的复杂度,以偏差的增加为代价来换取方差的下降。

在线性回归里,最常见的正则化方式就是在损失函数(loss function)中添加正则化项(regularizer),而添加的正则化项 R(λ) 往往是待估计参数的 p- 范数。将均方误差和参数的范数之和作为一个整体来进行约束优化,相当于额外添加了一重关于参数的限制条件,避免大量参数同时出现较大的取值。由于正则化的作用通常是让参数估计值的幅度下降,因此在统计学中它也被称为系数收缩方法(shrinkage method)。

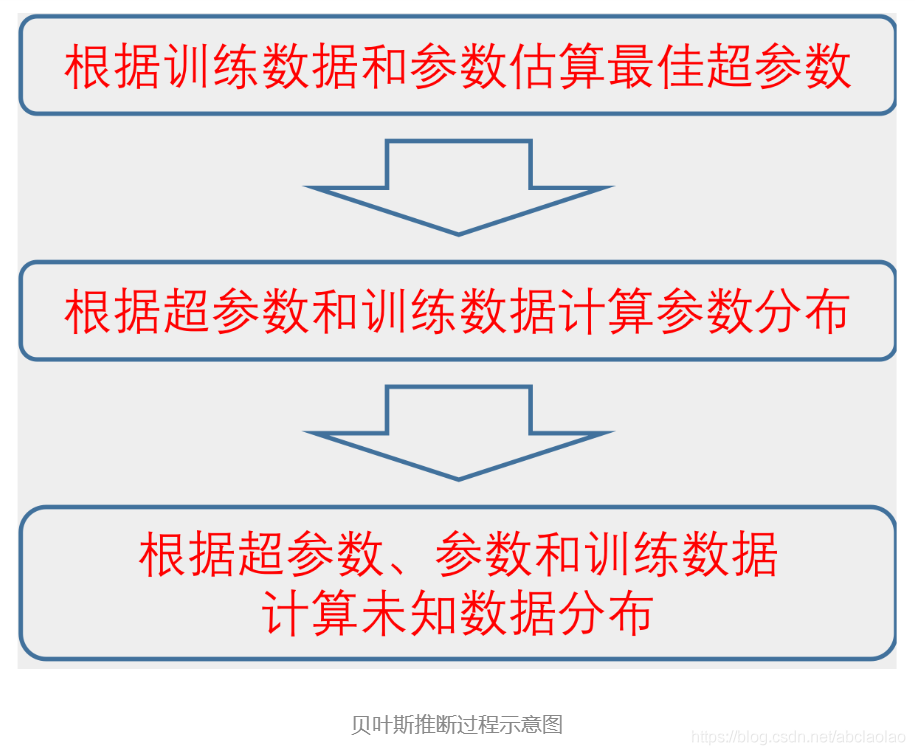

总结起来:利用贝叶斯概率来确定最优参数的步骤可以归纳如下:求解的对象是已知训练数据时,测试数据的条件概率 p(y∗|y),要计算这个条件概率就要对所有未知的参数和超参数进行积分,以消除这些变量。

而在已知的数据和未知的超参数之间搭起一座桥梁的,正是待估计的参数 w,它将 p(y∗|y) 的求解分解成两部分,一部分是根据已知数据推断参数,另一部分是根据参数推断未知数据。

而在根据已知数据推断参数时,又要先推断超参数,再利用超参数和数据一块儿推断参数。对超参数的推断则可以通过边际似然概率简化。

正则化的作用是抑制过拟合,通过增加偏差来降低方差,提升模型的泛化性能;

正则化项的作用是对解空间添加约束,在约束范围内寻找产生最小误差的系数;

频率视角下的正则化与贝叶斯视角下的边际化作用相同;

边际化对未知的参数和超参数进行积分以消除它们的影响,天然具有模型选择的功能。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?