集成学习方法-Boosting-Adaboost

Adaboost算法:

AdaBoost,英文为‘Adaptive Boosting’,它的自适应在于:1. 样本权重的自适应学习 2. 模型系数的自适应学习。相对于RF算法,Adaboost更加专注于偏差,它可以降低基学习器的偏差,对基学习器进行进一步的提升。

算法流程:

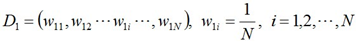

(1) 初始化训练数据的权值分布,对每个样本赋予同样的权值W=1/N。

(2) 对于m轮更迭,如m=1,2,3…..M

- (a) 使用具有权值分布的Dm的训练数据集来进行学习,并得到基本分类器Gm(x)

- (b) 计算在训练数据集上的分类误差率em

- © 计算模型Gm(x)的系数am

- (d) 更新训练集的权重分布,Dm+1

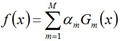

(3) 组合基本分类器:

最终分类器即为:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

684

684

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?