点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

转载自:新智元 | 编辑:桃子 好困

【导读】8月16日,未来科学大奖正式揭晓!数学与计算机科学奖表彰创世研究ResNet,何恺明、孙剑、任少卿、张祥雨4人摘桂冠。

刚刚,2023未来科学大奖获奖名单重磅揭晓!

值得一提的是,今年「数学与计算机科学奖」颁给了创世研究ResNet的团队,表彰他们人工智能做出了基础性贡献。

2016年,何恺明、张祥雨、任少卿、孙剑在微软期间发表了开创工作「深度残差网络」,让训练数千层神经网络成为可能。

不仅如此,四人平均年龄只有38岁出头,其中,张祥雨是「未来科学大奖」第一个90后,也是目前最年轻的获奖人。

论文地址:https://arxiv.org/abs/1512.03385

至今,这篇研究引用数已经超过18万。

其中,AI大牛、旷视前首席科学家孙剑博士已于2022年6月14日突发疾病离世。这也是「未来科学大奖」开创先例,为去世的技术大神首次颁奖。

另外,柴继杰、周俭民荣获「生命科学奖」,赵忠贤、陈仙辉获得「物质科学奖」。

据介绍,这次奖项中,单项奖金100万美元(约730万人民币)。

数学与计算机科学奖,ResNet摘冠

评语:表彰他们提出深度残差学习,为人工智能做出了基础性贡献。

深度神经网络推动了人工智能的革命和发展。其中,增加神经网络的深度是在许多人工智能应用中带来突破性进展的关键。获奖团队提出了深度残差学习,使神经网络能够达到前所未有的深度,获得以前难以实现的能力,促成了多个突破性的成果——包括AlphaGo,AlphaFold和ChatGPT。

获奖工作是四位获奖者在2012至2016年间于北京的微软亚洲研究院完成的。

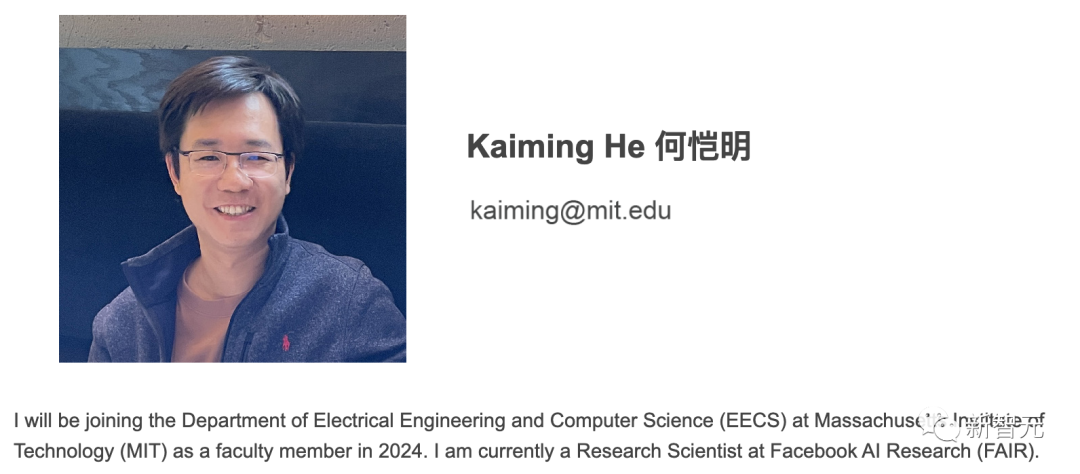

何恺明

Kaiming He

何恺明,清华大学学士(2007年),香港中文大学博士(2011年)。一直以来,担任Meta人工智能实验室的研究科学家。

近来,他在个人主页官宣,即将在2024年入职MIT,但仍EECS系的教师。

何恺明本人在计算机视觉和深度学习领域发表了一系列极具影响力的论文。

作为ResNet的一作,何恺明的这篇研究是2019年、2020年和2021年谷歌学术指标中,所有研究领域被引用次数最多的论文,并为现代深度学习模型中建立了一个基本组件,比如,Transformer、AlphaGo Zero、AlphaFold。

另外,他在视觉目标检测和分割领域做出许多贡献,包括Faster R-CNN、Mask R-CNN。

截至目前,他的所有研究引用次数超过46万次(截至2023年7月)。

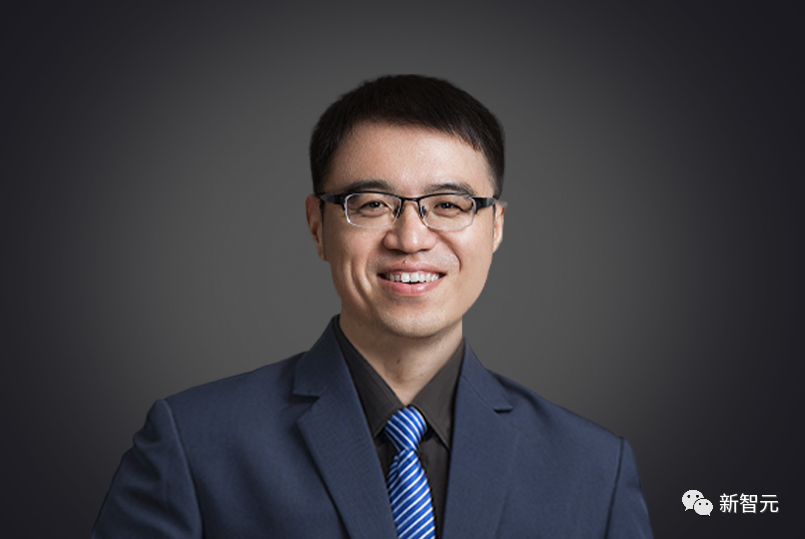

孙剑

Jian Sun

孙剑,西安交通大学学士(1997年)及博士(2003年)。

作为旷视首席科学家、旷视研究院院长,孙剑博士全面负责旷视技术研发,并带领着旷视研究院发展成为全球规模最大的计算机视觉研究院。

在孙剑博士的带领下,旷视研究院研发了包括移动端高效卷积神经网络ShuffleNet、开源深度学习框架天元MegEngine、AI生产力平台Brain++等多项创新技术,引领前沿人工智能应用。

孙剑博士的主要研究方向是计算机视觉和计算摄影学,拥有超过40项专利,自2002年以来在顶级学术会议和期刊上发表学术论文100余篇,被引数为255630。并于2009和2016年两次获得CVPR计算机视觉年会的最佳论文奖。

任少卿

Shaoqing Ren

任少卿,中国科学技术大学学士(2011年),中国科学技术大学与微软亚洲研究院博士(2016年)。

他曾任自动驾驶公司Momenta的合伙人兼研发总监。2020年6月,出任蔚来助理副总裁、自动驾驶研发首席专家。

张祥雨

Xiangyu Zhang

张祥雨,西安交通大学学士(2012年)和西安交通大学与微软亚洲研究院博士(2017年)。

他现任旷视研究院主任研究员、西安交通大学人工智能学院兼职教授。他年仅28岁就成为了旷视研究院基础模型组的负责人,为公司开辟基础算法新路。

物质科学奖

评语:表彰他们为发现抗病小体并阐明其结构和在抗植物病虫害中的功能做出的开创性工作。

超导体作为一种量子材料,其独特的零电阻和完全抗磁性特性,在能源、信息、医疗、交通和电力等领域带来深刻变革,有极大的应用前景。传统的超导材料达到超导状态的转变温度都很低(低于-230摄氏度)。高温超导材料的出现极大地提高了超导现象可以存在的温度范围。一方面这为超导材料的大规模应用提供了更多可能性,同时也揭示出形成超导现象的物理机制的复杂性。

赵忠贤和陈仙辉在高温超导材料的发现和发展方面做出了杰出的贡献。高温超导材料主要有两大类:铜氧化物超导体和铁基超导体。在铜氧化物方面,赵忠贤领导的团队独立发现了第一个液氮温区的超导材料。在铁基超导体方面,陈仙辉研究组首先将超导转变温度提高到麦克米兰极限之上,证明铁基超导体确实是非常规的高温超导体,而赵忠贤研究组创造并保持了在块状材料中超导转变温度的记录。在提高超导转变温度的同时,赵忠贤和陈仙辉对于高温超导的物理机制做了大量系统性的研究,在过去数十年内推动了高温超导领域的发展。

赵忠贤

Zhongxian Zhao

赵忠贤,1941年出生于辽宁新民,1964年毕业于中国科学技术大学技术物理系。

陈仙辉

Xianhui Chen

陈仙辉,1963年出生于湖南湘潭,1992年获中国科学技术大学凝聚态物理专业博士学位。

生命科学奖

评语:表彰他们为发现抗病小体并阐明其结构和在抗植物病虫害中的功能做出的开创性工作。

植物病害的爆发对社会文明产生过重大的影响。目前,全球粮食产量的 40% 可因植物害虫和病原体而损失。20世纪40年代植物抗性位点的发现表明植物具有先天免疫机制。1994 年,植物抗性基因的克隆从分子上证明了这一假设。这些抗性基因编码核苷酸结合域和富含亮氨酸的重复序列的免疫受体,构成了植物针对多种病原体和某些昆虫的主要免疫机制。然而,这些免疫受体如何启动植物的防卫反应一直是个谜。

通过19年的合作和努力,柴继杰博士和周俭民博士确立了由免疫受体激活的抗病小体的组成、结构和功能。他们发现抗病小体是由免疫受体蛋白在识别病原体效应子后形成的多组分复合体,并发现这种复合体通过形成钙离子通道引起植物免疫反应包括程序性细胞死亡,从而保护植物免受感染。这个发现将带来更好的植物病害控制方法,对全球粮食安全具有极其重要的意义。因此授予柴继杰博士和周俭民博士未来科学大奖-生命科学奖,以表彰他们对解析植物先天免疫机制做出的开创性贡献。

柴继杰

Jijie Chai

柴继杰,1966年生于中国辽宁,1997年获得中国医学科学院北京协和医学院药物研究所分析化学博士学位。

周俭民

Jian-min Zhou

周俭民,1964年生于中国四川,1994年获得普渡大学园艺系博士学位。

参考资料:

http://www.futureprize.org/cn/nav/detail/1435.html

ICCV / CVPR 2023论文和代码下载

后台回复:CVPR2023,即可下载CVPR 2023论文和代码开源的论文合集

后台回复:ICCV2023,即可下载ICCV 2023论文和代码开源的论文合集目标检测和Transformer交流群成立

扫描下方二维码,或者添加微信:CVer333,即可添加CVer小助手微信,便可申请加入CVer-目标检测或者Transformer 微信交流群。另外其他垂直方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch、TensorFlow和Transformer、NeRF等。

一定要备注:研究方向+地点+学校/公司+昵称(如目标检测或者Transformer+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲扫码或加微信号: CVer333,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉,已汇集数千人!

▲扫码进星球

▲点击上方卡片,关注CVer公众号整理不易,请点赞和在看![]()

2151

2151

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?