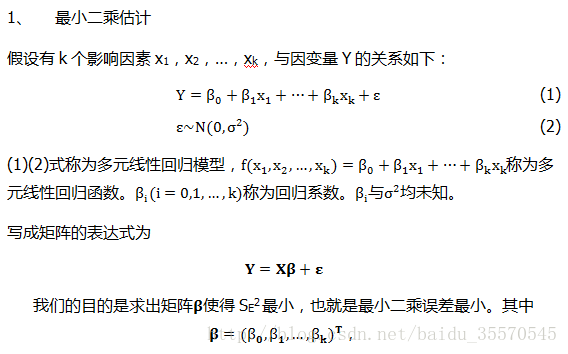

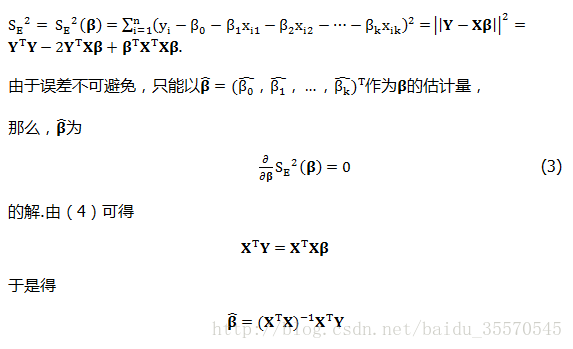

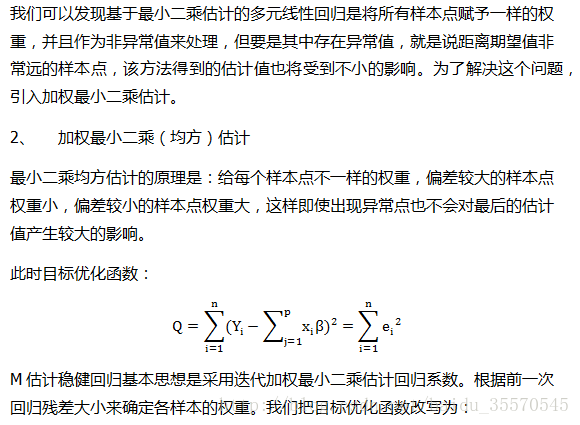

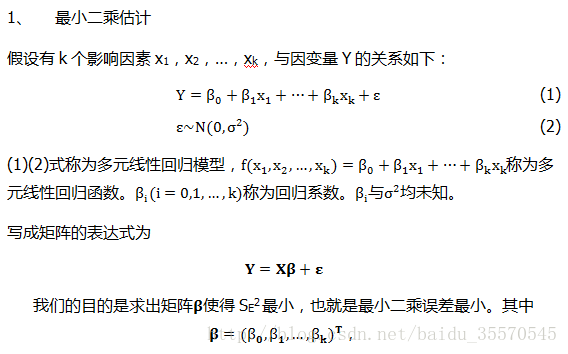

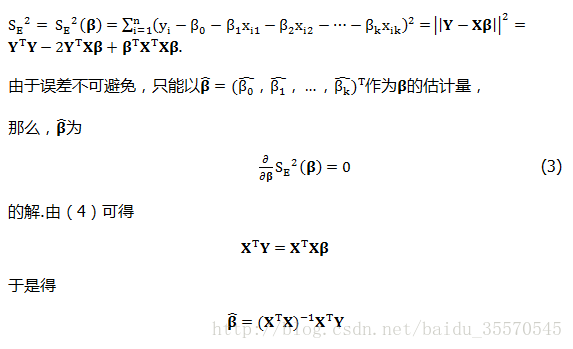

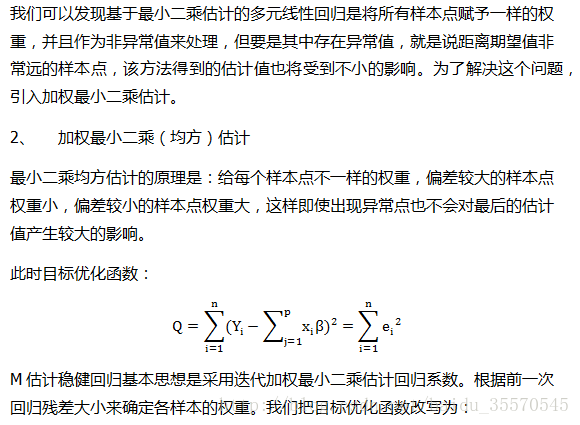

摘要:稳健估计是在粗差不可避免的情况下,选择适当的估计方法使未知量估计尽可能减免粗差的影响,得出正常模式下的最佳估计。本文先介绍基于最小二乘法的多元线性回归理论,再引出基于M估计的加权最小二乘估计。

关键词:稳健估计,M估计,最小二乘法,加权,极限学习机

稳健估计/M估计/最小二乘法

最新推荐文章于 2025-03-17 14:54:01 发布

摘要:稳健估计是在粗差不可避免的情况下,选择适当的估计方法使未知量估计尽可能减免粗差的影响,得出正常模式下的最佳估计。本文先介绍基于最小二乘法的多元线性回归理论,再引出基于M估计的加权最小二乘估计。

关键词:稳健估计,M估计,最小二乘法,加权,极限学习机

869

869

1896

1896

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?