PRML学习总结之三—–概率分布之二

这一部分主要介绍机器学习之中的重要分布:高斯分布(Gaussian Distribution),高斯分布贯穿整个机器学习中的各个部分。本文主要介绍2维、3维高斯分布的特点及性质。

高斯分布的表达式

二维高斯:

多维高斯:

高斯分布的图形

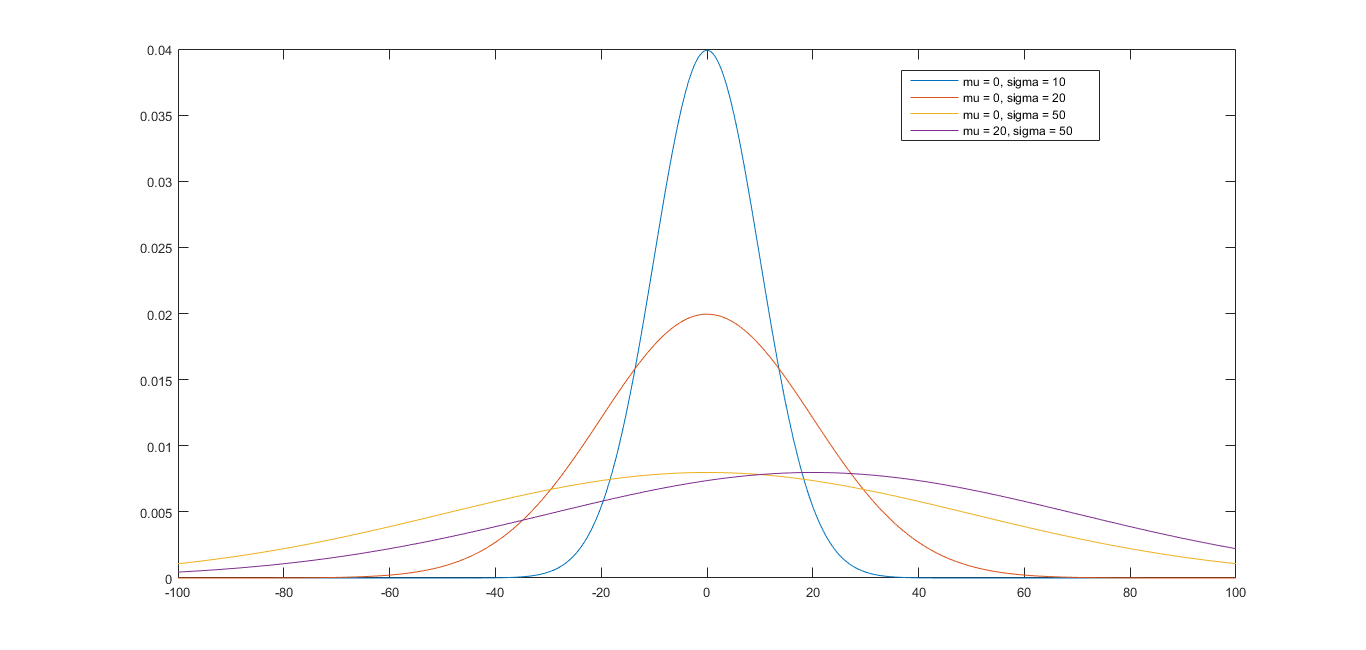

一维高斯的图形如下图,显然

x=μ

为二维高斯的对称轴,当

σ

越大时,曲线越矮胖;而当

σ

越小时,曲线越高窄。

二维高斯根据

Σ

的不同可以分为3种:

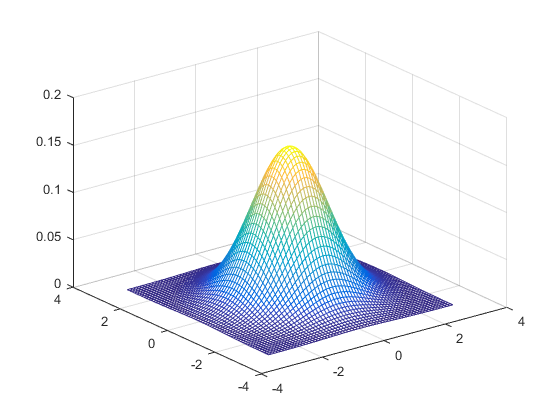

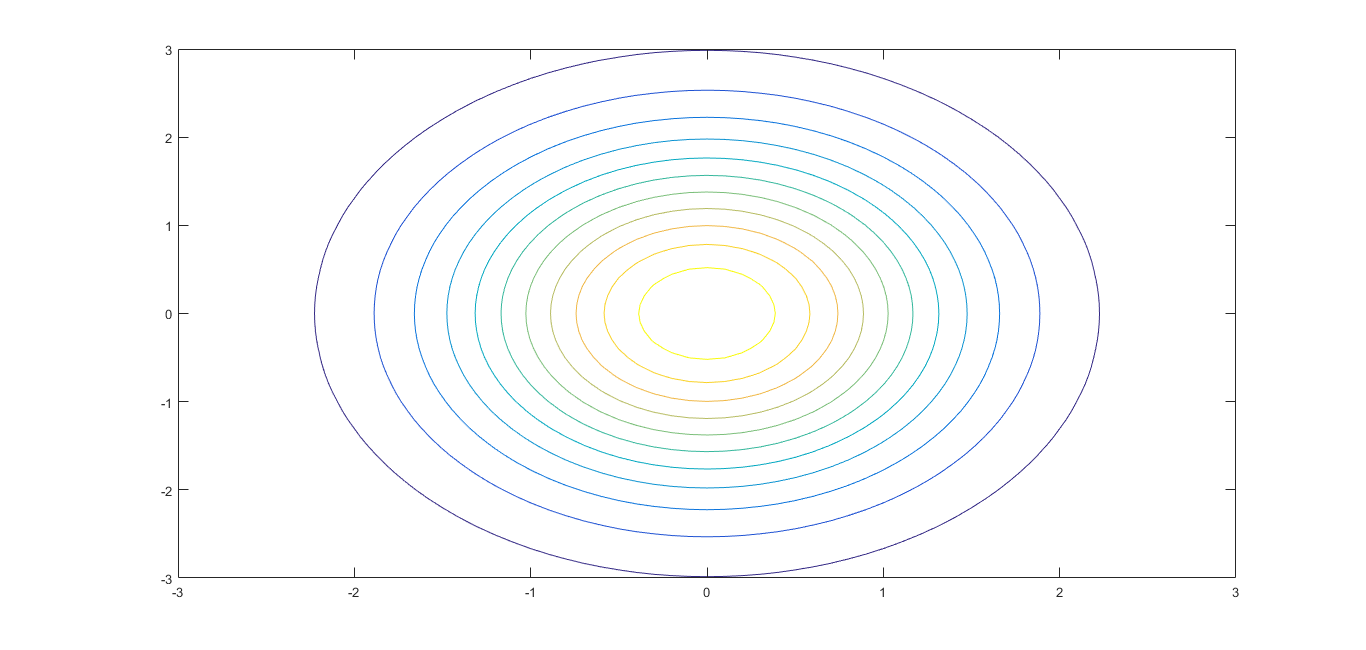

(1) 当

Σ

为对角矩阵,且对角线的元素均相等,图形如下

(

μ=[00]

,

Σ=[1001]

)

俯视图为:

显然可知俯视图为圆形。

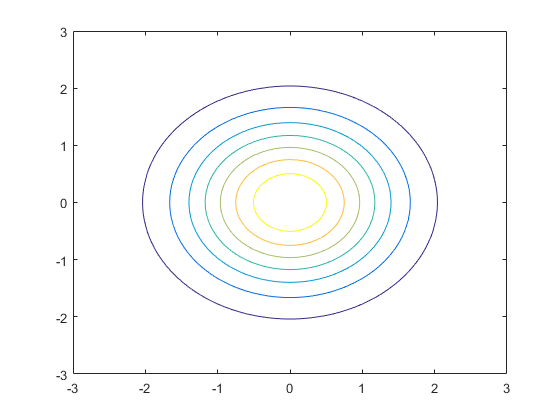

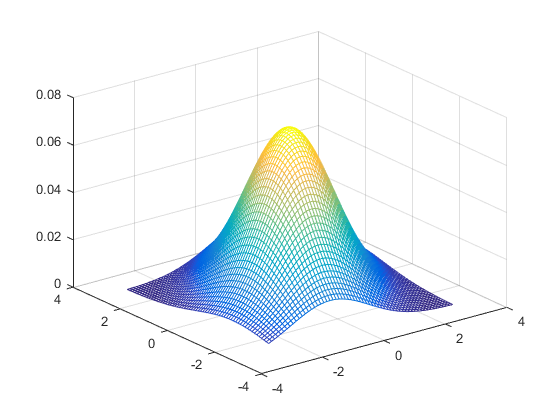

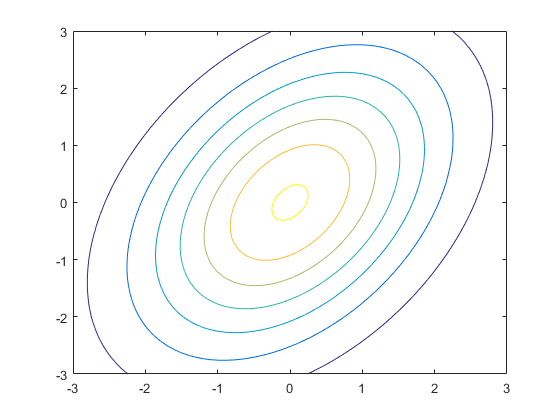

(2) 当

Σ

为对角矩阵,且对角线的元素不全相等,图形如下

(

μ=[00]

,

Σ=[1001.8]

):

俯视图为:

显然可知俯视图为椭圆,且其长轴与短轴分别与坐标轴平行。

通过对比也可以发现,当

Σ

的元素变大时, 图形变得矮胖;当

Σ

的元素较小时,图形变得瘦高。可以通过证明的是椭圆的长轴与短轴的长度恰恰是

Σ

的2个特征根的平方根。而方向则恰恰等于其特征向量的方向。

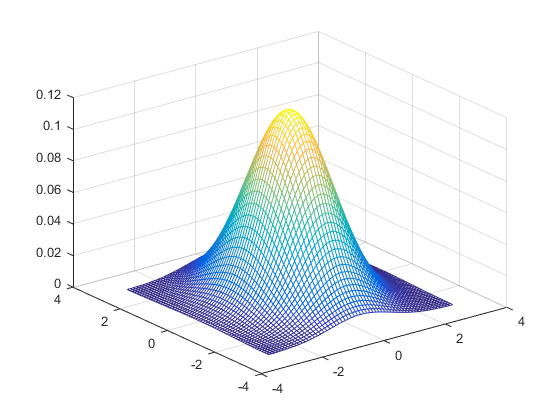

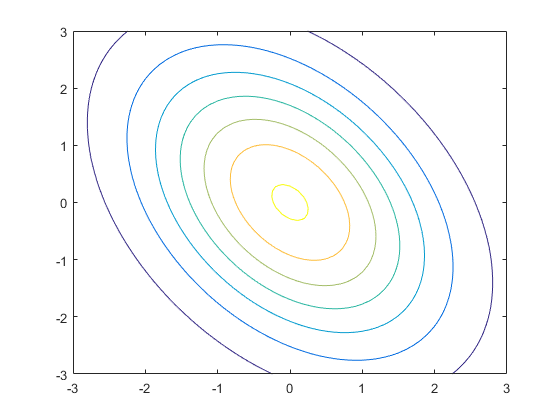

(3) 当

Σ

为非对角矩阵时,图形如下

(

μ=[00]

,

Σ=[2113]

)

俯视图为:

显然此时俯视图为椭圆,另一俯视图

(

μ=[00]

,

Σ=[2−1−13]

)

其中绘制2维高斯的matlab代码如下所示:

function [] = showGaussian2(mu, sigma)

[x,y] = meshgrid(-3:0.1:3,-3:0.1:3) ;

z = zeros(size(x));

m = length(x);

for i = 1:m,

for j = 1:m,

v = [x(i,j);y(i,j)] - mu;

z(i,j) = 1/(2*pi*(det(sigma)^0.5)) * exp(-0.5*v'*pinv(sigma)*v);

end;

end;

figure;mesh(x, y, z);

figure;contour(x, y, z);条件高斯分布

设原高斯分布为

p(x)=N(x|μ,Σ)

, 且

x=[x1x2]

,

μ=[μ1μ2]

,

Σ=[Σ11Σ21Σ12Σ22]

,

则在

x2

已知的前提下,

x1

仍为高斯分布,其形式如下:

注意到 μ1|2 是 x2 的线性函数,而这是很典型的线性高斯模型。

边缘高斯分布

类似条件高斯分布的假设,通过计算知 x1 依然是服从高斯分布,且其中

边缘与条件高斯

假设给定了x的边缘分布与给定x的情况下y的条件分布如下所示:

则根据Bayesian定理,可知:

高斯分布参数的共轭先验分布

高斯分布参数的先验分布主要可以分为4种情况:

(1) 当

Σ

已知,

μ

未知时, 参数

μ

的共轭先验分布为高斯分布;

(2)当

Σ

未知,

μ

已知时, 当参数为1维时,参数

Σ

的共轭先验分布为Gamma分布;当参数为2维时,

Σ

的共轭先验分布为Wishart分布;

(3)当

Σ

未知,

μ

未知时, 当参数为1维时,参数

Σ,μ

的共轭先验分布为Gaussian-Gamma分布;当参数为2维时,

Σ

的共轭先验分布为Gaussian-Wishart分布;

高斯分布的评价

优势

在不同学科的模型与生活中的多种场景中,利用高斯分布进行估计与模拟可以产生相当精确的结果。

不足:

(1)对于多维高斯,

Σ,μ

参数很多,假设参数维度为D,则

μ

包含D个参数,而对于普通的对称矩阵

Σ

也有

D(D+1)/2

个参数,总计有

D(D+3)/2

个参数。若D很大,则参数的估计计算很麻烦。

(2)由于仅含有唯一的最大值,高斯分布十分适用于单模型,而无法适用于多模型,这样就大大的增加了其局限性。不过,混合高斯可以很好地解决这个问题。

(3)由于高斯分布的尾巴很短,则对于一些偏离中心的孤立点往往不能给出很好地效果,因此利用高斯分布构建的模型可能并不健壮。

1342

1342

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?