©PaperWeekly 原创 · 作者 | 张永祺

单位 | 第四范式

研究方向 | 知识图谱表示与推理

论文标题:

KGTuner: Efficient Hyper-parameter Search for Knowledge Graph Learning

收录会议:

ACL 2022

论文地址:

https://aclanthology.org/2022.acl-long.194.pdf

代码链接:

https://github.com/AutoML-Research/KGTuner

内容概要

超参数搜索,是机器学习模型获得良好性能的关键。对于知识图谱的学习来说,同样是一个重要问题,一方面超参数的好坏会严重影响模型性能,另一方面模型训练时间长,现有的超参数搜索算法在这一问题上一个个尝试不同超参数配置,往往效率低下。为解决这一问题,我们详细地分析了知识图谱学习中不同超参数的性质,及子图到全图的迁移能力。

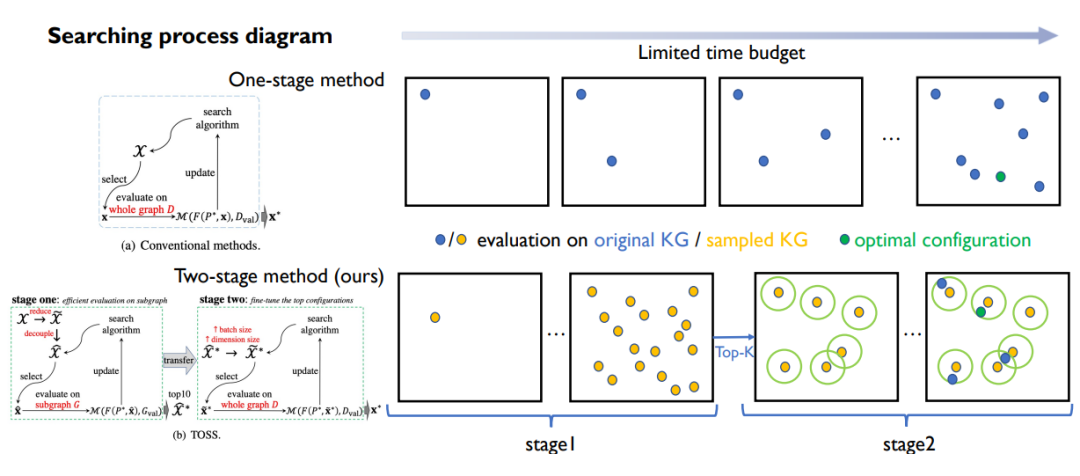

基于分析,我们提出两阶段的超参数搜索算法 KGTuner,如图 1 所示,我们在第一阶段利用子图高效地探索大量超参数,并将性能最好的几组超参数配置迁移到全图上,在第二阶段进行微调。实验表明,两阶段搜索算法大大提升了超参数搜索效率,在不同的大规模知识图谱链接预测任务上,均获得了性能的提升。

▲ 图1. KGTuner: 两阶段超参数搜索算法

问题定义

首先,我们将知识图谱学习问题,抽象成图1所示的框架,共包括五个重要组成部分:打分函数(scoring function),负采样(negative sampling),

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1964

1964

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?