©PaperWeekly 原创 · 作者 | 陈首元、王胜铭等

单位 | Meta Platform Inc

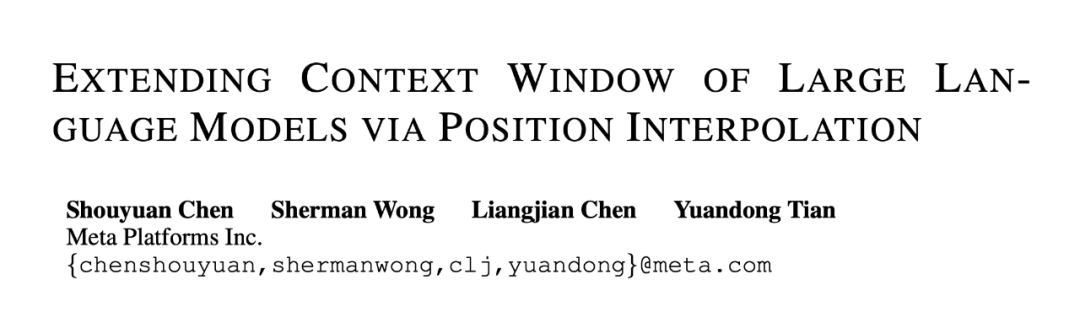

论文标题:

Extending Context Window of Large Language Models via Positional Interpolation

论文作者:

陈首元, 王胜铭, 陈梁坚, 田渊栋

作者单位:

Meta Platform Inc

论文链接:

https://arxiv.org/abs/2306.15595

方法动机

大型语言模型(LLM)通常具有预定义的上下文窗口大小。例如,LLaMA 的输入必须少于 2048 个 Token。在进行长时间对话、总结长文档或执行长期规划等应用中,经常超过这个预设的上下文窗口限制。对于这些应用,拥有更长上下文窗口的 LLM 更受青睐。然而,从头开始训练具有较长上下文窗口的 LLM 需要巨大的投入。这自然引出一个问题:我们能否扩展现有预训练 LLM 的上下文窗口?

一种直接的方法是对现有预训练 Transformer 进行微调,使其具有更长的上下文窗口。然而,根据经验,我们发现通过这种方式训练的模型对于较长的上下文窗口适应速度很慢。在训练了 10000 个批次以上后,有效上下文窗口的增加非常小,这表明这种方法不适用于显著延长上下文窗口。

尽管一些技术(如 ALiBi 和 LeX)可以实现 Transformer 的长度外推,即在短上下文窗口上进行训练,然后在更长的上下文窗口上进行推理,但许多现有的预训练 LLM,包括 LLaMA(Touvron 等人,2023),使用具有较弱外推性质的位置编码(例如 RoPE)。因此,这些技术在扩展这些 LLM 的上下文窗口大小方面的适用性仍然有限。

在这项工作中ÿ

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

515

515

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?