©PaperWeekly 原创 · 作者 | Hongru WANG

单位 | 香港中文大学

内功和外功,作为诸多武侠小说的两大流派,有着诸多区别。内功主要是内力,外功主要是拳脚功夫,如熟知的降龙十八掌就是外家的顶峰功夫,任何武功若想发挥最大的威力都离不开内功的精深。内功是道,外功是术,道术结合,东方不败。作为一个业余的武侠小说爱好者和刚入门的科研爱好者,这次从内功和外功的两个角度出发,介绍我们我们组在 EMNLP 2023 中的两个工作,如有不当之处,敬请原谅:

论文标题:

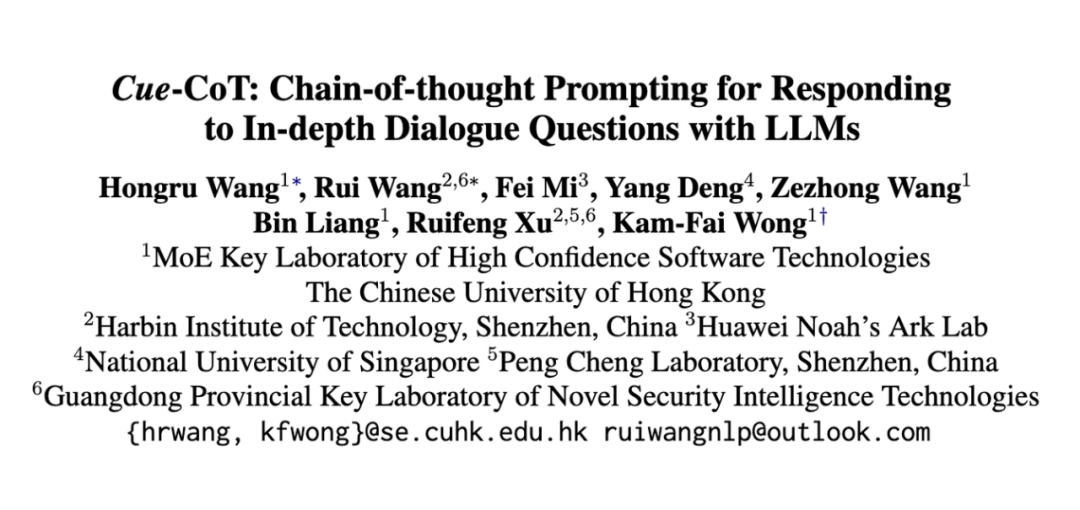

Cue-CoT: Chain-of-thought Prompting for Responding to In-depth Dialogue Questions with LLMs

论文链接:

https://arxiv.org/abs/2305.11792

代码链接:

https://github.com/ruleGreen/Cue-CoT

论文标题:

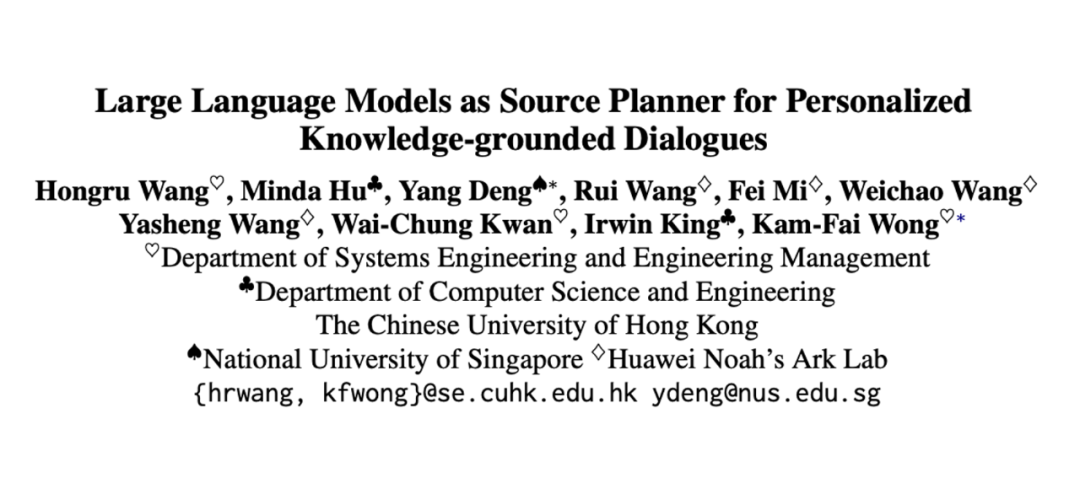

Large Language Models as Source Planner for Personalized Knowledge-grounded Dialogues

论文链接:

https://arxiv.org/pdf/2310.08840.pdf

代码链接:

https://github.com/ruleGreen/SAFARI

何为内功?

何为内功?按我的理解,要有功法,要运转多少个小周天,大周天,要有真气,真气运转之后要不变的更多,要不变的质量更好。何为功法?唯有 LLM 是也。何为小周天,大周天?唯有不同的 prompt engieering 或者说不同 path 的 chain-of-thoughts。何为真气?即为对话历史,也就是当前的输入。对话历史里面蕴藏着很多语义学线索,Mairesse 就研究过从对话历史中识别出来人物性格特点等,比如性子急的讲话就比较急躁,除此之外,其他工作也探索了类似情绪,心理状态等等不同方面的语义学线索,这些语义学线索在生成个性化回复的时候尤为重要。

正如我们人类在进行对话的时候,不可避免的会考虑对方的性格习惯,当下的情绪和心理状态等,LLM 在进行对话的时候也需要考虑到这些因素,从而生成更有帮助,更容易被用户接受的回复。而相较于传统的 standard prompting 而言,LLM 直接依赖对话历史进行回复,没有显示的建模刚刚提到的隐藏在对话历史中丰富的用户信息,我们提出一种新的 CoT 方法,Cue-CoT,把用户回复生成建模成多阶段的推理过程:

O-Cue:One-step inference, 类似于传统的 CoT,一步直接生成中间推理过程和最终回复。首先我们要求 LLM 推理出来当前对话历史里面蕴含的不同维度的用户信息(使用不同的 prompts),然后我们让 LLM 接着生成最终的回复。

本文从内功与外功的角度探讨大模型在对话系统中的应用。内功强调对话历史的深入理解和用户信息的建模,通过Cue-CoT方法提升模型的推理和解释性。外功则涉及如何利用外部知识和工具,如SAFARI框架,进行知识选择和回复生成。实验表明,内功和外功的有效结合能提高对话系统的性能和用户体验。

本文从内功与外功的角度探讨大模型在对话系统中的应用。内功强调对话历史的深入理解和用户信息的建模,通过Cue-CoT方法提升模型的推理和解释性。外功则涉及如何利用外部知识和工具,如SAFARI框架,进行知识选择和回复生成。实验表明,内功和外功的有效结合能提高对话系统的性能和用户体验。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1485

1485

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?